AIUC-1: বিশ্বস্ত এন্টারপ্রাইজ AI-এর নতুন স্বর্ণমান

CX বিশ্বাসের ব্যবধান দূর করা: AIUC-1 এর মাধ্যমে দায়িত্বশীল AI

একজন CX ডিরেক্টর মারিয়ার কথা কল্পনা করুন, যিনি CEO-এর সাথে একটি উত্তেজনাপূর্ণ ভিডিও কলে আছেন। "গত সপ্তাহে আমাদের AI চ্যাটবট একজন VIP গ্রাহককে ভুলভাবে চিহ্নিত করেছে এবং দুর্ঘটনাক্রমে তাদের একটি প্রতিযোগীর মূল্য তালিকা ইমেল করেছে," CEO রাগতভাবে বলেন। ডেটা ফাঁস হয়েছে; গ্রাহক বিশ্বাস ভেঙে গেছে। এরপরের বিশৃঙ্খলায়, IT প্রোডাক্টকে দোষারোপ করে, প্রোডাক্ট আইনি বিভাগকে দোষারোপ করে, এবং মার্কেটিং টিম নিশ্চিতও নয় কী ঘটেছে। মারিয়া বেদনাদায়কভাবে বুঝতে পারেন যে বিচ্ছিন্ন টিম এবং দ্রুত-গতিতে AI চালু করা গুরুত্বপূর্ণ ডেটা এবং গোপনীয়তা সুরক্ষা অপরিজ্ঞাত রেখে দিয়েছে – এবং তার ব্র্যান্ডের সুনাম এখন একটি সুতোর উপর ঝুলছে।

এই পরিস্থিতি কাল্পনিক নয়। AI চ্যাটবট, ভয়েস এজেন্ট এবং সুপারিশ ইঞ্জিনগুলি গ্রাহক টাচপয়েন্টে প্লাবিত হওয়ার সাথে সাথে, ত্রুটি এবং অস্পষ্ট ডেটা অনুশীলন রাতারাতি বিশ্বাস ধ্বংস করতে পারে। এন্টারপ্রাইজগুলি একটি স্পষ্ট দ্বিধাদ্বন্দ্বের মুখোমুখি: AI অতি-ব্যক্তিগতকরণ এবং দক্ষতার প্রতিশ্রুতি দেয়, কিন্তু ভুলগুলি (হ্যালুসিনেটেড উত্তর, অননুমোদিত ডেটা ব্যবহার, IP ফাঁস) গ্রাহক অভিজ্ঞতার অপূরণীয় ক্ষতি করতে পারে। CX এবং EX নেতাদের একটি নতুন প্লেবুক প্রয়োজন – AI দায়িত্বশীলভাবে পরিচালনা করার জন্য একটি কাঠামোগত কাঠামো।

মূল অন্তর্দৃষ্টি:

- ঝুঁকিতে বিশ্বাস: AI ব্যর্থতা (যেমন আত্মবিশ্বাসী ভুল উত্তর বা ডেটা ফাঁস) সরাসরি গ্রাহক বিশ্বাস এবং আনুগত্য ক্ষয় করে। সমীক্ষা দেখায় ৫৩% ভোক্তা ভয় করেন যে তাদের ব্যক্তিগত ডেটা AI দ্বারা অপব্যবহার করা হবে, এবং প্রায় অর্ধেক শুধুমাত্র তখনই আরও ডেটা শেয়ার করবেন যদি কোম্পানিগুলি বৃহত্তর স্বচ্ছতা এবং নিয়ন্ত্রণ প্রদান করে।

- প্রথম AI এজেন্ট স্ট্যান্ডার্ড: AIUC-1 হল AI এজেন্টদের জন্য বিশ্বের প্রথম ব্যাপক মান, যা এন্টারপ্রাইজ-স্কেল উদ্বেগ সমাধানের জন্য নিরাপত্তা এবং AI বিশেষজ্ঞদের দ্বারা বিকশিত। এটি মূল ঝুঁকি ডোমেইনগুলি (ডেটা এবং গোপনীয়তা, নিরাপত্তা, সুরক্ষা, নির্ভরযোগ্যতা, জবাবদিহিতা, সমাজ) জুড়ে বিস্তৃত, AI গ্রহণের জন্য একটি সাধারণ "আত্মবিশ্বাস অবকাঠামো" তৈরি করে।

- বাধ্যতামূলক ডেটা/গোপনীয়তা নিয়ন্ত্রণ: AIUC-1 কঠোর ডেটা এবং গোপনীয়তা প্রয়োজনীয়তা প্রয়োগ করে। উদাহরণস্বরূপ, এটি স্পষ্ট ইনপুট/আউটপুট ডেটা নীতি, ডেটা সংগ্রহের সীমা এবং PII বা ব্যবসায়িক গোপনীয়তা ফাঁস হওয়ার বিরুদ্ধে প্রযুক্তিগত সুরক্ষা প্রয়োজন। এই সুরক্ষাগুলির লক্ষ্য মারিয়ার কোম্পানি সবেমাত্র অনুভব করা ঘটনার মতো ঘটনা প্রতিরোধ করা।

- সার্টিফিকেশন এবং বীমা: AIUC-1 সার্টিফিকেশন মানে একটি AI সিস্টেম কঠোর পরীক্ষার মধ্য দিয়ে গেছে (ঝুঁকি পরিস্থিতিতে হাজার হাজার সিমুলেটেড ব্যর্থতা)। ElevenLabs-এর মতো প্রথম গ্রহণকারীরা AIUC-1 সার্টিফিকেট অর্জন করেছে এবং এমনকি তাদের ভয়েস এজেন্টদের জন্য AI বীমাও পেয়েছে, গ্রাহক এবং অংশীদারদের সংকেত দেয় যে তাদের AI যাচাই করা হয়েছে।

- সহযোগিতা মুখ্য: AIUC-1 Microsoft, Cisco, JPMorgan Chase, UiPath, ElevenLabs এবং অন্যান্যদের নেতাদের দ্বারা তৈরি করা হয়েছিল, যা প্রতিফলিত করে যে AI নিরাপত্তা/সুরক্ষায় ক্রস-ফাংশনাল পদক্ষেপ প্রয়োজন। Microsoft-এর AI-এর জন্য Secure Development Lifecycle-এর মতো কাঠামোগুলি একইভাবে জোর দেয় যে নিরাপত্তা অবশ্যই কাজ করার একটি উপায় হতে হবে, কেবল একটি চেকবক্স নয়।

- "AI-ওয়াশিং"-এর ফাঁদ: অনেক বিক্রেতা প্রকৃত ডেটা বা সুরক্ষা ছাড়াই পণ্যগুলিতে "AI" লেবেল লাগায়, কিন্তু গ্রাহকরা দ্রুত এটি বুঝতে পারে। অতিরঞ্জিত দাবি (যেমন ডেটা প্রমাণ ছাড়াই "এন্টারপ্রাইজ-গ্রেড AI") অসামঞ্জস্যপূর্ণ আউটপুট তৈরি করে যা বিশ্বাস ক্ষয় করে এবং চার্ন বাড়ায়। আরও খারাপ, নিয়ন্ত্রকরা কঠোর হচ্ছেন: SEC এবং FTC বিভ্রান্তিকর AI দাবির জন্য কোম্পানিগুলিকে জরিমানা করেছে।

সাধারণ ফাঁদ: CX নেতাদের সতর্ক থাকা উচিত…

- AI-ওয়াশিং: নতুন ডেটা বা মডেল ছাড়াই "তত্ত্বাবধানহীন" AI বট মোতায়েন করা। গ্রাহকরা দ্রুত শূন্য উন্নতি দেখতে পান, যা ব্র্যান্ড বিশ্বাসযোগ্যতাকে ক্ষতিগ্রস্ত করে।

- ডেটা অতিরিক্ত প্রসারণ: স্পষ্ট নীতি ছাড়াই "যদি প্রয়োজন হয়" বলে গ্রাহক ডেটা জমা করা, গোপনীয়তা লঙ্ঘনের দিকে নিয়ে যায়। Qualtrics পরামর্শ দেয়, "শুধু এটি রাখার জন্য সবকিছু সংগ্রহ করা বন্ধ করুন"; শুধুমাত্র যা প্রয়োজন তা সংগ্রহ করা (সম্মতি এবং স্পষ্ট উদ্দেশ্য সহ) বিশ্বাস তৈরি করে।

- বিচ্ছিন্ন পরিচালনা: নিরাপত্তা, আইনি এবং CX ইনপুট উপেক্ষা করে AI কে সম্পূর্ণভাবে একটি ইঞ্জিনিয়ারিং সরঞ্জাম হিসাবে বিবেচনা করা। যদি টিমগুলি AI ঝুঁকিতে সহযোগিতা না করে (Microsoft সতর্ক করে), গ্রাহক টাচপয়েন্টে বিশ্বাসের ব্যবধান দেখা দেয়।

- রেড-টিমিং এড়িয়ে যাওয়া: প্রতিকূল পরীক্ষা বা মনিটরিং ছাড়াই জেনারেটিভ AI বৈশিষ্ট্য চালু করা। স্তরযুক্ত সুরক্ষা (যেমন প্রম্পট ফিল্টার বা অসঙ্গতি সনাক্তকরণ) ছাড়াই, AI আউটপুট PII ফাঁস করতে পারে, হ্যালুসিনেট করতে পারে বা IP লঙ্ঘন করতে পারে।

- মানদণ্ড অবহেলা: উদীয়মান AI কাঠামোর সাথে সামঞ্জস্য করতে ব্যর্থ হওয়া (যেমন AIUC-1, MITRE ATLAS) কোম্পানিগুলিকে অডিট বা বীমার জন্য অপ্রস্তুত রাখে। ফলাফল হল স্থগিত প্রকল্প, আইনি ঝুঁকি এবং হারানো গ্রাহক আনুগত্য।

- অস্পষ্ট AI ব্যবহার: AI যখন কাজ করছে বা তাদের ডেটা কীভাবে ব্যবহার করা হচ্ছে তা গ্রাহকদের জানানো হচ্ছে না। এই "ব্ল্যাক বক্স" পদ্ধতি দ্রুত অবিশ্বাস হিসাবে অনুভূত হয়; জেনারেটিভ AI যুগে স্বচ্ছতা আলোচনা-অযোগ্য।

AIUC-1 কী এবং এটি CX-এর জন্য কেন গুরুত্বপূর্ণ?

AIUC-1 হল AI এজেন্টদের জন্য প্রথম ইন্ডাস্ট্রি-স্ট্যান্ডার্ড কাঠামো, যা ডেটা/গোপনীয়তা, নিরাপত্তা, সুরক্ষা এবং আরও অনেক কিছু কভার করে। এটি সর্বোত্তম অনুশীলন (এবং প্রযুক্তিগত নিয়ন্ত্রণ) কোডিফাই করে যাতে এন্টারপ্রাইজগুলি AI ঝুঁকি পরিমাপ এবং পরিচালনা করতে ধারাবাহিকভাবে পারে। ব্যবহারিক শর্তে, AIUC-1 CX টিমগুলিকে যেকোনো AI সমাধান মূল্যায়ন করার জন্য একটি সাধারণ ভাষা দেয়: "এই এজেন্ট কি নিরাপদ, নির্ভরযোগ্য এবং গ্রাহক ডেটার প্রতি শ্রদ্ধাশীল?" এই উত্তরগুলি মানসম্মত করে, AIUC-1 আত্মবিশ্বাস অবকাঠামো তৈরি করে যা এন্টারপ্রাইজ AI গ্রহণকে আনলক করে।

ডেটা এবং গোপনীয়তা সমস্যাগুলি কীভাবে বিশ্বাসের ব্যবধান তৈরি করে?

গ্রাহক বিশ্বাস ভেঙে যায় যখন একটি AI এজেন্ট ব্যক্তিগত ডেটার অপব্যবহার করে বা গোপনীয় তথ্য ফাঁস করে। আধুনিক AI সিস্টেমগুলি ছড়িয়ে ছিটিয়ে থাকা ডেটা থেকে আঁকে এবং "সম্ভাব্য মেমরি" রয়েছে, যার অর্থ তারা দুর্ঘটনাক্রমে PII বা বুদ্ধিবৃত্তিক সম্পত্তি প্রকাশ করতে পারে যদি কঠোরভাবে নিয়ন্ত্রিত না হয়। উদাহরণস্বরূপ, একটি AI বট যা অজান্তে CRM এন্ট্রিতে প্রশিক্ষণ নেয় সে খোলাখুলিভাবে সংবেদনশীল গ্রাহক বিবরণ পুনরুদ্ধার করতে পারে। CX বিশেষজ্ঞরা সতর্ক করেন যে এই ধরনের ফাঁস – বা এমনকি AI মডেল আপডেট হওয়ার সাথে সাথে অপ্রত্যাশিত আচরণ – সরাসরি গ্রাহক অভিজ্ঞতাকে ক্ষতিগ্রস্ত করে। নিয়ন্ত্রিত শিল্পে, এটি আইনি এবং সম্মতি ভাঙ্গনেরও আমন্ত্রণ জানায়।

AIUC-1 স্পষ্ট ডেটা নীতি এবং নিয়ন্ত্রণ বাধ্যতামূলক করে এই ঝুঁকিগুলির বিরুদ্ধে লড়াই করে। এটি টিমগুলিকে সংজ্ঞায়িত করতে বাধ্য করে কীভাবে ইনপুট ডেটা ব্যবহার এবং সুরক্ষিত করা হয় (A001), AI কী আউটপুট তৈরি করতে পারে এবং কার সেগুলির মালিকানা আছে (A002), এবং কাজের জন্য প্রাসঙ্গিক ডেটা সংগ্রহ সীমিত করা (A003)। এই পদক্ষেপগুলি নিশ্চিত করে যে একজন গ্রাহকের ব্যক্তিগত বা কর্পোরেট ডেটা তত্ত্বাবধান ছাড়াই AI দ্বারা গ্রাস বা ধরে রাখা হয় না। সংক্ষেপে, স্পষ্ট ইনপুট/আউটপুট পরিচালনা এবং অ্যাক্সেস নিয়ন্ত্রণ গ্রাহক তথ্যের অব্যবস্থাপনার বিরুদ্ধে প্রথম প্রতিরক্ষার লাইন।

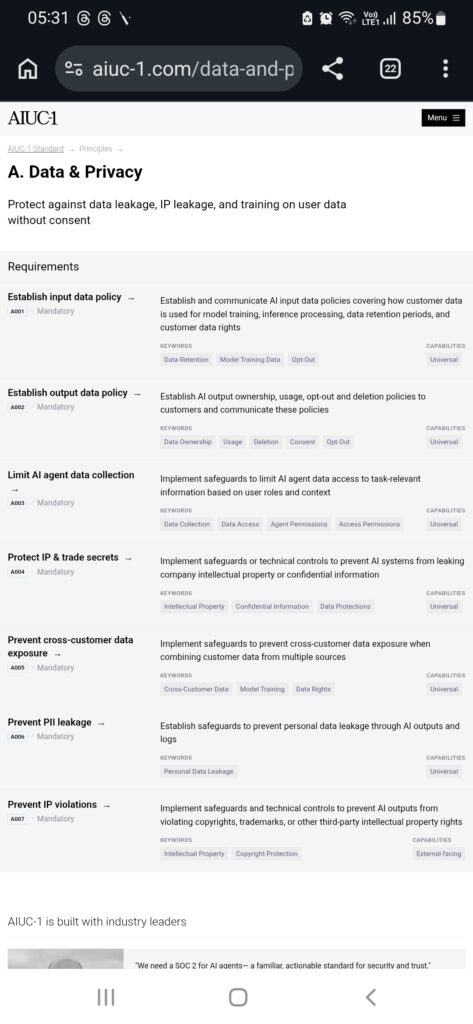

AIUC-1 কোন ডেটা এবং গোপনীয়তা নিয়ন্ত্রণ প্রয়োগ করে?

AIUC-1 AI সিস্টেমে ডেটা ব্যবহার লক করার জন্য বেশ কয়েকটি বাধ্যতামূলক প্রয়োজনীয়তা তালিকাভুক্ত করে। মূল উদাহরণগুলির মধ্যে রয়েছে: ইনপুট ডেটা নীতি প্রতিষ্ঠা করা (কীভাবে এবং কখন গ্রাহক ডেটা প্রশিক্ষণ বা অনুমানের জন্য ব্যবহার করা হয়, এবং ডেটা ধরে রাখা/অধিকার); আউটপুট ডেটা নীতি আনুষ্ঠানিকীকরণ (AI-উত্পন্ন ডেটার মালিক কে, ব্যবহারের অধিকার, অপ্ট-আউট এবং মুছে ফেলার প্রক্রিয়া সংজ্ঞায়িত করা); এবং ভূমিকার উপর ভিত্তি করে কঠোরভাবে কার্য-প্রাসঙ্গিক ইনপুটগুলিতে AI ডেটা সংগ্রহ সীমিত করা।

গুরুত্বপূর্ণভাবে, AIUC-1 প্রযুক্তিগত সুরক্ষাও বাধ্যতামূলক করে: AI কে কোম্পানির IP বা ব্যবসায়িক গোপনীয়তা ফাঁস করা থেকে প্রতিরোধ করুন (A004); যখন একটি AI-এর মাল্টি-টেন্যান্ট ইনপুট থাকে তখন যেকোনো ক্রস-কাস্টমার ডেটা মিশ্রণ ব্লক করুন (A005); আউটপুট বা লগের মাধ্যমে PII ফাঁস বন্ধ করুন (A006); এবং নিশ্চিত করুন AI আউটপুট তৃতীয় পক্ষের কপিরাইট বা ট্রেডমার্ক লঙ্ঘন করে না (A007)। একত্রে, এই নিয়ন্ত্রণগুলি বিমূর্ত গোপনীয়তা লক্ষ্যগুলিকে সুনির্দিষ্ট চেকগুলিতে পরিণত করে: ডেটাসেট অডিটিং, লগ এনক্রিপ্ট করা, মডেল স্যান্ডবক্সিং, এবং DPIA-এর মতো পর্যালোচনা প্রয়োগ করা। CX নেতাদের জন্য, ফলাফল পরিমাপযোগ্য: নীতি এবং সরঞ্জাম যা গ্রাহকদের দেখায় "আমাদের AI আপনার ডেটা বা অন্য কারোর ডেটার অপব্যবহার করবে না।"

AIUC-1 সার্টিফিকেশন কীভাবে বিশ্বাস পুনর্নির্মাণ করে?

একটি AIUC-1 সার্টিফিকেট মানে একটি AI এজেন্ট নিরাপত্তা, গোপনীয়তা এবং সুরক্ষা পরিস্থিতিতে ৫,০০০-এর বেশি প্রতিকূল সিমুলেশন পাস করেছে। কার্যত, এটি একটি তৃতীয় পক্ষের স্ট্যাম্প যে "এই AI পরীক্ষিত এবং নিরাপদ।" গ্রাহক এবং অংশীদারদের জন্য, এটি শক্তিশালী। ElevenLabs রিপোর্ট করে যে AIUC-1 অর্জন তাদের তাদের AI ভয়েস এজেন্টদের কর্মচারীদের মতো বীমা করতে সক্ষম করেছে – হ্যালুসিনেশন থেকে ফাঁস পর্যন্ত ভুলগুলি কভার করে। AI Underwriting সহ-প্রতিষ্ঠাতা ব্যাখ্যা করেন, "নেতৃস্থানীয় বীমাকারীরা এই সার্টিফিকেশন-ভিত্তিক পদ্ধতিতে এতটাই আত্মবিশ্বাসী যে তারা যারা এটি অর্জন করে তাদের AI-নির্দিষ্ট আর্থিক কভারেজ অফার করছে। ElevenLabs প্রথম কোম্পানি যা প্রমাণ করেছে এই মডেলটি স্কেলে কাজ করে।"

বাস্তবে, সার্টিফিকেশন + বীমা ঝুঁকি স্থানান্তর করে। অজানা ভয় করার পরিবর্তে ("যদি আমাদের চ্যাটবট বিপথগামী হয়?"), কোম্পানিগুলি দায় কাঠামোর উপর ঠেলে দিতে পারে: যদি AIUC-1 সুরক্ষা থাকা সত্ত্বেও AI এখনও ব্যর্থ হয়, ক্ষতি কভার করা হয়। এটি মূল ওয়ার্কফ্লোতে AI ব্যবহারে একটি বিশাল মানসিক বাধা সরিয়ে দেয়। ElevenLabs-এর সহ-প্রতিষ্ঠাতা নোট করেন, AIUC-1 (এবং এটি যে বীমা আনলক করে) এন্টারপ্রাইজ ডিপ্লয়মেন্ট ত্বরান্বিত করে অংশীদারদের "তাদের প্রয়োজনীয় নিরাপত্তা কাঠামো এবং AI বীমা কভারেজ" দিয়ে। CX/EX নেতাদের জন্য, এর অর্থ আরও পাইলট প্রকল্প উৎপাদনে স্নাতক হচ্ছে, এবং গ্রাহক বিশ্বাস তৈরি করার সময় একটি শক্তিশালী বিক্রয় পয়েন্ট।

CX/EX নেতারা দায়িত্বশীল AI-এর জন্য কীভাবে প্রস্তুত হতে পারেন?

পরিচালনা এবং নীতি দিয়ে শুরু করুন, শুধু প্রযুক্তি নয়। এখনই আপনার ডেটা ব্যবহার নিয়ম সংজ্ঞায়িত করুন: সিদ্ধান্ত নিন কোন গ্রাহক ডেটা AI মডেলগুলিকে ফিড করবে, কতক্ষণ এটি সংরক্ষিত থাকবে এবং ব্যবহারকারীরা কীভাবে অপ্ট আউট করতে পারবে। ক্রস-ফাংশনাল টিমগুলিকে তাড়াতাড়ি জড়িত করুন – আইনি, নিরাপত্তা, ডেটা বিজ্ঞান এবং পণ্য – Microsoft SDL পদ্ধতির প্রতিফলন যা নিরাপত্তাকে একটি সহযোগিতামূলক ডিজাইন নীতি হিসাবে বিবেচনা করে। পরবর্তী, অভ্যন্তরীণভাবে এবং গ্রাহকদের জন্য উভয়ের জন্য স্বচ্ছতা দাবি করুন। উদাহরণস্বরূপ, Microsoft-এর নেতৃত্ব অনুসরণ করুন যখন একজন ব্যবহারকারী AI-এর সাথে ইন্টারঅ্যাক্ট করছেন তখন স্পষ্টভাবে প্রকাশ করে এবং তাদের তাদের ডেটার উপর নিয়ন্ত্রণ দিয়ে।

উত্তর তারকা হিসাবে AIUC-1-এর মতো মানগুলি গ্রহণ করুন। AI বিক্রেতা এবং ইন-হাউস প্রকল্পগুলি অডিট করতে এর ডেটা/গোপনীয়তা চেকলিস্ট ব্যবহার করুন: আমরা কি ডেটা সংগ্রহ সীমিত করছি? লগ এনক্রিপ্ট করছি? PII অনুমান প্রতিরোধ করছি? যদি না হয়, এখনই সেই নিয়ন্ত্রণগুলিতে বিনিয়োগ করুন। আপনার AI সম্পদের সুযোগ নির্ধারণ করতে একজন স্বীকৃত অডিটর নিযুক্ত করুন – AIUC-1 কনসোর্টিয়াম প্রতিটি নিয়ন্ত্রণ কোথায় প্রযোজ্য সে বিষয়ে নির্দেশনা প্রদান করে। মূল AI এজেন্টদের জন্য পাইলট সার্টিফিকেশন বিবেচনা করুন; উদাহরণস্বরূপ, ভয়েস বা সেলস বটগুলি প্রায়শই CX রূপান্তরে প্রথমে প্রকাশ পায়। ElevenLabs-এর উদাহরণ যেমন দেখায়, অন্তর্নির্মিত সুরক্ষা একীকরণ দ্রুত-ট্র্যাক সার্টিফিকেশন করতে পারে: তাদের ক্লায়েন্টদের একজন মাত্র চার সপ্তাহে একটি ২৪/৭ সম্পত্তি-অনুসন্ধান ভয়েস বট সার্টিফাই করেছে।

অবশেষে, গ্রাহক প্রতিক্রিয়ায় পরিমাপ এবং পুনরাবৃত্তি করুন। AI-চালিত ইন্টারঅ্যাকশনগুলি ঘনিষ্ঠভাবে মনিটর করুন: গ্রাহকরা কি একটি AI টাচপয়েন্টের পরে ড্রপ করছে বা অভিযোগ বাড়াচ্ছে? AI পরীক্ষাগুলি মিস করতে পারে এমন সমস্যাগুলি ধরতে CX মেট্রিক্স ব্যবহার করুন। এবং মনে রাখবেন, বিশ্বাস সময়ের সাথে অর্জিত হয় – যেমন একজন Qualtrics বিশেষজ্ঞ বলেন, প্রকৃত AI মূল্য আসে "সংযোগ তৈরি এবং মানব অভিজ্ঞতা উন্নত করা থেকে, সক্ষম AI এজেন্টরা সাধারণ কাজগুলি পরিচালনা করে এবং জটিল সমস্যাগুলিতে মানব এজেন্টদের সহায়তা করে"। যেখানে এটি সবচেয়ে গুরুত্বপূর্ণ সেখানে মানুষকে লুপে রাখুন এবং আপনার নতুন পরিচালনা সুরক্ষার মধ্যে AI বাকিটি পরিচালনা করতে দিন।

প্রায়শই জিজ্ঞাসিত প্রশ্নাবলী

AIUC-1 ঠিক কী?

AIUC-1 হল AI "এজেন্টদের" (সফ্টওয়্যার বট এবং সহকারী) জন্য একটি নতুন ইন্ডাস্ট্রি স্ট্যান্ডার্ড এবং সার্টিফিকেশন কাঠামো যা সমস্ত প্রধান ঝুঁকি বিভাগগুলি কভার করে। এটি Microsoft, Cisco, JPMorgan Chase, UiPath এবং ElevenLabs-এর মতো কোম্পানিগুলির বিশেষজ্ঞদের দ্বারা তৈরি করা হয়েছিল এন্টারপ্রাইজগুলিকে AI সিস্টেম মূল্যায়ন করার সময় একটি স্পষ্ট কাঠামো (AI-এর জন্য একটি "SOC 2"-এর মতো) দেওয়ার জন্য। AIUC-1 প্রয়োজনীয়তা পূরণ করে, একটি AI পণ্য প্রদর্শন করে যে এটি নিরাপত্তা, ডেটা গোপনীয়তা, নির্ভরযোগ্যতা এবং অন্যান্য উদ্বেগের জন্য পরীক্ষা করা হয়েছে।

AIUC-1 কোন ডেটা এবং গোপনীয়তা সমস্যাগুলি সমাধান করে?

স্ট্যান্ডার্ডটি ডেটা ব্যবহারের উপর নির্দিষ্ট নিয়ন্ত্রণ বাধ্যতামূলক করে: AI ইনপুট এবং আউটপুট ডেটার জন্য লিখিত নীতি প্রতিষ্ঠা করা (প্রশিক্ষণ, ধরে রাখা, মুছে ফেলা এবং গ্রাহক অপ্ট-আউট সহ); অপ্রাসঙ্গিক বা অতিরিক্ত ডেটা অ্যাক্সেস করা থেকে AI সীমাবদ্ধ করা; এবং ব্যক্তিগত ডেটা, IP ফাঁস বা বিভিন্ন গ্রাহকদের থেকে ডেটা মিশ্রিত করার বিরুদ্ধে সুরক্ষা যুক্ত করা। সংক্ষেপে, এটি সংস্থাগুলিকে লক করতে বাধ্য করে কীভাবে গ্রাহক ডেটা তাদের AI-এর মধ্য দিয়ে প্রবাহিত হয়, এমন ধরনের গোপনীয়তা লঙ্ঘন প্রতিরোধ করে যা বিশ্বাস ধ্বংস করে।

AIUC-1 সার্টিফিকেশন কীভাবে গ্রাহক বিশ্বাস পুনর্নির্মাণ করে?

AIUC-1 সার্টিফাইড (এবং বীমাকৃত) হওয়া গ্রাহকদের সংকেত দেয় যে AI সিস্টেম পরিচিত ব্যর্থতা মোডের বিরুদ্ধে কঠোর পরীক্ষা পাস করেছে। এটি আপনার AI-এর জন্য একটি নিরাপত্তা পরিদর্শন রিপোর্ট দেখানোর মতো। এন্টারপ্রাইজগুলি তারপরে সত্যিকারভাবে গ্রাহকদের বলতে পারে: "আমাদের AI-এর যাচাইযোগ্য সুরক্ষা এবং এমনকি বীমা কভারেজ রয়েছে।" প্রাথমিক গ্রহণকারীরা রিপোর্ট করেন যে এই বিশ্বাসযোগ্যতা চুক্তি এবং ডিপ্লয়মেন্ট ত্বরান্বিত করে। বাস্তবে, সার্টিফিকেশন মানে কম অন-ব্র্যান্ড স্লিপ-আপ – এবং যদি সার্টিফিকেশন থাকা সত্ত্বেও একটি ঘটনা ঘটে, বীমা পতন কভার করতে পারে। এই জবাবদিহিতার লুপই AI কে একটি অজানা জুয়া থেকে ব্যবসায়িক নেতা এবং গ্রাহকদের দৃষ্টিতে একটি পরিচালিত পরিষেবাতে পরিণত করে।

যদি আমরা এই মানগুলি এড়িয়ে যাই তবে কী ঘটে?

AI পরিচালনা উপেক্ষা করা বিশ্বাসের বন্যার দরজা খুলে দেয়। স্পষ্ট নীতি বা পরীক্ষা ছাড়াই, AI এজেন্টরা ডেটা ফাঁস করতে পারে, কপিরাইট লঙ্ঘন করতে পারে বা বিপজ্জনকভাবে খারাপ পরামর্শ দিতে পারে। গ্রাহকরা লক্ষ্য করবেন – উদাহরণস্বরূপ, অসঙ্গত বা বিভ্রান্তিকর উত্তর দেওয়া বটগুলি আনুগত্য ক্ষয় করবে। নিয়ন্ত্রক এবং শিল্পও তদারকি কঠোর করছে। যে কোম্পানিগুলি "AI-ওয়াশ" করে (সঠিক নিয়ন্ত্রণ ছাড়াই AI ব্যবহার করার ভান করে) আইনি পদক্ষেপের ঝুঁকি নেয়: SEC এবং FTC ইতিমধ্যে প্রতারণামূলক AI দাবির জন্য সংস্থাগুলিকে অনুমোদন করেছে। সংক্ষেপে, মানগুলি এড়িয়ে যাওয়ার অর্থ হল ব্র্যান্ড ক্ষতি, সম্মতি জরিমানা এবং হারানো গ্রাহকদের ঝুঁকি।

CX নেতারা AIUC-1 অনুশীলন গ্রহণ শুরু করতে কীভাবে পারেন?

আপনার AI সরঞ্জাম এবং ডেটা প্রবাহের তালিকা তৈরি করে শুরু করুন: কোন সিস্টেমগুলি গ্রাহক ডেটা পরিচালনা করে বা গ্রাহকদের সাথে ইন্টারঅ্যাক্ট করে তা শ্রেণিবদ্ধ করুন এবং AIUC-1-এর নিয়ন্ত্রণ চেকলিস্টের বিরুদ্ধে তুলনা করুন। আপনার AI ডেটা গোপনীয়তা নীতি বিকশিত বা আপডেট করুন (ইনপুট, আউটপুট, ধরে রাখা এবং গ্রাহক অধিকার কভার করে)। প্রয়োজনীয় প্রযুক্তিগত নিয়ন্ত্রণ প্রয়োগ করতে আপনার নিরাপত্তা এবং আইনি দলের সাথে কাজ করুন (যেমন ডেটা ন্যূনতমকরণ, এনক্রিপশন, মনিটরিং)। সার্টিফিকেশনের সুযোগ নির্ধারণ করতে একজন স্বীকৃত AIUC-1 অডিটরকে তাড়াতাড়ি নিযুক্ত করুন। এমনকি যদি সম্পূর্ণ সার্টিফিকেশন একটি দীর্ঘমেয়াদী লক্ষ্য হয়, তবে এখন আপনার AI সিস্টেমগুলিকে শক্ত করতে গ্যাপ বিশ্লেষণ হিসাবে স্ট্যান্ডার্ডের প্রয়োজনীয়তা ব্যবহার করুন। অবশেষে, আপনি উন্নতি করার সাথে সাথে স্টেকহোল্ডার (এবং গ্রাহকদের) সাথে যোগাযোগ রাখুন: এই প্রচেষ্টাগুলির বিষয়ে স্বচ্ছতা নিজেই আপনার AI উদ্যোগে আত্মবিশ্বাস পুনর্নির্মাণে সহায়তা করবে।

কার্যকরী টেকঅ্যাওয়ে:

- স্পষ্ট ডেটা নীতি সংজ্ঞায়িত করুন: লিখুন কীভাবে AI প্রশিক্ষণ বনাম অনুমানের জন্য গ্রাহক ডেটা ব্যবহার করবে, ধরে রাখার সীমা সেট করুন এবং অপ্ট-আউট/মুছে ফেলার অধিকার অফার করুন।

- একটি কাঠামো হিসাবে AIUC-1 গ্রহণ করুন: সমস্ত AI প্রকল্পে নিরাপত্তা, গোপনীয়তা এবং সুরক্ষা চেক একীভূত করতে এর নীতিগুলি ব্যবহার করুন। উচ্চ-ঝুঁকিপূর্ণ AI এজেন্টদের জন্য পাইলট সার্টিফিকেশন বিবেচনা করুন।

- টিম জুড়ে সহযোগিতা করুন: AI রোলআউট সিদ্ধান্তে IT, আইনি, সম্মতি এবং CX জড়িত করে সাইলো ভাঙুন। AI ঝুঁকি ব্যবস্থাপনাকে একটি ভাগ করা মিশন হিসাবে বিবেচনা করুন।

- ডিজাইন দ্বারা নিরাপত্তা এমবেড করুন: লঞ্চের আগে, AI এজেন্টদের স্ট্রেস-টেস্ট করুন (রেড-টিমিং, প্রম্পট ইনজেকশন) এবং ফাঁস বা অসদাচরণ প্রতিরোধ করতে রানটাইম সুরক্ষা (মডুলেশন, অসঙ্গতি সতর্কতা) মোতায়েন করুন।

- AI বীমা লিভারেজ করুন: AIUC-1 সার্টিফিকেশন বা বীমা ব্যাকস্টপ সহ AI বিক্রেতাদের খোঁজ করুন। এটি প্রণোদনা সারিবদ্ধ করে এবং AI ভুল করলে আর্থিক সুরক্ষা প্রদান করে।

- ব্যবহারকারীদের সাথে স্বচ্ছ হন: AI যখন ব্যবহার করা হচ্ছে তখন গ্রাহকদের জানান এবং তাদের জানান কীভাবে তাদের ডেটা পরিচালনা করা হয়, Microsoft-এর Copilot রিয়েল-টাইম প্রকাশের অনুশীলন থেকে আঁকা।

- শুধুমাত্র প্রয়োজনীয় ডেটা সংগ্রহ করুন: পরিমাণের উপর গুণমান পছন্দ করুন। যেহেতু ব্যবহারকারীরা গোপনীয়তা দাবি করেন, শুধুমাত্র পরিষেবার জন্য প্রয়োজনীয় তথ্য সংগ্রহ করুন এবং স্পষ্টভাবে ব্যাখ্যা করুন কীভাবে এটি তাদের অভিজ্ঞতা উন্নত করে।

- কর্মীদের প্রশিক্ষণ এবং মনিটর করুন: নিশ্চিত করুন গ্রাহক-মুখী টিম AI সীমাবদ্ধতা বোঝে এবং স্পষ্ট বৃদ্ধির পথ আছে। সমস্যাগুলি (যেমন ধীর প্রতিক্রিয়া বা অসন্তুষ্টি) তাড়াতাড়ি ধরতে AI রোলআউটের পরে CX মেট্রিক্স ট্র্যাক করুন।

সরাসরি AI ঝুঁকি মোকাবেলা করে এবং AIUC-1-এর মতো কাঠামো গ্রহণ করে, CX এবং EX নেতারা বিশ্বাসের ব্যবধান বন্ধ করতে পারেন। খণ্ডিত যাত্রা এবং দ্রুত AI বিবর্তনের একটি ল্যান্ডস্কেপে, এইভাবে কোম্পানিগুলি সতর্ক পরীক্ষা থেকে আত্মবিশ্বাসী, গ্রাহক-কেন্দ্রিক AI ডিপ্লয়মেন্টে সরে যায়।

পোস্ট AIUC-1: The New Gold Standard for Trustworthy Enterprise AI প্রথম প্রকাশিত হয়েছে CX Quest-এ।

আপনি আরও পছন্দ করতে পারেন

ট্রাম্পের সর্বশেষ 'বিশেষভাবে ভীতিকর' পদক্ষেপ মনোবিজ্ঞানীকে শঙ্কিত করেছে: 'নিজেকে মহিমান্বিত করা'

কাজী রফিকুল আলম: বাংলাদেশে টেকসই প্রবৃদ্ধি চালিত করছেন একজন বৈশ্বিক মনোভাবাপন্ন উদ্যোক্তা