ওপেনএআই-এর পেন্টাগন চুক্তি: স্যাম অল্টম্যান প্রযুক্তিগত সুরক্ষা ব্যবস্থা সহ গুরুত্বপূর্ণ এআই চুক্তি সুরক্ষিত করেছেন

BitcoinWorld

OpenAI-এর পেন্টাগন চুক্তি: স্যাম আল্টম্যান প্রযুক্তিগত সুরক্ষা সহ গুরুত্বপূর্ণ AI চুক্তি সুরক্ষিত করেন

কৃত্রিম বুদ্ধিমত্তা শাসনের একটি যুগান্তকারী উন্নয়নে, OpenAI-এর CEO স্যাম আল্টম্যান শুক্রবার, ১৩ অক্টোবর, ২০২৫ তারিখে প্রতিরক্ষা বিভাগের সাথে একটি গুরুত্বপূর্ণ প্রতিরক্ষা চুক্তি ঘোষণা করেন, যা সামরিক AI প্রয়োগের চারপাশে গুরুত্বপূর্ণ নৈতিক উদ্বেগ সমাধান করে প্রযুক্তিগত সুরক্ষা প্রতিষ্ঠা করে। এই চুক্তিটি পেন্টাগন এবং প্রতিদ্বন্দ্বী AI কোম্পানি Anthropic-এর মধ্যে একটি বিতর্কিত সংঘর্ষের পরে আসে, যা ক্রমবর্ধমান স্বয়ংক্রিয় বিশ্বে জাতীয় নিরাপত্তা, প্রযুক্তিগত উদ্ভাবন এবং গণতান্ত্রিক মূল্যবোধের জটিল ছেদ তুলে ধরে।

প্রযুক্তিগত সুরক্ষা সহ OpenAI-এর পেন্টাগন চুক্তি

স্যাম আল্টম্যান প্রকাশ করেন যে OpenAI একটি চুক্তিতে পৌঁছেছে যা শ্রেণীবদ্ধ নেটওয়ার্কের মধ্যে প্রতিরক্ষা বিভাগকে তার AI মডেলগুলিতে অ্যাক্সেসের অনুমতি দেয়। গুরুত্বপূর্ণভাবে, চুক্তিতে দুটি মৌলিক নৈতিক উদ্বেগ সমাধানের জন্য নির্দিষ্ট প্রযুক্তিগত সুরক্ষা অন্তর্ভুক্ত রয়েছে। প্রথমত, চুক্তিটি দেশীয় গণ নজরদারি প্রয়োগ নিষিদ্ধ করে। দ্বিতীয়ত, এটি স্বায়ত্তশাসিত অস্ত্র ব্যবস্থা সহ শক্তি প্রয়োগের জন্য মানুষের দায়িত্ব বজায় রাখে। এই সুরক্ষাগুলি অবাধ সামরিক অ্যাক্সেস এবং সম্পূর্ণ কর্পোরেট অস্বীকারের মধ্যে একটি আপস অবস্থানের প্রতিনিধিত্ব করে।

আল্টম্যানের জনসাধারণের বিবৃতি অনুসারে, প্রতিরক্ষা বিভাগ এই নীতিগুলির সাথে একমত এবং সেগুলি আইন এবং নীতি উভয়েই অন্তর্ভুক্ত করেছে। তদুপরি, OpenAI মডেল আচরণ এই বিধিনিষেধের সাথে সামঞ্জস্যপূর্ণ তা নিশ্চিত করতে প্রযুক্তিগত সুরক্ষা বাস্তবায়ন করবে। কোম্পানিটি পেন্টাগন কর্মীদের সাথে কাজ করার জন্য প্রকৌশলীও মোতায়েন করবে, যথাযথ মডেল বাস্তবায়ন এবং চলমান সুরক্ষা নিরীক্ষণ সুবিধা দেবে। এই সহযোগিতামূলক পদ্ধতি OpenAI-এর কৌশলকে আরও প্রতিকূল শিল্প অবস্থান থেকে আলাদা করে।

Anthropic সংঘর্ষ এবং নৈতিক বিভাজন

OpenAI চুক্তিটি পেন্টাগন এবং Anthropic-এর মধ্যে ব্যর্থ আলোচনার পটভূমিতে উত্থিত হয়। কয়েক মাস ধরে, প্রতিরক্ষা কর্মকর্তারা AI কোম্পানিগুলিকে তাদের মডেলগুলি "সকল বৈধ উদ্দেশ্যে" ব্যবহারের অনুমতি দিতে চাপ দিয়েছিল। তবে, Anthropic গণ দেশীয় নজরদারি এবং সম্পূর্ণ স্বায়ত্তশাসিত অস্ত্রের উপর স্পষ্ট সীমাবদ্ধতা চেয়েছিল। CEO দারিও আমোদেই যুক্তি দিয়েছিলেন যে নির্দিষ্ট ক্ষেত্রে, AI গণতান্ত্রিক মূল্যবোধ রক্ষা করার পরিবর্তে তা দুর্বল করতে পারে।

এই নৈতিক অবস্থান প্রযুক্তি কর্মীদের থেকে উল্লেখযোগ্য সমর্থন আকর্ষণ করেছে। ৬০ জনেরও বেশি OpenAI কর্মচারী এবং ৩০০ জন Google কর্মচারী Anthropic-এর অবস্থান সমর্থন করে একটি খোলা চিঠিতে স্বাক্ষর করেছেন। চিঠিটি অনুরূপ নৈতিক সীমানার শিল্প-ব্যাপী গ্রহণের আহ্বান জানিয়েছে, যা তাদের প্রযুক্তির সম্ভাব্য সামরিক প্রয়োগ সম্পর্কে AI ডেভেলপারদের মধ্যে ক্রমবর্ধমান উদ্বেগ প্রতিফলিত করে।

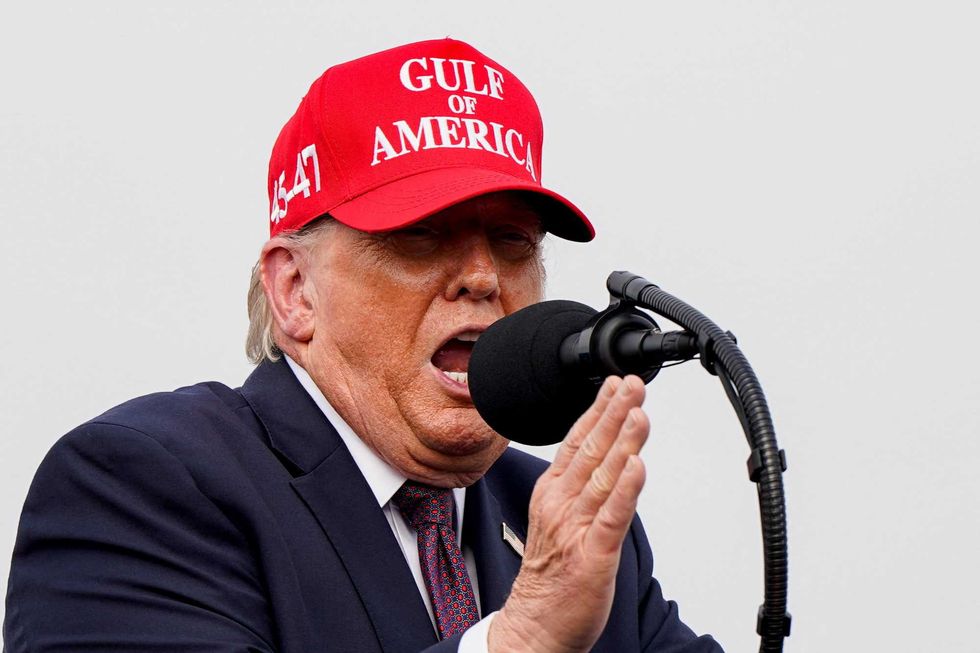

মতবিরোধ ট্রাম্প প্রশাসনের সাথে একটি জনসাধারণের সংঘর্ষে বৃদ্ধি পায়। প্রেসিডেন্ট ডোনাল্ড ট্রাম্প একটি সোশ্যাল মিডিয়া পোস্টে Anthropic-কে "বামপন্থী পাগল" হিসাবে সমালোচনা করেছেন। তিনি ছয় মাসের মধ্যে কোম্পানির পণ্য পর্যায়ক্রমে বন্ধ করার জন্য ফেডারেল এজেন্সিগুলিকে নির্দেশ দিয়েছেন। প্রতিরক্ষা সচিব পিট হেগসেথ Anthropic-কে একটি সরবরাহ-শৃঙ্খল ঝুঁকি হিসাবে নির্ধারণ করে সংঘাতকে আরও তীব্র করেছেন। এই নির্ধারণ সামরিক বাহিনীর সাথে ব্যবসা করা ঠিকাদার এবং অংশীদারদের Anthropic-এর সাথে বাণিজ্যিকভাবে জড়িত হতে নিষিদ্ধ করে।

শিল্প প্রভাব এবং নিয়ন্ত্রক পরিদৃশ্য

OpenAI এবং Anthropic-এর জন্য বিপরীত ফলাফল AI শিল্পের জন্য উল্লেখযোগ্য প্রভাব প্রকাশ করে। কোম্পানিগুলিকে এখন নৈতিক মান এবং জনসাধারণের আস্থা বজায় রেখে সরকারী সংস্থাগুলির সাথে জটিল সম্পর্ক নেভিগেট করতে হবে। OpenAI-এর পদ্ধতি প্রদর্শন করে যে নির্দিষ্ট সুরক্ষা সহ আলোচিত চুক্তিগুলি এগিয়ে যাওয়ার একটি কার্যকর পথ প্রতিনিধিত্ব করে। বিপরীতভাবে, Anthropic-এর অভিজ্ঞতা সরকারী দাবির বিরুদ্ধে দৃঢ় নৈতিক অবস্থান নেওয়ার সম্ভাব্য পরিণতি দেখায়।

এই পরিস্থিতি একটি বিস্তৃত নিয়ন্ত্রক প্রেক্ষাপটে ঘটে। একাধিক দেশ সামরিক AI প্রয়োগের জন্য কাঠামো উন্নয়ন করছে। জাতিসংঘ প্রাণঘাতী স্বায়ত্তশাসিত অস্ত্র ব্যবস্থা সম্পর্কে চলমান আলোচনা পরিচালনা করেছে। অতিরিক্তভাবে, ইউরোপীয় ইউনিয়ন সম্প্রতি তার AI আইন বাস্তবায়ন করেছে, যা উচ্চ-ঝুঁকিপূর্ণ প্রয়োগের জন্য নির্দিষ্ট বিধান অন্তর্ভুক্ত করে। এই বৈশ্বিক উন্নয়নগুলি প্রতিরক্ষা সেক্টরে কাজ করা AI কোম্পানিগুলির জন্য ক্রমবর্ধমান জটিল পরিবেশ তৈরি করে।

প্রযুক্তিগত বাস্তবায়ন এবং নিরাপত্তা প্রোটোকল

OpenAI-এর চুক্তিতে নৈতিক সুরক্ষার সাথে সম্মতি নিশ্চিত করার জন্য ডিজাইন করা বেশ কয়েকটি প্রযুক্তিগত উপাদান অন্তর্ভুক্ত রয়েছে। Fortune রিপোর্টার শ্যারন গোল্ডম্যানের মতে, আল্টম্যান কর্মচারীদের জানিয়েছেন যে সরকার OpenAI-কে অপব্যবহার প্রতিরোধ করতে তার নিজস্ব "নিরাপত্তা স্ট্যাক" তৈরি করার অনুমতি দেবে। এই প্রযুক্তিগত অবকাঠামো চুক্তির একটি গুরুত্বপূর্ণ উপাদান প্রতিনিধিত্ব করে। তদুপরি, যদি একটি OpenAI মডেল একটি নির্দিষ্ট কাজ সম্পাদন করতে অস্বীকার করে, সরকার কোম্পানিকে মডেলের আচরণ পরিবর্তন করতে বাধ্য করতে পারে না।

এই প্রযুক্তিগত ব্যবস্থাগুলি AI সিস্টেম নির্ভরযোগ্যতা এবং সারিবদ্ধকরণ সম্পর্কে মূল উদ্বেগগুলি সমাধান করে। তারা নিশ্চিত করার জন্য প্রক্রিয়া প্রদান করে যে AI আচরণ প্রতিষ্ঠিত নৈতিক সীমানার মধ্যে থাকে। পেন্টাগন কর্মীদের সাথে সরাসরি কাজ করার জন্য OpenAI প্রকৌশলীদের মোতায়েন যথাযথ বাস্তবায়ন এবং চলমান নিরীক্ষণ সহজ করে। এই সহযোগিতামূলক প্রযুক্তিগত তত্ত্বাবধান সংবেদনশীল প্রযুক্তি ডোমেনে সামরিক-কর্পোরেট অংশীদারিত্বের একটি উদ্ভাবনী পদ্ধতির প্রতিনিধিত্ব করে।

সামরিক চুক্তিতে AI কোম্পানি পদ্ধতির তুলনা| কোম্পানি | অবস্থান | মূল সুরক্ষা | সরকারি প্রতিক্রিয়া |

|---|---|---|---|

| OpenAI | আলোচিত চুক্তি | • কোনও দেশীয় গণ নজরদারি নেই • শক্তির জন্য মানুষের দায়িত্ব • প্রযুক্তিগত সুরক্ষা • প্রকৌশলী মোতায়েন | সুরক্ষা সহ চুক্তি প্রদান |

| Anthropic | নৈতিক সীমাবদ্ধতা | • কোনও গণ নজরদারি নেই • কোনও স্বায়ত্তশাসিত অস্ত্র নেই • গণতান্ত্রিক মূল্যবোধ সুরক্ষা | সরবরাহ-শৃঙ্খল ঝুঁকি নির্ধারণ পণ্য পর্যায়ক্রমে বন্ধের আদেশ |

বিস্তৃত প্রেক্ষাপট এবং আন্তর্জাতিক উন্নয়ন

OpenAI-পেন্টাগন চুক্তি উল্লেখযোগ্য আন্তর্জাতিক উন্নয়নের সাথে সামঞ্জস্যপূর্ণ। আল্টম্যানের ঘোষণার কিছু সময় পরে, ইরানের বিরুদ্ধে মার্কিন এবং ইসরায়েলি সামরিক পদক্ষেপ সম্পর্কে সংবাদ প্রকাশিত হয়। প্রেসিডেন্ট ট্রাম্প ইরানি সরকারের উৎখাতের আহ্বান জানান। এই একযোগে উন্নয়নগুলি জটিল ভূরাজনৈতিক পরিদৃশ্য তুলে ধরে যেখানে সামরিক AI প্রযুক্তি মোতায়েন করা হচ্ছে। তারা স্বায়ত্তশাসিত ব্যবস্থা এবং নজরদারি ক্ষমতার চারপাশে নৈতিক বিবেচনার সময়োপযোগিতাও জোর দেয়।

বিশ্বব্যাপী, দেশগুলি সামরিক AI একীকরণের জন্য বিভিন্ন পদ্ধতি অনুসরণ করছে:

- চীন কম জনসাধারণের নৈতিক সীমাবদ্ধতা সহ AI সামরিক প্রয়োগ আগ্রাসীভাবে অনুসরণ করেছে

- রাশিয়া সীমিত স্বচ্ছতা সহ সংঘাত অঞ্চলে স্বায়ত্তশাসিত ব্যবস্থা মোতায়েন করেছে

- ইউরোপীয় দেশগুলি সাধারণত শক্তিশালী তত্ত্বাবধান সহ আরও সতর্ক পদ্ধতি গ্রহণ করেছে

- জাতিসংঘ স্বায়ত্তশাসিত অস্ত্রের সম্ভাব্য চুক্তি সম্পর্কে আলোচনা অব্যাহত রেখেছে

এই আন্তর্জাতিক প্রেক্ষাপট প্রতিযোগিতামূলক চাপ তৈরি করে যা দেশীয় নীতি সিদ্ধান্তকে প্রভাবিত করে। মার্কিন যুক্তরাষ্ট্র গণতান্ত্রিক মূল্যবোধ এবং নৈতিক মান বজায় রেখে প্রযুক্তিগত শ্রেষ্ঠত্ব বজায় রাখার চ্যালেঞ্জের মুখোমুখি। OpenAI চুক্তি এই প্রতিযোগী অগ্রাধিকার ভারসাম্য রাখার একটি পদ্ধতির প্রতিনিধিত্ব করে।

কর্মচারী দৃষ্টিভঙ্গি এবং শিল্প নৈতিকতা

শত শত AI কর্মচারীর দ্বারা স্বাক্ষরিত খোলা চিঠি উল্লেখযোগ্য অভ্যন্তরীণ শিল্প উত্তেজনা প্রকাশ করে। প্রযুক্তি কর্মীরা ক্রমবর্ধমানভাবে তাদের কাজের নৈতিক প্রভাব নিয়ে প্রশ্ন করে, বিশেষত সামরিক প্রয়োগ সম্পর্কে। এই কর্মচারী সক্রিয়তা প্রতিরক্ষা প্রযুক্তি সেক্টরে একটি অপেক্ষাকৃত নতুন ঘটনা প্রতিনিধিত্ব করে। ঐতিহাসিকভাবে, প্রতিরক্ষা ঠিকাদাররা সামরিক প্রয়োগের জন্য কম অভ্যন্তরীণ প্রতিরোধের মুখোমুখি হয়েছিল। তবে, AI কোম্পানিগুলি প্রযুক্তির সামাজিক প্রভাব সম্পর্কে শক্তিশালী নৈতিক বিশ্বাস সহ কর্মচারী আকর্ষণ করে।

এই গতিবিদ্যা প্রতিরক্ষা চুক্তি অনুসরণকারী AI কোম্পানিগুলির জন্য পরিচালনার চ্যালেঞ্জ তৈরি করে। নেতৃত্বকে সরকারী সম্পর্ক, ব্যবসায়িক সুযোগ এবং কর্মচারী উদ্বেগ ভারসাম্য রাখতে হবে। নির্দিষ্ট সুরক্ষা আলোচনা করার OpenAI-এর পদ্ধতি এই প্রতিযোগী চাপ মোকাবেলার একটি কৌশল প্রতিনিধিত্ব করে। অনুরূপ শর্তের শিল্প-ব্যাপী গ্রহণের জন্য প্রকাশ্যে সমর্থন করার জন্য কোম্পানির ইচ্ছা সরকারী অ্যাক্সেস বজায় রেখে নৈতিক নিয়ম স্থাপনের একটি প্রচেষ্টা নির্দেশ করে।

আইনি এবং নীতি প্রভাব

Anthropic সরবরাহ-শৃঙ্খল ঝুঁকি নির্ধারণ উল্লেখযোগ্য আইনি প্রশ্ন উত্থাপন করে। কোম্পানিটি বলেছে যে এটি আদালতে এই ধরনের যে কোনও নির্ধারণকে চ্যালেঞ্জ করবে। এই সম্ভাব্য মামলা কর্পোরেট নৈতিক অবস্থানের উপর ভিত্তি করে বাণিজ্যিক সম্পর্ক সীমাবদ্ধ করার সরকারী কর্তৃত্ব সম্পর্কে গুরুত্বপূর্ণ নজির স্থাপন করতে পারে। ফলাফল অন্যান্য AI কোম্পানিগুলি সরকারী সংস্থাগুলির সাথে অনুরূপ আলোচনায় কীভাবে যোগাযোগ করে তা প্রভাবিত করতে পারে।

নীতি বিশেষজ্ঞরা বেশ কয়েকটি মূল বিবেচনা উল্লেখ করেন:

- জাতীয় নিরাপত্তার প্রয়োজন এবং কর্পোরেট নৈতিক স্বায়ত্তশাসনের মধ্যে ভারসাম্য

- সামরিক AI ব্যবস্থায় প্রযুক্তিগত সুরক্ষার উপযুক্ত ভূমিকা

- নৈতিক বিধিনিষেধের সাথে সম্মতি নিশ্চিত করার প্রক্রিয়া

- বিভিন্ন জাতীয় পদ্ধতির আন্তর্জাতিক প্রভাব

এই নীতি প্রশ্নগুলি আগামী মাসগুলিতে সম্ভবত বৃদ্ধি মনোযোগ পাবে। কংগ্রেসনাল কমিটি ইতিমধ্যে সামরিক AI নৈতিকতার উপর শুনানির ঘোষণা করেছে। অতিরিক্তভাবে, একাধিক থিঙ্ক ট্যাঙ্ক এবং গবেষণা প্রতিষ্ঠান দায়িত্বশীল সামরিক AI মোতায়েনের জন্য নীতি কাঠামো উন্নয়ন করছে।

উপসংহার

প্রযুক্তিগত সুরক্ষা সহ OpenAI-এর পেন্টাগন চুক্তি সামরিক AI একীকরণে একটি উল্লেখযোগ্য মাইলফলক প্রতিনিধিত্ব করে। চুক্তিটি প্রদর্শন করে যে নির্দিষ্ট নৈতিক সুরক্ষা সহ আলোচিত পদ্ধতি বৈধ উদ্বেগ সমাধান করার সাথে সাথে সরকারী অ্যাক্সেস সহজতর করতে পারে। তবে, Anthropic-এর সাথে বিপরীত অভিজ্ঞতা জাতীয় নিরাপত্তার অগ্রাধিকার এবং কর্পোরেট নৈতিক মানের মধ্যে চলমান উত্তেজনা প্রকাশ করে। AI প্রযুক্তি ক্রমাগত অগ্রসর হওয়ার সাথে সাথে, এই জটিল সম্পর্কগুলির সতর্ক নেভিগেশনের প্রয়োজন হবে। OpenAI-এর চুক্তিতে প্রতিষ্ঠিত প্রযুক্তিগত সুরক্ষাগুলি ভবিষ্যতের সামরিক-কর্পোরেট অংশীদারিত্বের জন্য একটি মডেল হিসাবে কাজ করতে পারে। শেষ পর্যন্ত, সামরিক AI প্রয়োগের বিকশিত পরিদৃশ্য নিরাপত্তা এবং গণতান্ত্রিক মূল্যবোধ উভয়ই রক্ষা করে এমন দায়িত্বশীল উদ্ভাবন নিশ্চিত করতে সরকারী সংস্থা, প্রযুক্তি কোম্পানি, কর্মচারী এবং নাগরিক সমাজের মধ্যে চলমান সংলাপের দাবি করবে।

FAQs

প্রশ্ন ১: OpenAI-এর পেন্টাগন চুক্তিতে কোন নির্দিষ্ট সুরক্ষা অন্তর্ভুক্ত রয়েছে?

চুক্তিটি দেশীয় গণ নজরদারি প্রয়োগ নিষিদ্ধ করে এবং স্বায়ত্তশাসিত অস্ত্র ব্যবস্থা সহ শক্তি প্রয়োগের জন্য মানুষের দায়িত্ব বজায় রাখে। OpenAI প্রযুক্তিগত সুরক্ষা বাস্তবায়ন করবে এবং সম্মতি নিশ্চিত করতে প্রকৌশলী মোতায়েন করবে।

প্রশ্ন ২: পেন্টাগনের সাথে Anthropic-এর আলোচনা কেন ব্যর্থ হয়েছিল?

Anthropic গণ দেশীয় নজরদারি এবং সম্পূর্ণ স্বায়ত্তশাসিত অস্ত্রের উপর স্পষ্ট সীমাবদ্ধতা চেয়েছিল, যখন পেন্টাগন "সকল বৈধ উদ্দেশ্যে" অ্যাক্সেসের জন্য চাপ দিয়েছিল। এই মৌলিক মতবিরোধ একটি আলোচিত চুক্তি প্রতিরোধ করেছে।

প্রশ্ন ৩: তার নৈতিক অবস্থানের জন্য Anthropic কী পরিণতির মুখোমুখি হয়েছে?

প্রেসিডেন্ট ট্রাম্প Anthropic পণ্য পর্যায়ক্রমে বন্ধ করার জন্য ফেডারেল এজেন্সিগুলিকে আদেশ দিয়েছেন, এবং প্রতিরক্ষা সচিব হেগসেথ কোম্পানিটিকে একটি সরবরাহ-শৃঙ্খল ঝুঁকি হিসাবে নির্ধারণ করেছেন, যা সামরিক ঠিকাদারদের তাদের সাথে ব্যবসা করতে নিষিদ্ধ করে।

প্রশ্ন ৪: AI শিল্পের কর্মচারীরা এই উন্নয়নগুলিতে কীভাবে সাড়া দিয়েছে?

OpenAI এবং Google থেকে ৩৬০ জনেরও বেশি কর্মচারী Anthropic-এর নৈতিক অবস্থান সমর্থন করে একটি খোলা চিঠিতে স্বাক্ষর করেছেন, যা সামরিক AI প্রয়োগ সম্পর্কে উল্লেখযোগ্য অভ্যন্তরীণ উদ্বেগ প্রতিফলিত করে।

প্রশ্ন ৫: AI শাসনের জন্য এই পরিস্থিতির বিস্তৃত প্রভাব কী?

বিপরীত ফলাফল জাতীয় নিরাপত্তা, কর্পোরেট নৈতিকতা এবং প্রযুক্তিগত উদ্ভাবনের মধ্যে জটিল ভারসাম্য তুলে ধরে, সম্ভাব্যভাবে অন্যান্য দেশ এবং কোম্পানিগুলি কীভাবে সামরিক AI একীকরণের সাথে যোগাযোগ করে তা প্রভাবিত করে।

এই পোস্ট OpenAI's Pentagon Deal: Sam Altman Secures Crucial AI Contract with Technical Safeguards প্রথম BitcoinWorld-এ প্রকাশিত হয়েছে।

আপনি আরও পছন্দ করতে পারেন

'অসুস্থ': সামরিক অভিযানের আগে ট্রাম্প প্রশাসনের পদক্ষেপ প্রকাশ করার পর ভোটগ্রহণকারী MAGA স্তম্ভিত

বিটকয়েন ৪৮% কমেছে, কিন্তু ইতিহাসের সবচেয়ে বড় ক্রেতারা এখনও সংগ্রহ করছেন