Krisenberater für OpenAI, Anthropic erwägt Schritt zur Bekämpfung von Extremismus

SYDNEY, Australien – Personen, die auf ChatGPT gewalttätige extremistische Tendenzen zeigen, werden durch ein neues Tool, das in Neuseeland entwickelt wird, zu menschlicher und Chatbot-basierter Deradikalisierungsunterstützung weitergeleitet, sagten die Personen dahinter.

Die Initiative ist der jüngste Versuch, Sicherheitsbedenken angesichts einer wachsenden Zahl von Klagen zu begegnen, die KI-gesteuerte Unternehmen beschuldigen, Gewalt nicht zu stoppen und sogar zu ermöglichen.

OpenAI wurde im Februar von der kanadischen Regierung mit einer Intervention gedroht, nachdem bekannt wurde, dass eine Person, die eine tödliche Schießerei an einer Schule verübt hatte, von der Plattform gesperrt worden war, ohne dass die Behörden informiert wurden.

ThroughLine, ein Startup, das in den letzten Jahren von ChatGPT-Eigentümer OpenAI sowie den Konkurrenten Anthropic und Google beauftragt wurde, Benutzer zu Krisenunterstützung weiterzuleiten, wenn sie als gefährdet für Selbstverletzung, häusliche Gewalt oder eine Essstörung gekennzeichnet sind, erforscht auch Möglichkeiten, sein Angebot zu erweitern, um die Verhinderung von gewaltbereitem Extremismus einzubeziehen, sagte sein Gründer und ehemaliger Jugendarbeiter Elliot Taylor.

Das Unternehmen befindet sich in Gesprächen mit The Christchurch Call, einer Initiative zur Bekämpfung von Online-Hass, die nach dem schlimmsten Terroranschlag Neuseelands im Jahr 2019 gegründet wurde. Dabei würde die Anti-Extremismus-Gruppe Anleitung geben, während ThroughLine den Interventions-Chatbot entwickelt, sagte der ehemalige Jugendarbeiter.

„Das ist etwas, worauf wir hinarbeiten möchten, um bessere Arbeit zu leisten und dann Plattformen besser unterstützen zu können", sagte Taylor in einem Interview und fügte hinzu, dass kein Zeitrahmen festgelegt wurde.

OpenAI bestätigte die Beziehung mit ThroughLine, lehnte jedoch weitere Kommentare ab. Anthropic und Google reagierten nicht sofort auf Anfragen zur Stellungnahme.

Taylors Firma, die er von seinem Zuhause im ländlichen Neuseeland aus betreibt, ist mit ihrem Angebot eines ständig überprüften Netzwerks von 1.600 Helplines in 180 Ländern zu einer ersten Anlaufstelle für KI-gesteuerte Unternehmen geworden.

Sobald die KI Anzeichen einer potenziellen psychischen Krise erkennt, leitet sie den Benutzer an ThroughLine weiter, das sie mit einem verfügbaren, von Menschen betriebenen Dienst in der Nähe zusammenbringt.

Aber der Umfang von ThroughLine war auf bestimmte Kategorien beschränkt, sagte der Gründer. Die Bandbreite der psychischen Gesundheitsprobleme, die Menschen online offenlegen, ist mit der Beliebtheit von KI-gesteuerten Chatbots explodiert und umfasst jetzt auch Liebäugeln mit Extremismus, fügte er hinzu.

Mehr Chatbots, mehr Probleme

Das Anti-Extremismus-Tool wäre wahrscheinlich ein Hybridmodell, das einen Chatbot kombiniert, der darauf trainiert ist, auf Menschen zu reagieren, die Anzeichen von Extremismus zeigen, und Überweisungen an reale psychische Gesundheitsdienste, sagte Taylor.

„Wir verwenden nicht die Trainingsdaten eines Basis-LLM", sagte er und bezog sich dabei auf die generischen Datensätze, die Large-Language-Model-Plattformen verwenden, um kohärenten Text zu bilden. „Wir arbeiten mit den richtigen Experten." Die Technologie wird derzeit getestet, aber es wurde kein Datum für die Veröffentlichung festgelegt.

Galen Lamphere-Englund, ein Terrorismusbekämpfungsberater, der The Christchurch Call vertritt, sagte, er hoffe, das Produkt für Moderatoren von Gaming-Foren und für Eltern und Betreuer einzuführen, die Extremismus online ausmerzen wollen.

Ein Chatbot-Umleitungstool sei „eine gute und notwendige Idee, weil es erkennt, dass nicht nur der Inhalt das Problem ist, sondern Beziehungsdynamiken", sagte Henry Fraser, ein KI-gesteuerte Forscher an der Queensland University of Technology.

Der Erfolg des Produkts hänge möglicherweise von Fragen ab wie „wie gut sind Folgemechanismen und wie gut sind die Strukturen und Beziehungen, in die sie Menschen leiten, um das Problem anzugehen", sagte er.

Taylor sagte, Folgefunktionen, einschließlich möglicher Warnungen an Behörden über gefährliche Benutzer, müssten noch festgelegt werden, würden aber jedes Risiko berücksichtigen, eskalierendes Verhalten auszulösen.

Er sagte, Menschen in Not neigten dazu, Dinge online zu teilen, die sie sich zu peinlich wären, einer Person zu sagen, und Regierungen riskierten, die Gefahr zu vergrößern, wenn sie Plattformen unter Druck setzten, Benutzer auszuschließen, die sich an sensiblen Gesprächen beteiligten.

Eine verstärkte Moderation im Zusammenhang mit Militanz durch Plattformen unter Druck der Strafverfolgungsbehörden hat dazu geführt, dass Sympathisanten zu weniger regulierten Alternativen wie Telegram wechseln, so eine Studie aus dem Jahr 2025 des Stern Center for Business and Human Rights der New York University.

„Wenn Sie mit einem AI Agent sprechen und die Krise offenlegen und es das Gespräch beendet, weiß niemand, dass das passiert ist, und diese Person könnte immer noch ohne Unterstützung sein", sagte Taylor. – Rappler.com

Das könnte Ihnen auch gefallen

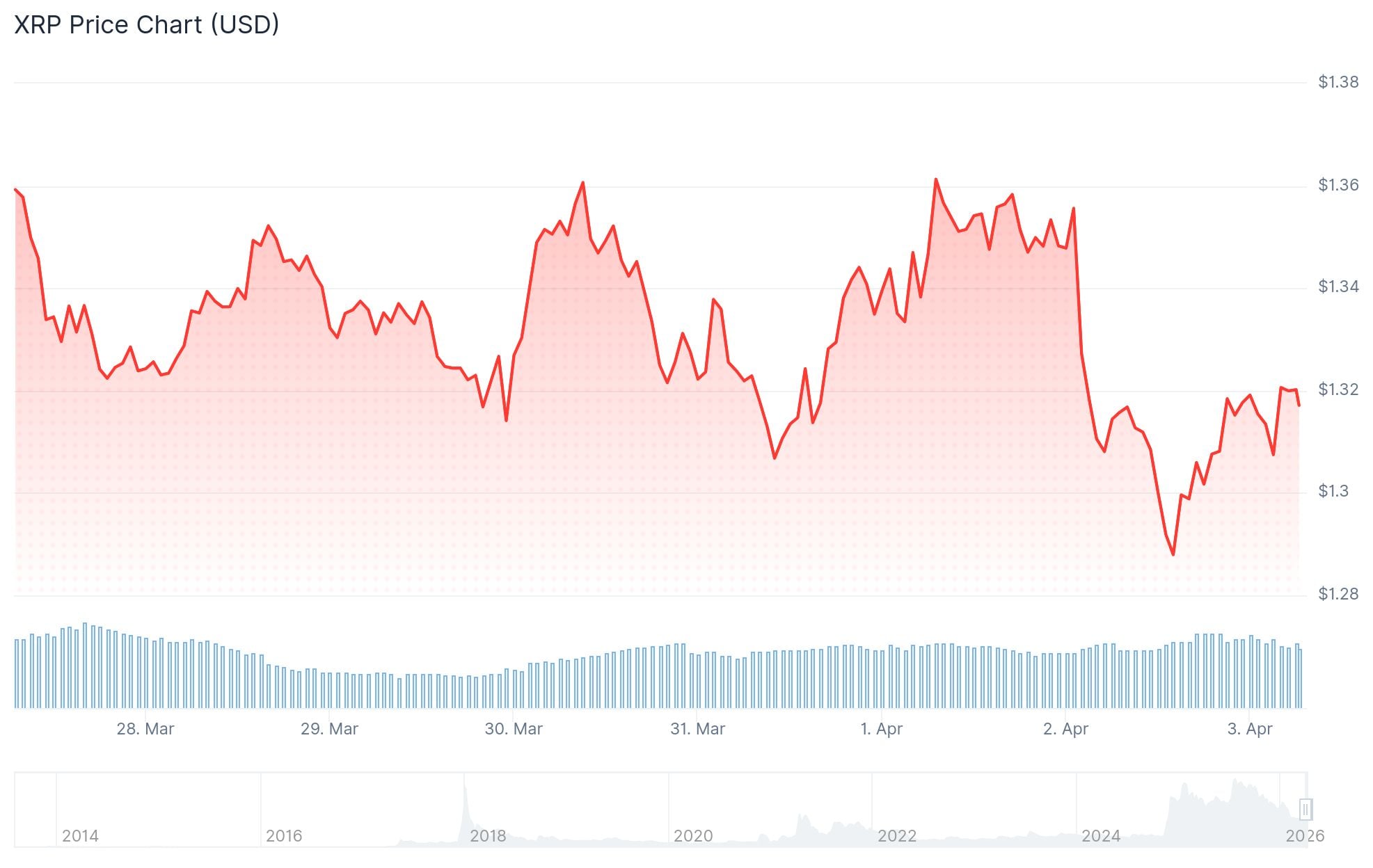

XRP-Preis: Institutionelle Investoren steigen aus, während ETF-Abflüsse und schwache On-Chain-Daten sich häufen – Was kommt als Nächstes?

MTN schließt Ausgliederung von Ghana Mobile Money in großem Fintech-Vorstoß ab