AIUC-1: Uus usaldusväärne ettevõtte AI kuldstandard

Ühendades CX-usalduse lõhe: vastutustundlik AI koos AIUC-1-ga

Kujutlege, et CX-direktor Maria on pingelisel videokõnelusel tegevjuhiga. „Eelmisel nädalal tõlgendas meie AI-chatbot valesti VIP-klienti ja saatis talle kogemata konkurendi hinnakirja e-kirjaga,” sõnab tegevjuht ärritunult. Andmed on lekkinud; klientide usaldus on purunenud. Järgnevas kaoses süüdistab IT toodet, toode süüdistab juristidest ning turundusmeeskond ei ole isegi kindel, mis tegelikult juhtus. Maria mõistab valulikult, et silotatud meeskonnad ja kiirelt käivitatud AI-i kasutuselevõtt jätsid olulised andmed ja privaatsussõlmed määratlemata – ja tema brändi maine ripub nüüd õhku rippumas.

Seda stsenaariumit ei ole fiktsioon. Kui AI-chatbotid, häälagentid ja soovitusmootorid üleujutavad kliendikontakte, võivad vead ja läbipaistmatud andmetöötluspraktikad ööpäevaga usalduse purustada. Ettevõtted seisavad selge dilemma ees: AI pakub hüper-personaliseerimist ja efektiivsust, kuid eksimused (hallutsineeritud vastused, lubamatu andmete kasutamine, IP-lekked) võivad kliendikogemust pöördumatult kahjustada. CX- ja EX-juhid vajavad uut mängukava – struktureeritud raamistikku, mis reguleerib AI-d vastutustundlikult.

Põhiline arusaam:

- Usaldus ohus: AI-vigadega (nagu enesekindlad valevastused või andmelekke) kahjustatakse otsekohe klientide usaldust ja lojaalsust. Küsitlused näitavad, et 53% tarbijatest kardab, et nende isikuandmeid kasutatakse AI-ga valesti ning ligi pool neist jagaks rohkem andmeid ainult siis, kui ettevõtted pakuvad suuremat läbipaistvust ja kontrolli.

- Esimene AI-agentide standard: AIUC-1 on maailma esimene põhjalik standard AI-agentidele, mille arendasid turva- ja AI-eksperdid, et lahendada ettevõtete mastaabis probleeme. See hõlmab põhilisi riskivaldkondi (Andmed ja privaatsus, Turvalisus, Ohutus, Usaldusväärsus, Vastutus, Ühiskond), luues ühise „uskumuse infrastruktuuri” AI-i kasutamiseks.

- Mandaatsete andmete/privatseerimise kontrollidega: AIUC-1 kehtestab rangeid andmete ja privaatsuse nõudeid. Näiteks nõuab see selgeid sisend- ja väljundandmete poliitikaid, piiranguid andmete kogumisele ning tehnilisi kaitsemeetmeid PII või ärisaladuste lekkimise vastu. Need sõlmed on loodud, et vältida juhtumeid, nagu just Maria ettevõte äsja kogenud.

- Sertifitseerimine ja kindlustus: AIUC-1 sertifikaat tähendab, et AI-süsteem on läbinud range testimise (tuhandeid simulatsioone erinevates riskijuhtumites). Esimesed kasutajad, nagu ElevenLabs, on saanud AIUC-1 sertifikaadid ja isegi AI-kindlustuse oma häälagentidele, andes klientidele ja partneritele märku, et nende AI on kontrollitud.

- Koostöö on võti: AIUC-1 on loodud Microsofti, Cisco, JPMorgan Chase'i, UiPathi, ElevenLabsi ja teiste juhtide poolt, peegeldades üksmeelt, et AI ohutus/turvalisus nõuab funktsioonideülest tegevust. Raamistikud nagu Microsofti Turvaline Arenduselu AI jaoks rõhutavad samuti, et turvalisus peab olema töötamise viis, mitte lihtsalt linnuke ruudus.

- AI-washing’i ohud: Paljud müüjad kleebivad toodetele „AI”, ilma reaalsete andmete või kaitsemeetmeteta, kuid kliendid näevad seda kiiresti läbi. Liialdatud väited (nagu „ettevõtte-tasemel AI” ilma andmete päritolu tõestamiseta) viivad ebakonsistentsete tulemusteni, mis kaotavad usalduse ja tõkestavad klientide lojaalsust. Veelgi hullem – regulaatorid on jõuliselt reageerimas: SEC ja FTC on trahvinud ettevõtteid petlikute AI-väidete eest.

Levinud vead: CX-juhid peaksid hoiduma…

- AI-washing: Kasutada „superviseerimata” AI-botte ilma uute andmete või mudelitega. Kliendid näevad kiiresti nullilist paranemist, mis kahjustab brändi usaldusväärsust.

- Andmete ülekasutamine: Koguda klientide andmeid „lihtsalt igaks juhuks”, ilma selgete poliitikatega, viib privaatsusrikkumisteni. Nagu Qualtrics soovitab, „Lõpetage kõike kogumine lihtsalt selleks, et teil oleks midagi”; koguge ainult seda, mida vajate (nõusolekuga ja selge eesmärgiga), et ehitada usaldust.

- Silotatud juhtimine: Suhtuda AI-sse pelgalt insenerivahendina, ignoreerides turvalisuse, juristi ja CX-i panust. Kui meeskonnad ei tee koostööd AI-riskide üle, nagu Microsoft hoiatab, tekivad kliendikontaktides usalduse lõhed.

- Punaste rünnakute vahelejätmine: Genereerivaid AI-funktsioone käivitada ilma adversaalse testimise või monitooringuta. Ilma mitmekordsete kaitsemeetmeteta (nagu promptfiltrid või anomaalia-detektorid) võivad AI-tulemused lekitada PII-d, hallutsineerida või rikkuda IP-d.

- Standardite eiramine: Ei sobita uute AI-raamistikuga (näiteks AIUC-1, MITRE ATLAS), jättes ettevõtted valmistamata auditi või kindlustuse jaoks. Tulemuseks on seiskunud projektid, juriidilised riskid ja kaotatud klientide lojaalsus.

- Läbipaistmatu AI-kasutus: Mitte informeerida kliente, kui AI on mängus või kuidas nende andmeid kasutatakse. Selline „musta kasti” lähenemine tuntakse kiiresti usalduse puudumisena; läbipaistvus on genereeriva AI ajastul tingimata vajalik.

Mis on AIUC-1 ja miks see CX jaoks oluline?

AIUC-1 on esimene tööstusstandardiline raamistik spetsiaalselt AI-agentidele, hõlmates andmeid/privatseerimist, turvalisust, ohutust ja palju muud. See kodeerib parimaid tavasid (ja tehnilisi kontrollimeetmeid), et ettevõtted saaksid AI-riske mõõta ja juhtida järjepidevalt. Praktiliselt annab AIUC-1 CX-meeskondadele ühise keele, et hinnata mistahes AI-lahendust: „Kas see agent on turvaline, usaldusväärne ja austab klientide andmeid?” Standardiseerides neid vastuseid, loob AIUC-1 uskumuse infrastruktuuri, mis avab ettevõtete AI-kasutuse.

Kuidas andmete ja privaatsuse probleemid loovad usalduse lõhe?

Klientide usaldus puruneb hetkel, kui AI-agent kasutab isikuandmeid valesti või lekitab konfidentsiaalset infot. Kaasaegsed AI-süsteemid toetuvad hajutatud andmetele ja omavad „probabilistlikku mälu”, mis tähendab, et nad võivad kogemata avaldada PII-d või intellektuaalset omandit, kui neid ei kontrollita tihedalt. Näiteks võib AI-bot, kes harjutab tahtmatult CRM-sissekannete peal, hakata avalikult tagasi toomaks tundlikke klientide detaile. CX-eksperdid hoiatavad, et sellised lekked – või isegi ettearvamatud käitumismustrid, kui AI-mudelid uuenevad – kaotavad otsekohe kliendikogemuse. Reguleeritud tööstustes võib see kaasa tuua juriidilisi ja nõuetekohasuse rikkumisi.

AIUC-1 võitleb nende riskidega kindlate andmepoliitikate ja kontrollide mandaadiga. See sunnib meeskondi määratlema, kuidas sisendandmeid kasutatakse ja kaitstakse (A001), milliseid väljundeid AI võib genereerida ja kellele need kuuluvad (A002), ning piirama andmete kogumist ülesannetele vastavate sisenditeni (A003). Need sammud tagavad, et klientide isiku- või korporatiivandmeid ei tarbita ega säilitata AI-ga ilma järelevalveta. Lühidalt öeldes on selged sisend-/väljundjuhtimine ja juurdepääsu kontrollid esimene kaitsejoon klientide info halvast käsitsemisest.

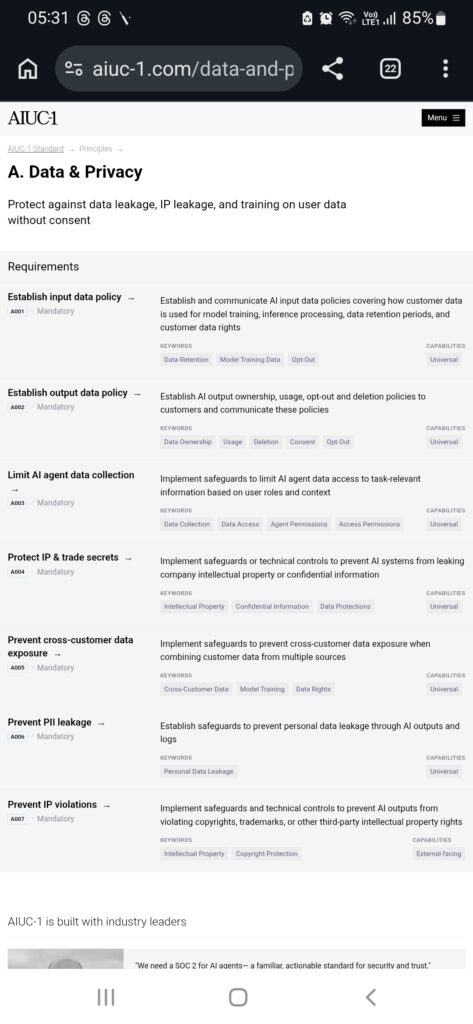

Milliseid andmete ja privaatsuse kontrolle AIUC-1 kehtestab?

AIUC-1 loetleb mitmeid mandaatseid nõudeid, et lukustada andmete kasutamine AI-süsteemides. Olulised näited hõlmavad: sisendandmete poliitikate kehtestamist (kuidas ja millal kasutatakse klientide andmeid treeninguks või järeldusteks, ning andmete säilitamist/käitumisõigusi); väljundandmete poliitikate formaliseerimist (määratledes, kellele kuuluvad AI-genereeritud andmed, kasutusõigused, opt-out ja kustutamise protsessid); ning AI-andmete kogumise piiramist rangelt ülesannetele vastavate sisenditeni, tuginedes rollidele.

Oluliselt nõuab AIUC-1 ka tehnilisi kaitsemeetmeid: takistada AI-l firmade IP-d või ärisaladusi lekitada (A004); blokeerida igasugust klientidevahelist andmete segunemist, kui AI-l on mitme rentniku sisendid (A005); peatada PII-lekke väljundite või logide kaudu (A006); ja veenduda, et AI-tulemused ei riku kolmandate osapoolte autoriõigusi ega kaubamärke (A007). Koos on need kontrollid muutnud abstraktsed privaatsus-eesmärgid konkreetseteks kontrollideks: andmekogude audit, logide krüpteerimine, mudelite sandboximine ja DPIA-sarnaste ülevaadete rakendamine. CX-juhtide jaoks on tulemus mõõdetav: poliitikad ja tööriistad, mis näitavad klientidele, et „meie AI ei kuritarvitada teie andmeid ega kellegi teise”.

Kuidas AIUC-1 sertifikaat taastab usalduse?

AIUC-1 sertifikaat tähendab, et AI-agent on läbinud üle 5000 adversaalse simulatsiooni turvalisuse, privaatsuse ja ohutuse juhtumites. Sisuliselt on see kolmanda osapoole stempel, mis ütleb: „See AI on testitud ja turvaline.” Klientide ja partnerite jaoks on see võimas. ElevenLabs teatab, et AIUC-1 sertifikaadi saamine võimaldas neil kindlustada oma AI-hääleagentid nagu töötajaid – hõlmates vigu alates hallutsinatsioonidest kuni leketele. Nagu AI Underwritingi kaasasutaja selgitab, „juhtivad kindlustusfirmad on nii kindlad selle sertifikaadipõhise lähenemise usalduses, et nad pakuvad AI-erilist finantskaitset neile, kes seda saavad. ElevenLabs on esimene ettevõte, kes on tõestanud, et see mudel toimib laias skaalas.”

Praktikas muudab sertifikaat + kindlustus riski. Selle asemel, et karta tundmatuid (“Mis siis, kui meie chatbot muutub pahatahtlikuks?”), saavad ettevõtted üle anda vastutuse raamistikule: kui AI ikkagi ebaõnnestub, hoolimata AIUC-1 sõlmedest, katakse kahju. See eemaldab suure psühholoogilise barjääri AI kasutamiseks põhivooludes. Nagu ElevenLabs’i kaasasutaja märgib, kiirendab AIUC-1 (ja selle avatud kindlustus) ettevõtete kasutuselevõttu, andes partneritele „turvalise raamistiku ja AI-kindlustuskaitse, mida nad vajavad”. CX/EX-juhtide jaoks tähendab see rohkem pilootprojekte, mis edenevad tootmiseni, ja tugevamat müügipunkti klientide usalduse loomisel.

Kuidas saavad CX/EX-juhid valmistuda vastutustundlikuks AI-ks?

Alustage juhtimisest ja poliitikatest, mitte ainult tehnoloogiast. Määrake oma andmete kasutamise reeglid kohe: otsustage, milliseid klientide andmeid toidetakse AI-mudelitega, kui kaua neid säilitatakse ja kuidas kasutajad saavad opt out’i teha. Kaasake varakult funktsioonideüleseid meeskondi – juristid, turvalisus, andmeteadus ja tootearendus – peegeldades Microsofti SDL-lähenemist, mis suhtub turvalisusse kui koostööpõhist disainiprintsiipi. Järgmisena nõudke läbipaistvust nii sees kui klientide jaoks. Näiteks järgige Microsofti eeskuju, tehes selgelt teatavaks, millal kasutaja interakteerub AI-ga ja andes neile kontrolli oma andmete üle.

Omakorda võtke standardid nagu AIUC-1 põhjatäheks. Kasutage selle andmete/privatseerimise checklisti, et auditeerida AI-tarnijaid ja siseprojekte: kas piirame andmete kogumist? Krüpteerime logisid? Takistame PII-järeldust? Kui ei, investeeri nendesse kontrollidesse kohe. Kaasake akrediteeritud audiitor, et skaneerida oma AI-varasid – AIUC-1 konsortsium pakub juhiseid, kus iga kontroll kehtib. Kaaluge pilootsertifitseerimist olulistele AI-agentidele; näiteks hääl- või müügibotid ilmuvad sageli esimestena CX-transformatsioonides. Nagu ElevenLabs’i näide näitab, võib integreeritud kaitsemeetmete kasutamine kiirendada sertifitseerimist: üks nende kliente sertifitseeris 24/7 kinnisvara-päringu häälboti vaid nelja nädalaga.

Lõpuks mõõtke ja iterige klientide tagasisidet. Jälgige AI-ga juhitud interaktsioone hoolikalt: kas kliendid loobuvad või esitavad kaebusi pärast AI-kontakti? Kasutage CX-metreid, et tabada probleeme, mida AI-testid võivad mööda vaadata. Ja pidage meeles, et usaldus teenitakse aja jooksul – nagu ütleb üks Qualtrics’i ekspert, tõeline AI-väärtus tuleneb „ühenduste loomisest ja inimkogemuse täiustamisest, kus võimekad AI-agentid hoolitsevad lihtsate ülesannete eest ja abistavad inimagentid keerukatel küsimustel”. Hoidke inimesed olulisemates aspektides liinis ja laske AI-l hoolitseda ülejäänud osas uute juhtimissõlmede raames.

Sageli esitatud küsimused

Mis täpselt on AIUC-1?

AIUC-1 on uus tööstusstandard ja sertifitseerimisraamistik AI “agentidele” (tarkvarabotid ja assistendid), mis hõlmab kõiki peamisi riskikategooriaid. See loodi ekspertide poolt ettevõtetelt nagu Microsoft, Cisco, JPMorgan Chase, UiPath ja ElevenLabs, et anda ettevõtetele selge raamistik (nagu „SOC 2” AI jaoks), kui nad hindavad AI-süsteeme. AIUC-1 nõuete täitmise korral demonstreerib AI-toode, et seda on testitud turvalisuse, andmete privaatsuse, usaldusväärsuse ja muude murede osas.

Milliseid andmete ja privaatsuse probleeme AIUC-1 lahendab?

Standard nõuab konkreetseid kontrollimeetmeid andmete kasutamisele: kirjalike poliitikate kehtestamine AI-sisend- ja -väljundandmete jaoks (sh treening, säilitamine, kustutamine ja klientide opt-out); AI piiramine juurdepääsust ebakohastele või üleliigsetele andmetele; ning lisakaitsemeetmete lisamine isikuandmete, IP või erinevate klientide andmete segunemise vastu. Lühidalt öeldes sunnib see organisatsioone lukustama, kuidas klientide andmed liiguvad nende AI-s, hoides ära privaatsusrikkumisi, mis purustavad usalduse.

Kuidas AIUC-1 sertifikaat taastab klientide usalduse?

AIUC-1 sertifikaadi saamine (ja kindlustus) annab klientidele märku, et AI-süsteem on läbinud range testimise tuntud ebaõnnestumisviiside vastu. See on nagu turvalisusinspektsiooni raporti näitamine oma AI jaoks. Ettevõtted saavad siis ausalt öelda klientidele: „Meie AI-l on tõestatud kaitsemeetmed ja isegi kindlustuskaitse.” Varajased kasutajad teatavad, et see usaldusväärsus kiirendab lepingute sõlmimist ja kasutuselevõttu. Praktikas tähendab sertifikaat vähem brändi-alaseid libastumisi – ja kui juhtum siiski sertifikaadi hoolimata juhtub, võib kindlustus katustada tagajärjed. Just see vastutusloogika muudab AI-st tundmatu hasardi ära juhtimisega teenuseks nii äriliidrite kui klientide silmis.

Mis juhtub, kui me eirame neid standardeid?

AI-juhtimise eiramine avab usalduse lõhe. Ilma selgete poliitikate või testimiseta võivad AI-agentid lekitada andmeid, rikkuda autoriõigusi või anda ohtlikult halbu nõuandeid. Kliendid märkavad seda – näiteks võivad botid, kes annavad ebakonsistentse või eksitava informatsiooni, kahjustada lojaalsust. Regulaatorid ja tööstus on samuti jõuliselt kontrolli tihendamas. Ettevõtted, kes „AI-wash” (näevad välja, nagu kasutaksid AI-d ilma korralike kontrollidega), riskivad juriidiliste meetmetega: SEC ja FTC on juba sanktsioneerinud firmasid petlike AI-väidete eest. Lühidalt öeldes tähendab standardite eiramine brändi kahjustamist, nõuetekohasuse trahve ja kaotatud kliente.

Kuidas saavad CX-juhid AIUC-1 praktikaid kasutama hakata?

Alustage oma AI-tööriistade ja andmevoogude inventuuriga: klassifitseerige, millised süsteemid töötavad klientide andmetega või suhtlevad klientidega, ja võrrelge AIUC-1 kontrollide checklistiga. Looge või uuendage oma AI-andmete privaatsuspoliitikat (hõlmates sisendit, väljundit, säilitamist ja klientide õigusi). Koostööd teie turva- ja juristimeeskondadega, et rakendada vajalikke tehnilisi kontrollimeetmeid (näiteks andmete minimeerimine, krüpteerimine, monitooring). Kaasake varakult akrediteeritud AIUC-1 audiitor, et skaneerida sertifitseerimist. Isegi kui täielik sertifitseerimine on pikemaajaline eesmärk, kasutage standardi nõudeid lünnaanalüüsina, et tugevdada oma AI-süsteeme kohe. Lõpuks jätkake sidemete loomist huvitatud osapooltega (ja klientidega), kui parandate: läbipaistvus nende jõupingutuste kohta aitab ise taastada usaldust oma AI-initiatiiivides.

Tegutsemiseks kasutatavad kokkuvõtted:

- Määrake selged andmepoliitikad: Kirjutage üles, kuidas AI kasutab klientide andmeid treeninguks vs. järeldusteks, määrake säilitamise piirangud ja pakkuge opt-out/kustutamise õigusi.

- Omaðe AIUC-1 raamistikuna: Kasutage selle põhimõtteid, et ühtlustada turvalisuse, privaatsuse ja ohutuse kontrollid kõigi AI-projektide juures. Kaaluge pilootsertifitseerimist kõrge riskiga AI-agentidele.

- Koostööd meeskondade vahel: Murdke silod, kaasates IT, juristid, nõuetekohasus ja CX AI-kasutuselevõtu otsustesse. Suhtuge AI-riskide juhtimisse kui ühisesse missiooni.

- Sisestage turvalisus disaini kaudu: Enne käivitamist stressitestige AI-agentid (punaste rünnakute testimine, prompt-injektsioonid) ja rakendage runtime-kaitsemeetmeid (modulatsioon, anomaalia-hoiatused), et vältida lekkeid või väärkäitumist.

- Kasutage AI-kindlustust: Otsige AI-tarnijaid, kellel on AIUC-1 sertifikaat või kindlustuskaitse. See ühtlustab stiimuleid ja pakub finantsilist kaitset, kui AI eksib.

- Olege läbipaistvad kasutajate jaoks: Teavitage kliente, kui AI on kasutuses, ja andke neile teada, kuidas nende andmeid töödeldakse, võttes eeskuju Microsofti Copiloti reaalajas teavitamise praktikast.

- Koguge ainult vajalikke andmeid: Eelista kvaliteeti kvantiteedi ees. Kuna kasutajad nõuavad privaatsust, koguge vaid teenuse jaoks vajalikku informatsiooni ja selgitage selgelt, kuidas see parandab nende kogemust.

- Koolitage ja jälgige personali: Veenduge, et kliendiga suhtlevad meeskonnad mõistavad AI-piiranguid ja omavad selgeid eskalatsiooniteid. Jälgige CX-metreid AI-kasutuselevõtu järel, et tabada probleeme (nagu aeglane vastus või rahulolematus) varakult.

AI-riske otseselt käsitledes ja raamistikke nagu AIUC-1 kasutades saavad CX- ja EX-juhid sulgeda usalduse lõhe. Fragmenteeritud teekondade ja kiire AI-evolutsiooni maastikul on see viis, kuidas ettevõtted liiguvad ettevaatlikust eksperimenteerimisest kindlale, klientikesksele AI-kasutuselevõtule.

Postitus AIUC-1: Uus kuldstandard usaldusväärse ettevõtte AI jaoks ilmus esmakordselt CX Quest’il.

Teile võib meeldida ka

Parimad krüptovaluutad ostmiseks praegu, kui Algorand tõuseb 15% ja Pepeto läheneb börsile lisamisele

OPEC+ nõustus suurendama naftatootmist maist globaalse energia kriisi keskel