Il existe un récit technologique qui suppose la centralisation : les données migrent vers le cloud computing, le calcul s'y effectue, les résultats reviennent. Pour les entreprises d'infrastructure cloud computing, ce récit est pratique. Pour les entreprises qui construisent réellement des systèmes d'IA devant fonctionner de manière fiable, rapide et sécurisée dans des environnements réels, ce récit devient de plus en plus limitant.

L'edge computing — le déplacement de la capacité de calcul plus près de l'endroit où les données sont générées et où les décisions doivent être prises — n'est pas nouveau. Ce qui est nouveau, c'est son urgence. La combinaison des exigences d'IA en temps réel, de la réglementation sur la confidentialité, des contraintes de bande passante réseau et de la complexité émergente de l'IoT et des systèmes autonomes fait de l'edge computing non pas un choix architectural de niche, mais une exigence centrale pour des catégories entières d'applications.

J'observe attentivement cette évolution via NexaTech Ventures car elle représente l'une des transitions architecturales les plus importantes dans l'infrastructure technologique depuis la migration vers le cloud computing elle-même.

Où l'architecture cloud échoue

Le cloud computing a été construit sur une hypothèse qui s'est avérée correcte pendant les deux premières décennies d'Internet : il est moins coûteux d'envoyer des données vers des ressources de calcul centrales que de distribuer le calcul sur le réseau. Pour la plupart des applications web — recherche, médias sociaux, e-commerce — cela reste vrai. Mais pour un ensemble croissant d'applications, cette hypothèse s'effondre.

Prenons les véhicules autonomes. Une voiture autonome prend des décisions critiques pour la sécurité en millisecondes sur la base de données de capteurs. Envoyer des données brutes de capteurs vers un service cloud distant, attendre une réponse et recevoir la décision en retour n'est pas seulement inefficace ; c'est fondamentalement impraticable. La latence est inacceptable et l'exigence de fiabilité ne peut être satisfaite. Le calcul doit se produire sur le véhicule lui-même, en temps réel, en utilisant un traitement local.

Ou considérez les applications réglementées en matière de confidentialité dans les soins de santé ou les services financiers. Le RGPD et des réglementations similaires exigent de plus en plus que les données personnelles sensibles soient traitées dans des juridictions spécifiques et sous des contrôles de sécurité spécifiques. La diffusion de données médicales ou de détails de transactions financières vers un service cloud dans un autre pays, même pour une analyse légitime, crée des complications de conformité qui rendent le traitement centralisé juridiquement et opérationnellement risqué.

Ou considérez la fabrication sur le site de production. Une installation de fabrication générant des téraoctets de données de capteurs à partir d'équipements de production ne peut pas réalistement diffuser tout cela vers un service cloud pour analyse. Le coût de bande passante est prohibitif, la latence pour les ajustements de processus en temps réel est inacceptable et le risque de résilience opérationnelle est trop élevé. Le calcul doit se produire localement.

Ce ne sont pas des cas marginaux. Ce sont des catégories centrales d'applications émergentes. Et l'architecture cloud computing, par conception, est mal adaptée à toutes.

Le changement technique requis

L'edge AI nécessite une architecture technique différente de l'IA basée sur le cloud. Les modèles d'apprentissage automatique doivent être plus petits, plus efficaces et optimisés pour des appareils aux ressources limitées. Les pipelines d'inférence doivent être robustes face à une connectivité réseau intermittente. Le modèle de sécurité doit fonctionner pour des systèmes distribués plutôt que pour des centres de données centralisés. Les mécanismes de mise à jour et de gestion des versions doivent pousser les modifications vers des milliers ou des millions d'appareils edge de manière efficace et sécurisée.

Ce sont des problèmes difficiles, et ils nécessitent des approches différentes du développement d'IA cloud. Les entreprises qui les résolvent ne sont pas des entreprises de cloud computing ; ce sont de nouvelles entreprises construisant une infrastructure d'IA optimisée pour l'edge.

Plusieurs tendances techniques convergent pour rendre cette transition possible. Les techniques de compression et de quantification de modèles s'améliorent rapidement, permettant à des modèles d'IA sophistiqués de fonctionner sur des appareils edge avec des ressources de calcul fractionnaires. Du matériel spécialisé — TPU, NPU et autres accélérateurs d'IA — devient disponible dans les appareils edge, fournissant la capacité de calcul nécessaire. Des normes ouvertes pour le déploiement edge émergent, brisant le verrouillage aux plateformes propriétaires.

Chez NexaTech Ventures, nous soutenons des entreprises dans trois catégories au sein de l'infrastructure edge AI. Premièrement, les plateformes d'optimisation et de déploiement de modèles qui prennent de grands modèles d'IA et les compressent pour une exécution edge. Deuxièmement, les moteurs d'inférence edge optimisés pour une exécution distribuée à faible latence. Troisièmement, les systèmes d'orchestration edge qui gèrent le déploiement, les mises à jour et la surveillance des charges de travail d'IA sur une infrastructure edge distribuée.

Où l'Europe se positionne

L'avantage infrastructurel de l'Europe dans l'edge computing est subtil mais réel. Le continent a investi massivement dans l'infrastructure de télécommunications et le déploiement de la 5G, ce qui fournit la capacité réseau et la connectivité à faible latence nécessaires pour l'edge computing. La réglementation européenne sur la protection des données, loin d'être un handicap, stimule la demande pour des solutions d'edge computing qui maintiennent les données sensibles en local.

Plus important encore, les secteurs manufacturier, automobile et industriel européens génèrent une demande réelle pour l'edge AI. Les entreprises automobiles allemandes ont besoin d'edge AI pour les véhicules autonomes. Les fabricants italiens ont besoin d'edge computing pour la fabrication de précision. L'agriculture néerlandaise a besoin d'edge AI pour les systèmes d'agriculture de précision. Cela crée un cercle vertueux où la demande stimule l'investissement dans l'infrastructure edge AI, qui attire les talents et les capitaux, qui améliore la capacité de la technologie, qui stimule une adoption accrue.

Le récit américain de l'edge computing est actuellement dominé par des entreprises cloud tentant d'étendre leurs plateformes à l'edge. AWS, Google Cloud et Azure offrent tous des services edge. Mais ce sont fondamentalement des architectures centrées sur le cloud avec l'edge ajouté. L'architecture transformatrice d'edge AI est construite par des entreprises qui commencent avec l'hypothèse que le calcul se produit à l'edge et que le cloud est l'exception, pas la règle.

L'argument d'investissement

L'edge computing et l'edge AI représentent un changement structurel dans la manière dont les logiciels sont déployés et exécutés. Ce n'est pas une tendance temporaire ou un marché de niche. C'est une transition architecturale fondamentale motivée par de réelles exigences techniques que le cloud computing ne peut satisfaire.

L'opportunité d'investissement se situe à plusieurs niveaux. Au niveau de l'infrastructure, les entreprises construisant des plateformes d'IA optimisées pour l'edge et des outils de déploiement créent un avantage concurrentiel durable. Au niveau des applications, les entreprises qui réarchitecturent leurs logiciels pour une exécution edge — véhicules autonomes, systèmes industriels, dispositifs de santé — obtiendront des avantages de performance et de fiabilité qui seront difficiles à déloger.

Chez NexaTech Ventures, nous recherchons des entreprises d'edge AI qui comprennent à la fois les exigences techniques et les défis opérationnels. Les meilleures entreprises n'optimisent pas seulement les algorithmes ; elles construisent des systèmes complets pour le déploiement edge, incluant la surveillance, la sécurité, la gestion des mises à jour et le support opérationnel.

Le passage du cloud centralisé à l'edge computing distribué représente la transition d'infrastructure la plus importante dans la technologie depuis la migration vers le cloud. Les entreprises qui se positionnent tôt dans cette transition construiront des entreprises substantielles et défendables.

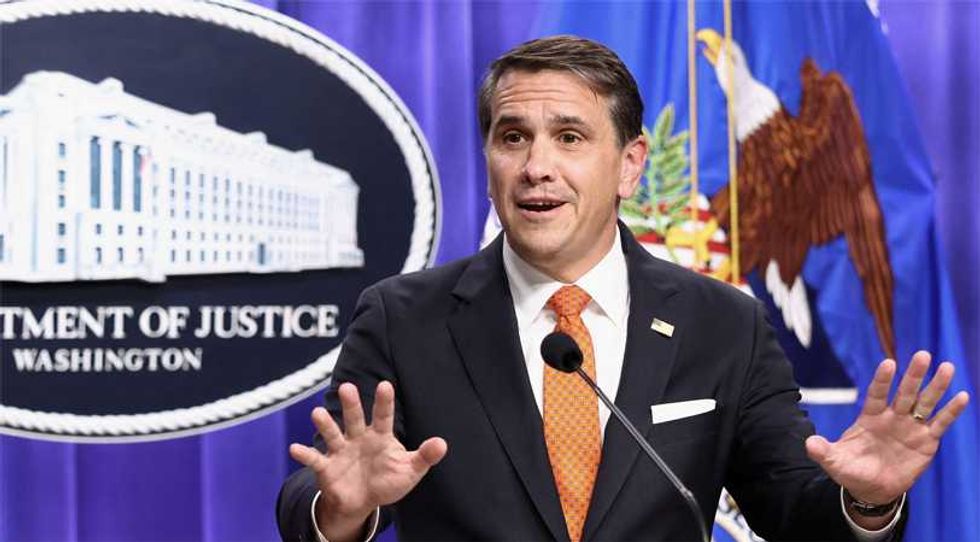

Scott Dylan est le fondateur de NexaTech Ventures. Il écrit sur l'infrastructure technologique, l'IA et l'investissement dans les technologies de pointe. En savoir plus sur scottdylan.com.