बोर्डों को AI से क्या मांग करनी चाहिए: मूल्यांकन, ऑडिट और आश्वासन

एरिका फिल टी. लेगारा द्वारा

एक पिछले BusinessWorld लेख में, मैंने तर्क दिया था कि AI गवर्नेंस कुछ प्रौद्योगिकी परियोजनाओं की देखरेख से परे जाता है और अब यह सुनिश्चित करना शामिल है कि संगठन में AI-सक्षम निर्णय रणनीति, जोखिम क्षमता और नैतिक मानकों के साथ संरेखित रहें। बोर्डों के लिए एक स्वाभाविक अनुवर्ती प्रश्न है: अपेक्षाएं निर्धारित करने के अलावा, एक संगठन कैसे सत्यापित करता है कि उसके AI सिस्टम वास्तव में इच्छित रूप से, जिम्मेदारी से और परिभाषित सीमाओं के भीतर काम कर रहे हैं?

इसका उत्तर तीन संबंधित लेकिन विशिष्ट विषयों में निहित है: AI जोखिम मूल्यांकन, AI ऑडिट और AI आश्वासन। वित्तीय निगरानी से परिचित बोर्ड इस तर्क को सहज पाएंगे। चुनौती, और अवसर, उसी अनुशासन को AI पर लागू करना है।

3 विशिष्ट लेकिन संबंधित अवधारणाएं

प्रत्येक शब्द का अर्थ सटीक होना मददगार है, क्योंकि उन्हें अक्सर एक दूसरे के स्थान पर उपयोग किया जाता है जबकि ऐसा नहीं होना चाहिए।

AI जोखिम मूल्यांकन वह आंतरिक प्रक्रिया है जिसके द्वारा एक संगठन अपने AI सिस्टम से जुड़े जोखिमों की पहचान, मूल्यांकन और प्राथमिकता तय करता है। यह पूछता है कि क्या गलत हो सकता है, इसकी कितनी संभावना है, और इसका प्रभाव क्या होगा। यह वह नींव है जिस पर बाकी सब कुछ टिका है। एक विश्वसनीय जोखिम मूल्यांकन के बिना, न तो ऑडिट और न ही आश्वासन के पास काम करने के लिए एक सार्थक आधार रेखा है। भौतिक AI सिस्टम हर क्षेत्र में मौजूद हैं: एक बैंक में क्रेडिट स्कोरिंग मॉडल, एक अस्पताल में रोगी ट्राइएज टूल, एक विश्वविद्यालय में छात्र प्रदर्शन भविष्यवक्ता, एक सरकारी एजेंसी में केस प्राथमिकता प्रणाली। जो उन्हें साझा करता है वह परिणाम है, जिसमें वास्तविक लोगों को सार्थक तरीके से प्रभावित करने वाले आउटपुट शामिल हैं।

ऐसे किसी भी सिस्टम के लिए, जोखिम मूल्यांकन व्यवस्थित, दस्तावेजीकृत होना चाहिए और नियमित रूप से फिर से देखा जाना चाहिए क्योंकि मॉडल विकसित होता है और संचालन वातावरण बदलता है।

AI ऑडिट यह स्वतंत्र परीक्षण है कि क्या एक AI सिस्टम, या इसके आसपास का गवर्नेंस ढांचा, परिभाषित मानकों, नीतियों या आवश्यकताओं के अनुरूप है। यह एक साक्ष्य-आधारित प्रक्रिया है जो समीक्षाधीन सिस्टम के लिए जिम्मेदार लोगों से पर्याप्त रूप से स्वतंत्र पक्ष द्वारा संचालित की जाती है। एक AI ऑडिट यह आकलन कर सकता है कि क्या किसी संगठन की AI प्रबंधन प्रथाएं अंतरराष्ट्रीय स्तर पर मान्यता प्राप्त मानक के अनुरूप हैं, जैसे कि ISO/IEC 42001, 2023 में प्रकाशित दुनिया का पहला AI प्रबंधन प्रणाली मानक, या क्या एक विशिष्ट मॉडल अनुमोदित मापदंडों के भीतर और अनपेक्षित पूर्वाग्रह के बिना काम कर रहा है। महत्वपूर्ण रूप से, ऑडिटरों को स्वयं नियंत्रित करने वाला मानक, ISO/IEC 42006, जुलाई 2025 में प्रकाशित, अब उन निकायों की योग्यता और कठोरता को निर्धारित करता है जो AI प्रबंधन प्रणालियों का ऑडिट और प्रमाणन करते हैं। दूसरे शब्दों में, ऑडिटिंग पेशा AI सगाई के लिए अपनी जवाबदेही को औपचारिक बनाना शुरू कर रहा है।

AI आश्वासन वह औपचारिक, हितधारक-सामना करने वाला निष्कर्ष है जो उस ऑडिट प्रक्रिया से उभरता है। यह पेशेवर राय है, एक योग्यकृत और स्वतंत्र पक्ष द्वारा जारी की गई, जो बोर्डों, नियामकों, निवेशकों और जनता को विश्वास दिलाती है कि एक AI सिस्टम या AI प्रबंधन ढांचा एक परिभाषित मानक को पूरा करता है। आश्वासन वह है जो एक आंतरिक समीक्षा को एक विश्वसनीय बाहरी संकेत में बदल देता है।

AI आश्वासन की नींव

स्वतंत्र आश्वासन की अवधारणा बोर्डों के लिए नई नहीं है। हर साल, बाहरी ऑडिटर एक संगठन के वित्तीय विवरणों की जांच करते हैं और एक राय जारी करते हैं; एक निष्कर्ष जो साक्ष्य में आधारित है, अंतरराष्ट्रीय स्तर पर मान्यता प्राप्त मानकों के तहत संचालित है, और ऑडिटर की पेशेवर स्वतंत्रता द्वारा समर्थित है। वह राय सटीक रूप से भार रखती है क्योंकि इसे नियंत्रित करने वाला ढांचा कठोर और अच्छी तरह से स्थापित है। यह तर्क उद्योग की परवाह किए बिना लागू होता है; चाहे संगठन एक बैंक हो, एक अस्पताल हो, एक समूह हो, या एक सार्वजनिक संस्थान हो, वित्तीय ऑडिट एक परिचित और विश्वसनीय तंत्र है।

वही तर्क अब AI पर लागू होता है। जब कोई संगठन अपने AI सिस्टम के बारे में सार्वजनिक या नियामक दावा करता है, कि वे निष्पक्ष, पारदर्शी, एक परिभाषित मानक के अनुरूप, या भौतिक पूर्वाग्रह से मुक्त हैं, तो सवाल यह है: उस दावे को स्वतंत्र रूप से कौन मान्य करता है, और किस पेशेवर ढांचे के तहत?

लेखा और ऑडिट पेशे के लिए उत्तर ISAE 3000 है, अंतर्राष्ट्रीय ऑडिटिंग और आश्वासन मानक बोर्ड (IAASB) द्वारा जारी आश्वासन सगाई पर अंतर्राष्ट्रीय मानक। ISAE 3000 ऐतिहासिक वित्तीय जानकारी के अलावा अन्य मामलों पर आश्वासन सगाई को नियंत्रित करता है, जिससे यह AI आश्वासन के लिए स्वाभाविक घर बन जाता है। इस मानक के तहत, एक पेशेवर या तो उचित आश्वासन सगाई कर सकता है, वित्तीय ऑडिट के समान उच्च मानक, या सीमित आश्वासन सगाई, जो समीक्षा की गहराई के करीब है। स्तर का चुनाव मायने रखता है और जानबूझकर होना चाहिए, प्रश्न में AI सिस्टम की भौतिकता और जोखिम के लिए कैलिब्रेटेड।

एक करीबी समकालीन समानता स्थिरता या ESG आश्वासन है। कई फिलीपीन-सूचीबद्ध कंपनियां पहले से ही अपने स्थिरता प्रकटीकरण पर स्वतंत्र आश्वासन कमीशन कर रही हैं, अक्सर ISAE 3000 के तहत। यांत्रिकी बिल्कुल समान है: एक स्वतंत्र व्यवसायी परिभाषित मानदंडों के खिलाफ दावों के एक सेट की जांच करता है और एक औपचारिक निष्कर्ष जारी करता है। विषय वस्तु भिन्न होती है; पेशेवर अनुशासन नहीं।

बोर्डों के लिए इसका अर्थ क्या है

इस ढांचे से तीन व्यावहारिक निहितार्थ निकलते हैं।

पहला, बोर्डों को पूछना चाहिए कि क्या उनके संगठनों ने भौतिक सिस्टम पर कठोर AI जोखिम मूल्यांकन किया है। एकबारगी अभ्यास नहीं, बल्कि एक जीवंत प्रक्रिया जो अपडेट की जाती है क्योंकि मॉडल को फिर से प्रशिक्षित किया जाता है, उपयोग के मामले विस्तारित होते हैं, और नियामक वातावरण विकसित होता है। डाउनस्ट्रीम ऑडिट और आश्वासन कार्य की गुणवत्ता केवल उतनी ही अच्छी है जितनी कि इसके पहले के जोखिम मूल्यांकन।

दूसरा, बोर्डों को आंतरिक और बाहरी AI ऑडिट के बीच अंतर करना चाहिए। आंतरिक ऑडिट कार्य आश्वासन प्रदान करने में एक महत्वपूर्ण भूमिका निभाते हैं कि AI नियंत्रण डिज़ाइन के रूप में संचालित होते हैं। हालांकि, बोर्डों को यह भी विचार करना चाहिए कि क्या भौतिक AI सिस्टम का एक स्वतंत्र, तीसरे पक्ष का ऑडिट उचित है, विशेष रूप से उन सिस्टम के लिए जो ग्राहकों, कर्मचारियों या जनता को महत्वपूर्ण तरीकों से प्रभावित करते हैं। वित्तीय ऑडिटिंग के साथ, स्वतंत्रता विश्वसनीयता को मजबूत करती है।

तीसरा, जैसे-जैसे संगठन नियामकों, निवेशकों और उन समुदायों को अपनी AI प्रथाओं के बारे में सार्वजनिक प्रतिबद्धताएं करते हैं जिनकी वे सेवा करते हैं, बोर्डों को पूछना चाहिए कि क्या वे प्रतिबद्धताएं विश्वसनीय आश्वासन द्वारा समर्थित हैं। स्वतंत्र सत्यापन के बिना दावे, सबसे अच्छे रूप में, एक प्रतिष्ठा जोखिम है जो साकार होने की प्रतीक्षा में है।

एक पेशा अभी भी अपनी क्षमताओं का निर्माण कर रहा है

इस परिदृश्य को इसकी वर्तमान सीमाओं को स्वीकार किए बिना प्रस्तुत करना अधूरा होगा। AI आश्वासन के लिए बुनियादी ढांचा अभी भी बनाया जा रहा है। पेशेवर मानक उभर रहे हैं। AI में ऑडिटर की क्षमताएं, मशीन लर्निंग, एल्गोरिदमिक पूर्वाग्रह, डेटा गवर्नेंस और मॉडल पारदर्शिता तक फैली हुई, अभी तक पेशे में समान रूप से विकसित नहीं हुई हैं। ISAE 3000 आश्वासन ढांचा प्रदान करता है, लेकिन इसके भीतर की AI-विशिष्ट कार्यप्रणाली अभी भी परिपक्व हो रही है।

जो संगठन अभी तक औपचारिक आश्वासन का पीछा करने के लिए तैयार नहीं हैं, उनके लिए यह स्थिर खड़े रहने का कारण नहीं है। भौतिक AI सिस्टम का एक संरचित, नियमित मूल्यांकन एक सार्थक और व्यावहारिक पहला कदम है। यह आंतरिक अनुशासन, दस्तावेज़ीकरण और गवर्नेंस आदतों का निर्माण करता है जो आश्वासन-तत्परता को अंततः आवश्यक होता है। बोर्ड जो आज ऐसे मूल्यांकन कमीशन करते हैं, भले ही अनौपचारिक रूप से, संस्थागत शक्ति विकसित कर रहे हैं जो मायने रखेगी जब नियामक अपेक्षाएं कठोर होंगी और हितधारक जांच तीव्र होगी।

यह दृष्टिकोण वह है जिसे मैंने सहयोगियों के साथ उन अर्थव्यवस्थाओं में जनरेटिव AI गवर्नेंस की जांच करने वाले शोध में और अधिक गहराई से खोजा है जहां विनियमन अभी तक प्रौद्योगिकी के साथ नहीं पकड़ पाया है। केंद्रीय तर्क यह है कि फर्म पहले से ही नैतिक एजेंट हैं जिनके अपने हितधारकों के प्रति मौजूदा नैतिक दायित्व हैं; बेसपोक AI कानून की प्रतीक्षा करना जिम्मेदार गवर्नेंस के लिए न तो आवश्यक है और न ही पर्याप्त है। कार्य करने का दायित्व पहले से ही वहां है। जो आवश्यक है वह इसे संचालित करने की संगठनात्मक इच्छा है।

यह बोर्डों के लिए व्यापक एजेंडे पर प्रतीक्षा करने का कारण नहीं है। यह अब सूचित प्रश्न पूछने का कारण है, अपने बाहरी ऑडिटरों से, अपने आंतरिक ऑडिट कार्यों से, और अपनी प्रबंधन टीमों से, ताकि जब पेशे की क्षमताएं मांग के साथ पकड़ें, तो उनके संगठन सार्थक रूप से संलग्न होने के लिए तैयार हों।

वित्तीय ऑडिट पूरी तरह से गठित नहीं हुआ। स्वतंत्र ऑडिट को आज की विश्वसनीय संस्था बनने के लिए मानक-निर्धारण, पेशेवर विकास और कॉर्पोरेट विफलताओं से कठिन सबक के दशकों लग गए। AI आश्वासन एक तुलनीय प्रारंभिक विभक्ति बिंदु पर है। बोर्ड जो अब इसके साथ संलग्न होते हैं, अपने ऑडिटरों से तेज प्रश्न पूछते हैं, प्रबंधन दावों से अधिक की मांग करते हैं, और नियामकों के ऐसा करने की आवश्यकता से पहले आंतरिक क्षमताओं का निर्माण करते हैं, न केवल अपने स्वयं के जोखिम को कम करेंगे। वे यह आकार देने में मदद करेंगे कि फिलीपीन संगठनों और व्यापक क्षेत्र के लिए जिम्मेदार AI जवाबदेही कैसी दिखती है।

एरिका फिल टी. लेगारा एक भौतिक विज्ञानी, शिक्षक और डेटा विज्ञान और AI व्यवसायी हैं जो सरकार, शिक्षा और उद्योग में काम कर रही हैं। वह शिक्षा केंद्र फॉर AI रिसर्च की उद्घाटन प्रबंध निदेशक और मुख्य AI और डेटा अधिकारी हैं, और एशियन इंस्टीट्यूट ऑफ मैनेजमेंट में एक सहयोगी प्रोफेसर और डेटा विज्ञान में एबोइटिज़ चेयर हैं, जहां उन्होंने 2017 से 2024 तक देश के पहले MSc इन डेटा साइंस कार्यक्रम की स्थापना की और नेतृत्व किया। वह कॉर्पोरेट बोर्डों में सेवा करती हैं, इंस्टीट्यूट ऑफ कॉर्पोरेट डायरेक्टर्स की फेलो हैं, एक IAPP सर्टिफाइड AI गवर्नेंस प्रोफेशनल हैं, और CorteX इनोवेशंस की सह-संस्थापक हैं।

आपको यह भी पसंद आ सकता है

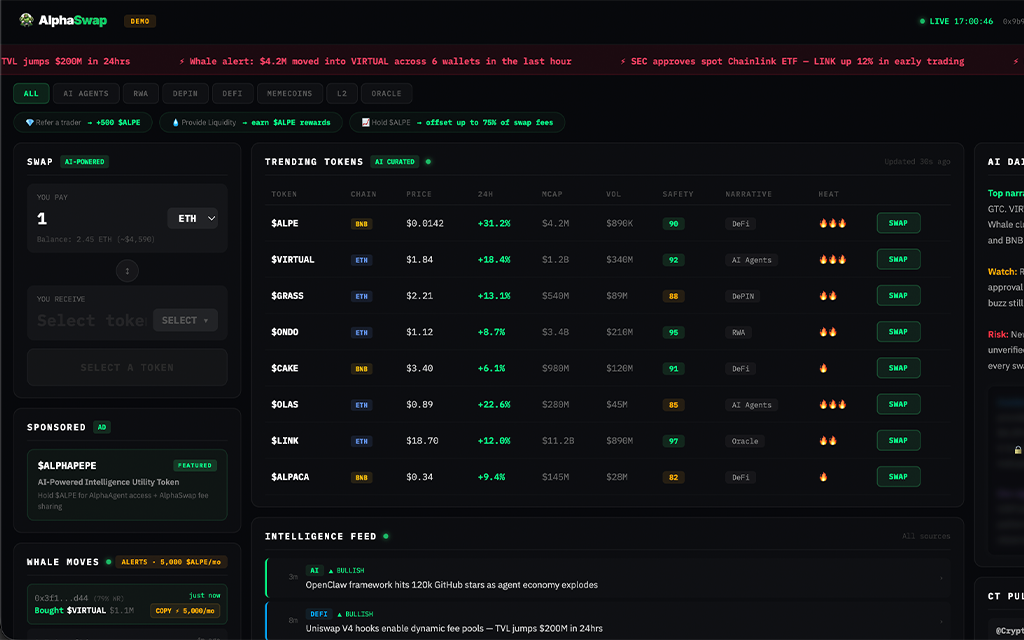

T. Rowe Price ETF फाइलिंग ने ADA एक्सपोजर जोड़ा क्योंकि Cardano प्राइस प्रेडिक्शन खरीदार AlphaPepe के $1 केस पर नजर रख रहे हैं

स्विट्ज़रलैंड के सबसे बड़े बैंक ने Strategy (MSTR) में भारी निवेश किया