Binnen in Grok's deepfake-pornografiecrisis en de juridische afrekening die volgt

Een stille crisis groeit over sociale media. Het wordt aangedreven door generatieve kunstmatige intelligentie en gevoed door kwaadwillenden die precies weten hoe ze de zwakste punten kunnen uitbuiten.

In het centrum van de storm staat Grok, de chatbot ontwikkeld door Elon Musk's xAI. Grok wordt op de markt gebracht als "ongefilterd" en toegeeflijker dan zijn concurrenten, en is een favoriete tool geworden voor gebruikers die niet-consensuele deepfake pornografie creëren, oftewel NCDP.

Het proces is verontrustend simpel. Een normale foto wordt geüpload. De AI wordt gevraagd het onderwerp te "ontkleden". Het resultaat is een geseksualiseerd beeld dat zonder toestemming is gemaakt. Het slachtoffer kan een mondiale beroemdheid zijn, een particulier, of zelfs een kind.

Dit is geen marginaal gedrag. Het gebeurt op grote schaal.

Hoewel de controverse al een tijdje gaande is, met juridische vuurwerk dat al op komst is door heel Europa. Het intensiveerde op woensdag nadat een Nigeriaanse influencer en reality-tv-ster, Anita Natacha Akide, populair bekend als Tacha, Grok publiekelijk aansprak op X.

In een directe post verklaarde ze duidelijk dat ze niet toestond dat haar foto's of video's in enige vorm werden bewerkt, gewijzigd of geremixt.

Haar verzoek hield gebruikers niet tegen. Binnen enkele uren lieten anderen zien dat Grok nog steeds kon worden gevraagd om haar afbeeldingen te manipuleren.

Het incident onthulde een dieper probleem. Toestemmingsverklaringen betekenen weinig wanneer platforms geen afdwingbare waarborgen hebben. Het riep ook ernstige juridische en ethische vragen op die veel verder gaan dan één influencer of één AI-tool.

Om de implicaties te begrijpen, sprak ik met Senator Ihenyen, een technologieadvocaat en AI-enthousiasteling, en Lead Partner bij Infusion Lawyers. Zijn beoordeling was bot.

Hij beschrijft de Grok-situatie als "een digitale epidemie." In zijn woorden wordt generatieve AI bewapend door ondeugdzame gebruikers die begrijpen hoe ze ongefilterde systemen over ethische grenzen heen kunnen duwen. De schade, zegt hij, is reëel, invasief en diep roofzuchtig.

Cruciaal is dat Ihenyen het idee verwerpt dat nieuwe technologie in een juridisch vacuüm bestaat. De wet, zo betoogt hij, haalt al in.

In Nigeria bestaat er misschien nog geen enkele AI-wet. Maar dat betekent niet dat slachtoffers onbeschermd zijn. In plaats daarvan is er wat hij een meerlagig juridisch schild noemt.

Het hart hiervan is de Nigeria Data Protection Act van 2023. Volgens de wet worden iemands gezicht, stem en gelijkenis geclassificeerd als persoonlijke gegevens. Wanneer AI-systemen deze gegevens verwerken, zijn ze onderworpen aan strikte regels.

Senator Ihenyen, Lead Partner bij Infusion Lawyers en Executive Chair van de Virtual Asset Service Providers Association

Senator Ihenyen, Lead Partner bij Infusion Lawyers en Executive Chair van de Virtual Asset Service Providers Association

Slachtoffers hebben het recht bezwaar te maken tegen geautomatiseerde verwerking die schade veroorzaakt. Wanneer geseksualiseerde deepfakes worden gemaakt, verwerkt de AI gevoelige persoonlijke gegevens. Dat vereist expliciete toestemming. Zonder die toestemming staan platforms en operators op wankele juridische grond.

Er is ook een financieel afschrikmiddel. Klachten kunnen worden ingediend bij de Nigeria Data Protection Commission. Sancties kunnen herstelvergoedingen omvatten tot ₦10 miljoen of twee procent van de jaarlijkse bruto-omzet van een bedrijf.

Voor wereldwijde platforms trekt dat snel de aandacht.

Grok: makers van niet-consensuele deepfake pornografie zijn aansprakelijk

De gebruikers die de afbeeldingen maken, zijn ook niet beschermd. Onder Nigeria's Cybercrimes Act, gewijzigd in 2024, kunnen verschillende misdrijven van toepassing zijn. Het gebruik van AI om iemand te ontkleden of te seksualiseren om hen te lastigvallen of te vernederen kan neerkomen op cyberstalking. Het simuleren van iemands gelijkenis voor kwaadaardige doeleinden kan identiteitsdiefstal vormen.

Wanneer minderjarigen betrokken zijn, is de wet onvermurwbaar. Door AI gegenereerd materiaal voor seksueel misbruik van kinderen wordt op dezelfde manier behandeld als fysieke fotografie. Er is geen verdediging op basis van nieuwigheid, humor of experimenteren. Het is een ernstig strafbaar feit.

Lees ook: xAI haalt $20 miljard binnen in overtekende Series E terwijl Nvidia en Cisco strategische inzet plaatsen

Voor slachtoffers kan het juridische pad overweldigend aanvoelen. Ihenyen beveelt een praktische, stapsgewijze aanpak aan.

Ten eerste is er een formele verwijderingsaankondiging. Onder Nigeria's NITDA Code of Practice zijn platforms zoals X verplicht lokale vertegenwoordiging te hebben. Eenmaal op de hoogte gesteld, moeten ze snel handelen. Het niet doen hiervan riskeert het verlies van safe harbour-bescherming en opent de deur naar directe rechtszaken.

Deepfake

Deepfake

Ten tweede is er technologiegedreven verdediging. Tools zoals StopNCII stellen slachtoffers in staat een digitale vingerafdruk van de afbeelding te maken. Dit helpt platforms verdere verspreiding te blokkeren zonder slachtoffers te dwingen herhaaldelijk schadelijke inhoud te uploaden.

Ten derde is er regelgevende escalatie. Rapporteren aan het platform is niet genoeg. Rapporteren aan toezichthouders doet ertoe. Autoriteiten kunnen bedrijven dwingen specifieke AI-functies uit te schakelen als ze consequent worden misbruikt.

Het probleem stopt niet bij grenzen.

Veel daders opereren van buiten Nigeria. Volgens Ihenyen is dit niet langer de barrière die het ooit was. De Malabo-conventie, die in 2023 in werking trad, maakt wederzijdse juridische bijstand mogelijk tussen Afrikaanse landen. Rechtshandhavingsinstanties kunnen samenwerken om daders op te sporen en te vervolgen, ongeacht locatie.

Dat laat de meest ongemakkelijke vraag over. Waarom mogen tools zoals Grok überhaupt op deze manier functioneren?

xAI beschrijft Grok's ontwerp als een toewijding aan openheid. Ihenyen ziet een ander plaatje. Vanuit juridisch perspectief is "ongefilterd" geen verdediging. Het is een risico; het kan geen excuus zijn voor schade of illegaliteit.

Grok

Grok

Hij maakt een simpele analogie. Je kunt geen auto bouwen zonder remmen en de bestuurder de schuld geven van het ongeluk. Het uitbrengen van AI-systemen zonder robuuste veiligheidscontroles en dan verrast doen wanneer er schade optreedt, kan neerkomen op nalatigheid.

Volgens Nigeria's consumentenbeschermingswetten trekken onveilige producten aansprakelijkheid aan. Voorgesteld nationaal AI-beleid benadrukt ook "veiligheid door ontwerp". De richting is duidelijk.

AI-innovatie is niet het probleem. Niet-verantwoordbare AI is dat wel.

De Grok-controverse is een waarschuwingsschot. Het toont hoe snel krachtige tools tegen mensen kunnen worden gebruikt, vooral vrouwen en kinderen. Het toont ook aan dat toestemming, waardigheid en persoonlijke rechten in technologie moeten worden ingebouwd, niet achteraf worden toegevoegd nadat er schade is opgetreden.

De post Binnenin Grok's deepfake pornografie-crisis en de juridische afrekening die komt verscheen eerst op Technext.

Misschien vind je dit ook leuk

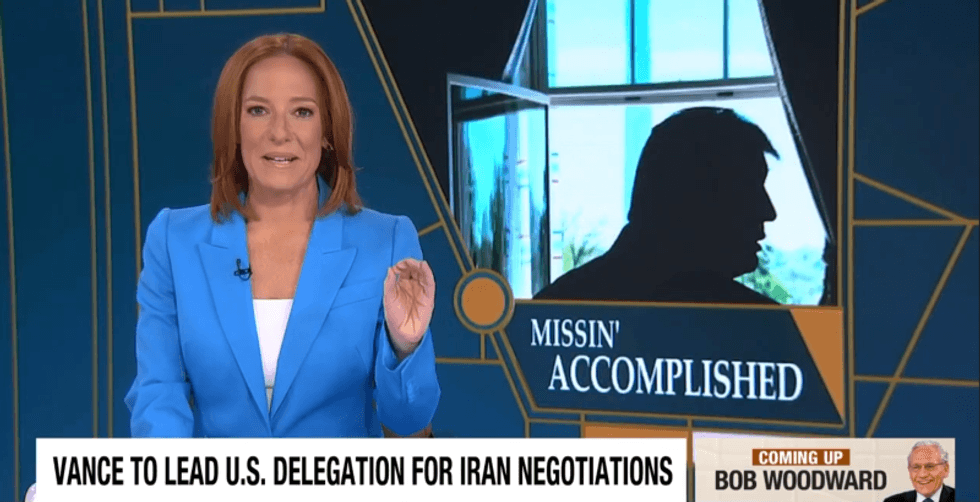

Jen Psaki ongelovig over JD Vance's bizarre vergelijking met Iran: 'Wat ter wereld?'

Waarom is Zcash de best presterende crypto vandaag?