AIUC-1: De Nieuwe Gouden Standaard voor Betrouwbare Enterprise AI

De CX-vertrouwenskloof overbruggen: Verantwoorde AI met AIUC-1

Stel je een CX-directeur voor, Maria, in een gespannen videogesprek met de CEO. "Vorige week heeft onze AI-chatbot een VIP-klant verkeerd geïdentificeerd en per ongeluk de prijslijst van een concurrent gemaild," snauwt de CEO. Gegevens zijn gelekt; het vertrouwen van de klant is vernietigd. In de daaropvolgende chaos geeft IT de schuld aan product, product geeft de schuld aan juridische zaken, en het marketingteam weet niet eens wat er is gebeurd. Maria realiseert zich pijnlijk dat geïsoleerde teams en versnelde AI-implementaties kritieke data- en privacybeschermingen ongedefinieerd lieten – en de reputatie van haar merk nu aan een zijden draad hangt.

Dit scenario is geen fictie. Naarmate AI-chatbots, voice-agents en aanbevelingsmotoren de contactpunten met klanten overspoelen, kunnen fouten en ondoorzichtige datapraktijken vertrouwen in één nacht vernietigen. Ondernemingen staan voor een duidelijk dilemma: AI belooft hyperpersonalisatie en efficiëntie, maar misstappen (gehallucineerde antwoorden, ongeautoriseerd datagebruik, IP-lekken) kunnen de klantervaring onherstelbaar schaden. CX- en EX-leiders hebben een nieuw draaiboek nodig – een gestructureerd raamwerk om AI verantwoord te beheren.

Belangrijkste inzichten:

- Vertrouwen in gevaar: AI-fouten (zoals zelfverzekerde verkeerde antwoorden of datalekken) ondermijnen direct het vertrouwen en de loyaliteit van klanten. Enquêtes tonen aan dat 53% van de consumenten vreest dat hun persoonlijke gegevens misbruikt zullen worden door AI, en bijna de helft zou alleen meer gegevens delen als bedrijven meer transparantie en controle bieden.

- Eerste AI-agentstandaard: AIUC-1 is 's werelds eerste uitgebreide standaard voor AI-agents, ontwikkeld door beveiligings- en AI-experts om problemen op ondernemingsschaal aan te pakken. Het omvat kerndomeinen van risico (Data & Privacy, Beveiliging, Veiligheid, Betrouwbaarheid, Verantwoordelijkheid, Maatschappij) en creëert een gemeenschappelijke "vertrouwensinfrastructuur" voor AI-adoptie.

- Verplichte data-/privacycontroles: AIUC-1 handhaaft strikte data- en privacyvereisten. Het vereist bijvoorbeeld duidelijke beleidslijnen voor invoer-/uitvoergegevens, beperkingen op gegevensverzameling en technische beveiligingen tegen het lekken van persoonsgegevens of bedrijfsgeheimen. Deze beschermingen zijn bedoeld om incidenten zoals dat van Maria's bedrijf te voorkomen.

- Certificering en verzekering: AIUC-1-certificering betekent dat een AI-systeem rigoureuze tests heeft ondergaan (duizenden gesimuleerde fouten in verschillende risicoscenario's). Eerste gebruikers zoals ElevenLabs hebben AIUC-1-certificaten verdiend en zelfs AI-verzekeringen voor hun voice-agents, wat aan klanten en partners signaleert dat hun AI is gekeurd.

- Samenwerking is essentieel: AIUC-1 is gebouwd door leiders van Microsoft, Cisco, JPMorgan Chase, UiPath, ElevenLabs en anderen, wat een consensus weerspiegelt dat AI-veiligheid/-beveiliging multifunctionele actie vereist. Raamwerken zoals Microsoft's Secure Development Lifecycle voor AI benadrukken eveneens dat beveiliging een werkwijze moet zijn, geen vinkje.

- Valkuilen van "AI-washing": Veel leveranciers plakken "AI" op producten zonder echte gegevens of beveiligingen, maar klanten zien hier snel doorheen. Overdreven beweringen (zoals "enterprise-grade AI" zonder gegevensprovenance) leiden tot inconsistente outputs die vertrouwen eroderen en churn veroorzaken. Erger nog, toezichthouders grijpen hard in: de SEC en FTC hebben bedrijven beboet voor misleidende AI-beweringen.

Veelvoorkomende valkuilen: CX-leiders moeten opletten voor…

- AI-washing: Het inzetten van "onbeheerde" AI-bots zonder nieuwe gegevens of modellen. Klanten zien snel geen verbetering, wat de merkgeloofwaardigheid schaadt.

- Gegevensoverschrijding: Het hamsteren van klantgegevens "voor de zekerheid," zonder duidelijke beleidslijnen, leidt tot privacyschendingen. Zoals Qualtrics adviseert: "Stop met alles verzamelen om het te hebben"; verzamel alleen wat je nodig hebt (met toestemming en duidelijk doel) om vertrouwen op te bouwen.

- Geïsoleerd bestuur: AI behandelen als puur een engineeringtool terwijl beveiliging, juridische zaken en CX-input worden genegeerd. Als teams niet samenwerken aan AI-risico's (zoals Microsoft waarschuwt), ontstaan vertrouwenskloven bij contactpunten met klanten.

- Red-teaming overslaan: Generatieve AI-functies lanceren zonder adversarial testing of monitoring. Zonder gelaagde beveiligingen (zoals promptfilters of anomaliedetectie) kunnen AI-outputs persoonsgegevens lekken, hallucineren of IP schenden.

- Standaarden verwaarlozen: Het niet afstemmen op opkomende AI-raamwerken (bijv. AIUC-1, MITRE ATLAS) laat bedrijven onvoorbereid voor audits of verzekeringen. Het resultaat zijn stilgelegde projecten, juridisch risico en verloren klantloyaliteit.

- Ondoorzichtig AI-gebruik: Klanten niet informeren wanneer AI wordt gebruikt of hoe hun gegevens worden gebruikt. Deze "black box"-benadering wordt snel gevoeld als wantrouwen; transparantie is niet onderhandelbaar in het tijdperk van generatieve AI.

Wat is AIUC-1 en waarom is het belangrijk voor CX?

AIUC-1 is het eerste industriestandaardraamwerk specifiek voor AI-agents, dat data/privacy, beveiliging, veiligheid en meer omvat. Het codificeert best practices (en technische controles) zodat ondernemingen AI-risico consistent kunnen meten en beheren. In praktische termen geeft AIUC-1 CX-teams een gemeenschappelijke taal om elke AI-oplossing te beoordelen: "Is deze agent veilig, betrouwbaar en respectvol ten opzichte van klantgegevens?" Door die antwoorden te standaardiseren, bouwt AIUC-1 de vertrouwensinfrastructuur die enterprise AI-adoptie ontgrendelt.

Hoe creëren data- en privacyproblemen een vertrouwenskloof?

Het vertrouwen van klanten wordt vernietigd op het moment dat een AI-agent persoonlijke gegevens misbruikt of vertrouwelijke informatie lekt. Moderne AI-systemen putten uit verspreide gegevens en hebben "probabilistisch geheugen," wat betekent dat ze per ongeluk persoonsgegevens of intellectueel eigendom kunnen onthullen tenzij ze streng worden gecontroleerd. Een AI-bot die onbewust traint op CRM-vermeldingen kan bijvoorbeeld gevoelige klantgegevens openbaar regurgitate. CX-experts waarschuwen dat dergelijke lekken – of zelfs onvoorspelbaar gedrag wanneer AI-modellen updaten – direct de klantervaring ondermijnen. In gereguleerde sectoren nodigt dit ook juridische en compliance-problemen uit.

AIUC-1 bestrijdt deze risico's door duidelijke databeleidslijnen en controles verplicht te stellen. Het dwingt teams te definiëren hoe invoergegevens worden gebruikt en beschermd (A001), welke outputs de AI kan genereren en wie eigenaar is (A002), en om gegevensverzameling te beperken tot wat relevant is voor de taak (A003). Deze stappen zorgen ervoor dat de persoonlijke of bedrijfsgegevens van een klant niet zonder toezicht door de AI worden geconsumeerd of bewaard. Kortom, duidelijk invoer-/uitvoerbeheer en toegangscontroles vormen de eerste verdedigingslinie tegen het mishandelen van klantinformatie.

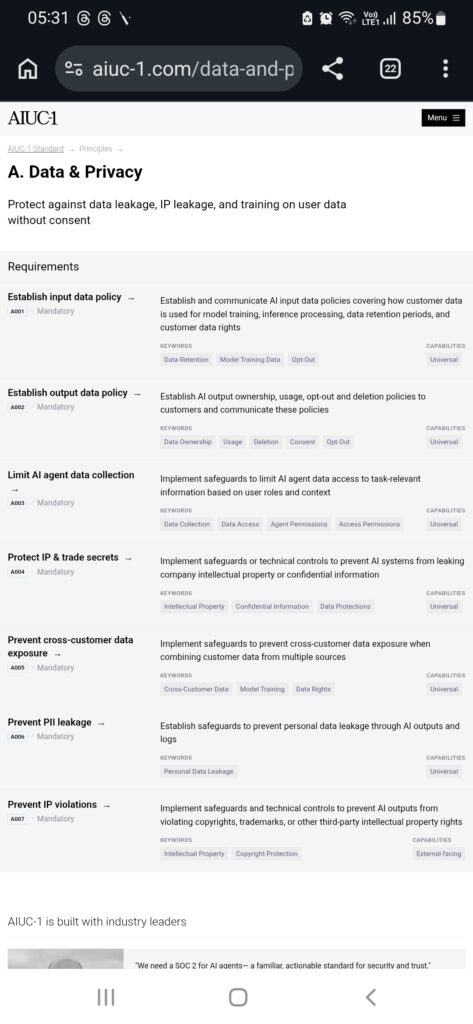

Welke data- en privacycontroles handhaaft AIUC-1?

AIUC-1 somt verschillende verplichte vereisten op om datagebruik in AI-systemen vast te leggen. Belangrijke voorbeelden zijn: het vaststellen van invoergegevensbeleid (hoe en wanneer klantgegevens worden gebruikt voor training of inferentie, en gegevensbehoud/rechten); het formaliseren van uitvoergegevensbeleid (definiëren wie eigenaar is van door AI gegenereerde gegevens, gebruiksrechten, opt-out- en verwijderingsprocessen); en het beperken van AI-gegevensverzameling strikt tot taakrelevante invoer op basis van rollen.

Cruciaal is dat AIUC-1 ook technische beveiligingen verplicht stelt: voorkom dat de AI bedrijfs-IP of bedrijfsgeheimen lekt (A004); blokkeer elke cross-customer datamixing wanneer een AI multi-tenant invoer heeft (A005); stop PII-lekkage via outputs of logs (A006); en zorg ervoor dat AI-outputs geen auteursrechten of handelsmerken van derden schenden (A007). Samen zetten deze controles abstracte privacydoelen om in concrete checks: datasets auditen, logs versleutelen, modellen sandboxen en DPIA-achtige beoordelingen toepassen. Voor CX-leiders is het resultaat meetbaar: beleidslijnen en tools die klanten tonen "onze AI zal uw gegevens of die van anderen niet misbruiken."

Hoe herbouwt AIUC-1-certificering vertrouwen?

Een AIUC-1-certificaat betekent dat een AI-agent meer dan 5.000 adversarial simulaties heeft doorstaan in beveiliging-, privacy- en veiligheidsscenario's. In feite is het een stempel van derden dat "deze AI is getest en veilig." Voor klanten en partners is dat krachtig. ElevenLabs meldt dat het verdienen van AIUC-1 hen in staat stelde om hun AI voice-agents te verzekeren zoals werknemers – dekking biedend voor fouten van hallucinaties tot lekken. Zoals de medeoprichter van AI Underwriting uitlegt: "toonaangevende verzekeraars hebben zoveel vertrouwen in deze op certificering gebaseerde aanpak dat ze AI-specifieke financiële dekking aanbieden aan degenen die het verdienen. ElevenLabs is het eerste bedrijf dat aantoont dat dit model op schaal werkt."

In de praktijk verschuift certificering + verzekering het risico. In plaats van onbekenden te vrezen ("Wat als onze chatbot uit de hand loopt?"), kunnen bedrijven aansprakelijkheid op het raamwerk afwentelen: als de AI nog steeds faalt ondanks AIUC-1-beveiligingen, is het verlies gedekt. Dit verwijdert een enorme psychologische barrière voor het gebruik van AI in kernworkflows. Zoals de medeoprichter van ElevenLabs opmerkt, AIUC-1 (en de verzekering die het ontgrendelt) versnelt enterprise-implementatie door partners "het beveiligingsraamwerk en AI-verzekeringsdekking te geven die ze nodig hebben". Voor CX-/EX-leiders betekent dit dat meer pilotprojecten naar productie gaan en een sterker verkoopargument bij het opbouwen van klantvertrouwen.

Hoe kunnen CX-/EX-leiders zich voorbereiden op verantwoorde AI?

Begin met bestuur en beleidslijnen, niet alleen technologie. Definieer nu uw datagebruiksregels: beslis welke klantgegevens AI-modellen zullen voeden, hoe lang het wordt opgeslagen en hoe gebruikers zich kunnen afmelden. Betrek vroeg multifunctionele teams – juridisch, beveiliging, datawetenschap en product – in navolging van de Microsoft SDL-benadering die beveiliging als een samenwerkend ontwerpprincipe behandelt. Vervolgens, eis transparantie zowel intern als voor klanten. Volg bijvoorbeeld Microsoft's voorbeeld door duidelijk bekend te maken wanneer een gebruiker met AI interacteert en hen controle over hun gegevens te geven.

Adopteer standaarden zoals AIUC-1 als een leidraad. Gebruik de data-/privacychecklist om AI-leveranciers en interne projecten te auditen: beperken we gegevensverzameling? versleutelen we logs? voorkomen we PII-inferentie? Zo niet, investeer dan nu in die controles. Schakel vroeg een geaccrediteerde auditor in om uw AI-assets te scopen – het AIUC-1-consortium biedt begeleiding over waar elke controle van toepassing is. Overweeg certificering te piloten voor belangrijke AI-agents; bijvoorbeeld voice- of salesbots komen vaak eerst aan bod in CX-transformaties. Zoals het voorbeeld van ElevenLabs laat zien, kan het integreren van ingebouwde beveiligingen certificering versnellen: een van hun klanten certificeerde een 24/7 vastgoedonderzoek voice-bot in slechts vier weken.

Ten slotte, meet en itereer op basis van klantfeedback. Monitor AI-gedreven interacties nauwlettend: haken klanten af of uiten ze klachten na een AI-contactpunt? Gebruik CX-metrieken om problemen te vangen die de AI-tests mogelijk missen. En onthoud, vertrouwen wordt in de loop van de tijd verdiend – zoals een Qualtrics-expert het verwoordt, komt echte AI-waarde voort uit "het opbouwen van verbindingen en het verbeteren van de menselijke ervaring, waarbij capabele AI-agents eenvoudige taken beheren en menselijke agents assisteren bij complexe problemen". Houd mensen in de loop waar het het meest van belang is, en laat AI de rest afhandelen binnen uw nieuwe bestuursbeveiliging.

Veelgestelde vragen

Wat is AIUC-1 precies?

AIUC-1 is een nieuwe industriestandaard en certificeringsraamwerk voor AI-"agents" (softwarebots en assistenten) dat alle belangrijke risico-categorieën omvat. Het is gecreëerd door experts van bedrijven als Microsoft, Cisco, JPMorgan Chase, UiPath en ElevenLabs om ondernemingen een duidelijk raamwerk (zoals een "SOC 2" voor AI) te bieden bij het evalueren van AI-systemen. Door aan AIUC-1-vereisten te voldoen, toont een AI-product aan dat het is getest op beveiliging, gegevensprivacy, betrouwbaarheid en andere zorgen.

Welke data- en privacyproblemen pakt AIUC-1 aan?

De standaard verplicht specifieke controles op datagebruik: het vaststellen van schriftelijke beleidslijnen voor AI-invoer- en uitvoergegevens (inclusief training, retentie, verwijdering en klant-opt-out); het beperken van AI van toegang tot irrelevante of overmatige gegevens; en het toevoegen van beveiligingen tegen het lekken van persoonlijke gegevens, IP of het mixen van gegevens van verschillende klanten. Kortom, het dwingt organisaties te bepalen hoe klantgegevens door hun AI stromen, waardoor privacyschendingen die vertrouwen vernietigen worden voorkomen.

Hoe herbouwt AIUC-1-certificering klantvertrouwen?

AIUC-1-gecertificeerd (en verzekerd) worden signaleert aan klanten dat het AI-systeem rigoureuze tests tegen bekende faalmodi heeft doorstaan. Het is alsof je een veiligheidsinspectierrapport voor je AI toont. Ondernemingen kunnen dan eerlijk tegen klanten zeggen: "Onze AI heeft verifieerbare beveiligingen en zelfs verzekeringsdekking." Vroege gebruikers melden dat deze geloofwaardigheid contracten en implementatie versnelt. In de praktijk betekent certificering minder merkgerelateerde missers – en als er ondanks certificering een incident optreedt, kan verzekering de gevolgen dekken. Deze verantwoordelijkheidslus is wat AI verandert van een onbekende gok in een beheerde dienst in de ogen van zakelijke leiders en klanten.

Wat gebeurt er als we deze standaarden overslaan?

AI-governance negeren opent de vertrouwenssluizen. Zonder duidelijke beleidslijnen of tests kunnen AI-agents gegevens lekken, auteursrechten schenden of gevaarlijk slecht advies geven. Klanten zullen het merken – bijvoorbeeld bots die inconsistente of misleidende antwoorden geven zullen loyaliteit eroderen. Toezichthouders en de industrie verscherpen ook het toezicht. Bedrijven die "AI-washen" (doen alsof ze AI gebruiken zonder de juiste controles) lopen juridische risico's: de SEC en FTC hebben al bedrijven gesanctioneerd voor misleidende AI-claims. Kortom, standaarden overslaan betekent merkschade, compliance-boetes en verloren klanten riskeren.

Hoe kunnen CX-leiders beginnen met het adopteren van AIUC-1-praktijken?

Begin met het inventariseren van uw AI-tools en gegevensstromen: classificeer welke systemen klantgegevens verwerken of met klanten interacteren, en vergelijk met de AIUC-1-controleschecklist. Ontwikkel of update uw AI-gegevensprivacybeleid (met betrekking tot invoer, uitvoer, retentie en klantrechten). Werk samen met uw beveiligings- en juridische teams om de benodigde technische controles te implementeren (bijv. dataminimalisatie, versleuteling, monitoring). Schakel vroeg een geaccrediteerde AIUC-1-auditor in om certificering te scopen. Zelfs als volledige certificering een langetermijndoel is, gebruik dan de vereisten van de standaard als een gapanalyse om uw AI-systemen nu te versterken. Ten slotte, blijf communiceren met stakeholders (en klanten) terwijl u verbetert: transparantie over deze inspanningen zal zelf helpen het vertrouwen in uw AI-initiatieven te herbouwen.

Actiegerichte aandachtspunten:

- Definieer duidelijke databeleidslijnen: Schrijf op hoe AI klantgegevens zal gebruiken voor training vs. inferentie, stel retentielimieten in en bied opt-out-/verwijderingsrechten.

- Adopteer AIUC-1 als raamwerk: Gebruik de principes om beveiliging, privacy en veiligheidscontroles over alle AI-projecten te verenigen. Overweeg certificering te piloten voor AI-agents met hoog risico.

- Werk samen tussen teams: Doorbreek silo's door IT, juridisch, compliance en CX te betrekken bij AI-implementatiebeslissingen. Behandel AI-risicobeheer als een gedeelde missie.

- Integreer security by design: Test AI-agents voor lancering stresstest (red-teaming, prompt-injecties) en implementeer runtime-beveiligingen (modulatie, anomaliewaarschuwingen) om lekken of wangedrag te voorkomen.

- Maak gebruik van AI-verzekering: Zoek AI-leveranciers met AIUC-1-certificering of verzekeringsbacking. Dit stemt prikkels af en biedt financiële bescherming als de AI fouten maakt.

- Wees transparant naar gebruikers: Informeer klanten wanneer AI wordt gebruikt en laat hen weten hoe hun gegevens worden verwerkt, in navolging van Microsoft's Copilot-praktijk van real-time openbaarmakingen.

- Verzamel alleen benodigde gegevens: Geef kwaliteit de voorkeur boven kwantiteit. Naarmate gebruikers privacy eisen, verzamel alleen de informatie die nodig is voor service en leg duidelijk uit hoe het hun ervaring verbetert.

- Train en monitor personeel: Zorg ervoor dat klantgerichte teams AI-beperkingen begrijpen en duidelijke escalatiepaden hebben. Volg CX-metrieken na AI-implementatie om problemen (zoals trage respons of ontevredenheid) vroeg op te vangen.

Door AI-risico's frontaal aan te pakken en raamwerken zoals AIUC-1 te adopteren, kunnen CX- en EX-leiders de vertrouwenskloof dichten. In een landschap van gefragmenteerde reizen en snelle AI-evolutie is dit hoe bedrijven overgaan van voorzichtig experimenteren naar zelfverzekerde, klantgerichte AI-implementatie.

De post AIUC-1: The New Gold Standard for Trustworthy Enterprise AI verscheen eerst op CX Quest.

Misschien vind je dit ook leuk

Handelsdruk neemt af voor Chainlink naarmate stabiliteit zich voordoet

Onderhandelingen intensiveren terwijl Amerikaanse en Iraanse teams botsen over belangrijk 'struikelblok'