Forças Armadas dos EUA usaram Anthropic para ataque ao Irão apesar da proibição de Trump: WSJ

Os militares dos EUA terão recorrido ao Claude AI da Anthropic durante um grande ataque aéreo no Irão, um desenvolvimento que surgiu poucas horas depois de o Presidente Donald Trump ter ordenado às agências federais que interrompessem o uso do modelo. Os comandos na região, incluindo o CENTCOM, terão usado o Claude para apoiar a análise de inteligência, verificação de alvos e simulações de campo de batalha. O episódio destaca o quão profundamente as ferramentas de IA foram integradas nas operações de defesa, mesmo enquanto os decisores políticos pressionam para cortar laços com determinados fornecedores. O episódio sublinha uma tensão entre diretivas executivas e a automação no terreno que pode influenciar a aquisição e o gerenciamento de risco automatizado em todos os programas de defesa.

Principais conclusões

- <li O Claude AI terá sido implementado para análise de inteligência, verificação de alvos e simulações de campo de batalha em conexão com um grande ataque aéreo, horas depois de uma diretiva da Casa Branca para pausar o uso do sistema.

-

<li A Anthropic havia anteriormente garantido um contrato plurianual com o Pentágono no valor de até 200 milhões de dólares, com colaborações envolvendo a Palantir e a Amazon Web Services para permitir fluxos de trabalho classificados para o Claude.

-

<li A administração Trump instruiu as agências a pararem de trabalhar com a Anthropic e ordenou ao Departamento de Defesa que tratasse a empresa como um potencial risco de segurança após as negociações contratuais terem fracassado devido ao uso militar irrestrito.

-

<li O Pentágono começou a identificar fornecedores de substituição e moveu-se para implementar outros modelos de IA em redes classificadas, incluindo uma colaboração com a OpenAI para tais implementações.

-

<li O CEO da Anthropic, Dario Amodei, rejeitou publicamente a proibição, argumentando que certas aplicações militares cruzam limites éticos e devem permanecer sob supervisão humana em vez de vigilância massiva automatizada ou armamento autónomo.

Sentimento: Neutro

Contexto de mercado: O episódio situa-se na intersecção entre aquisições de defesa, ética de IA e gerenciamento de risco automatizado de segurança nacional, à medida que as agências reavaliam as dependências de fornecedores e a classificação de ferramentas de IA para operações sensíveis.

Porque é importante

O incidente oferece uma visão rara de como os modelos comerciais de IA são integrados em fluxos de trabalho militares de alto risco. O Claude, originalmente concebido para tarefas cognitivas amplas, terá apoiado a análise de inteligência e a modelação de cenários de campo de batalha, sugerindo um nível de confiança operacional que se estende para além dos ambientes de laboratório para missões do mundo real. Isto levanta questões importantes sobre a fiabilidade, auditoria e controlabilidade da IA no planeamento de combate, especialmente quando os sinais de política governamental mudam rapidamente em torno do uso de fornecedores.

Ao nível da política, o atrito entre uma relação contratual e uma diretiva presidencial destaca um debate mais amplo sobre como os fornecedores de IA devem ser tratados em ambientes seguros. A recusa da Anthropic em conceder uso militar irrestrito alinha-se com os seus limites éticos declarados, sinalizando que os fornecedores do setor privado podem cada vez mais resistir a configurações que considerem eticamente problemáticas. A resposta do Pentágono — recorrer a fornecedores alternativos para cargas de trabalho classificadas — ilustra como os departamentos de defesa podem diversificar ecossistemas de IA para reduzir a exposição ao risco, mantendo capacidade em operações sensíveis.

A tensão também toca na dinâmica competitiva do mercado de IA como serviço. Com a OpenAI supostamente a intervir para fornecer modelos para redes classificadas, o setor está provavelmente a testemunhar experimentação contínua e renegociação de termos em torno de classificações de segurança, governança de dados e risco da cadeia de fornecimento. A situação sublinha a necessidade de estruturas de governança rigorosas que possam adaptar-se a mudanças tecnológicas rápidas sem comprometer a segurança operacional ou padrões éticos.

O que observar a seguir

- Atualizações regulatórias e de políticas do Departamento de Defesa e da Casa Branca relativamente ao uso de fornecedores de IA e classificações de segurança.

- Quaisquer novas aquisições ou parcerias que ampliem as capacidades de IA para missões classificadas, incluindo potenciais acordos com fornecedores alternativos para substituir ou complementar as ofertas da Anthropic.

- Declarações públicas da Anthropic e OpenAI sobre a natureza das implementações em redes protegidas e quaisquer novas restrições ou proteções.

- Mais detalhes sobre o resultado das negociações anteriores de uso irrestrito e como isso moldará futuros contratos de defesa com fornecedores de IA.

Fontes e verificação

- Relatórios sobre o uso do Claude numa operação no Médio Oriente e a ordem de interrupção da administração, incluindo evidências discutidas com fontes familiarizadas com o assunto.

- Contexto sobre o contrato da Anthropic com o Pentágono, incluindo o acordo plurianual no valor de até 200 milhões de dólares e parcerias com a Palantir e AWS para fluxos de trabalho classificados.

- Declarações da liderança da Anthropic e comentários públicos sobre uso militar e limites éticos, incluindo entrevistas e respostas oficiais a ações regulatórias.

- Implementação da OpenAI em redes classificadas e discussões relacionadas, incluindo discurso público em torno de um acordo com os militares dos EUA e cobertura associada.

- Discussões públicas e referências em redes sociais conectadas ao acordo da OpenAI com os militares, como publicações documentando reações da indústria.

Claude da Anthropic na mira: IA, ética e política colidem em operações de defesa

Funcionários descreveram o Claude como desempenhando um papel na análise de inteligência e planeamento operacional durante um grande ataque aéreo no Irão, uma alegação que ilustra o quão perto as ferramentas de IA se aproximaram da tomada de decisões no campo de batalha. Enquanto a administração Trump se moveu para cortar laços com a Anthropic, o uso operacional do Claude terá persistido em certos comandos, sublinhando uma desconexão entre declarações de política e fluxos de trabalho de defesa do dia a dia. A realidade prática é que análises, simulações e avaliações de risco impulsionadas por IA podem infiltrar-se no planeamento de missões, mesmo enquanto as agências reavaliam o risco de fornecedores e requisitos de conformidade entre departamentos.

O envolvimento anterior do Pentágono com a Anthropic foi substancial: um contrato plurianual avaliado em até 200 milhões de dólares e uma rede de parcerias, incluindo a Palantir e a Amazon Web Services, que permitiram o uso do Claude no tratamento de informações classificadas e processamento de inteligência. O acordo destacou uma estratégia mais ampla: diversificar as capacidades de IA através de um ecossistema de confiança para garantir resiliência em ambientes sensíveis. No entanto, quando as direções de política mudaram, a administração moveu-se para reenquadrar a relação com o fornecedor, sinalizando uma recalibração baseada em risco em vez de um recuo total das operações de defesa habilitadas por IA.

Nos bastidores, as tensões entre política pública e ética do setor privado vieram à tona. O Secretário de Defesa Pete Hegseth terá pressionado a Anthropic para permitir uso militar irrestrito dos seus modelos, um pedido que a liderança da Anthropic rejeitou como cruzando linhas éticas que a empresa não cruzaria. A posição da empresa centra-se na crença de que certos usos — vigilância doméstica massiva e armas totalmente autónomas — levantam profundas preocupações éticas e legais, e que uma supervisão humana significativa deve sobreviver à transição do conceito à execução. Esta posição alinha-se com debates em curso sobre como equilibrar a adoção rápida de IA com salvaguardas contra abusos e consequências não intencionais.

Por seu lado, o Pentágono não ficou parado. Enfrentando uma potencial lacuna de fornecedores, começou a alinhar substitutos e terá chegado a um acordo com a OpenAI para implementar modelos em redes classificadas. A mudança sublinha um movimento estratégico mais amplo para garantir continuidade de capacidade, mesmo enquanto os fornecedores reavaliam os seus termos para implementações sensíveis. O contraste entre os limites éticos da Anthropic e as necessidades operacionais do departamento revela uma tensão política mais ampla: como aproveitar tecnologia transformadora de forma responsável, preservando imperativos de segurança nacional.

Observadores da indústria também notaram os efeitos no ecossistema de tais transições. O mercado de IA está a evoluir para configurações mais modulares e com autorização de segurança que podem ser trocadas ou atualizadas à medida que as avaliações de política e risco mudam. O acordo da OpenAI, em particular, sinaliza apetite contínuo para integrar modelos líderes em redes de defesa, embora sob governança e supervisão rigorosas. Embora esta trajetória prometa capacidade melhorada para analistas e planeadores militares, também eleva o escrutínio em torno do tratamento de dados, interpretabilidade do modelo e o risco de dependência excessiva de sistemas automatizados para decisões críticas.

O CEO da Anthropic, Dario Amodei, argumentou que, embora a IA possa aumentar o julgamento humano, não pode substituí-lo em decisões de defesa centrais. Em declarações públicas, reafirmou o compromisso da empresa com limites éticos e com a manutenção do controlo humano em momentos cruciais. A tensão entre manter acesso a ferramentas de ponta e defender padrões éticos provavelmente moldará futuras negociações com agências federais, particularmente à medida que legisladores e reguladores examinam o papel da IA em contextos civis e de segurança nacional.

À medida que o panorama evolui, as comunidades cripto e tecnológica mais amplas estarão a observar como estas dinâmicas de política e aquisição influenciam o desenvolvimento e implementação de sistemas avançados de IA em ambientes de alto risco. O episódio serve como um estudo de caso sobre como equilibrar o avanço tecnológico rápido com governança, supervisão e a questão duradoura de onde termina a responsabilidade humana e começa a tomada de decisões automatizada.

Este artigo foi originalmente publicado como US military used Anthropic for Iran strike despite Trump's ban: WSJ em Crypto Breaking News – a sua fonte de confiança para notícias cripto, notícias Bitcoin e atualizações blockchain.

Você também pode gostar

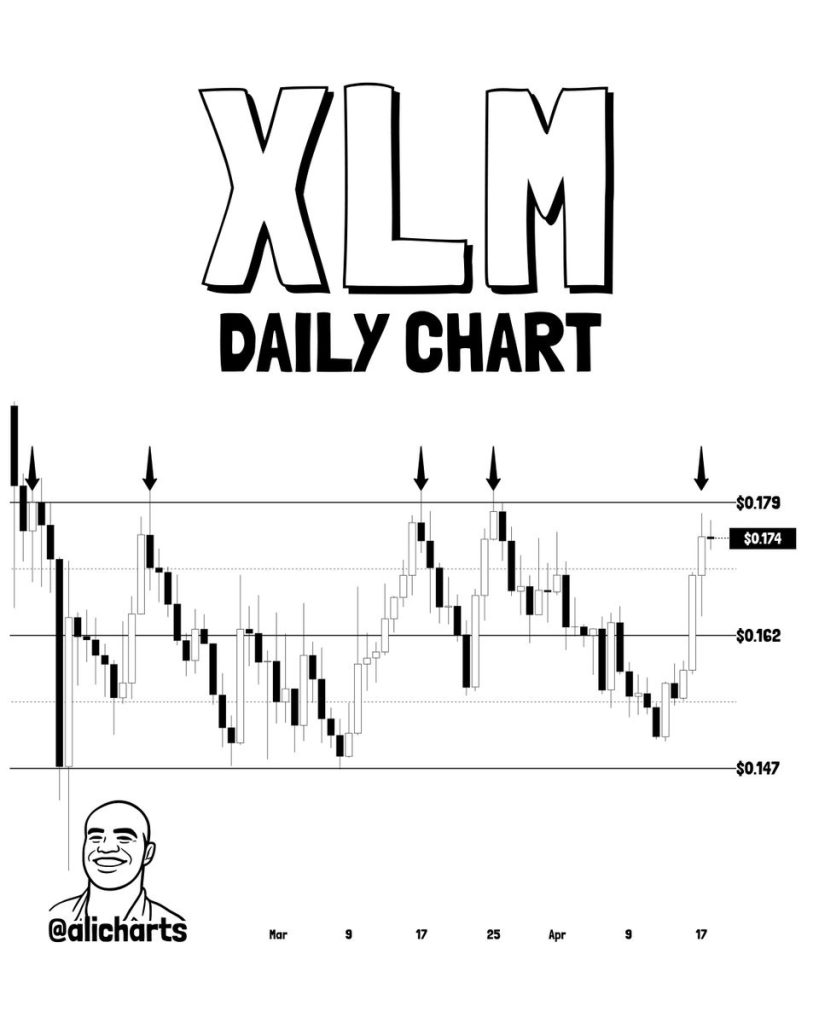

O Preço da Stellar (XLM) Continua a Atingir a Mesma Barreira, mas Este Quarto Reteste Poderá Ser o Que a Rompe

Stablecoins não são uma ameaça para os bancos no curto prazo: analista da Moody's