Acordo entre OpenAI e Pentágono Revela Salvaguardas Cruciais Contra Armas Autónomas e Vigilância

BitcoinWorld

Acordo OpenAI Pentágono Revela Salvaguardas Cruciais Contra Armas Autónomas e Vigilância

Num desenvolvimento significativo para a governança da inteligência artificial, a OpenAI publicou documentação detalhada sobre o seu controverso acordo com o Departamento de Defesa dos EUA, delineando salvaguardas específicas contra sistemas de armas autónomos e aplicações de vigilância em massa. O acordo OpenAI Pentágono surge em meio a um escrutínio intensificado do envolvimento de empresas de IA em operações de segurança nacional, particularmente após o colapso das negociações da Anthropic com agências de defesa na semana passada. Esta divulgação representa um momento crucial no debate em curso sobre limites éticos para sistemas avançados de IA em contextos militares e de inteligência.

Estrutura do Acordo OpenAI Pentágono e Salvaguardas Essenciais

O quadro publicado pela OpenAI revela uma abordagem multicamadas para garantir a implantação responsável da sua tecnologia em ambientes de defesa classificados. A empresa proíbe explicitamente três aplicações específicas: programas de vigilância doméstica em massa, sistemas de armas totalmente autónomos e decisões automatizadas de alto risco como mecanismos de pontuação de crédito social. Estas restrições formam a base do que o CEO Sam Altman descreve como "linhas vermelhas" que a empresa não cruzará em parcerias de defesa.

Ao contrário de alguns concorrentes que dependem principalmente de políticas de utilização, a OpenAI enfatiza proteções técnicas e contratuais. A empresa mantém controlo total sobre a sua pilha de segurança e implementa exclusivamente através de acesso à API de nuvem em vez de fornecer acesso direto ao modelo. Esta decisão arquitetónica impede a integração da tecnologia da OpenAI diretamente em hardware de armas ou sistemas de vigilância. Adicionalmente, o pessoal autorizado da OpenAI permanece envolvido na supervisão de implementação, criando salvaguardas com humano no circuito.

Proteções Contratuais e Análise do Quadro Legal

O acordo incorpora fortes proteções contratuais juntamente com os quadros legais dos EUA existentes que regem a tecnologia de defesa. De acordo com a documentação da OpenAI, estas camadas trabalham juntas para criar limites aplicáveis em torno das aplicações de IA. A empresa referencia especificamente a conformidade com a Ordem Executiva 12333 e outros estatutos relevantes, embora esta referência tenha gerado debate entre defensores da privacidade sobre potenciais implicações de vigilância.

A chefe de parcerias de segurança nacional da OpenAI, Katrina Mulligan, argumenta que focar-se apenas na linguagem contratual não compreende como a segurança da IA opera na prática. "A arquitetura de implementação importa mais do que a linguagem contratual", afirmou Mulligan numa publicação no LinkedIn. "Ao limitar a nossa implementação à API de nuvem, podemos garantir que os nossos modelos não podem ser integrados diretamente em sistemas de armas, sensores ou outro hardware operacional." Esta limitação técnica representa uma distinção crucial das abordagens tradicionais de contratação de defesa.

Análise Comparativa: Por Que a OpenAI Teve Sucesso Onde a Anthropic Falhou

Os resultados divergentes entre as negociações de defesa da OpenAI e da Anthropic destacam diferenças importantes na abordagem e timing. A Anthropic alegadamente traçou "linhas vermelhas" semelhantes em torno de armas autónomas e vigilância, mas não conseguiu chegar a acordo com o Pentágono. A negociação bem-sucedida da OpenAI sugere arquiteturas técnicas diferentes, termos contratuais diferentes ou timing diferente no processo de negociação.

Analistas da indústria notam vários fatores potenciais no sucesso da OpenAI. A empresa pode ter oferecido opções de implementação mais flexíveis enquanto mantinha salvaguardas essenciais. Alternativamente, as relações governamentais estabelecidas da OpenAI através de contratos anteriores não relacionados com defesa podem ter facilitado negociações mais suaves. O timing também se provou significativo, com a OpenAI entrando em negociações imediatamente após o colapso da Anthropic, potencialmente beneficiando-se da urgência do Pentágono em garantir capacidades de IA.

| Empresa | Salvaguardas Essenciais | Método de Implementação | Estado do Contrato |

|---|---|---|---|

| OpenAI | Três proibições explícitas, proteção multicamadas | Apenas API de nuvem, supervisão humana | Acordo alcançado |

| Anthropic | Linhas vermelhas similares, restrições baseadas em políticas | Não divulgado (negociações falharam) | Sem acordo |

Reações da Indústria e Implicações Éticas

O anúncio gerou discussão significativa dentro da comunidade de ética de IA. Alguns especialistas elogiam a transparência da OpenAI e as salvaguardas técnicas como passos significativos em direção à implantação responsável de IA. Outros expressam preocupação sobre quaisquer aplicações militares de sistemas avançados de IA, independentemente de salvaguardas. O debate reflete tensões mais amplas entre necessidades de segurança nacional e princípios de desenvolvimento ético de IA.

Notavelmente, Mike Masnick do Techdirt levantou questões sobre potenciais implicações de vigilância, sugerindo que a conformidade com a Ordem Executiva 12333 pode permitir certas formas de recolha de dados. No entanto, a OpenAI mantém que as suas limitações arquitetónicas impedem vigilância doméstica em massa independentemente dos quadros legais. Este debate técnico versus legal destaca a complexidade de regular aplicações de IA em contextos de segurança nacional.

O impacto do acordo estende-se para além das aplicações de defesa imediatas. Estabelece precedentes para como as empresas de IA podem envolver-se com agências governamentais enquanto mantêm limites éticos. Outros laboratórios agora enfrentam decisões sobre se devem perseguir acordos semelhantes ou manter separação completa de aplicações de defesa. A OpenAI declarou explicitamente que espera que mais empresas considerem abordagens semelhantes, sugerindo que pode surgir um potencial padrão da indústria.

Cronologia de Eventos e Impacto no Mercado

A rápida sequência de eventos demonstra a natureza dinâmica da contratação de defesa de IA. Na sexta-feira, as negociações entre a Anthropic e o Pentágono colapsaram. O Presidente Trump subsequentemente direcionou agências federais a eliminar gradualmente a tecnologia Anthropic ao longo de seis meses enquanto designava a empresa um risco de cadeia de fornecimento. A OpenAI anunciou o seu acordo pouco depois, criando reações imediatas no mercado.

Os dados de mercado mostram impactos mensuráveis destes desenvolvimentos. O Claude da Anthropic ultrapassou brevemente o ChatGPT da OpenAI nas classificações da App Store da Apple após a controvérsia, sugerindo sensibilidade do consumidor às parcerias de defesa. No entanto, ambas as empresas mantêm fortes posições de mercado no geral. O episódio ilustra como as decisões de contratação governamental podem influenciar os mercados comerciais de IA, criando relações complexas entre o desenvolvimento de IA do setor público e privado.

Arquitetura Técnica e Implementação de Segurança

A abordagem da OpenAI enfatiza controlos técnicos sobre declarações de política. O modelo de implementação de API de nuvem representa uma decisão arquitetónica crucial com várias implicações de segurança:

- Supervisão contínua: A OpenAI mantém visibilidade operacional sobre como os seus modelos estão a ser usados

- Capacidade de atualização: A empresa pode modificar ou restringir funcionalidade conforme necessário

- Prevenção de integração: A integração direta de hardware torna-se tecnicamente impossível

- Monitorização de utilização: A deteção de padrões pode identificar tentativas potenciais de uso indevido

Esta arquitetura contrasta com modelos tradicionais de licenciamento de software onde os clientes recebem acesso completo ao código. Ao reter controlo sobre o ambiente operacional, a OpenAI cria limitações inerentes sobre como a sua tecnologia pode ser aplicada. Estas salvaguardas técnicas complementam proteções contratuais e políticas, criando o que a empresa descreve como uma "abordagem multicamadas mais expansiva" do que os sistemas principalmente baseados em políticas dos concorrentes.

Conclusão

O acordo OpenAI Pentágono representa um marco significativo na maturação dos quadros de governança de IA para aplicações de segurança nacional. Ao publicar salvaguardas detalhadas e limitações técnicas, a OpenAI estabeleceu um modelo potencialmente influente para implementação responsável de IA em contextos sensíveis. A abordagem multicamadas do acordo—combinando arquitetura técnica, proteções contratuais e proibições políticas—aborda preocupações éticas enquanto permite aplicações de defesa limitadas. À medida que a tecnologia de IA continua avançando, este acordo OpenAI Pentágono pode servir como ponto de referência para equilibrar inovação, segurança e responsabilidade ética num panorama tecnológico cada vez mais complexo.

Perguntas Frequentes

P1: Que aplicações específicas a OpenAI proíbe no seu acordo com o Pentágono?

A OpenAI proíbe explicitamente três aplicações: programas de vigilância doméstica em massa, sistemas de armas totalmente autónomos e decisões automatizadas de alto risco como sistemas de pontuação de crédito social. Estas proibições formam os limites éticos essenciais do acordo.

P2: Como a abordagem da OpenAI difere dos contratos de defesa de outras empresas de IA?

A OpenAI enfatiza salvaguardas técnicas e arquitetónicas em vez de depender principalmente de políticas de utilização. A empresa implementa exclusivamente através de acesso à API de nuvem com supervisão humana, prevenindo integração direta em hardware de armas e mantendo controlo operacional contínuo.

P3: Por que a Anthropic falhou em chegar a acordo com o Pentágono enquanto a OpenAI teve sucesso?

As razões exatas permanecem não divulgadas, mas fatores prováveis incluem diferentes opções de implementação técnica, diferentes termos contratuais, diferentes timings nas negociações e potencialmente diferentes interpretações de salvaguardas aceitáveis. A OpenAI entrou em negociações imediatamente após o colapso da Anthropic, o que pode ter criado um timing vantajoso.

P4: Quais são as principais críticas ao acordo do Pentágono da OpenAI?

Os críticos levantam preocupações sobre potenciais implicações de vigilância através da conformidade com a Ordem Executiva 12333, o precedente de aplicações militares de IA em geral, e questões sobre se as salvaguardas técnicas podem ser contornadas. Alguns especialistas argumentam que qualquer uso militar de IA cria riscos inaceitáveis independentemente de salvaguardas.

P5: Como este acordo afeta a indústria de IA mais ampla?

O acordo estabelece potenciais precedentes para o envolvimento de empresas de IA com agências governamentais. Pode influenciar como outros laboratórios abordam contratos de defesa e poderia contribuir para padrões emergentes da indústria para implementação responsável de IA em aplicações sensíveis.

Esta publicação Acordo OpenAI Pentágono Revela Salvaguardas Cruciais Contra Armas Autónomas e Vigilância apareceu primeiro em BitcoinWorld.

Você também pode gostar

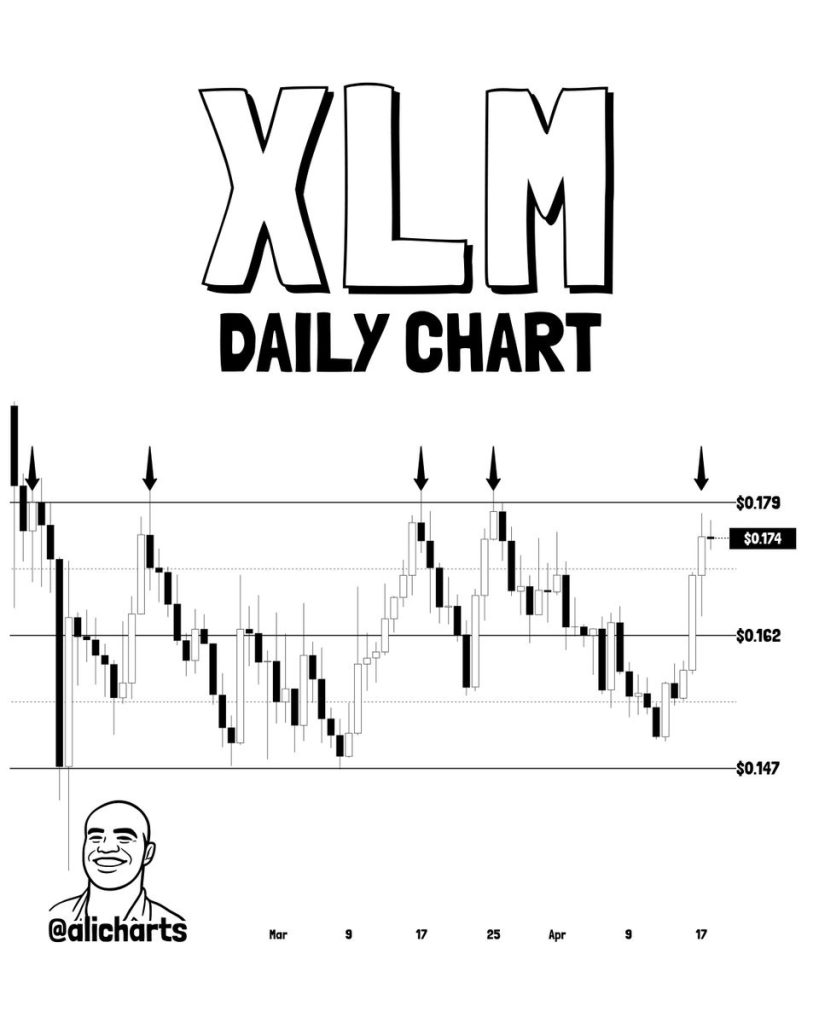

O Preço da Stellar (XLM) Continua a Atingir a Mesma Barreira, mas Este Quarto Reteste Poderá Ser o Que a Rompe

Stablecoins não são uma ameaça para os bancos no curto prazo: analista da Moody's