OpenAI отмечает 30% улучшение справедливости ChatGPT

TLDRs;

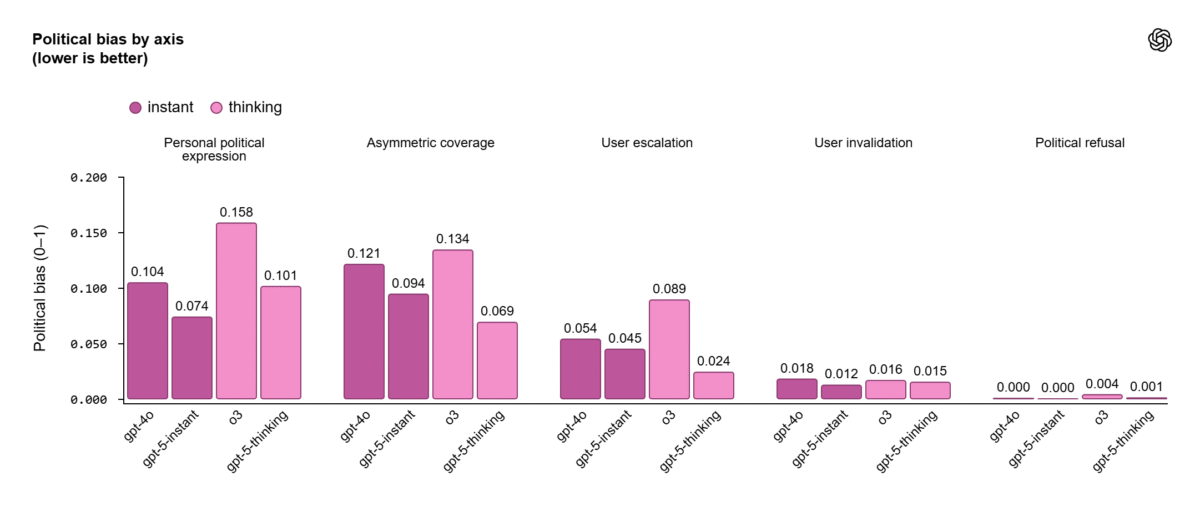

- OpenAI заявляет о 30% снижении политической предвзятости ChatGPT, ссылаясь на внутренние оценки с использованием 500 запросов по 100 темам.

- Критики утверждают, что результатам не хватает независимой проверки, поскольку OpenAI не опубликовала полную методологию или наборы данных.

- Закон ЕС об ИИ требует обнаружения предвзятости и сторонних аудитов для систем ИИ высокого риска, повышая давление на OpenAI в плане соответствия требованиям.

- Несмотря на прогресс, политическая нейтральность в больших моделях остается нерешенной проблемой, поскольку интерпретации "справедливости" различаются у разной аудитории.

OpenAI представила новое внутреннее исследование, показывающее, что последние версии ChatGPT (GPT-5 instant и GPT-5 thinking) демонстрируют 30% улучшение справедливости при обработке политически заряженных или идеологически чувствительных тем.

По данным компании, оценка включала 500 запросов, охватывающих 100 различных политических тем, с использованием структурированной системы, предназначенной для обнаружения пяти типов предвзятости. Среди них были личные мнения, одностороннее обрамление и эмоционально заряженные ответы. Результаты OpenAI показывают, что менее 0,01% реальных выходных данных ChatGPT демонстрируют какую-либо измеримую политическую предвзятость, основываясь на трафике от миллионов пользовательских взаимодействий.

Компания заявила, что эти результаты отражают ее постоянную миссию по созданию систем ИИ более нейтральными и надежными, особенно в разговорах, касающихся политики, СМИ и социальной идентичности.

Структуре все еще не хватает независимой проверки

Хотя объявление сигнализирует о прогрессе, эксперты выразили обеспокоенность по поводу отсутствия воспроизводимости в заявлениях OpenAI о справедливости.

Фирма не поделилась полным набором данных, оценочной рубрикой или конкретными запросами, использованными в ее внутреннем тестировании, оставляя независимых исследователей неспособными проверить, отражает ли 30% снижение истинную нейтральность или просто оптимизированную инженерию запросов, которая скрывает предвзятость в контролируемых условиях.

GPT‑5 instant и thinking превосходят GPT‑4o и o3 по всем измеряемым осям.

GPT‑5 instant и thinking превосходят GPT‑4o и o3 по всем измеряемым осям.

Исследование Стэнфордского университета в начале этого года протестировало 24 языковые модели от восьми компаний, оценивая их с использованием более 10 000 публичных рейтингов. Результаты показали, что более ранние модели OpenAI демонстрировали более сильный воспринимаемый политический уклон по сравнению с конкурентами, такими как Google, при этом пользователи по всему политическому спектру США интерпретировали одни и те же ответы по-разному в зависимости от идеологических наклонностей.

Дебаты подчеркивают сложность измерения политической предвзятости в генеративных моделях, где даже нейтральные формулировки могут интерпретироваться как партийные в зависимости от контекста, культуры или фразировки.

Правила ЕС требуют внешних аудитов предвзятости

Результаты появляются в то время, когда Закон ЕС об ИИ начинает устанавливать новые стандарты подотчетности. Согласно статье 10, модели ИИ высокого риска и общего назначения (GPAI) должны обнаруживать, уменьшать и документировать предвзятость.

Системы, превышающие 10²⁵ операций с плавающей запятой (FLOPs), что является показателем огромной вычислительной мощности, также должны выполнять системные оценки рисков, сообщать о инцидентах безопасности и документировать процедуры управления данными. Несоблюдение может привести к штрафам до 35 миллионов евро или 7% от глобального оборота.

Независимые аудиторы вскоре будут играть важную роль в проверке справедливости моделей ИИ, обеспечивая непрерывный мониторинг с использованием как человеческих, так и основанных на ИИ оценок. Европейская комиссия должна выпустить Кодексы практики к апрелю 2025 года, предлагая подробные рекомендации о том, как поставщики GPAI, такие как OpenAI, могут продемонстрировать соответствие.

Балансирование прогресса с подотчетностью

Несмотря на внутренний оптимизм, OpenAI остается под растущим контролем со стороны регуляторов и академических кругов. Компания признала, что политическая и идеологическая предвзятость остается открытой исследовательской проблемой, требующей долгосрочного совершенствования в сборе данных, маркировке и методах обучения с подкреплением.

Параллельно OpenAI недавно встретилась с регуляторами ЕС по антимонопольным вопросам, поднимая опасения по поводу конкуренции о доминировании крупных технологических фирм, особенно Google, в сфере ИИ. С более чем 800 миллионами еженедельных пользователей ChatGPT и оценкой, превышающей 500 миллиардов долларов США, OpenAI сейчас находится на пересечении инноваций и регуляторного напряжения.

Пост OpenAI видит 30% улучшение справедливости ChatGPT впервые появился на CoinCentral.

Вам также может быть интересно

Последние новости криптовалют: запуск MSBT от Morgan Stanley

Новости о криптовалюте, которые все запомнят в этом апреле, когда Pepeto заполнится раньше ETH и BNB