Как пользователи видят технологии ИИ в продуктах и как избежать «черного зеркала» в восприятии

Привет, Хабр! Сейчас тема ИИ у всех на слуху: эта технология то ли собирается перевернуть современный мир, то ли всем уже надоела, то ли и то и другое сразу. У пользователей ее упоминание в продуктах может вызвать как интерес, так и тревогу, особенно когда она обещает больше, чем реально дает.

Меня зовут Юля, в MТС я занимаюсь внедрением ИИ-функций в нескольких продуктах. В этом материале расскажу о результатах собственного исследования отношения пользователей к ИИ: покажу, как можно сегментировать аудиторию в зависимости от их восприятия технологий и как донести ценность ИИ через персонализацию и продуманные сценарии.

Почему я решила погрузиться в эту тему

Продукты с ИИ можно разделить на следующие категории:

-

Продукты, где вся функциональность строится вокруг ИИ: приложения для общения с ИИ-персонажами, генерации изображений и видео, транскрибации аудио и так далее.

-

Продукты с отдельными ИИ-функциями — например, ассистенты в тарифе РИИЛ от МТС.

-

Продукты, где ИИ применяется для каких-то внутренних задач — например, сервис собирает и выводит ленту рекомендаций по действиям или реакциям.

К третьей группе люди более или менее привыкли, а вот на первые две реагируют по-разному. Одни пользуются этими функциями каждый день, другие пробуют пару раз, а третьи разочаровываются, потому что не разобрались с технологией ИИ.

Готовность работать, знакомиться или недоверие — разные сценарии, и мне важно различать их. Из этого и выросло небольшое исследование, о котором расскажу дальше.

Что я сделала

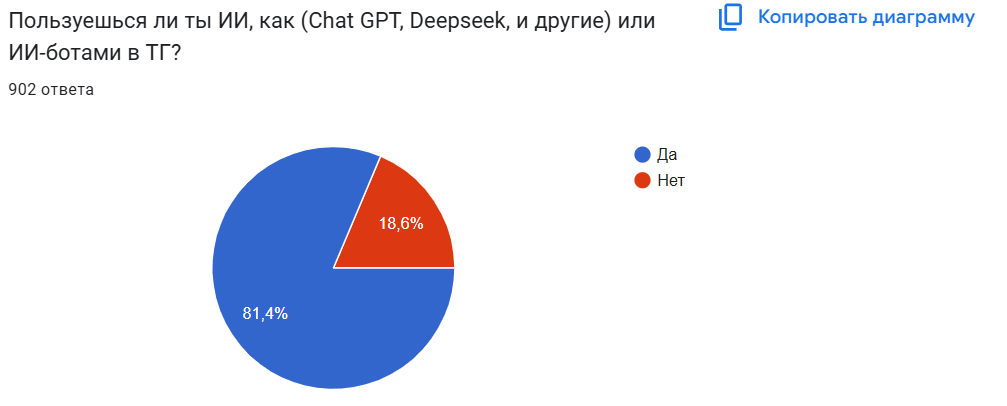

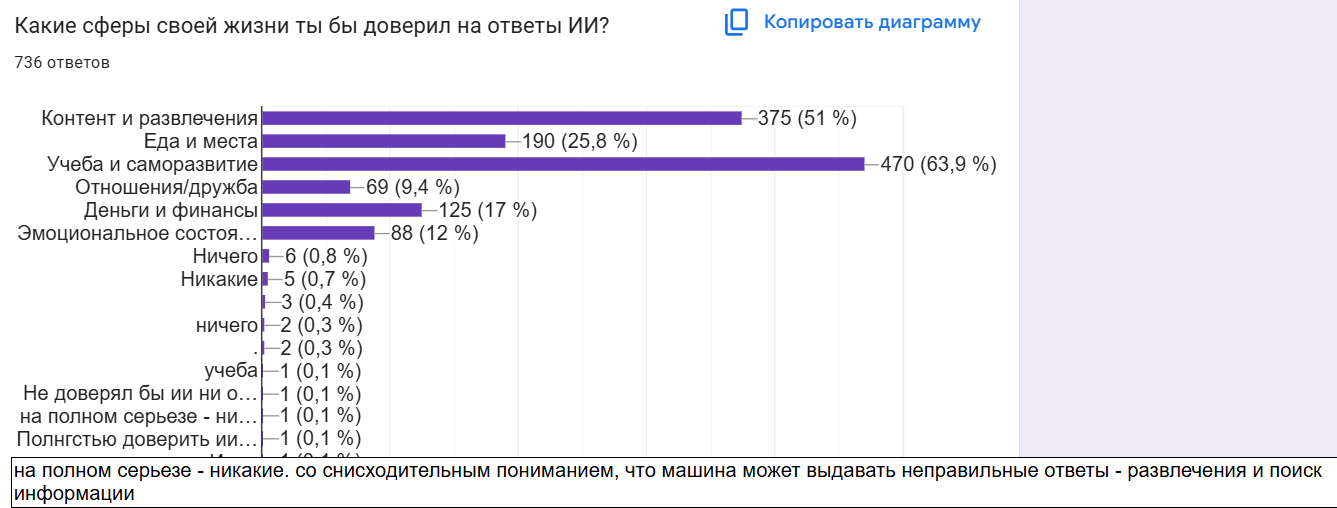

Начала с небольшого опроса. Задала пятнадцати пользователям возрастом от 18 до 23 лет несколько вопросов: пользуются ли они нейросетями, в каких ситуациях и какие эмоции испытывают при просмотре сгенерированного контента. Кроме того, для дополнительного подтверждения своих гипотез проводила количественное исследование. В нем приняли участие девятьсот два человека. Общее отношение к нейросетям видно на графике:

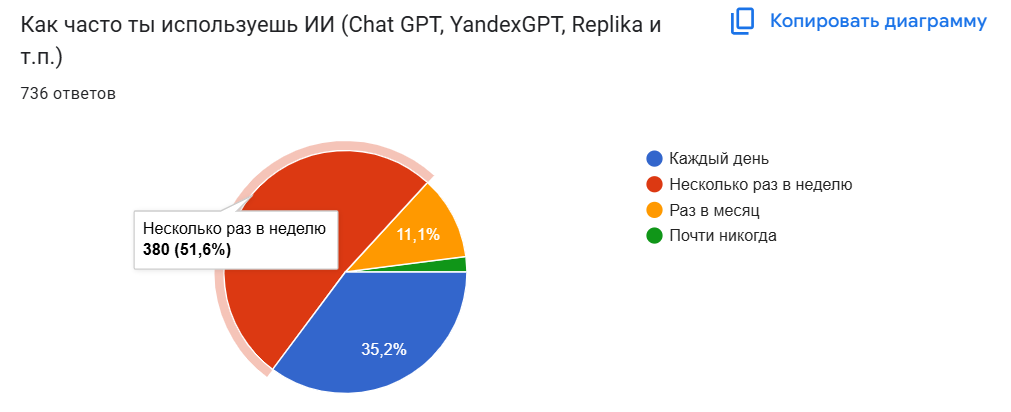

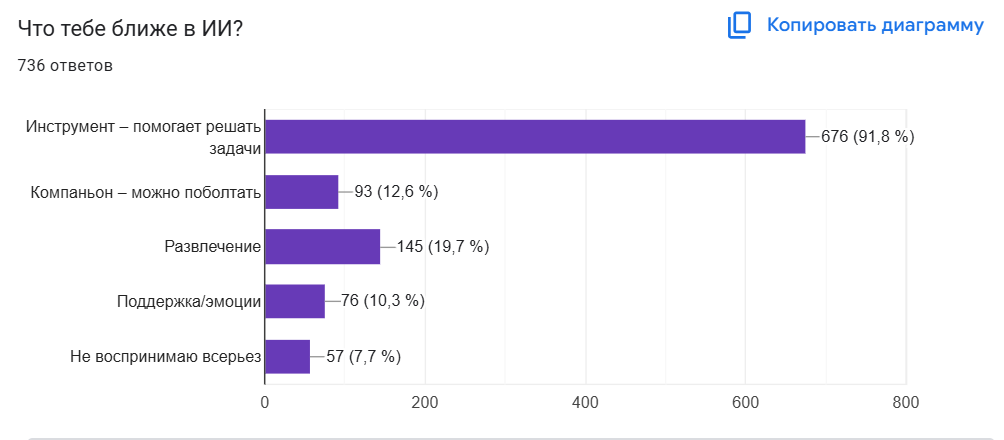

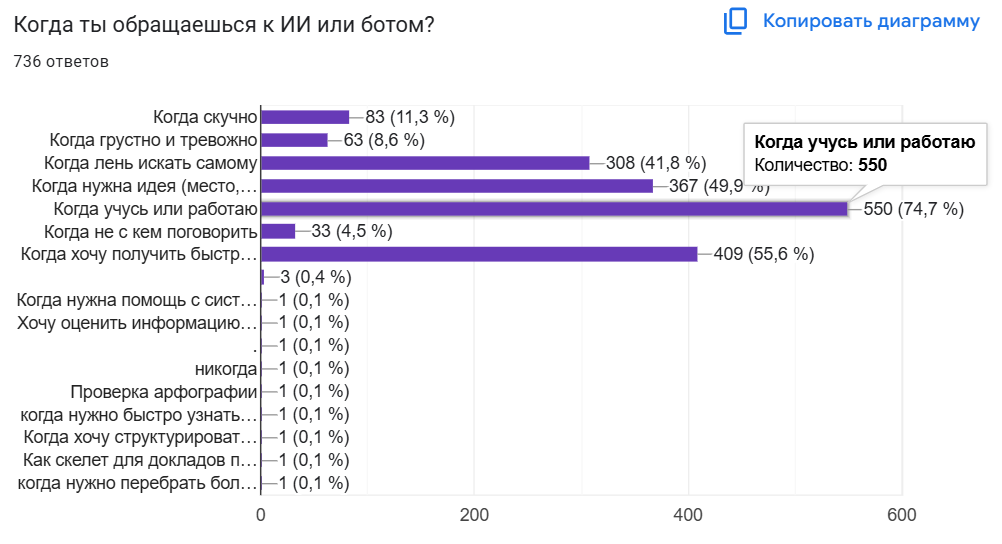

А также в каких именно моментах прибегают к помощи нейросетей:

Благодаря опросу я подтвердила, что пользователи активно пользуются ИИ-функциями, но те вызывают разные эмоции: большинство видит в них инструмент для решения конкретных задач, но некоторые видят вариант развлечения или не воспринимают всерьез.

Как донести разным группам пользователям ценность технологии ИИ

Часто респонденты признавались, что испытывают тревогу, когда видят прямое упоминание — «здесь применяется ИИ». Я сформулировала два основных страха:

-

отсутствие доверия к создателю приложения/контента;

-

формирование собственных ожиданий и разочарование от результата.

На самом деле всему виной реклама: черный пиар — тоже пиар.

На Хабре уже много писали об этой проблеме: часто компании добавляют ИИ-функции не из реальной потребности аудитории. Когда пользователи отвечают на новинку раздражением, бизнес делает неверный вывод: «Наша разработка хуже, чем у конкурентов», врубает форсаж и добавляет еще больше ИИ, хотя в реальности людям он не нужен.

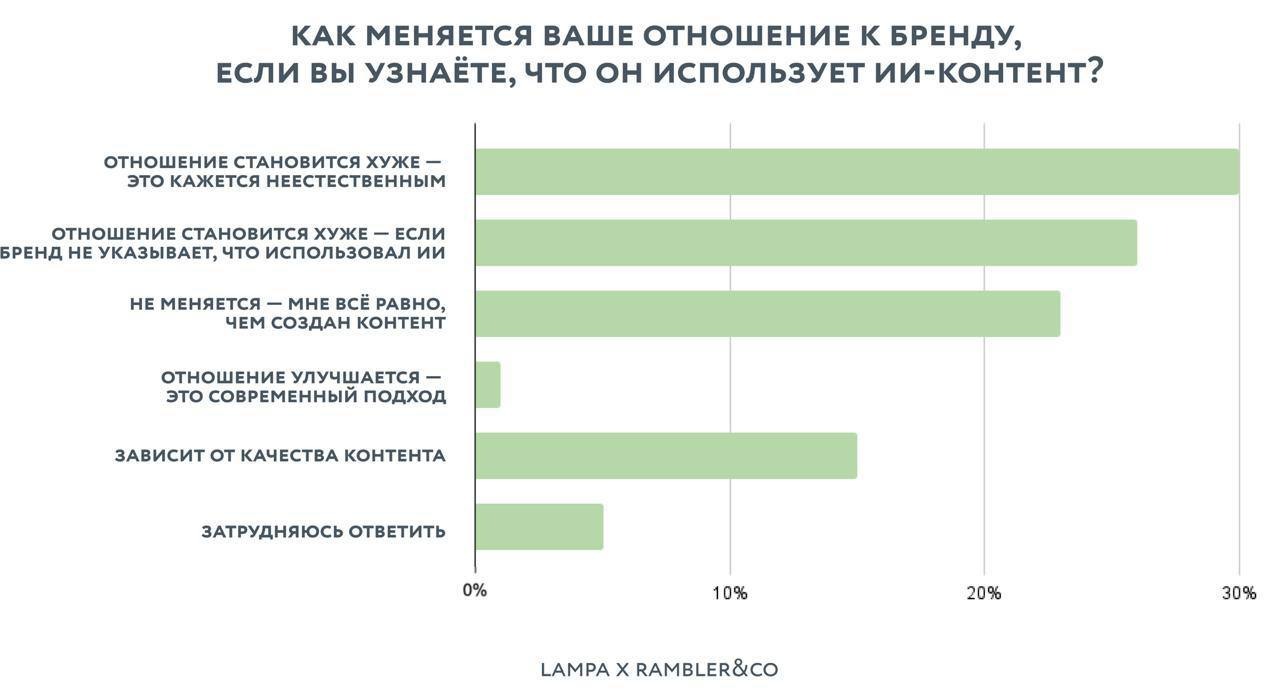

Пока делала эту статью, наткнулась еще на одно исследование. У него тоже очень показательные результаты:

И что же делать, чтобы избежать негативной реакции?

Нужно давать пользователям выбор: пользоваться ИИ или нет

Чтобы негатив не накапливался, ИИ-функция не должна быть обязательной. Например, в тарифе РИИЛ пользователь может спросить что-то у бота, но может продолжить общаться с друзьями.

Аудитории нужно показывать, как ИИ работает в реальных кейсах

Для тех, кто относится к ИИ-агентам или использованию нейросетей настороженно, можно показать их как помощника для конкретных сценариев, делающего жизнь проще и эффективнее. Например, что бот может выступать в разных ролях:

-

репетитором при изучении иностранных языков;

-

карьерным консультантом при подготовке резюме.

Его можно использовать как прокачанный поисковик: в свободной форме описать, что ты хочешь посмотреть, и он подберет тебе фильм на вечер, сэкономив время на поиск по каталогам.

Моими респондентами были зуммеры, их главный запрос связан с учебой и поиском новой работы:

Здесь приложения с нейросетями в формате агентов отлично вписываются в сценарии обучения:

Один из важных вызовов ИИ — необходимость проверки фактов. Об этом говорили все мои респонденты: никто из них не доверяет нейросетям на сто процентов.

Нужно заранее и явно предупреждать, что при работе с ИИ всегда остается вероятность нерелевантного ответа

При работе чат-ботов и других нейросетевых инструментов всегда есть риск галлюцинаций и нерелевантных ответов, которые приводят к негативной обратной связи от пользователей и падению их доверия к продукту. Чем больше они взаимодействуют с ИИ-функциями, тем меньше обращают внимание на неточности, перестают перепроверять информацию и потом сталкиваются с неприятными для себя последствиями.

Чтобы этого избежать, необходимо создавать систему «предохранителей» от неприятных ситуаций. Например, в ботах тарифа РИИЛ мы на уровне промптов прописали темы, которые он не должен обсуждать. В ассистенте ментальной поддержки есть расширенная защита, где мы определяем, на какую тему бот может разговаривать. Если пользователь пишет про депрессию или потерю тяги к жизни, то ассистент прервет обсуждение и посоветует обратиться в специальную службу поддержки.

Что важно понимать при внедрении ИИ-функций

Для меня результаты исследования показали, что пользователи не «покупают» такие функции просто так и их внедрение требует много усилий — бизнесовых, маркетинговых и технических. На начальном этапе нужно продумать все детали будущего взаимодействия пользователей:

-

Если человек относится с недоверием — ему нужны готовые сценарии, где уже заранее понятно, что надо вводить и какие вопросы задавать.

-

Если пользователь продвинутый и интересуется работой нейросетей — подойдет формат, где можно экспериментировать и самому создавать свои сценарии.

-

В развлекательных активностях нужно всегда закладывать «предохранители» и предупреждать пользователей о возможных рисках.

На этом у меня всё. Делитесь в комментариях своими эмоциями по отношению к нейросетям, задавайте вопросы. Буду рада обсудить результаты своего исследования.

Источник

Вам также может быть интересно

Revolut протестирует стейблкоины в регуляторной песочнице Великобритании

Поступило предложение рассматривать стейблкоины как наличные