Cổ phiếu Nvidia (NVDA); Giảm nhẹ khi thỏa thuận GPU trị giá 1 triệu USD với AWS xuất hiện

Tóm tắt;

- Cổ phiếu Nvidia (NVDA) giảm nhẹ sau tin tức về thỏa thuận GPU trị giá 1 triệu USD với AWS.

- Thỏa thuận bao gồm 1 triệu GPU cùng các chip mạng và suy luận đến năm 2027.

- AWS tăng cường năng lực điện toán AI giữa tình trạng thiếu hụt chip toàn cầu và nhu cầu cao.

- Việc triển khai chip hỗn hợp cho thấy sự hợp tác và cạnh tranh liên tục giữa AWS và Nvidia.

Cổ phiếu Nvidia (NVDA) giảm nhẹ trong tuần này sau khi thông tin về thỏa thuận nhiều năm với Amazon Web Services (AWS) để cung cấp tới một triệu GPU và một số chip bổ sung đến cuối năm 2027 được tiết lộ.

Thỏa thuận được một giám đốc điều hành công ty tiết lộ với Reuters, cũng bao gồm phần cứng mạng tiên tiến như Connect X và Spectrum X, cũng như sáu chip Nvidia chuyên dụng khác được thiết kế cho khối lượng công việc suy luận AI.

Mặc dù các điều khoản tài chính vẫn chưa được công bố, tin tức này đã thu hút sự chú ý của các nhà đầu tư, phản ánh cả quy mô cam kết và tầm quan trọng chiến lược của việc liên kết với nhà cung cấp điện toán đám mây hàng đầu. CEO Nvidia Jensen Huang trước đó đã mô tả cơ hội bán hàng tiềm năng trị giá 1,000 tỷ USD cho các dòng chip Rubin và Blackwell trong cùng kỳ, báo hiệu rằng những quan hệ đối tác như vậy là trọng tâm trong chiến lược tăng trưởng dài hạn của Nvidia.

Thỏa Thuận Đa Chip Củng Cố Cơ Sở Hạ Tầng AI Của AWS

Sự hợp tác vượt xa một thỏa thuận nhà cung cấp đơn giản. Nvidia và AWS có kế hoạch tích hợp Connect X và Spectrum X vào các trung tâm dữ liệu của AWS, hỗ trợ các khách hàng và khối lượng công việc AI lớn, theo Ian Buck, phó chủ tịch điện toán siêu quy mô và hiệu suất cao của Nvidia. AWS cũng sẽ tận dụng nền tảng NVLink Fusion của Nvidia, một công nghệ liên kết chip tốc độ cao, để nâng cao hiệu suất cho các bộ gia tốc tùy chỉnh Trainium4 trong tương lai.

NVIDIA Corporation, NVDA

Cách tiếp cận kết hợp này minh họa một chiến lược kép: AWS có quyền truy cập vào GPU đẳng cấp thế giới trong khi tiếp tục phát triển các chip tập trung vào AI của riêng mình. AWS đã nhấn mạnh rằng các chip Trainium mang lại hiệu suất giá tốt hơn 30–40% so với các phiên bản dựa trên GPU, chứng minh rằng hai công ty vừa là đối tác vừa là đối thủ cạnh tranh trong thị trường điện toán đám mây AI.

Thị Trường Chứng Khoán Phản Ứng Với Quy Mô Và Chiến Lược

Các nhà đầu tư tỏ ra thận trọng, dẫn đến cổ phiếu Nvidia giảm nhẹ. Các nhà phân tích cho rằng sự giảm giá có thể phản ánh sự không chắc chắn về việc liệu một đơn hàng lớn như vậy sẽ ảnh hưởng đến chuỗi cung ứng hay ảnh hưởng đến tỷ suất lợi nhuận của Nvidia. Tuy nhiên, thỏa thuận này nhấn mạnh vai trò trung tâm của Nvidia trong cơ sở hạ tầng AI điện toán đám mây, đặc biệt khi các nhà cung cấp siêu quy mô tiếp tục dựa vào GPU của Nvidia ngay cả khi họ xây dựng các chip tùy chỉnh.

Việc đảm bảo một triệu GPU mang lại cho AWS lợi thế dài hạn trong phân khúc GPU-as-a-Service, mà các dự báo ngành ước tính sẽ đạt 26,600 triệu USD vào năm 2030. Quy mô khổng lồ của thỏa thuận này có thể khiến các nhà cung cấp điện toán đám mây nhỏ hơn gặp khó khăn hơn trong việc cạnh tranh cho các khối lượng công việc AI cao cấp, vì nguồn cung GPU cao cấp vẫn bị hạn chế trên toàn cầu.

Tác Động Ngành: Hợp Tác Gặp Cạnh Tranh

Thỏa thuận Nvidia-AWS làm nổi bật một động lực tinh tế trong không gian AI điện toán đám mây. Trong khi AWS là người mua Nvidia lớn, khoản đầu tư liên tục của họ vào các chip Trainium độc quyền đảm bảo rằng sự thống trị của Nvidia được cân bằng bởi sự đổi mới của khách hàng. Sự hợp tác cũng cho thấy xu hướng các nhà cung cấp siêu quy mô tích hợp nhiều loại chip và giải pháp mạng để tối ưu hóa hiệu suất AI, thay vì dựa vào một hệ sinh thái nhà cung cấp duy nhất.

Các chuyên gia ngành cho rằng mô hình chip hỗn hợp này có thể sẽ tồn tại trong nhiều năm, kết hợp tốc độ và tính linh hoạt của GPU Nvidia với hiệu quả chi phí và tùy chỉnh của phần cứng độc quyền. Nó cũng nhấn mạnh sự tăng trưởng rộng lớn hơn của nhu cầu điện toán AI, tiếp tục vượt qua nguồn cung toàn cầu bất chấp việc mở rộng năng lực sản xuất.

Triển Vọng Cho Nvidia Và AWS

Nhìn về tương lai, cả hai công ty dự kiến sẽ đẩy mạnh hợp tác kỹ thuật, đặc biệt trong suy luận AI hiệu suất cao và khối lượng công việc quy mô điện toán đám mây. Trong khi Nvidia đối mặt với biến động cổ phiếu nhỏ để đáp ứng với tin tức, định vị chiến lược của công ty với tư cách là nhà cung cấp chip AI hàng đầu vẫn mạnh mẽ.

Đối với AWS, thỏa thuận củng cố vị trí dẫn đầu của họ trong các dịch vụ điện toán đám mây tăng tốc GPU trong khi cân bằng các khoản đầu tư vào hệ sinh thái chip độc quyền của mình.

Bài viết Cổ Phiếu Nvidia (NVDA); Giảm Nhẹ Khi Thỏa Thuận GPU 1 Triệu USD Với AWS Xuất Hiện được đăng đầu tiên trên CoinCentral.

Có thể bạn cũng thích

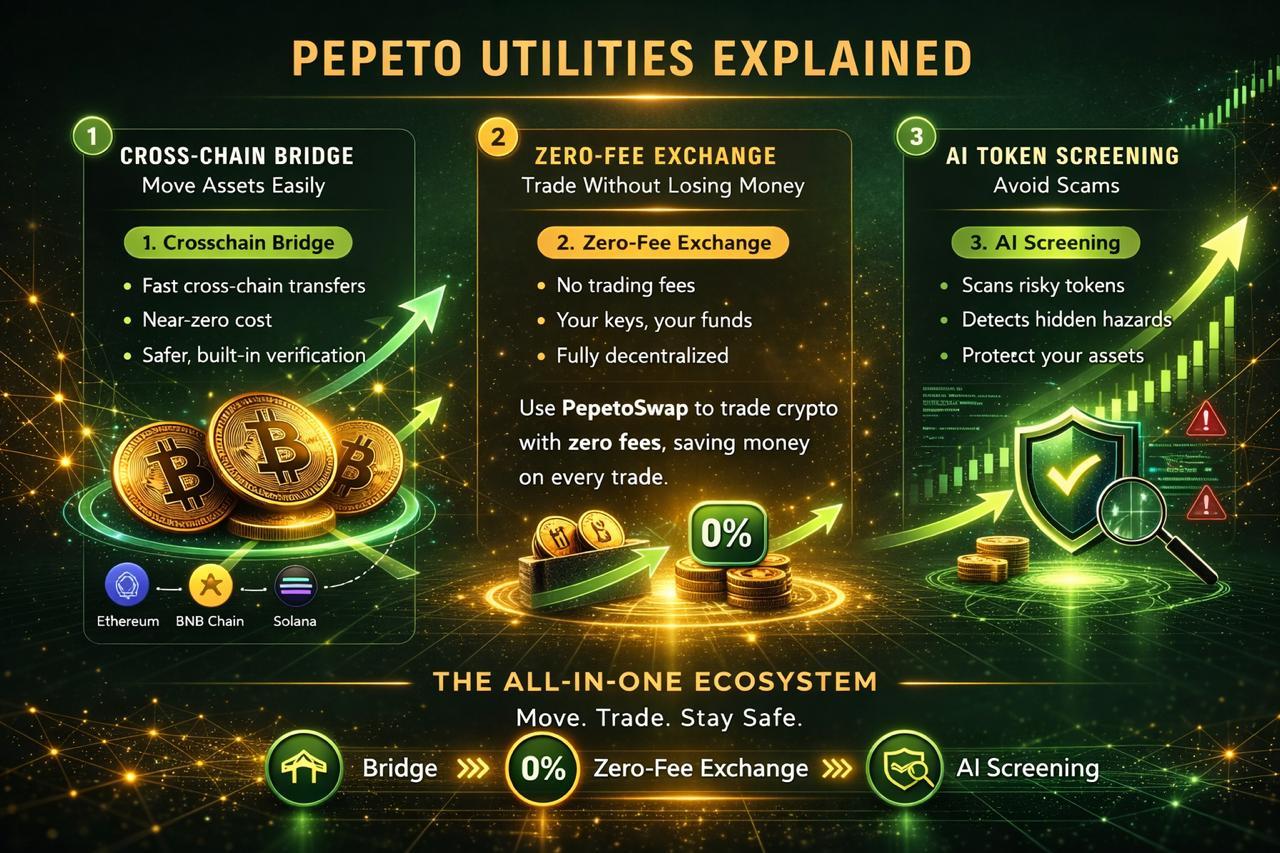

Tiền mã hóa tốt nhất để đầu tư năm 2026 khi SEC phân loại 16 hàng hóa trong khi Pepeto cung cấp mức tăng hiếm có 220 lần trước khi niêm yết

Cựu Cục trưởng Tuần tra Biên giới thúc đẩy truy xuất gần một phần ba dân số Hoa Kỳ