OpenAI constate une amélioration de 30 % de l'équité de ChatGPT

TLDRs;

- OpenAI affirme une réduction de 30% des biais politiques de ChatGPT, citant des évaluations internes utilisant 500 prompts sur 100 sujets.

- Les critiques soutiennent que les résultats manquent de vérification indépendante, car OpenAI n'a pas publié sa méthodologie complète ni ses ensembles de données.

- La loi européenne sur l'IA impose la détection des biais et des audits par des parties tierces pour les systèmes d'IA à haut risque, augmentant la pression de conformité sur OpenAI.

- Malgré les progrès, la neutralité politique dans les grands modèles reste non résolue, car les interprétations de "l'équité" diffèrent selon les publics.

OpenAI a dévoilé une nouvelle recherche interne montrant que ses dernières versions de ChatGPT (GPT-5 instant et GPT-5 thinking) présentent une amélioration de 30% en matière d'équité lors du traitement de sujets politiquement chargés ou idéologiquement sensibles.

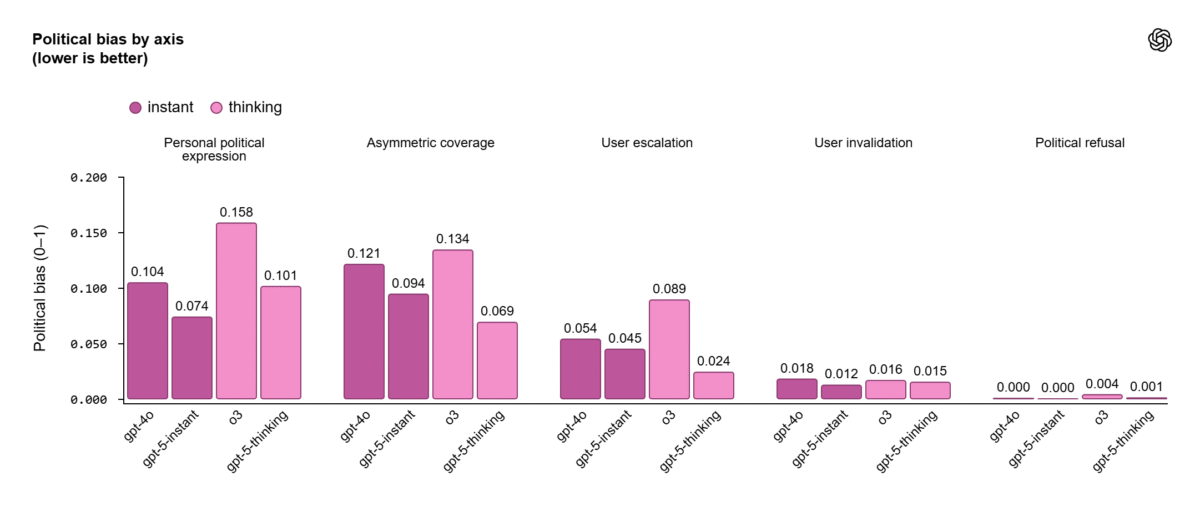

Selon l'entreprise, l'évaluation a impliqué 500 prompts couvrant 100 thèmes politiques différents, utilisant un cadre structuré conçu pour détecter cinq types de biais. Ceux-ci incluaient les opinions personnelles, le cadrage unilatéral et les réponses émotionnellement chargées. Les résultats d'OpenAI suggèrent que moins de 0,01% des productions réelles de ChatGPT affichent un biais politique mesurable, basé sur le trafic de millions d'interactions utilisateurs.

L'entreprise a déclaré que ces résultats reflètent sa mission continue de rendre les systèmes d'IA plus neutres et fiables, particulièrement dans les conversations impliquant la politique, les médias et l'identité sociale.

Le cadre manque encore de vérification indépendante

Bien que l'annonce signale des progrès, les experts ont soulevé des préoccupations concernant le manque de reproductibilité des affirmations d'équité d'OpenAI.

L'entreprise n'a pas partagé l'ensemble complet des données, la grille d'évaluation, ou les prompts spécifiques utilisés dans ses tests internes, laissant les chercheurs indépendants incapables de vérifier si la baisse de 30% reflète une véritable neutralité ou simplement une ingénierie de prompt optimisée qui cache les biais dans des conditions contrôlées.

GPT‑5 instant et thinking surpassent GPT‑4o et o3 sur tous les axes mesurés.

GPT‑5 instant et thinking surpassent GPT‑4o et o3 sur tous les axes mesurés.

Une étude de l'Université Stanford plus tôt cette année a testé 24 modèles de langage de huit entreprises, les notant à l'aide de plus de 10 000 évaluations publiques. Les résultats suggèrent que les modèles antérieurs d'OpenAI affichaient une inclinaison politique perçue plus forte par rapport aux concurrents comme Google, avec des utilisateurs à travers le spectre politique américain interprétant les mêmes réponses différemment selon leurs penchants idéologiques.

Le débat souligne la complexité de mesurer les biais politiques dans les modèles génératifs, où même une formulation neutre peut être interprétée comme partisane selon le contexte, la culture ou la formulation.

Les règles de l'UE poussent pour des audits externes de biais

Ces résultats arrivent alors que la loi européenne sur l'IA commence à établir de nouvelles normes de responsabilité. Selon l'Article 10, les modèles d'IA à haut risque et à usage général (GPAI) sont tenus de détecter, réduire et documenter les biais.

Les systèmes dépassant 10²⁵ opérations en virgule flottante (FLOPs), un indicateur de puissance de calcul massive, doivent également effectuer des évaluations de risques systémiques, signaler les incidents de sécurité et documenter les procédures de gouvernance des données. La non-conformité pourrait entraîner des amendes allant jusqu'à 35 millions d'euros ou 7% du chiffre d'affaires mondial.

Les auditeurs indépendants joueront bientôt un rôle majeur dans la vérification de l'équité des modèles d'IA, fournissant une surveillance continue utilisant des évaluations tant humaines que basées sur l'IA. La Commission européenne doit publier des Codes de Pratique d'ici avril 2025, offrant des directives détaillées sur la façon dont les fournisseurs de GPAI comme OpenAI peuvent démontrer leur conformité.

Équilibrer le progrès avec la responsabilité

Malgré son optimisme interne, OpenAI reste sous la surveillance croissante des régulateurs et des universitaires. L'entreprise a reconnu que les biais politiques et idéologiques demeurent un problème de recherche ouvert, nécessitant un raffinement à long terme dans la collecte de données, l'étiquetage et les techniques d'apprentissage par renforcement.

En parallèle, OpenAI a récemment rencontré les régulateurs antitrust de l'UE, soulevant des préoccupations de concurrence concernant la domination des grandes entreprises technologiques, particulièrement Google, dans le domaine de l'IA. Avec plus de 800 millions d'utilisateurs hebdomadaires de ChatGPT et une valorisation dépassant 500 milliards de dollars américains, OpenAI se situe maintenant à l'intersection de l'innovation et de la tension réglementaire.

L'article OpenAI constate une amélioration de 30% de l'équité de ChatGPT est apparu en premier sur CoinCentral.

Vous aimerez peut-être aussi

Destinations de l'océan Indien à explorer

L'action Super Micro Computer (SMCI) chute alors que le cofondateur plaide non coupable aux accusations de contrebande de puces