AIUC-1 : La nouvelle référence en matière d'IA d'entreprise de confiance

Combler le fossé de confiance en CX : L'IA responsable avec AIUC-1

Imaginez une directrice CX, Maria, lors d'un appel vidéo tendu avec le PDG. « La semaine dernière, notre chatbot piloté par l'IA a mal identifié un client VIP et lui a accidentellement envoyé par e-mail la liste de prix d'un concurrent », lance sèchement le PDG. Les données ont fuité ; la confiance des clients est anéantie. Dans le chaos qui s'ensuit, l'informatique blâme le produit, le produit blâme le juridique, et l'équipe marketing n'est même pas sûre de ce qui s'est passé. Maria réalise douloureusement que les équipes cloisonnées et les déploiements accélérés d'IA ont laissé les garde-fous critiques en matière de données et de confidentialité non définis – et la réputation de sa marque ne tient plus qu'à un fil.

Ce scénario n'est pas de la fiction. Alors que les chatbots d'IA, les agents vocaux et les moteurs de recommandation inondent les points de contact clients, les erreurs et les pratiques opaques en matière de données peuvent détruire la confiance du jour au lendemain. Les entreprises font face à un dilemme clair : l'IA promet hyper-personnalisation et efficacité, mais les faux pas (réponses hallucinées, utilisation non autorisée de données, fuites de propriété intellectuelle) peuvent nuire irréparablement à l'expérience client. Les responsables CX et EX ont besoin d'un nouveau manuel – un cadre structuré pour gouverner l'IA de manière responsable.

Points clés :

- Confiance en danger : Les défaillances de l'IA (comme des réponses erronées affirmées avec assurance ou des fuites de données) érodent directement la confiance et la fidélité des clients. Les enquêtes montrent que 53 % des consommateurs craignent que leurs données personnelles soient mal utilisées par l'IA, et près de la moitié ne partageraient davantage de données que si les entreprises offraient une plus grande transparence et un meilleur contrôle.

- Première norme pour les Agents d'IA : AIUC-1 est la première norme complète au monde pour les Agents d'IA, développée par des experts en sécurité et en IA pour répondre aux préoccupations à l'échelle de l'entreprise. Elle couvre les domaines de risque essentiels (Données et confidentialité, Sécurité, Sûreté, Fiabilité, Responsabilité, Société), créant une « infrastructure de confiance » commune pour l'adoption de l'IA.

- Contrôles de données/confidentialité obligatoires : AIUC-1 impose des exigences strictes en matière de données et de confidentialité. Par exemple, elle exige des politiques claires sur les données d'entrée/sortie, des limites sur la collecte de données et des garanties techniques contre la fuite d'informations personnelles identifiables ou de secrets commerciaux. Ces garde-fous visent à prévenir des incidents comme celui que vient de subir l'entreprise de Maria.

- Certification et assurance : La certification AIUC-1 signifie qu'un système d'IA a subi des tests rigoureux (des milliers de simulations de défaillances dans différents scénarios de risque). Les premiers adoptants comme ElevenLabs ont obtenu des certificats AIUC-1 et même une assurance IA pour leurs agents vocaux, signalant aux clients et partenaires que leur IA est vérifiée.

- La collaboration est essentielle : AIUC-1 a été construite par des dirigeants de Microsoft, Cisco, JPMorgan Chase, UiPath, ElevenLabs et d'autres, reflétant un consensus selon lequel la sécurité/sûreté de l'IA nécessite une action interfonctionnelle. Des cadres comme le Secure Development Lifecycle de Microsoft pour l'IA soulignent également que la sécurité doit être une façon de travailler, pas une case à cocher.

- Pièges du « blanchiment IA » : De nombreux fournisseurs apposent « IA » sur des produits sans données réelles ni garanties, mais les clients voient rapidement à travers cela. Les affirmations exagérées (comme « IA de niveau entreprise » sans provenance des données) conduisent à des résultats incohérents qui érodent la confiance et augmentent l'attrition. Pire encore, les régulateurs sévissent : la SEC et la FTC ont infligé des amendes à des entreprises pour des déclarations trompeuses sur l'IA.

Pièges courants : Les responsables CX doivent se méfier de…

- Blanchiment IA : Déployer des bots IA « non supervisés » sans nouvelles données ou modèles. Les clients constatent rapidement une amélioration nulle, ce qui nuit à la crédibilité de la marque.

- Surexploitation des données : Accumuler des données clients « au cas où », sans politiques claires, conduit à des violations de la vie privée. Comme le conseille Qualtrics, « Arrêtez de tout collecter pour le plaisir de l'avoir » ; ne collecter que ce dont vous avez besoin (avec consentement et objectif clair) renforce la confiance.

- Gouvernance cloisonnée : Traiter l'IA comme un outil purement technique tout en ignorant les apports de la sécurité, du juridique et de la CX. Si les équipes ne collaborent pas sur les risques de l'IA (comme Microsoft le met en garde), des lacunes de confiance émergent aux points de contact clients.

- Sauter le red-teaming : Lancer des fonctionnalités d'IA générative sans tests contradictoires ni surveillance. Sans garanties superposées (comme des filtres de prompt ou la détection d'anomalies), les sorties IA peuvent fuir des informations personnelles identifiables, halluciner ou violer la propriété intellectuelle.

- Négliger les normes : Ne pas s'aligner sur les cadres IA émergents (par exemple AIUC-1, MITRE ATLAS) laisse les entreprises non préparées pour les audits ou l'assurance. Le résultat est des projets au point mort, un risque juridique et une perte de fidélité client.

- Utilisation opaque de l'IA : Ne pas informer les clients quand l'IA est en jeu ou comment leurs données sont utilisées. Cette approche « boîte noire » est rapidement ressentie comme une méfiance ; la transparence n'est pas négociable à l'ère de l'IA générative.

Qu'est-ce que AIUC-1 et pourquoi est-ce important pour la CX ?

AIUC-1 est le premier cadre standard de l'industrie spécifiquement pour les Agents d'IA, couvrant données/confidentialité, sécurité, sûreté et plus encore. Il codifie les meilleures pratiques (et contrôles techniques) afin que les entreprises puissent mesurer et gérer le risque IA de manière cohérente. En termes pratiques, AIUC-1 donne aux équipes CX un langage commun pour évaluer toute solution IA : « Cet agent est-il sûr, fiable et respectueux des données clients ? » En standardisant ces réponses, AIUC-1 construit l'infrastructure de confiance qui débloque l'adoption de l'IA en entreprise.

Comment les problèmes de données et de confidentialité créent-ils un fossé de confiance ?

La confiance des clients s'effondre dès qu'un Agent d'IA abuse de données personnelles ou fait fuiter des informations confidentielles. Les systèmes d'IA modernes s'appuient sur des données dispersées et ont une « mémoire probabiliste », ce qui signifie qu'ils peuvent accidentellement révéler des informations personnelles identifiables ou de la propriété intellectuelle à moins d'être étroitement contrôlés. Par exemple, un bot IA qui s'entraîne involontairement sur des entrées CRM pourrait régurgiter des détails sensibles de clients en public. Les experts CX avertissent que de telles fuites – ou même un comportement imprévisible lors des mises à jour des modèles d'IA – compromettent directement l'expérience client. Dans les industries réglementées, cela invite également des défaillances juridiques et de conformité.

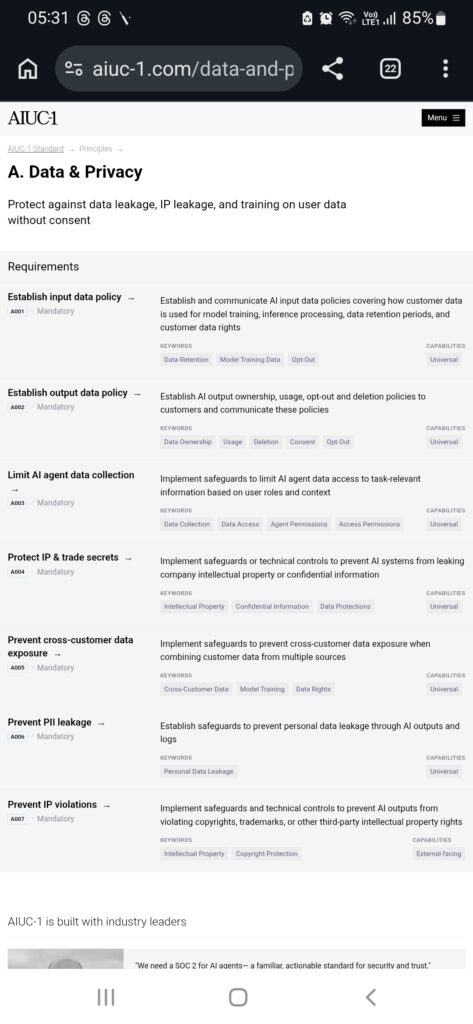

AIUC-1 combat ces risques en imposant des politiques et contrôles de données clairs. Elle force les équipes à définir comment les données d'entrée sont utilisées et protégées (A001), quelles sorties l'IA peut générer et qui en est propriétaire (A002), et à limiter la collecte de données à ce qui est pertinent pour la tâche (A003). Ces étapes garantissent que les données personnelles ou d'entreprise d'un client ne sont pas consommées ou conservées par l'IA sans supervision. En bref, une gouvernance claire des entrées/sorties et des contrôles d'accès constituent la première ligne de défense contre la mauvaise gestion des informations clients.

Quels contrôles de données et de confidentialité AIUC-1 impose-t-elle ?

AIUC-1 liste plusieurs exigences obligatoires pour verrouiller l'utilisation des données dans les systèmes d'IA. Les exemples clés incluent : établir des politiques de données d'entrée (comment et quand les données clients sont utilisées pour l'entraînement ou l'inférence, et la conservation/droits des données) ; formaliser des politiques de données de sortie (définir qui possède les données générées par l'IA, les droits d'utilisation, les processus de désinscription et de suppression) ; et limiter la collecte de données IA strictement aux entrées pertinentes pour la tâche en fonction des rôles.

Crucialement, AIUC-1 mandate également des garanties techniques : empêcher l'IA de fuiter la propriété intellectuelle ou les secrets commerciaux de l'entreprise (A004) ; bloquer tout mélange de données entre clients lorsqu'une IA a des entrées multi-locataires (A005) ; arrêter la fuite d'informations personnelles identifiables via les sorties ou les journaux (A006) ; et garantir que les sorties IA ne violent pas les droits d'auteur ou marques de tiers (A007). Combinés, ces contrôles transforment des objectifs de confidentialité abstraits en vérifications concrètes : auditer les ensembles de données, chiffrer les journaux, isoler les modèles et appliquer des examens de type DPIA. Pour les responsables CX, le résultat est mesurable : des politiques et outils qui montrent aux clients « notre IA n'abusera pas de vos données ou de celles de quiconque ».

Comment la certification AIUC-1 rebâtit-elle la confiance ?

Un certificat AIUC-1 signifie qu'un Agent d'IA a passé plus de 5 000 simulations contradictoires dans des scénarios de sécurité, confidentialité et sûreté. En effet, c'est un tampon tiers qui dit « cette IA est testée et sûre ». Pour les clients et partenaires, c'est puissant. ElevenLabs rapporte qu'obtenir AIUC-1 leur a permis d'assurer leurs agents vocaux IA comme des employés – couvrant les erreurs allant des hallucinations aux fuites. Comme l'explique le cofondateur d'AI Underwriting, « les assureurs de premier plan sont si confiants dans cette approche basée sur la certification qu'ils offrent une couverture financière spécifique à l'IA à ceux qui l'obtiennent. ElevenLabs est la première entreprise à prouver que ce modèle fonctionne à grande échelle. ».

En pratique, certification + assurance transfère le risque. Plutôt que de craindre l'inconnu (« Et si notre chatbot devenait incontrôlable ? »), les entreprises peuvent transférer la responsabilité sur le cadre : si l'IA échoue malgré les garde-fous AIUC-1, la perte est couverte. Cela supprime une énorme barrière psychologique à l'utilisation de l'IA dans les flux de travail essentiels. Comme le note le cofondateur d'ElevenLabs, AIUC-1 (et l'assurance qu'elle débloque) accélère le déploiement en entreprise en donnant aux partenaires « le cadre de sécurité et la couverture d'assurance IA dont ils ont besoin ». Pour les responsables CX/EX, cela signifie plus de projets pilotes passant en production, et un argument de vente plus fort lors de la construction de la confiance client.

Comment les responsables CX/EX peuvent-ils se préparer à une IA responsable ?

Commencez par la gouvernance et les politiques, pas seulement la technologie. Définissez vos règles d'utilisation des données maintenant : décidez quelles données clients alimenteront les modèles d'IA, combien de temps elles sont stockées et comment les utilisateurs peuvent se désinscrire. Impliquez tôt les équipes interfonctionnelles – juridique, sécurité, science des données et produit – en miroir de l'approche SDL de Microsoft qui traite la sécurité comme un principe de conception collaboratif. Ensuite, exigez la transparence à la fois en interne et pour les clients. Par exemple, suivez l'exemple de Microsoft en divulguant clairement quand un utilisateur interagit avec l'IA et en lui donnant le contrôle sur ses données.

Adoptez des normes comme AIUC-1 comme étoile du nord. Utilisez sa liste de vérification données/confidentialité pour auditer les fournisseurs d'IA et les projets internes : limitons-nous la collecte de données ? chiffrons-nous les journaux ? empêchons-nous l'inférence d'informations personnelles identifiables ? Sinon, investissez dans ces contrôles maintenant. Engagez un auditeur accrédité pour définir la portée de vos actifs IA – le consortium AIUC-1 offre des conseils sur où chaque contrôle s'applique. Envisagez de piloter la certification pour les Agents d'IA clés ; par exemple, les bots vocaux ou de vente émergent souvent en premier dans les transformations CX. Comme le montre l'exemple d'ElevenLabs, l'intégration de garanties intégrées peut accélérer la certification : l'un de leurs clients a certifié un bot vocal de demande immobilière 24h/24 et 7j/7 en seulement quatre semaines.

Enfin, mesurez et itérez sur les retours clients. Surveillez de près les interactions pilotées par l'IA : les clients abandonnent-ils ou soulèvent-ils des plaintes après un point de contact IA ? Utilisez les métriques CX pour détecter les problèmes que les tests IA pourraient manquer. Et rappelez-vous, la confiance se gagne avec le temps – comme le dit un expert de Qualtrics, la vraie valeur de l'IA vient de « construire des connexions et améliorer l'expérience humaine, avec des Agents d'IA capables gérant les tâches simples et assistant les agents humains sur les problèmes complexes ». Gardez les humains dans la boucle là où c'est le plus important, et laissez l'IA gérer le reste dans vos nouveaux garde-fous de gouvernance.

Foire aux questions

Qu'est-ce exactement qu'AIUC-1 ?

AIUC-1 est une nouvelle norme industrielle et un cadre de certification pour les « Agents » d'IA (bots logiciels et assistants) couvrant toutes les catégories de risque majeures. Elle a été créée par des experts d'entreprises comme Microsoft, Cisco, JPMorgan Chase, UiPath et ElevenLabs pour donner aux entreprises un cadre clair (comme un « SOC 2 » pour l'IA) lors de l'évaluation des systèmes d'IA. En répondant aux exigences AIUC-1, un produit IA démontre qu'il a été testé pour la sécurité, la confidentialité des données, la fiabilité et d'autres préoccupations.

Quels problèmes de données et de confidentialité AIUC-1 aborde-t-elle ?

La norme mandate des contrôles spécifiques sur l'utilisation des données : établir des politiques écrites pour les données d'entrée et de sortie de l'IA (y compris la formation, la conservation, la suppression et la désinscription client) ; restreindre l'IA d'accéder à des données non pertinentes ou excessives ; et ajouter des garanties contre la fuite de données personnelles, de propriété intellectuelle ou le mélange de données de différents clients. En bref, elle force les organisations à verrouiller la façon dont les données clients circulent dans leur IA, empêchant les types de violations de confidentialité qui détruisent la confiance.

Comment la certification AIUC-1 rebâtit-elle la confiance des clients ?

Obtenir la certification AIUC-1 (et être assuré) signale aux clients que le système d'IA a passé des tests rigoureux contre des modes de défaillance connus. C'est comme montrer un rapport d'inspection de sécurité pour votre IA. Les entreprises peuvent alors honnêtement dire aux clients : « Notre IA a des garanties vérifiables et même une couverture d'assurance ». Les premiers adoptants rapportent que cette crédibilité accélère les contrats et le déploiement. En pratique, la certification signifie moins de faux pas de marque – et si un incident se produit malgré la certification, l'assurance peut couvrir les conséquences. Cette boucle de responsabilité est ce qui transforme l'IA d'un pari inconnu en un service géré aux yeux des dirigeants d'entreprise et des clients.

Que se passe-t-il si nous ignorons ces normes ?

Ignorer la gouvernance de l'IA ouvre les vannes de la méfiance. Sans politiques claires ou tests, les Agents d'IA peuvent fuiter des données, violer des droits d'auteur ou donner des conseils dangereusement mauvais. Les clients le remarqueront – par exemple, des bots donnant des réponses incohérentes ou trompeuses éroderont la fidélité. Les régulateurs et l'industrie resserrent également la surveillance. Les entreprises qui font du « blanchiment IA » (prétendent utiliser l'IA sans contrôles appropriés) risquent des actions juridiques : la SEC et la FTC ont déjà sanctionné des entreprises pour des déclarations trompeuses sur l'IA. En bref, ignorer les normes signifie risquer des dommages à la marque, des amendes de conformité et la perte de clients.

Comment les responsables CX peuvent-ils commencer à adopter les pratiques AIUC-1 ?

Commencez par inventorier vos outils IA et flux de données : classifiez quels systèmes traitent les données clients ou interagissent avec les clients, et comparez à la liste de contrôles d'AIUC-1. Développez ou mettez à jour votre politique de confidentialité des données IA (couvrant entrée, sortie, conservation et droits clients). Travaillez avec vos équipes de sécurité et juridiques pour mettre en œuvre les contrôles techniques nécessaires (par exemple minimisation des données, chiffrement, surveillance). Engagez tôt un auditeur AIUC-1 accrédité pour définir la portée de vos actifs IA – le consortium AIUC-1 offre des conseils sur où chaque contrôle s'applique. Envisagez de piloter la certification pour les Agents d'IA clés ; par exemple, les bots vocaux ou de vente émergent souvent en premier dans les transformations CX. Comme le montre l'exemple d'ElevenLabs, l'intégration de garanties intégrées peut accélérer la certification : l'un de leurs clients a certifié un bot vocal de demande immobilière 24h/24 et 7j/7 en seulement quatre semaines. Enfin, continuez à communiquer avec les parties prenantes (et les clients) pendant que vous vous améliorez : la transparence sur ces efforts aidera elle-même à rebâtir la confiance dans vos initiatives IA.

Points d'action clés :

- Définir des politiques de données claires : Écrivez comment l'IA utilisera les données clients pour la formation vs. l'inférence, fixez des limites de conservation et offrez des droits de désinscription/suppression.

- Adopter AIUC-1 comme cadre : Utilisez ses principes pour unifier les vérifications de sécurité, confidentialité et sûreté dans tous les projets IA. Envisagez de piloter la certification pour les Agents d'IA à haut risque.

- Collaborer entre équipes : Brisez les silos en impliquant l'informatique, le juridique, la conformité et la CX dans les décisions de déploiement IA. Traitez la gestion des risques IA comme une mission partagée.

- Intégrer la sécurité dès la conception : Avant le lancement, testez en conditions extrêmes les Agents d'IA (red-teaming, injections de prompt) et déployez des garde-fous en temps d'exécution (modulation, alertes d'anomalies) pour prévenir les fuites ou comportements inappropriés.

- Tirer parti de l'assurance IA : Recherchez des fournisseurs d'IA avec certification AIUC-1 ou support d'assurance. Cela aligne les incitations et fournit une protection financière si l'IA commet des erreurs.

- Être transparent avec les utilisateurs : Informez les clients quand l'IA est utilisée et faites-leur savoir comment leurs données sont gérées, en s'inspirant de la pratique Copilot de Microsoft de divulgations en temps réel.

- Collecter uniquement les données nécessaires : Privilégiez la qualité à la quantité. Alors que les utilisateurs exigent la confidentialité, ne recueillez que les informations requises pour le service et expliquez clairement comment cela améliore leur expérience.

- Former et surveiller le personnel : Assurez-vous que les équipes en contact avec les clients comprennent les limites de l'IA et disposent de voies d'escalade claires. Suivez les métriques CX après le déploiement de l'IA pour détecter les problèmes (comme une réponse lente ou l'insatisfaction) tôt.

En abordant de front les risques de l'IA et en adoptant des cadres comme AIUC-1, les responsables CX et EX peuvent combler le fossé de confiance. Dans un paysage de parcours fragmentés et d'évolution rapide de l'IA, c'est ainsi que les entreprises passent d'une expérimentation prudente à un déploiement d'IA confiant et centré sur le client.

L'article AIUC-1 : The New Gold Standard for Trustworthy Enterprise AI est apparu en premier sur CX Quest.

Vous aimerez peut-être aussi

Le XRP est-il plus sûr que le Bitcoin ? Cet analyste explique le véritable risque quantique pour les détenteurs

Covenant AI quitte Bittensor en raison d'un « théâtre de décentralisation », TAO chute de 18 %