Accord d'OpenAI avec le Pentagone : Sam Altman Obtient un Contrat IA Crucial avec des Garanties Techniques

BitcoinWorld

Accord d'OpenAI avec le Pentagone : Sam Altman obtient un contrat crucial en IA avec des garanties techniques

Dans une évolution majeure pour la gouvernance de l'intelligence artificielle, le PDG d'OpenAI, Sam Altman, a annoncé un contrat de défense important avec le Département de la Défense le vendredi 13 octobre 2025, établissant des garanties techniques qui répondent aux préoccupations éthiques cruciales concernant les applications militaires de l'IA. Cet accord fait suite à un affrontement controversé entre le Pentagone et la société d'IA concurrente Anthropic, soulignant l'intersection complexe entre sécurité nationale, innovation technologique et valeurs démocratiques dans un monde de plus en plus automatisé.

L'accord d'OpenAI avec le Pentagone et ses garanties techniques

Sam Altman a révélé qu'OpenAI a conclu un accord permettant au Département de la Défense d'accéder à ses modèles d'IA au sein de réseaux classifiés. Fait important, le contrat inclut des protections techniques spécifiques répondant à deux préoccupations éthiques fondamentales. Premièrement, l'accord interdit les applications de surveillance de masse nationale. Deuxièmement, il maintient la responsabilité humaine pour l'usage de la force, y compris les systèmes d'armes autonomes. Ces garanties représentent une position de compromis entre un accès militaire sans restriction et un refus corporatif total.

Selon la déclaration publique d'Altman, le Département de la Défense accepte ces principes et les a intégrés à la fois dans la loi et dans la politique. De plus, OpenAI mettra en œuvre des garanties techniques pour s'assurer que le comportement des modèles s'aligne sur ces restrictions. L'entreprise déploiera également des ingénieurs pour travailler aux côtés du personnel du Pentagone, facilitant la mise en œuvre appropriée des modèles et la surveillance continue de la sécurité. Cette approche collaborative distingue la stratégie d'OpenAI des positions industrielles plus antagonistes.

L'impasse avec Anthropic et les divisions éthiques

L'accord d'OpenAI émerge dans le contexte d'échecs de négociations entre le Pentagone et Anthropic. Pendant plusieurs mois, les responsables de la défense ont poussé les entreprises d'IA à autoriser l'utilisation de leurs modèles à « toutes fins légales ». Cependant, Anthropic a cherché des limitations explicites sur la surveillance de masse nationale et les armes entièrement autonomes. Le PDG Dario Amodei a soutenu que dans des cas spécifiques, l'IA pourrait saper les valeurs démocratiques plutôt que de les défendre.

Cette position éthique a attiré un soutien important des travailleurs technologiques. Plus de 60 employés d'OpenAI et 300 employés de Google ont signé une lettre ouverte soutenant la position d'Anthropic. La lettre appelait à une adoption à l'échelle de l'industrie de limites éthiques similaires, reflétant l'inquiétude croissante parmi les développeurs d'IA concernant les applications militaires potentielles de leurs technologies.

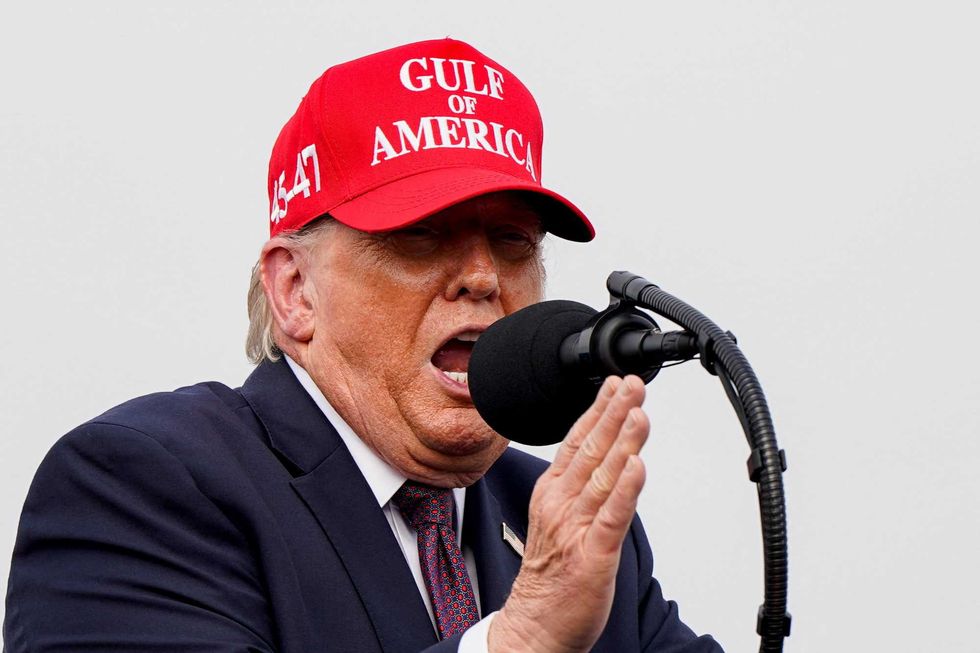

Le désaccord s'est transformé en confrontation publique avec l'administration Trump. Le président Donald Trump a critiqué Anthropic comme des « fous de gauche » dans une publication sur les réseaux sociaux. Il a ordonné aux agences fédérales de supprimer progressivement les produits de l'entreprise dans les six mois. Le secrétaire à la Défense Pete Hegseth a intensifié le conflit en désignant Anthropic comme un risque pour la chaîne d'approvisionnement. Cette désignation interdit aux entrepreneurs et partenaires faisant affaire avec l'armée de s'engager commercialement avec Anthropic.

Implications pour l'industrie et paysage réglementaire

Les résultats contrastés pour OpenAI et Anthropic révèlent des implications importantes pour l'industrie de l'IA. Les entreprises doivent désormais naviguer dans des relations complexes avec les entités gouvernementales tout en maintenant des normes éthiques et la confiance du public. L'approche d'OpenAI démontre que les accords négociés avec des garanties spécifiques représentent une voie viable. À l'inverse, l'expérience d'Anthropic montre les conséquences potentielles d'une position éthique plus ferme contre les demandes gouvernementales.

Cette situation se produit dans un contexte réglementaire plus large. Plusieurs nations développent des cadres pour les applications militaires de l'IA. Les Nations Unies ont mené des discussions continues sur les systèmes d'armes autonomes létaux. De plus, l'Union européenne a récemment mis en œuvre son AI Act, qui inclut des dispositions spécifiques pour les applications à haut risque. Ces développements mondiaux créent un environnement de plus en plus complexe pour les entreprises d'IA opérant dans les secteurs de la défense.

Mise en œuvre technique et protocoles de sécurité

L'accord d'OpenAI comprend plusieurs composants techniques conçus pour garantir la conformité aux garanties éthiques. Selon la journaliste de Fortune Sharon Goldman, Altman a informé les employés que le gouvernement permettra à OpenAI de construire sa propre « pile de sécurité » pour prévenir les abus. Cette infrastructure technique représente un composant critique de l'accord. De plus, si un modèle OpenAI refuse d'effectuer une tâche spécifique, le gouvernement ne peut pas forcer l'entreprise à modifier le comportement du modèle.

Ces mesures techniques répondent aux préoccupations fondamentales concernant la fiabilité et l'alignement des systèmes d'IA. Elles fournissent des mécanismes pour s'assurer que le comportement de l'IA reste dans les limites éthiques établies. Le déploiement d'ingénieurs d'OpenAI pour travailler directement avec le personnel du Pentagone facilite la mise en œuvre appropriée et la surveillance continue. Cette supervision technique collaborative représente une approche innovante des partenariats militaires-corporatifs dans les domaines technologiques sensibles.

Comparaison des approches des entreprises d'IA concernant les contrats militaires| Entreprise | Position | Garanties clés | Réponse gouvernementale |

|---|---|---|---|

| OpenAI | Accord négocié | • Pas de surveillance de masse nationale • Responsabilité humaine pour la force • Garanties techniques • Déploiement d'ingénieurs | Contrat attribué avec garanties |

| Anthropic | Limitations éthiques | • Pas de surveillance de masse • Pas d'armes autonomes • Protection des valeurs démocratiques | Désignation comme risque de chaîne d'approvisionnement Suppression progressive des produits ordonnée |

Contexte plus large et développements internationaux

L'accord OpenAI-Pentagone coïncide avec des développements internationaux significatifs. Peu après l'annonce d'Altman, des nouvelles ont émergé concernant les actions militaires américaines et israéliennes contre l'Iran. Le président Trump a appelé au renversement du gouvernement iranien. Ces développements simultanés soulignent le paysage géopolitique complexe dans lequel les technologies militaires d'IA sont déployées. Ils soulignent également l'actualité des considérations éthiques entourant les systèmes autonomes et les capacités de surveillance.

À l'échelle mondiale, les nations poursuivent des approches variées pour l'intégration militaire de l'IA :

- La Chine a poursuivi de manière agressive les applications militaires de l'IA avec moins de contraintes éthiques publiques

- La Russie a déployé des systèmes autonomes dans des zones de conflit avec une transparence limitée

- Les nations européennes ont généralement adopté des approches plus prudentes avec une surveillance plus forte

- Les Nations Unies poursuivent les discussions concernant les traités potentiels sur les armes autonomes

Ce contexte international crée des pressions concurrentielles qui influencent les décisions politiques nationales. Les États-Unis font face au défi de maintenir la supériorité technologique tout en défendant les valeurs démocratiques et les normes éthiques. L'accord OpenAI représente une approche pour équilibrer ces priorités concurrentes.

Perspectives des employés et éthique de l'industrie

La lettre ouverte signée par des centaines d'employés de l'IA révèle des tensions internes importantes dans l'industrie. Les travailleurs technologiques remettent de plus en plus en question les implications éthiques de leur travail, notamment concernant les applications militaires. Cet activisme des employés représente un phénomène relativement nouveau dans le secteur de la technologie de défense. Historiquement, les entrepreneurs de la défense faisaient face à moins de résistance interne aux applications militaires. Cependant, les entreprises d'IA attirent des employés avec de fortes convictions éthiques sur l'impact sociétal de la technologie.

Cette dynamique crée des défis de gestion pour les entreprises d'IA poursuivant des contrats de défense. La direction doit équilibrer les relations gouvernementales, les opportunités commerciales et les préoccupations des employés. L'approche d'OpenAI consistant à négocier des garanties spécifiques représente une stratégie pour répondre à ces pressions concurrentes. La volonté de l'entreprise de plaider publiquement pour l'adoption à l'échelle de l'industrie de termes similaires suggère une tentative d'établir des normes éthiques tout en maintenant l'accès gouvernemental.

Implications juridiques et politiques

La désignation d'Anthropic comme risque pour la chaîne d'approvisionnement soulève des questions juridiques importantes. L'entreprise a déclaré qu'elle contesterait toute telle désignation devant les tribunaux. Ce litige potentiel pourrait établir des précédents importants concernant l'autorité gouvernementale de restreindre les relations commerciales basées sur les positions éthiques des entreprises. Le résultat pourrait influencer la manière dont d'autres entreprises d'IA abordent des négociations similaires avec les entités gouvernementales.

Les experts en politique notent plusieurs considérations clés :

- L'équilibre entre les besoins de sécurité nationale et l'autonomie éthique des entreprises

- Le rôle approprié des garanties techniques dans les systèmes militaires d'IA

- Les mécanismes pour assurer la conformité aux restrictions éthiques

- Les implications internationales des différentes approches nationales

Ces questions politiques recevront probablement une attention accrue dans les mois à venir. Les comités du Congrès ont déjà annoncé des audiences sur l'éthique militaire de l'IA. De plus, plusieurs groupes de réflexion et institutions de recherche développent des cadres politiques pour un déploiement responsable de l'IA militaire.

Conclusion

L'accord d'OpenAI avec le Pentagone et ses garanties techniques représente une étape importante dans l'intégration militaire de l'IA. L'accord démontre que les approches négociées avec des protections éthiques spécifiques peuvent faciliter l'accès gouvernemental tout en répondant aux préoccupations légitimes. Cependant, l'expérience contrastée avec Anthropic révèle des tensions persistantes entre les priorités de sécurité nationale et les normes éthiques des entreprises. À mesure que les technologies d'IA continuent de progresser, ces relations complexes nécessiteront une navigation prudente. Les garanties techniques établies dans l'accord d'OpenAI pourraient servir de modèle pour les futurs partenariats militaires-corporatifs. En fin de compte, le paysage évolutif des applications militaires de l'IA exigera un dialogue continu entre les entités gouvernementales, les entreprises technologiques, les employés et la société civile pour garantir une innovation responsable qui protège à la fois la sécurité et les valeurs démocratiques.

FAQ

Q1 : Quelles garanties spécifiques l'accord d'OpenAI avec le Pentagone inclut-il ?

L'accord interdit les applications de surveillance de masse nationale et maintient la responsabilité humaine pour l'usage de la force, y compris les systèmes d'armes autonomes. OpenAI mettra en œuvre des garanties techniques et déploiera des ingénieurs pour assurer la conformité.

Q2 : Pourquoi les négociations d'Anthropic avec le Pentagone ont-elles échoué ?

Anthropic a cherché des limitations explicites sur la surveillance de masse nationale et les armes entièrement autonomes, tandis que le Pentagone poussait pour un accès à « toutes fins légales ». Ce désaccord fondamental a empêché un accord négocié.

Q3 : Quelles conséquences Anthropic a-t-elle subies pour sa position éthique ?

Le président Trump a ordonné aux agences fédérales de supprimer progressivement les produits d'Anthropic, et le secrétaire à la Défense Hegseth a désigné l'entreprise comme un risque pour la chaîne d'approvisionnement, interdisant aux entrepreneurs militaires de faire affaire avec elle.

Q4 : Comment les employés de l'industrie de l'IA ont-ils réagi à ces développements ?

Plus de 360 employés d'OpenAI et de Google ont signé une lettre ouverte soutenant la position éthique d'Anthropic, reflétant une préoccupation interne importante concernant les applications militaires de l'IA.

Q5 : Quelles implications plus larges cette situation a-t-elle pour la gouvernance de l'IA ?

Les résultats contrastés mettent en évidence l'équilibre complexe entre sécurité nationale, éthique des entreprises et innovation technologique, influençant potentiellement la manière dont d'autres nations et entreprises abordent l'intégration militaire de l'IA.

Cet article Accord d'OpenAI avec le Pentagone : Sam Altman obtient un contrat crucial en IA avec des garanties techniques est apparu en premier sur BitcoinWorld.

Vous aimerez peut-être aussi

« Scandaleux » : MAGA stupéfait après que le sondeur révèle la décision de l'administration Trump avant l'opération militaire

Le Bitcoin est en baisse de 48%, mais les plus gros acheteurs de l'histoire continuent d'accumuler