AIUC-1: विश्वसनीय एंटरप्राइज़ AI के लिए नया गोल्ड स्टैंडर्ड

CX विश्वास अंतर को पाटना: AIUC-1 के साथ जिम्मेदार AI

एक CX निदेशक, Maria की कल्पना करें, जो CEO के साथ एक तनावपूर्ण वीडियो कॉल पर हैं। "पिछले हफ्ते हमारे AI चैटबॉट ने एक VIP ग्राहक की गलत पहचान की और गलती से उन्हें एक प्रतिस्पर्धी की मूल्य सूची ईमेल कर दी," CEO गुस्से में कहते हैं। डेटा लीक हो गया है; ग्राहक का विश्वास टूट गया है। इसके बाद की अराजकता में, IT प्रोडक्ट को दोष देता है, प्रोडक्ट लीगल को दोष देता है, और मार्केटिंग टीम को यह भी नहीं पता कि क्या हुआ। Maria को दर्दनाक रूप से एहसास होता है कि अलग-थलग टीमों और तेजी से लागू की गई AI रोलआउट्स ने महत्वपूर्ण डेटा और प्राइवेसी गार्डरेल्स को अपरिभाषित छोड़ दिया – और अब उनके ब्रांड की प्रतिष्ठा एक धागे से लटकी है।

यह परिदृश्य काल्पनिक नहीं है। जैसे-जैसे AI चैटबॉट्स, वॉइस एजेंट्स और रेकमेंडेशन इंजन ग्राहक टचपॉइंट्स में बाढ़ ला रहे हैं, त्रुटियां और अपारदर्शी डेटा प्रथाएं रातों-रात विश्वास को नष्ट कर सकती हैं। एंटरप्राइजेज एक स्पष्ट दुविधा का सामना करते हैं: AI हाइपर-पर्सनलाइजेशन और दक्षता का वादा करता है, लेकिन गलतियां (भ्रमित उत्तर, अनधिकृत डेटा उपयोग, IP लीक) ग्राहक अनुभव को अपूरणीय रूप से नुकसान पहुंचा सकती हैं। CX और EX लीडर्स को एक नई प्लेबुक की आवश्यकता है – AI को जिम्मेदारी से संचालित करने के लिए एक संरचित ढांचा।

मुख्य अंतर्दृष्टि:

- जोखिम में विश्वास: AI विफलताएं (जैसे आत्मविश्वासपूर्ण गलत उत्तर या डेटा लीक) सीधे ग्राहक विश्वास और वफादारी को कमजोर करती हैं। सर्वेक्षण बताते हैं कि 53% उपभोक्ताओं को डर है कि AI द्वारा उनके व्यक्तिगत डेटा का दुरुपयोग किया जाएगा, और लगभग आधे तभी अधिक डेटा साझा करेंगे जब कंपनियां अधिक पारदर्शिता और नियंत्रण प्रदान करें।

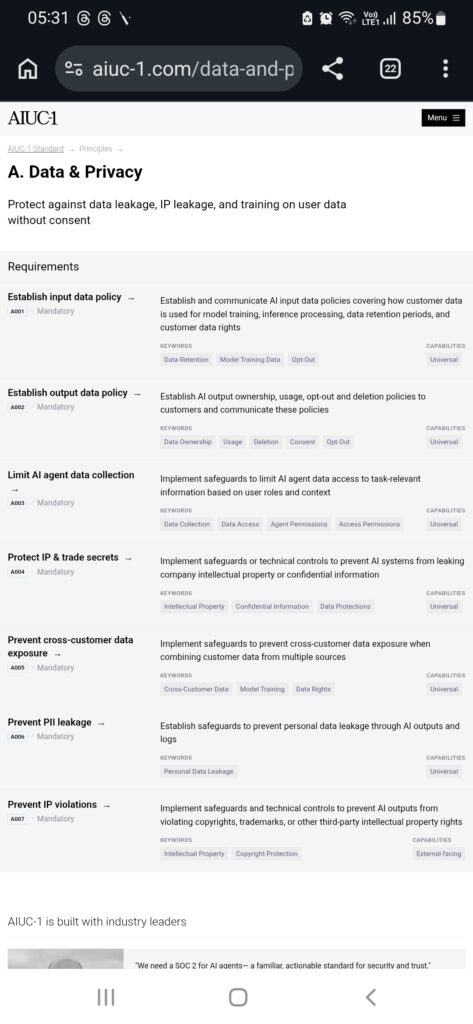

- पहला AI एजेंट मानक: AIUC-1 AI एजेंट्स के लिए दुनिया का पहला व्यापक मानक है, जिसे सुरक्षा और AI विशेषज्ञों द्वारा एंटरप्राइज-स्केल चिंताओं को संबोधित करने के लिए विकसित किया गया है। यह मुख्य जोखिम डोमेन (डेटा और प्राइवेसी, सुरक्षा, सेफ्टी, विश्वसनीयता, जवाबदेही, समाज) को कवर करता है, जो AI अपनाने के लिए एक सामान्य "विश्वास बुनियादी ढांचा" बनाता है।

- अनिवार्य डेटा/प्राइवेसी नियंत्रण: AIUC-1 सख्त डेटा और प्राइवेसी आवश्यकताओं को लागू करता है। उदाहरण के लिए, इसे स्पष्ट इनपुट/आउटपुट डेटा पॉलिसी, डेटा संग्रह पर सीमाएं, और PII या व्यापार रहस्यों के लीक होने के खिलाफ तकनीकी सुरक्षा उपायों की आवश्यकता होती है। इन गार्डरेल्स का उद्देश्य Maria की कंपनी द्वारा अनुभव की गई घटना जैसी घटनाओं को रोकना है।

- सर्टिफिकेशन और बीमा: AIUC-1 सर्टिफिकेशन का मतलब है कि एक AI सिस्टम ने कठोर परीक्षण (जोखिम परिदृश्यों में हजारों सिमुलेटेड विफलताओं) से गुजरा है। ElevenLabs जैसे पहले अपनाने वालों ने AIUC-1 प्रमाणपत्र और यहां तक कि अपने वॉइस एजेंट्स के लिए AI बीमा भी अर्जित किया है, जो ग्राहकों और भागीदारों को संकेत देता है कि उनका AI जांचा गया है।

- सहयोग महत्वपूर्ण है: AIUC-1 को Microsoft, Cisco, JPMorgan Chase, UiPath, ElevenLabs और अन्य के नेताओं द्वारा बनाया गया था, जो इस सहमति को दर्शाता है कि AI सुरक्षा/सेफ्टी के लिए क्रॉस-फंक्शनल कार्रवाई की आवश्यकता है। Microsoft के Secure Development Lifecycle for AI जैसे फ्रेमवर्क भी इसी तरह जोर देते हैं कि सुरक्षा एक कार्य करने का तरीका होना चाहिए, न कि केवल एक चेकबॉक्स।

- "AI-washing" के नुकसान: कई विक्रेता वास्तविक डेटा या सुरक्षा उपायों के बिना उत्पादों पर "AI" लगाते हैं, लेकिन ग्राहक जल्दी ही इसे देख लेते हैं। अतिशयोक्तिपूर्ण दावे (जैसे "एंटरप्राइज-ग्रेड AI" बिना किसी डेटा प्रोवेनेंस के) असंगत आउटपुट की ओर ले जाते हैं जो विश्वास को कमजोर करते हैं और चर्न बढ़ाते हैं। इससे भी बुरा, नियामक सख्ती कर रहे हैं: SEC और FTC ने भ्रामक AI दावों के लिए कंपनियों पर जुर्माना लगाया है।

सामान्य नुकसान: CX लीडर्स को ध्यान रखना चाहिए…

- AI-washing: नए डेटा या मॉडल के बिना "अनसुपरवाइज्ड" AI बॉट्स को तैनात करना। ग्राहक जल्दी ही शून्य सुधार देखते हैं, जो ब्रांड विश्वसनीयता को नुकसान पहुंचाता है।

- डेटा ओवररीच: स्पष्ट नीतियों के बिना "बस के मामले में" ग्राहक डेटा जमा करना, प्राइवेसी उल्लंघनों की ओर ले जाता है। जैसा कि Qualtrics सलाह देता है, "इसे रखने के लिए सब कुछ एकत्र करना बंद करें"; केवल वही एकत्र करें जो आपको चाहिए (सहमति और स्पष्ट उद्देश्य के साथ) विश्वास बनाता है।

- अलग-थलग गवर्नेंस: सुरक्षा, कानूनी और CX इनपुट की अनदेखी करते हुए AI को केवल एक इंजीनियरिंग टूल के रूप में मानना। अगर टीमें AI जोखिमों पर सहयोग नहीं करती हैं (जैसा कि Microsoft चेतावनी देता है), तो ग्राहक टचपॉइंट्स पर विश्वास अंतर उभरता है।

- रेड-टीमिंग को छोड़ना: प्रतिकूल परीक्षण या निगरानी के बिना जेनरेटिव AI फीचर्स लॉन्च करना। लेयर्ड सुरक्षा उपायों (जैसे प्रॉम्प्ट फिल्टर या एनोमली डिटेक्शन) के बिना, AI आउटपुट PII लीक कर सकते हैं, भ्रमित हो सकते हैं या IP का उल्लंघन कर सकते हैं।

- मानकों की अनदेखी: उभरते AI फ्रेमवर्क (जैसे AIUC-1, MITRE ATLAS) के साथ संरेखित करने में विफल रहना कंपनियों को ऑडिट या बीमा के लिए अप्रस्तुत छोड़ देता है। परिणाम रुकी हुई परियोजनाएं, कानूनी जोखिम और खोया हुआ ग्राहक वफादारी है।

- अपारदर्शी AI उपयोग: ग्राहकों को सूचित नहीं करना कि AI का उपयोग कब किया जा रहा है या उनके डेटा का उपयोग कैसे किया जा रहा है। यह "ब्लैक बॉक्स" दृष्टिकोण जल्दी ही अविश्वास के रूप में महसूस किया जाता है; जेनरेटिव AI के युग में पारदर्शिता गैर-परक्राम्य है।

AIUC-1 क्या है और CX के लिए यह क्यों मायने रखता है?

AIUC-1 विशेष रूप से AI एजेंट्स के लिए पहला उद्योग-मानक फ्रेमवर्क है, जो डेटा/प्राइवेसी, सुरक्षा, सेफ्टी और अधिक को कवर करता है। यह सर्वोत्तम प्रथाओं (और तकनीकी नियंत्रणों) को संहिताबद्ध करता है ताकि एंटरप्राइजेज AI जोखिम को लगातार माप और प्रबंधित कर सकें। व्यावहारिक रूप से, AIUC-1 CX टीमों को किसी भी AI समाधान का आकलन करने के लिए एक सामान्य भाषा देता है: "क्या यह एजेंट सुरक्षित, विश्वसनीय और ग्राहक डेटा का सम्मान करने वाला है?" उन उत्तरों को मानकीकृत करके, AIUC-1 विश्वास बुनियादी ढांचा बनाता है जो एंटरप्राइज AI अपनाने को अनलॉक करता है।

डेटा और प्राइवेसी मुद्दे विश्वास अंतर कैसे बनाते हैं?

ग्राहक विश्वास उस क्षण टूट जाता है जब एक AI एजेंट व्यक्तिगत डेटा का दुरुपयोग करता है या गोपनीय जानकारी लीक करता है। आधुनिक AI सिस्टम बिखरे हुए डेटा पर आकर्षित होते हैं और उनकी "संभाव्य मेमोरी" होती है, जिसका अर्थ है कि वे गलती से PII या बौद्धिक संपदा का खुलासा कर सकते हैं जब तक कि कड़ाई से नियंत्रित न किया जाए। उदाहरण के लिए, एक AI बॉट जो अनजाने में CRM प्रविष्टियों पर ट्रेन करता है, खुले में संवेदनशील ग्राहक विवरण उगल सकता है। CX विशेषज्ञ चेतावनी देते हैं कि ऐसे लीक – या AI मॉडल अपडेट होने पर अप्रत्याशित व्यवहार भी – सीधे ग्राहक अनुभव को कमजोर करते हैं। विनियमित उद्योगों में, यह कानूनी और अनुपालन टूटने को भी आमंत्रित करता है।

AIUC-1 स्पष्ट डेटा नीतियों और नियंत्रणों को अनिवार्य करके इन जोखिमों का मुकाबला करता है। यह टीमों को परिभाषित करने के लिए मजबूर करता है कि इनपुट डेटा का उपयोग और सुरक्षा कैसे की जाती है (A001), AI किस आउटपुट को जेनरेट कर सकता है और उनका मालिक कौन है (A002), और डेटा संग्रह को कार्य के लिए प्रासंगिक तक सीमित करना (A003)। ये कदम सुनिश्चित करते हैं कि एक ग्राहक का व्यक्तिगत या कॉर्पोरेट डेटा बिना निगरानी के AI द्वारा उपभोग या बनाए नहीं रखा जाता है। संक्षेप में, स्पष्ट इनपुट/आउटपुट गवर्नेंस और एक्सेस नियंत्रण ग्राहक जानकारी के दुरुपयोग के खिलाफ रक्षा की पहली पंक्ति हैं।

AIUC-1 कौन से डेटा और प्राइवेसी नियंत्रण लागू करता है?

AIUC-1 AI सिस्टम में डेटा उपयोग को लॉक करने के लिए कई अनिवार्य आवश्यकताओं को सूचीबद्ध करता है। मुख्य उदाहरणों में शामिल हैं: इनपुट डेटा पॉलिसी स्थापित करना (ग्राहक डेटा को ट्रेनिंग या इनफेरेंस के लिए कब और कैसे उपयोग किया जाता है, और डेटा प्रतिधारण/अधिकार); आउटपुट डेटा पॉलिसी को औपचारिक बनाना (AI-जेनरेटेड डेटा का मालिक कौन है, उपयोग अधिकार, ऑप्ट-आउट और डिलीशन प्रक्रियाओं को परिभाषित करना); और AI डेटा संग्रह को सीमित करना भूमिकाओं के आधार पर सख्ती से कार्य-प्रासंगिक इनपुट तक।

महत्वपूर्ण रूप से, AIUC-1 तकनीकी सुरक्षा उपायों को भी अनिवार्य बनाता है: AI को कंपनी IP या व्यापार रहस्यों को लीक करने से रोकें (A004); जब एक AI में मल्टी-टेनेंट इनपुट हों तो किसी भी क्रॉस-कस्टमर डेटा मिक्सिंग को ब्लॉक करें (A005); आउटपुट या लॉग के माध्यम से PII लीकेज को रोकें (A006); और सुनिश्चित करें कि AI आउटपुट तीसरे पक्ष के कॉपीराइट या ट्रेडमार्क का उल्लंघन नहीं करते (A007)। संयुक्त रूप से, ये नियंत्रण अमूर्त प्राइवेसी लक्ष्यों को ठोस जांचों में बदल देते हैं: डेटासेट्स का ऑडिट करना, लॉग को एन्क्रिप्ट करना, मॉडल को सैंडबॉक्स करना, और DPIA-जैसी समीक्षाओं को लागू करना। CX लीडर्स के लिए, परिणाम मापने योग्य है: नीतियां और उपकरण जो ग्राहकों को दिखाते हैं "हमारा AI आपके डेटा या किसी और के डेटा का दुरुपयोग नहीं करेगा।"

AIUC-1 सर्टिफिकेशन विश्वास को कैसे फिर से बनाता है?

एक AIUC-1 प्रमाणपत्र का मतलब है कि एक AI एजेंट सुरक्षा, प्राइवेसी और सेफ्टी परिदृश्यों में 5,000 से अधिक प्रतिकूल सिमुलेशन पास कर चुका है। वास्तव में, यह एक तीसरे पक्ष की मुहर है कि "यह AI परीक्षण किया गया है और सुरक्षित है।" ग्राहकों और भागीदारों के लिए, यह शक्तिशाली है। ElevenLabs रिपोर्ट करता है कि AIUC-1 अर्जित करने से उन्हें अपने AI वॉइस एजेंट्स को कर्मचारियों की तरह बीमा करने में सक्षम बनाया – भ्रम से लेकर लीक तक की गलतियों को कवर करना। जैसा कि AI Underwriting सह-संस्थापक बताते हैं, "प्रमुख बीमाकर्ता इस सर्टिफिकेशन-आधारित दृष्टिकोण में इतने आश्वस्त हैं कि वे इसे अर्जित करने वालों को AI-विशिष्ट वित्तीय कवरेज प्रदान कर रहे हैं। ElevenLabs पहली कंपनी है जिसने साबित किया कि यह मॉडल बड़े पैमाने पर काम करता है।"

व्यवहार में, सर्टिफिकेशन + बीमा जोखिम को स्थानांतरित करता है। अज्ञात से डरने के बजाय ("क्या होगा अगर हमारा चैटबॉट बेकाबू हो जाता है?"), कंपनियां फ्रेमवर्क पर दायित्व को धकेल सकती हैं: अगर AIUC-1 गार्डरेल्स के बावजूद AI अभी भी विफल रहता है, तो नुकसान कवर किया जाता है। यह मुख्य वर्कफ्लो में AI का उपयोग करने के लिए एक विशाल मनोवैज्ञानिक बाधा को हटा देता है। जैसा कि ElevenLabs के सह-संस्थापक नोट करते हैं, AIUC-1 (और इसके द्वारा अनलॉक किया गया बीमा) भागीदारों को "सुरक्षा ढांचा और AI बीमा कवरेज जो उन्हें चाहिए" देकर एंटरप्राइज तैनाती को तेज करता है। CX/EX लीडर्स के लिए, इसका मतलब है अधिक पायलट प्रोजेक्ट प्रोडक्शन में स्नातक हो रहे हैं, और ग्राहक विश्वास बनाते समय एक मजबूत बिक्री बिंदु।

CX/EX लीडर्स जिम्मेदार AI के लिए कैसे तैयारी कर सकते हैं?

गवर्नेंस और नीतियों से शुरुआत करें, न कि केवल प्रौद्योगिकी से। अभी अपने डेटा उपयोग नियमों को परिभाषित करें: तय करें कि कौन सा ग्राहक डेटा AI मॉडल को फीड करेगा, यह कितने समय तक संग्रहीत है, और उपयोगकर्ता कैसे ऑप्ट आउट कर सकते हैं। क्रॉस-फंक्शनल टीमों को जल्दी शामिल करें – कानूनी, सुरक्षा, डेटा साइंस और प्रोडक्ट – Microsoft SDL दृष्टिकोण को दर्शाते हुए जो सुरक्षा को एक सहयोगी डिजाइन सिद्धांत के रूप में मानता है। अगला, आंतरिक रूप से और ग्राहकों के लिए पारदर्शिता की मांग करें। उदाहरण के लिए, Microsoft की लीड का पालन करें स्पष्ट रूप से खुलासा करके जब एक उपयोगकर्ता AI के साथ इंटरैक्ट कर रहा है और उन्हें अपने डेटा पर नियंत्रण दे रहा है।

AIUC-1 जैसे मानकों को एक उत्तर सितारे के रूप में अपनाएं। AI विक्रेताओं और इन-हाउस प्रोजेक्ट्स का ऑडिट करने के लिए इसकी डेटा/प्राइवेसी चेकलिस्ट का उपयोग करें: क्या हम डेटा संग्रह को सीमित कर रहे हैं? लॉग को एन्क्रिप्ट कर रहे हैं? PII इनफरेंस को रोक रहे हैं? यदि नहीं, तो अभी उन नियंत्रणों में निवेश करें। अपनी AI परिसंपत्तियों को स्कोप करने के लिए एक मान्यता प्राप्त ऑडिटर को संलग्न करें – AIUC-1 कंसोर्टियम मार्गदर्शन प्रदान करता है कि प्रत्येक नियंत्रण कहां लागू होता है। मुख्य AI एजेंट्स के लिए सर्टिफिकेशन पायलट करने पर विचार करें; उदाहरण के लिए, वॉइस या सेल्स बॉट्स अक्सर CX परिवर्तनों में पहले सामने आते हैं। जैसा कि ElevenLabs का उदाहरण दिखाता है, बिल्ट-इन सुरक्षा उपायों को एकीकृत करना सर्टिफिकेशन को तेज कर सकता है: उनके एक ग्राहक ने केवल चार सप्ताह में 24/7 संपत्ति-पूछताछ वॉइस बॉट को प्रमाणित किया।

अंत में, ग्राहक फीडबैक पर मापें और पुनरावृत्ति करें। AI-संचालित इंटरैक्शन की बारीकी से निगरानी करें: क्या ग्राहक AI टचपॉइंट के बाद छोड़ रहे हैं या शिकायतें बढ़ा रहे हैं? AI परीक्षणों को चूक सकने वाले मुद्दों को पकड़ने के लिए CX मेट्रिक्स का उपयोग करें। और याद रखें, विश्वास समय के साथ अर्जित किया जाता है – जैसा कि एक Qualtrics विशेषज्ञ कहते हैं, वास्तविक AI मूल्य "कनेक्शन बनाने और मानव अनुभव को बढ़ाने से आता है, सक्षम AI एजेंट्स सरल कार्यों का प्रबंधन करते हैं और जटिल मुद्दों पर मानव एजेंटों की सहायता करते हैं"। जहां यह सबसे अधिक मायने रखता है वहां मनुष्यों को लूप में रखें, और AI को अपने नए गवर्नेंस गार्डरेल्स के भीतर बाकी को संभालने दें।

अक्सर पूछे जाने वाले प्रश्न

AIUC-1 वास्तव में क्या है?

AIUC-1 AI "एजेंट्स" (सॉफ्टवेयर बॉट्स और असिस्टेंट्स) के लिए एक नया उद्योग मानक और सर्टिफिकेशन फ्रेमवर्क है जो सभी प्रमुख जोखिम श्रेणियों को कवर करता है। इसे Microsoft, Cisco, JPMorgan Chase, UiPath और ElevenLabs जैसी कंपनियों के विशेषज्ञों द्वारा बनाया गया था ताकि एंटरप्राइजेज को AI सिस्टम का मूल्यांकन करते समय एक स्पष्ट फ्रेमवर्क (AI के लिए "SOC 2" की तरह) मिल सके। AIUC-1 आवश्यकताओं को पूरा करके, एक AI उत्पाद प्रदर्शित करता है कि इसका सुरक्षा, डेटा प्राइवेसी, विश्वसनीयता और अन्य चिंताओं के लिए परीक्षण किया गया है।

AIUC-1 किन डेटा और प्राइवेसी मुद्दों को संबोधित करता है?

मानक डेटा उपयोग पर विशिष्ट नियंत्रण अनिवार्य करता है: AI इनपुट और आउटपुट डेटा के लिए लिखित नीतियों की स्थापना (ट्रेनिंग, प्रतिधारण, डिलीशन और ग्राहक ऑप्ट-आउट सहित); AI को अप्रासंगिक या अत्यधिक डेटा तक पहुंचने से प्रतिबंधित करना; और व्यक्तिगत डेटा, IP लीक करने या विभिन्न ग्राहकों से डेटा मिश्रण के खिलाफ सुरक्षा उपाय जोड़ना। संक्षेप में, यह संगठनों को लॉक करने के लिए मजबूर करता है कि ग्राहक डेटा उनके AI के माध्यम से कैसे प्रवाहित होता है, प्राइवेसी उल्लंघनों को रोकना जो विश्वास को नष्ट करते हैं।

AIUC-1 सर्टिफिकेशन ग्राहक विश्वास को कैसे फिर से बनाता है?

AIUC-1 प्रमाणित (और बीमित) होना ग्राहकों को संकेत देता है कि AI सिस्टम ने ज्ञात विफलता मोड के खिलाफ कठोर परीक्षण पारित किया है। यह आपके AI के लिए एक सुरक्षा निरीक्षण रिपोर्ट दिखाने जैसा है। एंटरप्राइजेज तब ईमानदारी से ग्राहकों को बता सकते हैं: "हमारे AI के पास सत्यापन योग्य सुरक्षा उपाय हैं और यहां तक कि बीमा कवरेज भी है।" शुरुआती अपनाने वाले रिपोर्ट करते हैं कि यह विश्वसनीयता अनुबंधों और तैनाती को तेज करती है। व्यवहार में, सर्टिफिकेशन का मतलब है कम ऑन-ब्रांड स्लिप-अप्स – और यदि सर्टिफिकेशन के बावजूद कोई घटना होती है, तो बीमा फॉलआउट को कवर कर सकता है। यह जवाबदेही लूप वह है जो व्यापार नेताओं और ग्राहकों की नजर में AI को एक अज्ञात जुए से एक प्रबंधित सेवा में बदल देता है।

यदि हम इन मानकों को छोड़ते हैं तो क्या होता है?

AI गवर्नेंस को अनदेखा करना विश्वास बाढ़ के दरवाजे खोलता है। स्पष्ट नीतियों या परीक्षण के बिना, AI एजेंट डेटा लीक कर सकते हैं, कॉपीराइट का उल्लंघन कर सकते हैं या खतरनाक रूप से बुरी सलाह दे सकते हैं। ग्राहक नोटिस करेंगे – उदाहरण के लिए, बॉट्स असंगत या भ्रामक उत्तर देने से वफादारी को नष्ट कर देंगे। नियामक और उद्योग भी निगरानी कड़ी कर रहे हैं। कंपनियां जो "AI-wash" करती हैं (उचित नियंत्रण के बिना AI का उपयोग करने का दिखावा करती हैं) कानूनी कार्रवाई का जोखिम उठाती हैं: SEC और FTC ने पहले ही भ्रामक AI दावों के लिए फर्मों को मंजूरी दी है। संक्षेप में, मानकों को छोड़ने का मतलब है ब्रांड क्षति, अनुपालन जुर्माना और खोए हुए ग्राहकों का जोखिम।

CX लीडर्स AIUC-1 प्रथाओं को अपनाना कैसे शुरू कर सकते हैं?

अपने AI टूल्स और डेटा फ्लो की इन्वेंट्री करके शुरू करें: वर्गीकृत करें कि कौन से सिस्टम ग्राहक डेटा संभालते हैं या ग्राहकों के साथ इंटरैक्ट करते हैं, और AIUC-1 के नियंत्रण चेकलिस्ट के खिलाफ तुलना करें। अपनी AI डेटा प्राइवेसी पॉलिसी विकसित करें या अपडेट करें (इनपुट, आउटपुट, प्रतिधारण और ग्राहक अधिकारों को कवर करते हुए)। आवश्यक तकनीकी नियंत्रणों को लागू करने के लिए अपनी सुरक्षा और कानूनी टीमों के साथ काम करें (जैसे डेटा मिनिमाइजेशन, एन्क्रिप्शन, मॉनिटरिंग)। सर्टिफिकेशन को स्कोप करने के लिए जल्दी एक मान्यता प्राप्त AIUC-1 ऑडिटर को संलग्न करें। भले ही पूर्ण सर्टिफिकेशन एक लंबी अवधि का लक्ष्य है, अपने AI सिस्टम को अभी सख्त करने के लिए मानक की आवश्यकताओं का उपयोग गैप विश्लेषण के रूप में करें। अंत में, जैसे-जैसे आप सुधार करते हैं स्टेकहोल्डर्स (और ग्राहकों) के साथ संवाद करते रहें: इन प्रयासों के बारे में पारदर्शिता स्वयं आपकी AI पहलों में विश्वास को फिर से बनाने में मदद करेगी।

कार्रवाई योग्य निष्कर्ष:

- स्पष्ट डेटा नीतियों को परिभाषित करें: लिखें कि AI ट्रेनिंग बनाम इनफेरेंस के लिए ग्राहक डेटा का उपयोग कैसे करेगा, प्रतिधारण सीमाएं सेट करें, और ऑप्ट-आउट/डिलीशन अधिकार प्रदान करें।

- AIUC-1 को एक फ्रेमवर्क के रूप में अपनाएं: सभी AI प्रोजेक्ट्स में सुरक्षा, प्राइवेसी और सेफ्टी जांच को एकीकृत करने के लिए इसके सिद्धांतों का उपयोग करें। उच्च जोखिम वाले AI एजेंट्स के लिए सर्टिफिकेशन पायलट करने पर विचार करें।

- टीमों में सहयोग करें: AI रोलआउट निर्णयों में IT, कानूनी, अनुपालन और CX को शामिल करके साइलो तोड़ें। AI जोखिम प्रबंधन को एक साझा मिशन के रूप में मानें।

- डिजाइन द्वारा सुरक्षा एम्बेड करें: लॉन्च से पहले, AI एजेंट्स को स्ट्रेस-टेस्ट करें (रेड-टीमिंग, प्रॉम्प्ट इंजेक्शन) और लीक या दुर्व्यवहार को रोकने के लिए रनटाइम गार्डरेल्स (मॉड्यूलेशन, एनोमली अलर्ट्स) तैनात करें।

- AI बीमा का लाभ उठाएं: AIUC-1 सर्टिफिकेशन या बीमा बैकस्टॉप वाले AI विक्रेताओं की तलाश करें। यह प्रोत्साहनों को संरेखित करता है और यदि AI गलती करता है तो वित्तीय सुरक्षा प्रदान करता है।

- उपयोगकर्ताओं के साथ पारदर्शी रहें: ग्राहकों को सूचित करें जब AI उपयोग में है और उन्हें बताएं कि उनके डेटा को कैसे संभाला जाता है, Microsoft के Copilot अभ्यास से वास्तविक समय खुलासे।

- केवल आवश्यक डेटा एकत्र करें: मात्रा से अधिक गुणवत्ता को प्राथमिकता दें। जैसे-जैसे उपयोगकर्ता प्राइवेसी की मांग करते हैं, सेवा के लिए आवश्यक जानकारी ही एकत्र करें और स्पष्ट रूप से समझाएं कि यह उनके अनुभव को कैसे बेहतर बनाता है।

- स्टाफ को प्रशिक्षित और मॉनिटर करें: सुनिश्चित करें कि ग्राहक-सामना करने वाली टीमें AI सीमाओं को समझती हैं और स्पष्ट एस्केलेशन पथ हैं। मुद्दों (जैसे धीमी प्रतिक्रिया या असंतोष) को जल्दी पकड़ने के लिए AI रोलआउट के बाद CX मेट्रिक्स ट्रैक करें।

AI जोखिमों को सीधे संबोधित करके और AIUC-1 जैसे फ्रेमवर्क को अपनाकर, CX और EX लीडर्स विश्वास अंतर को बंद कर सकते हैं। खंडित यात्राओं और तेजी से AI विकास के परिदृश्य में, यह है कि कंपनियां सावधान प्रयोग से आत्मविश्वासपूर्ण, ग्राहक-केंद्रित AI तैनाती की ओर कैसे बढ़ती हैं।

पोस्ट AIUC-1: The New Gold Standard for Trustworthy Enterprise AI पहली बार CX Quest पर दिखाई दी।

आपको यह भी पसंद आ सकता है

Binance के CZ ने OKX के Founder को डिवोर्स विवाद पर $1 Billion की शर्त लगाई

स्टार्कवेयर शोधकर्ता ने क्वांटम-सुरक्षित Bitcoin लेनदेन योजना प्रकाशित की