ट्रम्प के प्रतिबंध के बावजूद अमेरिकी सेना ने ईरान हमले के लिए Anthropic का उपयोग किया: WSJ

रिपोर्ट के अनुसार, अमेरिकी सेना ने ईरान में एक बड़े हवाई हमले के दौरान Anthropic के Claude AI का उपयोग किया, यह विकास राष्ट्रपति डोनाल्ड ट्रंप द्वारा संघीय एजेंसियों को मॉडल के उपयोग को रोकने का आदेश देने के कुछ घंटे बाद सामने आया। क्षेत्र में कमांड, जिसमें CENTCOM शामिल है, ने कथित तौर पर खुफिया विश्लेषण, लक्ष्य जांच और युद्धक्षेत्र सिमुलेशन का समर्थन करने के लिए Claude का उपयोग किया। यह प्रकरण इस बात पर प्रकाश डालता है कि रक्षा संचालन में AI उपकरण कितनी गहराई से बुने गए हैं, भले ही नीति निर्माता कुछ विक्रेताओं के साथ संबंध तोड़ने का प्रयास कर रहे हों। यह प्रकरण कार्यकारी निर्देशों और जमीनी स्वचालन के बीच तनाव को रेखांकित करता है जो रक्षा कार्यक्रमों में खरीद और जोखिम प्रबंधन को प्रभावित कर सकता है।

मुख्य बातें

- <li Claude AI को कथित तौर पर एक बड़े हवाई हमले के संबंध में खुफिया विश्लेषण, लक्ष्य जांच और युद्धक्षेत्र सिमुलेशन के लिए तैनात किया गया था, व्हाइट हाउस के सिस्टम के उपयोग को रोकने के निर्देश के कुछ घंटे बाद।

-

<li Anthropic ने पहले $200 मिलियन तक के मूल्य का एक बहुवर्षीय पेंटागन अनुबंध प्राप्त किया था, जिसमें Claude के लिए वर्गीकृत कार्यप्रवाह को सक्षम करने के लिए Palantir और Amazon Web Services के साथ सहयोग शामिल था।

-

<li ट्रंप प्रशासन ने एजेंसियों को Anthropic के साथ काम करना बंद करने का निर्देश दिया और रक्षा विभाग को कंपनी को एक संभावित सुरक्षा जोखिम के रूप में मानने का निर्देश दिया, जब अप्रतिबंधित सैन्य उपयोग पर अनुबंध वार्ता टूट गई।

-

<li पेंटागन ने प्रतिस्थापन प्रदाताओं की पहचान करना शुरू कर दिया और वर्गीकृत नेटवर्क पर अन्य AI मॉडल तैनात करना शुरू किया, जिसमें ऐसी तैनाती के लिए OpenAI के साथ सहयोग शामिल है।

-

<li Anthropic के CEO Dario Amodei ने सार्वजनिक रूप से प्रतिबंध के खिलाफ धक्का दिया, यह तर्क देते हुए कि कुछ सैन्य अनुप्रयोग नैतिक सीमाओं को पार करते हैं और स्वचालित, बड़े पैमाने पर निगरानी या स्वायत्त हथियारकरण के बजाय मानव निरीक्षण के तहत रहना चाहिए।

भावना: तटस्थ

बाजार संदर्भ: यह प्रकरण रक्षा खरीद, AI नैतिकता, और राष्ट्रीय-सुरक्षा जोखिम प्रबंधन के चौराहे पर स्थित है क्योंकि एजेंसियां विक्रेता निर्भरता और संवेदनशील संचालन के लिए AI उपकरणों के वर्गीकरण का पुनर्मूल्यांकन करती हैं।

यह क्यों मायने रखता है

यह घटना एक दुर्लभ झलक प्रदान करती है कि कैसे वाणिज्यिक AI मॉडल उच्च-दांव वाले सैन्य कार्यप्रवाह में एकीकृत होते हैं। Claude, मूल रूप से व्यापक संज्ञानात्मक कार्यों के लिए डिज़ाइन किया गया, कथित तौर पर खुफिया विश्लेषण और युद्धक्षेत्र परिदृश्यों के मॉडलिंग का समर्थन करता है, जो परिचालन विश्वास के एक स्तर का सुझाव देता है जो प्रयोगशाला वातावरण से परे वास्तविक दुनिया के मिशनों में फैला हुआ है। यह युद्ध योजना में AI की विश्वसनीयता, ऑडिटिंग और नियंत्रणीयता के बारे में महत्वपूर्ण प्रश्न उठाता है, विशेष रूप से जब सरकारी नीति संकेत विक्रेता उपयोग के आसपास तेजी से बदलते हैं।

नीति स्तर पर, एक अनुबंध संबंध और एक राष्ट्रपति निर्देश के बीच घर्षण एक व्यापक बहस को उजागर करता है कि सुरक्षित वातावरण में AI विक्रेताओं के साथ कैसे व्यवहार किया जाना चाहिए। Anthropic का अप्रतिबंधित सैन्य उपयोग देने से इनकार उसकी घोषित नैतिक सीमाओं के साथ संरेखित होता है, यह संकेत देते हुए कि निजी-क्षेत्र के प्रदाता तेजी से उन विन्यासों के खिलाफ धक्का दे सकते हैं जिन्हें वे नैतिक रूप से समस्याग्रस्त मानते हैं। पेंटागन की प्रतिक्रिया—वर्गीकृत कार्यभार के लिए वैकल्पिक आपूर्तिकर्ताओं की ओर मुड़ना—यह दर्शाता है कि कैसे रक्षा विभाग संवेदनशील संचालन में क्षमता बनाए रखते हुए जोखिम जोखिम को कम करने के लिए AI पारिस्थितिकी प्रणालियों में विविधता ला सकते हैं।

तनाव AI-as-a-service बाजार की प्रतिस्पर्धी गतिशीलता को भी छूता है। OpenAI कथित तौर पर वर्गीकृत नेटवर्क के लिए मॉडल प्रदान करने के लिए कदम रख रहा है, क्षेत्र में सुरक्षा वर्गीकरण, डेटा शासन और आपूर्ति-श्रृंखला जोखिम के आसपास शर्तों के निरंतर प्रयोग और पुनर्बातचीत की संभावना है। स्थिति सख्त शासन ढांचे की आवश्यकता को रेखांकित करती है जो परिचालन सुरक्षा या नैतिक मानकों से समझौता किए बिना तेजी से तकनीकी परिवर्तन के अनुकूल हो सकते हैं।

आगे क्या देखना है

- रक्षा विभाग और व्हाइट हाउस से AI विक्रेता उपयोग और सुरक्षा वर्गीकरण के संबंध में नियामक और नीति अपडेट।

- कोई भी नई खरीद या साझेदारी जो वर्गीकृत मिशनों के लिए AI क्षमताओं का विस्तार करती है, जिसमें Anthropic की पेशकशों को बदलने या पूरक करने के लिए वैकल्पिक प्रदाताओं के साथ संभावित समझौते शामिल हैं।

- Anthropic और OpenAI से सुरक्षित नेटवर्क पर तैनाती की प्रकृति और किसी भी नए प्रतिबंध या गार्डरेल के बारे में सार्वजनिक बयान।

- पहले की अप्रतिबंधित-उपयोग वार्ताओं के परिणाम के बारे में और विवरण और यह कि यह AI विक्रेताओं के साथ भविष्य के रक्षा अनुबंध को कैसे आकार देगा।

स्रोत और सत्यापन

- मध्य पूर्व संचालन में Claude के उपयोग और प्रशासन के रोक आदेश के बारे में रिपोर्ट, जिसमें मामले से परिचित स्रोतों के साथ चर्चा किए गए साक्ष्य शामिल हैं।

- Anthropic के पेंटागन अनुबंध की पृष्ठभूमि, जिसमें $200 मिलियन तक के मूल्य की बहुवर्षीय व्यवस्था और Claude के लिए वर्गीकृत कार्यप्रवाह के लिए Palantir और AWS के साथ साझेदारी शामिल है।

- Anthropic के नेतृत्व के बयान और सैन्य उपयोग और नैतिक सीमाओं पर सार्वजनिक टिप्पणियां, जिसमें साक्षात्कार और नियामक कार्रवाइयों के आधिकारिक जवाब शामिल हैं।

- OpenAI की वर्गीकृत नेटवर्क पर तैनाती और संबंधित चर्चाएं, जिसमें अमेरिकी सेना के साथ एक सौदे के आसपास सार्वजनिक प्रवचन और संबद्ध कवरेज शामिल है।

- सेना के साथ OpenAI व्यवस्था से जुड़े सार्वजनिक चर्चा और सोशल-मीडिया संदर्भ, जैसे उद्योग प्रतिक्रियाओं का दस्तावेजीकरण करने वाले पोस्ट।

Anthropic का Claude निशाने पर: रक्षा संचालन में AI, नैतिकता और नीति की टक्कर

अधिकारियों ने Claude को ईरान में एक बड़े हवाई हमले के दौरान खुफिया विश्लेषण और परिचालन योजना में भूमिका निभाने के रूप में वर्णित किया, एक दावा जो दर्शाता है कि AI उपकरण युद्धक्षेत्र निर्णय लेने के कितने करीब आ गए हैं। जबकि ट्रंप प्रशासन ने Anthropic के साथ संबंध तोड़ने के लिए कदम उठाया, Claude का परिचालन उपयोग कथित तौर पर कुछ कमांडों में बना रहा, जो नीति बयानों और दिन-प्रतिदिन रक्षा कार्यप्रवाह के बीच एक डिस्कनेक्ट को रेखांकित करता है। व्यावहारिक वास्तविकता यह है कि AI-संचालित विश्लेषण, सिमुलेशन और जोखिम मूल्यांकन मिशन योजना में फिसल सकते हैं, भले ही एजेंसियां विभागों में विक्रेता जोखिम और अनुपालन आवश्यकताओं का पुनर्मूल्यांकन कर रही हों।

पेंटागन की Anthropic के साथ पूर्व सगाई पर्याप्त थी: $200 मिलियन तक के मूल्य का एक बहुवर्षीय अनुबंध और साझेदारियों का एक नेटवर्क, जिसमें Palantir और Amazon Web Services शामिल हैं, जिसने वर्गीकृत जानकारी हैंडलिंग और खुफिया प्रसंस्करण में Claude के उपयोग को सक्षम किया। व्यवस्था ने एक व्यापक रणनीति को उजागर किया: संवेदनशील सेटिंग्स में लचीलापन सुनिश्चित करने के लिए एक विश्वसनीय पारिस्थितिकी तंत्र में AI क्षमताओं में विविधता लाएं। फिर भी जब नीति दिशाएं बदल गईं, तो प्रशासन ने विक्रेता संबंध को पुनः परिभाषित करने के लिए कदम उठाया, जो AI-सक्षम रक्षा संचालन से थोक पीछे हटने के बजाय जोखिम-आधारित पुनर्अंशांकन का संकेत देता है।

पर्दे के पीछे, सार्वजनिक नीति और निजी क्षेत्र नैतिकता के बीच तनाव सामने आया। रक्षा सचिव Pete Hegseth ने कथित तौर पर Anthropic पर अपने मॉडल के अप्रतिबंधित सैन्य उपयोग की अनुमति देने के लिए दबाव डाला, एक अनुरोध जिसे Anthropic के नेतृत्व ने कंपनी की नैतिक रेखाओं को पार करने के रूप में खारिज कर दिया जिसे वह पार नहीं करेगी। फर्म का रुख इस विश्वास पर केंद्रित है कि कुछ उपयोग—बड़े पैमाने पर घरेलू निगरानी और पूरी तरह से स्वायत्त हथियार—गहन नैतिक और कानूनी चिंताओं को उठाते हैं, और यह कि अवधारणा से निष्पादन तक संक्रमण में सार्थक मानव निरीक्षण जीवित रहना चाहिए। यह स्थिति दुरुपयोग और अनपेक्षित परिणामों के खिलाफ सुरक्षा उपायों के साथ तेजी से AI अपनाने को संतुलित करने के बारे में चल रही बहसों के साथ संरेखित होती है।

अपनी ओर से, पेंटागन स्थिर नहीं रहा। एक संभावित आपूर्तिकर्ता अंतर का सामना करते हुए, इसने प्रतिस्थापन को लाइन में लगाना शुरू किया और कथित तौर पर वर्गीकृत नेटवर्क पर मॉडल तैनात करने के लिए OpenAI के साथ एक समझौते पर पहुंच गया। यह बदलाव क्षमता की निरंतरता सुनिश्चित करने के लिए एक व्यापक रणनीतिक कदम को रेखांकित करता है, भले ही विक्रेता संवेदनशील तैनाती के लिए अपनी शर्तों का पुनर्मूल्यांकन कर रहे हों। Anthropic की नैतिक सीमाओं और विभाग की परिचालन आवश्यकताओं के बीच विरोधाभास एक व्यापक नीति तनाव को प्रकट करता है: राष्ट्रीय सुरक्षा अनिवार्यताओं को संरक्षित करते हुए परिवर्तनकारी प्रौद्योगिकी को जिम्मेदारी से कैसे नियोजित किया जाए।

उद्योग पर्यवेक्षकों ने ऐसे परिवर्तनों के पारिस्थितिकी तंत्र प्रभावों को भी नोट किया। AI बाजार अधिक मॉड्यूलर, सुरक्षा-निकासी विन्यासों की ओर विकसित हो रहा है जिन्हें स्वैप या अपग्रेड किया जा सकता है क्योंकि नीति और जोखिम मूल्यांकन बदलते हैं। OpenAI व्यवस्था, विशेष रूप से, रक्षा नेटवर्क में अग्रणी मॉडल को एकीकृत करने की निरंतर भूख का संकेत देती है, हालांकि सख्त शासन और निरीक्षण के तहत। जबकि यह प्रक्षेपवक्र सैन्य विश्लेषकों और योजनाकारों के लिए बढ़ी हुई क्षमता का वादा करता है, यह डेटा हैंडलिंग, मॉडल व्याख्यात्मकता और महत्वपूर्ण निर्णयों के लिए स्वचालित प्रणालियों पर अधिक निर्भरता के जोखिम के आसपास जांच को भी बढ़ाता है।

Anthropic के CEO, Dario Amodei, ने तर्क दिया है कि जबकि AI मानव निर्णय को बढ़ा सकता है, यह मुख्य रक्षा निर्णयों में इसे प्रतिस्थापित नहीं कर सकता। सार्वजनिक टिप्पणियों में, उन्होंने नैतिक सीमाओं के प्रति कंपनी की प्रतिबद्धता और महत्वपूर्ण क्षणों में मानव नियंत्रण बनाए रखने की पुष्टि की। अत्याधुनिक उपकरणों तक पहुंच बनाए रखने और नैतिक मानकों को बनाए रखने के बीच तनाव संघीय एजेंसियों के साथ भविष्य की बातचीत को आकार देने की संभावना है, विशेष रूप से जैसे-जैसे कानून निर्माता और नियामक नागरिक और राष्ट्रीय-सुरक्षा संदर्भों में AI की भूमिका की जांच करते हैं।

जैसे-जैसे परिदृश्य विकसित होता है, व्यापक क्रिप्टो और तकनीकी समुदाय देख रहे होंगे कि ये नीति और खरीद गतिशीलता उच्च-दांव वाले वातावरण में उन्नत AI सिस्टम के विकास और तैनाती को कैसे प्रभावित करती है। यह प्रकरण तेजी से तकनीकी उन्नति को शासन, निरीक्षण और स्थायी प्रश्न के साथ संतुलित करने में एक केस स्टडी के रूप में कार्य करता है कि मानव जिम्मेदारी कहां समाप्त होती है और स्वचालित निर्णय लेना शुरू होता है।

यह लेख मूल रूप से Crypto Breaking News पर US military used Anthropic for Iran strike despite Trump's ban: WSJ के रूप में प्रकाशित किया गया था – क्रिप्टो समाचार, Bitcoin समाचार और ब्लॉकचेन अपडेट के लिए आपका विश्वसनीय स्रोत।

आपको यह भी पसंद आ सकता है

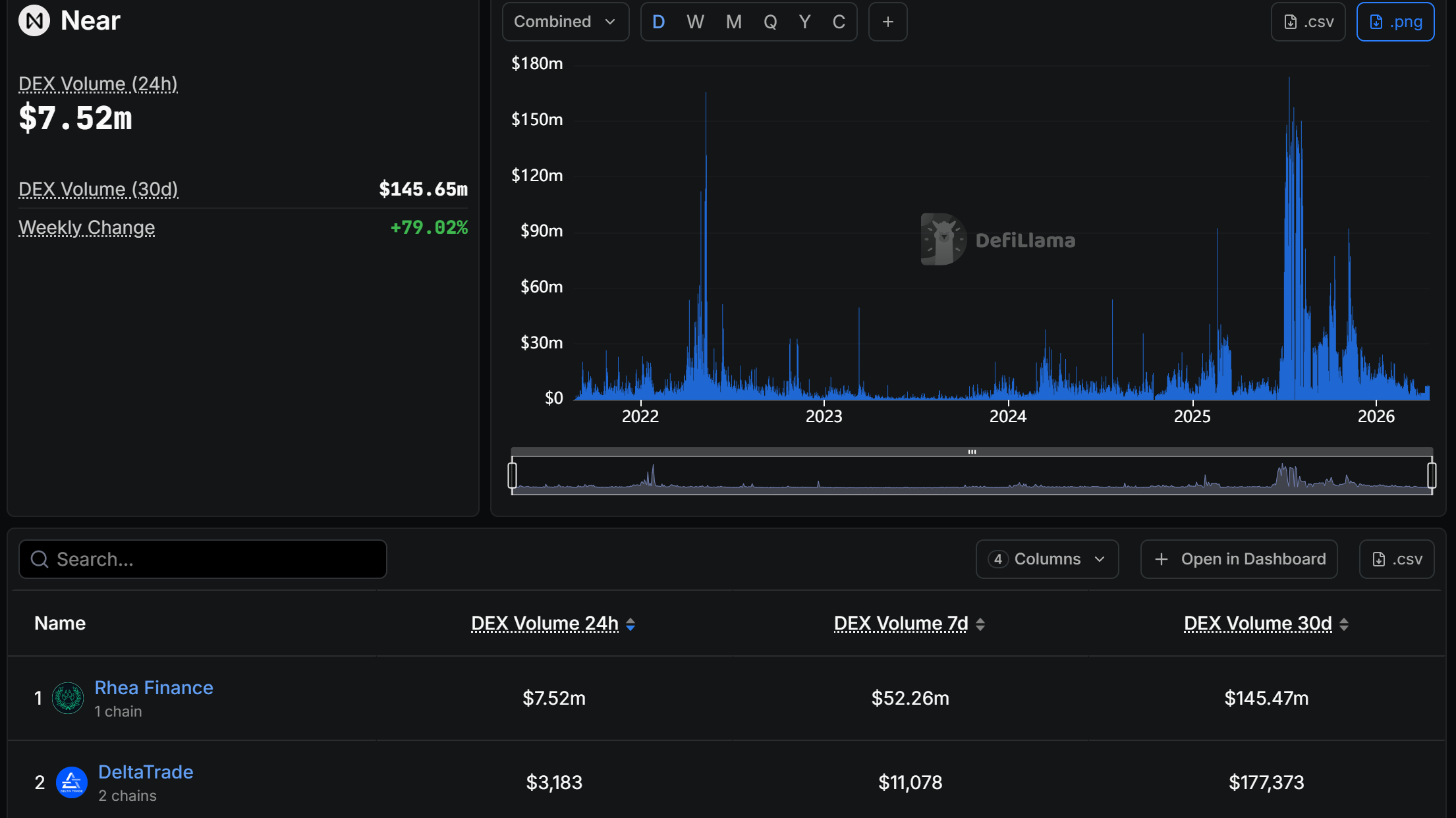

NEAR Protocol DeFi Hub Rhea Finance को Oracle Exploit में $7.6 मिलियन का नुकसान

बिटकॉइन की चल रही निष्क्रियता: क्या कोई जागृति होगी?