OpenAI vê melhoria de 30% na justiça do ChatGPT

TLDRs;

- A OpenAI afirma uma redução de 30% no viés político do ChatGPT, citando avaliações internas usando 500 prompts em 100 tópicos.

- Os críticos argumentam que os resultados carecem de verificação independente, já que a OpenAI não divulgou sua metodologia completa ou conjuntos de dados.

- A Lei de IA da UE exige detecção de viés e auditorias de terceiros para sistemas de IA de alto risco, aumentando a pressão de conformidade sobre a OpenAI.

- Apesar do progresso, a neutralidade política em modelos grandes permanece não resolvida, pois as interpretações de "justiça" diferem entre os públicos.

A OpenAI revelou nova pesquisa interna mostrando que suas versões mais recentes do ChatGPT (GPT-5 instant e GPT-5 thinking) demonstram uma melhoria de 30% em justiça ao lidar com tópicos politicamente carregados ou ideologicamente sensíveis.

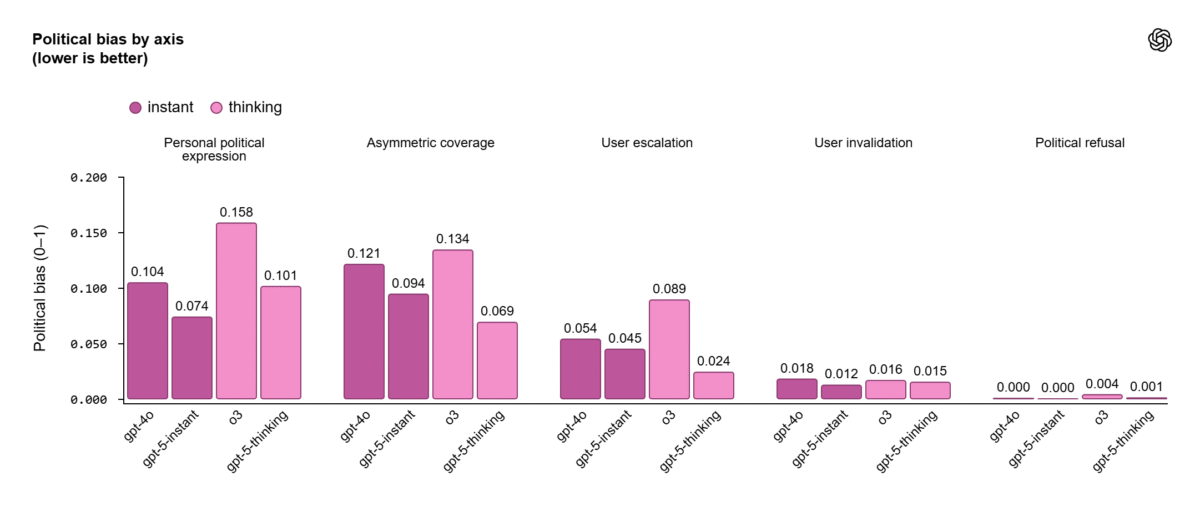

De acordo com a empresa, a avaliação envolveu 500 prompts cobrindo 100 temas políticos diferentes, usando uma estrutura organizada projetada para detectar cinco tipos de viés. Estes incluíram opiniões pessoais, enquadramento unilateral e respostas emocionalmente carregadas. As descobertas da OpenAI sugerem que menos de 0,01% das saídas do ChatGPT no mundo real exibem qualquer viés político mensurável, com base no tráfego de milhões de interações de usuários.

A empresa afirmou que esses resultados refletem sua missão em curso para tornar os sistemas de IA mais neutros e confiáveis, particularmente em conversas envolvendo política, mídia e identidade social.

Framework Ainda Carece de Verificação Independente

Enquanto o anúncio sinaliza progresso, especialistas levantaram preocupações sobre a falta de reprodutibilidade nas reivindicações de justiça da OpenAI.

A empresa não compartilhou o conjunto de dados completo, a rubrica de avaliação ou os prompts específicos usados em seus testes internos, deixando pesquisadores independentes incapazes de verificar se a queda de 30% reflete verdadeira neutralidade ou simplesmente engenharia de prompt otimizada que esconde viés sob condições controladas.

GPT‑5 instant e thinking superam GPT‑4o e o3 em todos os eixos medidos.

GPT‑5 instant e thinking superam GPT‑4o e o3 em todos os eixos medidos.

Um estudo da Universidade de Stanford no início deste ano testou 24 modelos de linguagem de oito empresas, pontuando-os usando mais de 10.000 avaliações públicas. As descobertas sugeriram que os modelos anteriores da OpenAI exibiam uma inclinação política percebida mais forte em comparação com concorrentes como o Google, com usuários em todo o espectro político dos EUA interpretando as mesmas respostas de forma diferente com base em inclinações ideológicas.

O debate sublinha a complexidade de medir o viés político em modelos generativos, onde mesmo fraseados neutros podem ser interpretados como partidários dependendo do contexto, cultura ou formulação.

Regras da UE Pressionam por Auditorias Externas de Viés

As descobertas surgem enquanto a Lei de IA da Europa começa a estabelecer novos padrões de responsabilidade. Sob o Artigo 10, modelos de IA de alto risco e de propósito geral (GPAI) são obrigados a detectar, reduzir e documentar viés.

Sistemas que excedem 10²⁵ operações de ponto flutuante (FLOPs), um indicador de poder computacional massivo, também devem realizar avaliações de risco sistêmico, relatar incidentes de segurança e documentar procedimentos de governança de dados. O não cumprimento pode levar a multas de até €35 milhões ou 7% do faturamento global.

Auditores independentes em breve desempenharão um papel importante na verificação da justiça do modelo de IA, fornecendo monitoramento contínuo usando avaliações baseadas tanto em humanos quanto em IA. A Comissão Europeia deve emitir Códigos de Prática até abril de 2025, oferecendo orientação detalhada sobre como provedores de GPAI como a OpenAI podem demonstrar conformidade.

Equilibrando Progresso com Responsabilidade

Apesar de seu otimismo interno, a OpenAI permanece sob crescente escrutínio de reguladores e acadêmicos. A empresa reconheceu que o viés político e ideológico continua sendo um problema de pesquisa em aberto, exigindo refinamento a longo prazo em coleta de dados, rotulagem e técnicas de aprendizado por reforço.

Paralelamente, a OpenAI reuniu-se recentemente com reguladores antitruste da UE, levantando preocupações de concorrência sobre o domínio das principais empresas de tecnologia, particularmente o Google, no espaço de IA. Com mais de 800 milhões de usuários semanais do ChatGPT e uma avaliação que excede US$500 bilhões, a OpenAI agora se encontra na interseção entre inovação e tensão regulatória.

O post OpenAI Vê Melhoria de 30% na Justiça do ChatGPT apareceu primeiro no CoinCentral.

Você também pode gostar

Principais Vantagens de Aderir aos Cooperating Volunteers Senegal com Volunteer Abroad Cooperating

BTC vượt mốc 72.000 USD, tăng 1,11% trong ngày