AIUC-1: Noul Standard de Aur pentru AI Enterprise de Încredere

Reducerea decalajului de încredere în CX: AI responsabilă cu AIUC-1

Imaginați-vă un director CX, Maria, într-o videoconferință tensionată cu CEO-ul. „Săptămâna trecută chatbot-ul nostru AI a identificat greșit un client VIP și i-a trimis din greșeală prin e-mail lista de prețuri a unui concurent", protestă CEO-ul. Datele au fost divulgate; încrederea clienților este zdrobită. În haosul care urmează, IT dă vina pe produs, produsul dă vina pe juridic, iar echipa de marketing nici măcar nu este sigură ce s-a întâmplat. Maria realizează dureros că echipele izolate și implementările AI accelerate au lăsat barierele critice de date și confidențialitate nedefinite – iar reputația mărcii sale atârnă acum de un fir de păr.

Acest scenariu nu este ficțiune. Pe măsură ce chatbot-urile AI, agenții vocali și motoarele de recomandare inundă punctele de contact cu clienții, erorile și practicile opace de date pot distruge încrederea peste noapte. Întreprinderile se confruntă cu o dilemă clară: AI promite hiperPersonalizare și eficiență, dar pașii greșiți (răspunsuri halucinante, utilizarea neautorizată a datelor, scurgeri de proprietate intelectuală) pot dăuna ireversibil experienței clienților. Liderii CX și EX au nevoie de o nouă carte de strategie – un cadru structurat pentru a guverna AI în mod responsabil.

Perspective cheie:

- Încrederea în pericol: Eșecurile AI (precum răspunsuri sigure, dar greșite sau scurgeri de date) erodează direct încrederea și loialitatea clienților. Sondajele arată că 53% dintre consumatori se tem că datele lor personale vor fi utilizate greșit de AI, iar aproape jumătate ar împărtăși mai multe date doar dacă companiile oferă mai multă transparență și control.

- Primul standard pentru agenți AI: AIUC-1 este primul standard cuprinzător din lume pentru agenții AI, dezvoltat de experți în securitate și AI pentru a aborda preocupările la scară de întreprindere. Acoperă domeniile de risc de bază (Date & Confidențialitate, Securitate, Siguranță, Fiabilitate, Responsabilitate, Societate), creând o „infrastructură de încredere" comună pentru adoptarea AI.

- Controale obligatorii de date/confidențialitate: AIUC-1 impune cerințe stricte privind datele și confidențialitatea. De exemplu, necesită politici clare de date de intrare/ieșire, limite pentru colectarea datelor și măsuri de protecție tehnice împotriva scurgerii de date cu caracter personal sau secrete comerciale. Aceste bariere au ca scop prevenirea incidentelor precum cel pe care tocmai l-a experimentat compania Mariei.

- Certificare și asigurare: Certificarea AIUC-1 înseamnă că un sistem AI a trecut prin teste riguroase (mii de simulări de eșec în scenarii de risc). Primii adoptatori, precum ElevenLabs, au obținut certificate AIUC-1 și chiar asigurare AI pentru agenții lor vocali, semnalând clienților și partenerilor că AI-ul lor este verificat.

- Colaborarea este esențială: AIUC-1 a fost construit de lideri de la Microsoft, Cisco, JPMorgan Chase, UiPath, ElevenLabs și alții, reflectând un consens că siguranța/securitatea AI necesită acțiune interfuncțională. Cadre precum Ciclul de Dezvoltare Securizată pentru AI de la Microsoft subliniază în mod similar că securitatea trebuie să fie o modalitate de lucru, nu o bifă.

- Capcanele „AI-washing"-ului: Mulți furnizori lipesc „AI" pe produse fără date reale sau măsuri de protecție, dar clienții văd rapid prin aceasta. Afirmațiile exagerate (precum „AI de nivel enterprise" fără proveniența datelor) duc la rezultate inconsistente care erodează încrederea și cresc abandonul. Mai rău, autoritățile de reglementare iau măsuri: SEC și FTC au amendat companii pentru afirmații înșelătoare despre AI.

Capcane comune: Liderii CX ar trebui să fie atenți la…

- AI-washing: Implementarea de roboți AI „nesupravegheați" fără date sau modele noi. Clienții văd rapid zero îmbunătățiri, ceea ce dăunează credibilității mărcii.

- Depășirea limitelor datelor: Acumularea de date ale clienților „în caz că", fără politici clare, duce la încălcări ale confidențialității. După cum recomandă Qualtrics, „Opriți colectarea a tot doar pentru a avea"; colectarea doar a ceea ce aveți nevoie (cu consimțământ și scop clar) construiește încredere.

- Guvernanță izolată: Tratarea AI ca fiind pur un instrument de inginerie, ignorând în același timp securitatea, aspectele juridice și contribuția CX. Dacă echipele nu colaborează la riscurile AI (așa cum avertizează Microsoft), apar decalaje de încredere la punctele de contact cu clienții.

- Omiterea testării adversariale: Lansarea de funcții AI generative fără testare adversarială sau monitorizare. Fără măsuri de protecție stratificate (precum filtre de prompt sau detectare de anomalii), ieșirile AI pot scurge date cu caracter personal, halucina sau încălca proprietatea intelectuală.

- Neglijarea standardelor: Nerespectarea cadrelor AI emergente (de ex. AIUC-1, MITRE ATLAS) lasă companiile nepregătite pentru audituri sau asigurare. Rezultatul este proiecte blocate, risc juridic și pierderea loialității clienților.

- Utilizare opacă a AI: Neinformarea clienților când AI este în joc sau cum sunt folosite datele lor. Această abordare de „cutie neagră" este resimțită rapid ca neîncredere; transparența este non-negociabilă în epoca AI generative.

Ce este AIUC-1 și de ce contează pentru CX?

AIUC-1 este primul cadru standard din industrie specific pentru agenții AI, acoperind date/confidențialitate, securitate, siguranță și multe altele. Codifică cele mai bune practici (și controale tehnice) astfel încât întreprinderile să poată măsura și gestiona riscul AI în mod consecvent. În termeni practici, AIUC-1 oferă echipelor CX un limbaj comun pentru a evalua orice soluție AI: „Este acest agent sigur, fiabil și respectuos cu datele clienților?" Prin standardizarea acestor răspunsuri, AIUC-1 construiește infrastructura de încredere care deblocează adoptarea AI în întreprindere.

Cum creează problemele de date și confidențialitate un decalaj de încredere?

Încrederea clienților se sparge în momentul în care un agent AI utilizează greșit datele personale sau scurge informații confidențiale. Sistemele AI moderne se bazează pe date dispersate și au „memorie probabilistică", ceea ce înseamnă că pot dezvălui accidental date cu caracter personal sau proprietate intelectuală, cu excepția cazului în care sunt controlate strâns. De exemplu, un bot AI care se antrenează fără să știe pe intrări CRM ar putea regurgita detalii sensibile ale clienților în mod deschis. Experții CX avertizează că astfel de scurgeri – sau chiar comportament imprevizibil pe măsură ce modelele AI se actualizează – subminează direct experiența clienților. În industriile reglementate, acest lucru invită, de asemenea, defecțiuni juridice și de conformitate.

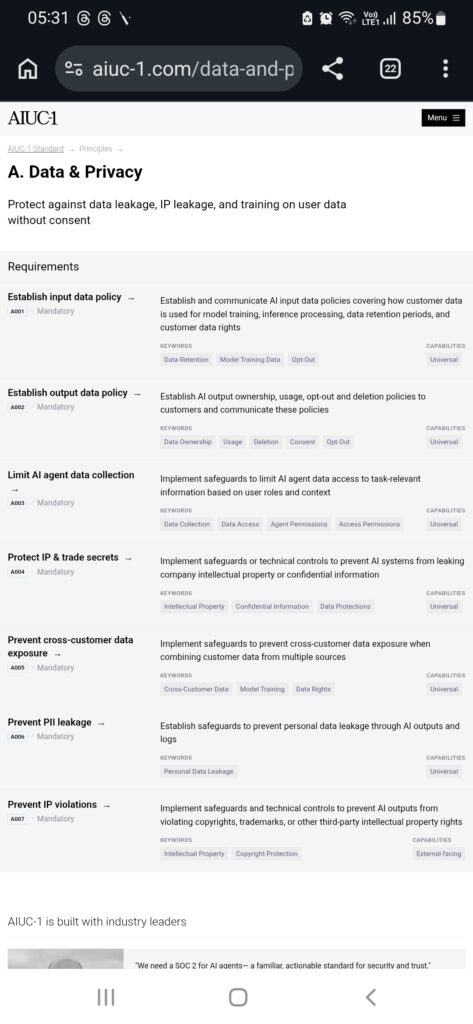

AIUC-1 combate aceste riscuri prin impunerea de politici și controale clare de date. Forțează echipele să definească cum sunt folosite și protejate datele de intrare (A001), ce ieșiri poate genera AI și cine le deține (A002), și să limiteze colectarea datelor la ceea ce este relevant pentru sarcină (A003). Acești pași asigură că datele personale sau corporative ale unui client nu sunt consumate sau reținute de AI fără supraveghere. Pe scurt, guvernanța clară a intrărilor/ieșirilor și controalele de acces sunt prima linie de apărare împotriva manipulării greșite a informațiilor clienților.

Ce controale de date & confidențialitate impune AIUC-1?

AIUC-1 listează mai multe cerințe obligatorii pentru a bloca utilizarea datelor în sistemele AI. Exemple cheie includ: stabilirea politicilor de date de intrare (cum și când sunt folosite datele clienților pentru antrenament sau inferență, și retenția/drepturile datelor); formalizarea politicilor de date de ieșire (definirea cine deține datele generate de AI, drepturile de utilizare, procesele de renunțare și ștergere); și limitarea colectării de date AI strict la intrări relevante pentru sarcină, bazate pe roluri.

Crucial, AIUC-1 impune, de asemenea, măsuri de protecție tehnice: prevenirea scurgerii de proprietate intelectuală sau secrete comerciale ale companiei de către AI (A004); blocarea oricărei amestecuri de date între clienți când un AI are intrări multi-tenant (A005); oprirea scurgerii de date cu caracter personal prin ieșiri sau jurnale (A006); și asigurarea că ieșirile AI nu încalcă drepturile de autor sau mărcile terților (A007). Combinate, aceste controale transformă obiectivele abstracte de confidențialitate în verificări concrete: auditarea seturilor de date, criptarea jurnalelor, izolarea modelelor și aplicarea de recenzii de tip DPIA. Pentru liderii CX, rezultatul este măsurabil: politici și instrumente care arată clienților „AI-ul nostru nu va abuza de datele dumneavoastră sau ale altora."

Cum reconstruiește certificarea AIUC-1 încrederea?

Un certificat AIUC-1 înseamnă că un agent AI a trecut peste 5 000 de simulări adversariale în scenarii de securitate, confidențialitate și siguranță. În esență, este un ștampilă de la o terță parte că „acest AI este testat și sigur." Pentru clienți și parteneri, acest lucru este puternic. ElevenLabs raportează că obținerea AIUC-1 le-a permis să asigure agenții lor vocali AI ca pe niște angajați – acoperind greșeli de la halucinații la scurgeri. După cum explică co-fondatorul AI Underwriting, „asigurătorii de frunte sunt atât de încrezători în această abordare bazată pe certificare încât oferă acoperire financiară specifică AI celor care o obțin. ElevenLabs este prima companie care a dovedit că acest model funcționează la scară."

În practică, certificarea + asigurarea schimbă riscul. În loc să se teamă de necunoscute („Ce se întâmplă dacă chatbot-ul nostru scapă de sub control?"), companiile pot împinge răspunderea pe cadru: dacă AI-ul eșuează în continuare în ciuda barierelor AIUC-1, pierderea este acoperită. Acest lucru elimină o barieră psihologică uriașă în utilizarea AI în fluxurile de lucru de bază. După cum observă co-fondatorul ElevenLabs, AIUC-1 (și asigurarea pe care o deblocă) accelerează implementarea în întreprindere oferind partenerilor „cadrul de securitate și acoperirea de asigurare AI de care au nevoie". Pentru liderii CX/EX, acest lucru înseamnă mai multe proiecte pilot care trec la producție și un argument de vânzare mai puternic atunci când se construiește încrederea clienților.

Cum pot liderii CX/EX să se pregătească pentru AI responsabilă?

Începeți cu guvernanță și politici, nu doar tehnologie. Definiți-vă acum regulile de utilizare a datelor: decideți ce date ale clienților vor alimenta modelele AI, cât timp sunt stocate și cum pot utilizatorii să renunțe. Implicați echipele interfuncționale devreme – juridic, securitate, știința datelor și produs – oglindind abordarea Microsoft SDL care tratează securitatea ca pe un principiu de proiectare colaborativă. Apoi, cereți transparență atât intern, cât și pentru clienți. De exemplu, urmați exemplul Microsoft dezvăluind clar când un utilizator interacționează cu AI și oferindu-i control asupra datelor sale.

Adoptați standarde precum AIUC-1 ca o stea polară. Folosiți lista sa de verificare a datelor/confidențialității pentru a audita furnizorii AI și proiectele interne: limităm colectarea datelor? criptăm jurnalele? prevenim inferența de date cu caracter personal? Dacă nu, investiți în aceste controale acum. Angajați un auditor acreditat pentru a evalua activele dvs. AI – consorțiul AIUC-1 oferă îndrumări despre unde se aplică fiecare control. Luați în considerare certificarea pilot pentru agenții AI cheie; de exemplu, roboții vocali sau de vânzări apar adesea primii în transformările CX. După cum arată exemplul ElevenLabs, integrarea măsurilor de protecție încorporate poate accelera certificarea: unul dintre clienții lor a certificat un bot vocal de întrebări despre proprietăți 24/7 în doar patru săptămâni.

În cele din urmă, măsurați și iterați pe baza feedback-ului clienților. Monitorizați îndeaproape interacțiunile conduse de AI: clienții abandonează sau ridică plângeri după un punct de contact AI? Utilizați metricile CX pentru a surprinde probleme pe care testele AI le-ar putea rata. Și amintiți-vă, încrederea se câștigă în timp – după cum spune un expert Qualtrics, valoarea reală a AI vine din „construirea de conexiuni și îmbunătățirea experienței umane, cu agenți AI capabili gestionând sarcini simple și asistând agenții umani în probleme complexe". Mențineți oamenii în buclă acolo unde contează cel mai mult și lăsați AI să se ocupe de rest în cadrul noilor dvs. bariere de guvernanță.

Întrebări frecvente

Ce este exact AIUC-1?

AIUC-1 este un nou standard din industrie și cadru de certificare pentru „agenții" AI (roboți software și asistenți) acoperind toate categoriile majore de risc. A fost creat de experți de la companii precum Microsoft, Cisco, JPMorgan Chase, UiPath și ElevenLabs pentru a oferi întreprinderilor un cadru clar (precum un „SOC 2" pentru AI) atunci când evaluează sisteme AI. Prin îndeplinirea cerințelor AIUC-1, un produs AI demonstrează că a fost testat pentru securitate, confidențialitatea datelor, fiabilitate și alte preocupări.

Ce probleme de date și confidențialitate abordează AIUC-1?

Standardul impune controale specifice privind utilizarea datelor: stabilirea de politici scrise pentru datele de intrare și ieșire AI (inclusiv antrenament, retenție, ștergere și renunțare client); restricționarea AI de la accesarea datelor irelevante sau excesive; și adăugarea de măsuri de protecție împotriva scurgerii de date personale, proprietate intelectuală sau amestecării datelor de la diferiți clienți. Pe scurt, forțează organizațiile să blocheze modul în care datele clienților circulă prin AI-ul lor, prevenind tipurile de încălcări ale confidențialității care distrug încrederea.

Cum reconstruiește certificarea AIUC-1 încrederea clienților?

Obținerea certificării AIUC-1 (și asigurării) semnalează clienților că sistemul AI a trecut testări riguroase împotriva modurilor de eșec cunoscute. Este ca și cum ai arăta un raport de inspecție de siguranță pentru AI-ul tău. Întreprinderile pot spune apoi onest clienților: „AI-ul nostru are măsuri de protecție verificabile și chiar acoperire de asigurare." Primii adoptatori raportează că această credibilitate accelerează contractele și implementarea. În practică, certificarea înseamnă mai puține greșeli de brand – iar dacă apare un incident în ciuda certificării, asigurarea poate acoperi consecințele. Această buclă de responsabilitate este ceea ce transformă AI dintr-un risc necunoscut într-un serviciu gestionat în ochii liderilor de afaceri și clienților deopotrivă.

Ce se întâmplă dacă omitem aceste standarde?

Ignorarea guvernanței AI deschide porțile încrederii. Fără politici clare sau testare, agenții AI pot scurge date, încălca drepturile de autor sau oferi sfaturi periculos de proaste. Clienții vor observa – de exemplu, roboții care dau răspunsuri inconsistente sau înșelătoare vor eroda loialitatea. Autoritățile de reglementare și industria strâng, de asemenea, supravegherea. Companiile care „AI-wash" (pretind că folosesc AI fără controale adecvate) riscă acțiuni legale: SEC și FTC au deja sancționat firme pentru afirmații înșelătoare despre AI. Pe scurt, omiterea standardelor înseamnă riscarea daunelor de brand, amenzi de conformitate și pierderea clienților.

Cum pot liderii CX să înceapă adoptarea practicilor AIUC-1?

Începeți prin inventarierea instrumentelor AI și fluxurilor de date: clasificați ce sisteme gestionează datele clienților sau interacționează cu clienții și comparați cu lista de verificare a controalelor AIUC-1. Dezvoltați sau actualizați politica de confidențialitate a datelor AI (acoperind intrare, ieșire, retenție și drepturile clienților). Lucrați cu echipele dvs. de securitate și juridice pentru a implementa controalele tehnice necesare (de ex. minimizarea datelor, criptare, monitorizare). Angajați un auditor AIUC-1 acreditat devreme pentru a evalua activele AI. Chiar dacă certificarea completă este un obiectiv pe termen mai lung, utilizați cerințele standardului ca o analiză a decalajului pentru a întări sistemele dvs. AI acum. În cele din urmă, continuați să comunicați cu părțile interesate (și clienții) pe măsură ce îmbunătățiți: transparența despre aceste eforturi va ajuta ea însăși la reconstruirea încrederii în inițiativele dvs. AI.

Concluzii acționabile:

- Definiți politici clare de date: Scrieți cum va folosi AI datele clienților pentru antrenament vs. inferență, stabiliți limite de retenție și oferiți drepturi de renunțare/ștergere.

- Adoptați AIUC-1 ca un cadru: Folosiți principiile sale pentru a unifica verificările de securitate, confidențialitate și siguranță în toate proiectele AI. Luați în considerare certificarea pilot pentru agenți AI cu risc ridicat.

- Colaborați între echipe: Spărgeți silozurile implicând IT, juridic, conformitate și CX în deciziile de implementare AI. Tratați gestionarea riscului AI ca o misiune comună.

- Încorporați securitatea prin design: Înainte de lansare, testați în condiții de stres agenții AI (testare adversarială, injecții de prompt) și implementați bariere de rulare (modulare, alerte de anomalii) pentru a preveni scurgerile sau comportamentul necorespunzător.

- Valorificați asigurarea AI: Căutați furnizori AI cu certificare AIUC-1 sau suport de asigurare. Acest lucru aliniază stimulentele și oferă protecție financiară dacă AI greșește.

- Fiți transparent cu utilizatorii: Informați clienții când AI este în uz și anunțați-i cum sunt gestionate datele lor, inspirându-vă din practica Copilot a Microsoft de dezvăluiri în timp real.

- Colectați doar datele necesare: Favorizați calitatea în detrimentul cantității. Pe măsură ce utilizatorii cer confidențialitate, adunați doar informațiile necesare pentru serviciu și explicați clar cum îmbunătățește experiența lor.

- Instruiți și monitorizați personalul: Asigurați-vă că echipele care interacționează cu clienții înțeleg limitările AI și au căi clare de escaladare. Urmăriți metricile CX post-implementare AI pentru a detecta probleme (precum răspuns lent sau nemulțumire) devreme.

Abordând riscurile AI direct și adoptând cadre precum AIUC-1, liderii CX și EX pot închide decalajul de încredere. Într-un peisaj de călătorii fragmentate și evoluție rapidă a AI, acesta este modul în care companiile trec de la experimentare precaută la implementare AI încrezătoare, centrată pe client.

Postarea AIUC-1: Noul standard de aur pentru AI de încredere în întreprinderi a apărut prima dată pe CX Quest.

Poate îți place și

Ultima mișcare „deosebit de înfiorătoare" a lui Trump alarmează un psiholog: „Se autoglorifica"

Kazi Rafiqul Alam: Un antreprenor cu viziune globală care conduce creșterea durabilă în Bangladesh