การละเมิด Anthropic Mythos: การเข้าถึงเครื่องมือความปลอดภัยไซเบอร์ AI เฉพาะโดยไม่ได้รับอนุญาต จุดชนวนความกังวลด้านความปลอดภัยขององค์กรอย่างร้ายแรง

BitcoinWorld

การละเมิด Anthropic Mythos: การเข้าถึงโดยไม่ได้รับอนุญาตต่อเครื่องมือความปลอดภัยทางไซเบอร์ AI เฉพาะกลุ่ม ก่อให้เกิดความกังวลด้านความปลอดภัยขององค์กรอย่างวิกฤต

ซานฟรานซิสโก รัฐแคลิฟอร์เนีย – 30 เมษายน 2568 – รายงานระบุว่าเครื่องมือความปลอดภัยทางไซเบอร์เฉพาะกลุ่มของ Anthropic ชื่อ Mythos ถูกเข้าถึงโดยกลุ่มที่ไม่ได้รับอนุญาตผ่านสภาพแวดล้อมของผู้ให้บริการบุคคลที่สาม ตามการสืบสวนของ Bloomberg เหตุการณ์นี้ก่อให้เกิดความกังวลอย่างมากเกี่ยวกับความปลอดภัยของระบบ AI ขั้นสูงที่ออกแบบมาเพื่อปกป้ององค์กร การละเมิดเกิดขึ้นแม้ว่า Anthropic จะมีกลยุทธ์การเผยแพร่ที่ควบคุมอย่างรอบคอบสำหรับ Mythos ซึ่งเป็นเครื่องมือที่บริษัทออกแบบมาโดยเฉพาะเพื่อเสริมสร้างการป้องกันความปลอดภัยขององค์กร

การสืบสวนการละเมิด Anthropic Mythos อยู่ระหว่างดำเนินการ

Anthropic ยืนยันว่ากำลังสืบสวนรายงานการเข้าถึง Claude Mythos Preview โดยไม่ได้รับอนุญาต บริษัทได้ออกแถลงการณ์นี้ต่อ Bitcoin World: "เรากำลังสืบสวนรายงานที่อ้างว่ามีการเข้าถึง Claude Mythos Preview โดยไม่ได้รับอนุญาตผ่านสภาพแวดล้อมของผู้ให้บริการบุคคลที่สามรายหนึ่งของเรา" ที่สำคัญ การสืบสวนภายในของ Anthropic ไม่พบหลักฐานว่ากิจกรรมที่ไม่ได้รับอนุญาตดังกล่าวส่งผลกระทบต่อระบบหลักของบริษัท การละเมิดดูเหมือนจำกัดอยู่ที่สภาพแวดล้อม preview ที่เข้าถึงผ่านช่องทางผู้ให้บริการ

รายงานระบุว่ากลุ่มที่ไม่ได้รับอนุญาตได้เข้าถึงในวันเดียวกับที่ Anthropic ประกาศ Mythos ต่อสาธารณะ พวกเขาใช้กลยุทธ์หลายอย่างเพื่อเจาะระบบ จากแหล่งข้อมูลของ Bloomberg กลุ่มดังกล่าวได้เดาตำแหน่งออนไลน์ของโมเดลโดยอาศัยความรู้เกี่ยวกับรูปแบบการจัดรูปแบบของ Anthropic สำหรับโมเดลอื่นๆ กิจกรรมของกลุ่มนี้เน้นให้เห็นช่องโหว่ที่อาจเกิดขึ้นในโปรโตคอลความปลอดภัยของบุคคลที่สาม

ช่องโหว่ความปลอดภัยของผู้ให้บริการบุคคลที่สามถูกเปิดเผย

เส้นทางการละเมิดเกี่ยวข้องกับผู้รับเหมาบุคคลที่สามที่ทำงานร่วมกับ Anthropic Bloomberg รายงานว่ากลุ่มที่ไม่ได้รับอนุญาตได้ใช้ประโยชน์จาก "การเข้าถึง" ของบุคคลที่ทำงานอยู่ในผู้รับเหมารายนั้น เหตุการณ์นี้เน้นย้ำถึงความท้าทายด้านความปลอดภัยที่เกิดจากระบบนิเวศขององค์กรที่ขยายออกไป ผู้ให้บริการบุคคลที่สามมักเป็นจุดอ่อนที่สุดในห่วงโซ่ความปลอดภัยขององค์กร

องค์กรต่างๆ พึ่งพาผู้รับเหมาเฉพาะทางมากขึ้นสำหรับหน้าที่ต่างๆ อย่างไรก็ตาม การพึ่งพานี้สร้างพื้นที่โจมตีเพิ่มเติม สถานการณ์ Anthropic Mythos แสดงให้เห็นว่าผู้กระทำที่มีความซับซ้อนสามารถใช้ประโยชน์จากความสัมพันธ์เหล่านี้ได้อย่างไร ผู้เชี่ยวชาญด้านความปลอดภัยเตือนอยู่เสมอเกี่ยวกับความเสี่ยงจากบุคคลที่สาม โดยระบุว่าการประเมินความปลอดภัยของผู้ให้บริการมักตามไม่ทันภัยคุกคามที่พัฒนาอยู่ตลอดเวลา

| วันที่ | เหตุการณ์ |

|---|---|

| เมษายน 2568 | Anthropic ประกาศเครื่องมือความปลอดภัยทางไซเบอร์ Mythos |

| วันเดียวกัน | รายงานว่ากลุ่มที่ไม่ได้รับอนุญาตได้เข้าถึง |

| 30 เมษายน | Bloomberg เผยแพร่ผลการสืบสวน |

| ต่อเนื่อง | Anthropic ดำเนินการตรวจสอบความปลอดภัยภายใน |

ผลกระทบต่อความปลอดภัย AI ขององค์กร

การละเมิด Mythos มีผลกระทบสำคัญต่อความปลอดภัย AI ขององค์กร Anthropic ออกแบบ Mythos มาโดยเฉพาะเพื่อเพิ่มประสิทธิภาพการป้องกันความปลอดภัยทางไซเบอร์ขององค์กร บริษัทยอมรับถึงศักยภาพการใช้งานสองด้านของเครื่องมือนี้ในระหว่างการประกาศ ในมือที่ผิด Mythos อาจถูกใช้เป็นอาวุธโจมตีระบบที่มันถูกสร้างมาเพื่อปกป้อง

เหตุการณ์นี้ก่อให้เกิดคำถามสำคัญเกี่ยวกับการปรับใช้ AI อย่างปลอดภัย องค์กรระดับองค์กรต้องพิจารณาปัจจัยหลายประการ:

- โปรโตคอลการควบคุมการเข้าถึง: วิธีที่องค์กรจัดการสิทธิ์สำหรับเครื่องมือ AI ที่มีพลัง

- การบริหารความเสี่ยงของผู้ให้บริการ: การประเมินความปลอดภัยสำหรับผู้รับเหมาบุคคลที่สาม

- ความสามารถในการตรวจสอบ: การตรวจจับการใช้งาน AI โดยไม่ได้รับอนุญาต

- การตอบสนองต่อเหตุการณ์: ขั้นตอนสำหรับการละเมิดความปลอดภัย AI ที่อาจเกิดขึ้น

แรงจูงใจและกิจกรรมของกลุ่มที่ไม่ได้รับอนุญาต

รายงานของ Bloomberg ให้รายละเอียดที่น่าสนใจเกี่ยวกับกลุ่มที่ไม่ได้รับอนุญาต สมาชิกเป็นส่วนหนึ่งของช่อง Discord ที่มุ่งเน้นการค้นหาข้อมูลเกี่ยวกับโมเดล AI ที่ยังไม่เปิดตัว แหล่งข้อมูลของกลุ่มบอก Bloomberg ว่าพวกเขา "สนใจที่จะทดลองใช้โมเดลใหม่ ไม่ใช่ก่อความวุ่นวาย" ความแตกต่างนี้มีความสำคัญในการทำความเข้าใจความเสี่ยงที่อาจเกิดขึ้น

รายงานระบุว่ากลุ่มดังกล่าวใช้ Mythos อย่างสม่ำเสมอนับตั้งแต่ได้รับการเข้าถึง พวกเขาได้มอบหลักฐานให้ Bloomberg รวมถึงภาพหน้าจอและการสาธิตซอฟต์แวร์สด กิจกรรมของพวกเขาดูเหมือนมุ่งเน้นไปที่การสำรวจมากกว่าการแสวงหาผลประโยชน์โดยมีเจตนาร้าย อย่างไรก็ตาม ผู้เชี่ยวชาญด้านความปลอดภัยเตือนว่าแม้แต่การเข้าถึงโดยไม่ได้รับอนุญาตที่ไม่มีเจตนาร้ายก็ยังก่อให้เกิดความเสี่ยง มันสร้างเส้นทางที่ผู้กระทำที่มีเจตนาร้ายอาจนำไปใช้ในภายหลัง

ผู้เชี่ยวชาญด้านความปลอดภัยทางไซเบอร์เน้นว่าเจตนาสามารถเปลี่ยนแปลงได้อย่างรวดเร็ว กลุ่มที่เริ่มต้นสนใจการสำรวจอาจตัดสินใจในภายหลังที่จะใช้การเข้าถึงเพื่อวัตถุประสงค์อื่น หรืออีกทางหนึ่ง วิธีการเข้าถึงของพวกเขาอาจถูกค้นพบและนำไปใช้โดยผู้กระทำที่มีเจตนาร้ายอย่างแท้จริง ภูมิทัศน์ความปลอดภัยดิจิทัลพัฒนาอยู่ตลอดเวลา

Project Glasswing และกลยุทธ์การเผยแพร่แบบควบคุม

Anthropic เผยแพร่ Mythos ผ่านโครงการที่เรียกว่า Project Glasswing โปรแกรมนี้ให้การเข้าถึงที่จำกัดแก่ผู้ให้บริการที่คัดสรรรวมถึงบริษัทเทคโนโลยีชั้นนำอย่าง Apple กลยุทธ์การเผยแพร่แบบควบคุมมุ่งเน้นโดยเฉพาะเพื่อป้องกันการใช้งานโดยผู้กระทำที่ไม่ดี Anthropic ตระหนักถึงศักยภาพการใช้งานในทางที่ผิดของเครื่องมือนี้ตั้งแต่ต้น

Project Glasswing เป็นตัวแทนของแนวโน้มที่เพิ่มขึ้นในการปรับใช้ AI อย่างมีความรับผิดชอบ บริษัทต่างๆ ใช้การเผยแพร่แบบเป็นขั้นตอนสำหรับระบบ AI ที่มีพลังมากขึ้น แนวทางนี้ช่วยให้:

- การทดสอบในโลกจริงในสภาพแวดล้อมที่ควบคุม

- การระบุช่องโหว่ความปลอดภัยที่อาจเกิดขึ้น

- การปรับขนาดอย่างค่อยเป็นค่อยไปตามข้อมูลประสิทธิภาพและความปลอดภัย

- การกำหนดโปรโตคอลการใช้งานและแนวปฏิบัติที่ดีที่สุด

แม้จะมีมาตรการป้องกันเหล่านี้ การละเมิดที่รายงานแสดงให้เห็นถึงความท้าทายในการรักษาความปลอดภัยระบบ AI ขั้นสูงอย่างสมบูรณ์ แม้แต่การเผยแพร่ที่จำกัดให้กับพันธมิตรที่เชื่อถือได้ก็ยังสร้างจุดเปิดรับที่อาจเกิดขึ้น เหตุการณ์นี้มีแนวโน้มที่จะส่งผลต่อกลยุทธ์การเผยแพร่ AI ในอนาคตทั่วทั้งอุตสาหกรรม

การตอบสนองของอุตสาหกรรมและแนวปฏิบัติที่ดีที่สุดด้านความปลอดภัย

ชุมชนความปลอดภัยทางไซเบอร์กำลังติดตามสถานการณ์ Anthropic Mythos อย่างใกล้ชิด ผู้เชี่ยวชาญในอุตสาหกรรมระบุว่าการละเมิดความปลอดภัย AI ต้องการโปรโตคอลการตอบสนองเฉพาะทาง ขั้นตอนการละเมิดข้อมูลแบบดั้งเดิมอาจไม่เพียงพอสำหรับความเสี่ยงเฉพาะของ AI ซึ่งรวมถึงการดึงโมเดล การโจมตีด้วย prompt injection และการวางยาพิษข้อมูลการฝึก

ทีมความปลอดภัยขององค์กรควรตรวจสอบหลายด้านหลังจากเหตุการณ์นี้:

การประเมินความปลอดภัยของผู้ให้บริการ: องค์กรต้องดำเนินการตรวจสอบอย่างเข้มงวดสำหรับผู้ให้บริการบุคคลที่สามทั้งหมดที่มีการเข้าถึงระบบ AI การประเมินเหล่านี้ควรเกินกว่าแบบสอบถามความปลอดภัยมาตรฐาน ต้องรวมการประเมินความสามารถและโปรโตคอลความปลอดภัย AI โดยเฉพาะ

การตรวจสอบการเข้าถึง: การตรวจสอบรูปแบบการใช้งานระบบ AI อย่างต่อเนื่องเป็นสิ่งจำเป็น ระบบตรวจจับความผิดปกติควรแจ้งเตือนรูปแบบการเข้าถึงที่ผิดปกติหรือปริมาณการใช้งาน ระบบเหล่านี้ต้องคำนึงถึงลักษณะเฉพาะของการโต้ตอบกับเครื่องมือ AI

การวางแผนการตอบสนองต่อเหตุการณ์: ทีมความปลอดภัยต้องมีแผนการตอบสนองต่อเหตุการณ์เฉพาะสำหรับ AI แผนเหล่านี้ควรครอบคลุมสถานการณ์ต่างๆ เช่น การถูกโจมตีโมเดล การเข้าถึงโดยไม่ได้รับอนุญาต และการใช้เป็นอาวุธที่อาจเกิดขึ้น การฝึกซ้อมตารางอย่างสม่ำเสมอช่วยเตรียมองค์กรสำหรับเหตุการณ์จริง

ผลกระทบในวงกว้างต่อภูมิทัศน์ความปลอดภัย AI

การละเมิด Mythos ที่รายงานเกิดขึ้นท่ามกลางความกังวลที่เพิ่มขึ้นเกี่ยวกับความปลอดภัย AI เมื่อระบบ AI มีความสามารถมากขึ้นและถูกรวมเข้ากับโครงสร้างพื้นฐานที่สำคัญ ความปลอดภัยของพวกมันยิ่งมีความสำคัญมากขึ้น หลายแนวโน้มกำลังเกิดขึ้นในภูมิทัศน์ความปลอดภัย AI:

ประการแรก บทบาทความปลอดภัย AI เฉพาะทางกำลังเป็นที่นิยมมากขึ้น องค์กรต่างๆ จ้างผู้เชี่ยวชาญที่มุ่งเน้นโดยเฉพาะในการรักษาความปลอดภัยระบบ AI บทบาทเหล่านี้ต้องการความเข้าใจทั้งความปลอดภัยทางไซเบอร์แบบดั้งเดิมและช่องโหว่เฉพาะของ AI

ประการที่สอง ความสนใจด้านกฎระเบียบกำลังเพิ่มขึ้น รัฐบาลทั่วโลกกำลังพัฒนากรอบสำหรับความปลอดภัยและความเสี่ยงของ AI เหตุการณ์อย่างการละเมิด Mythos มีแนวโน้มที่จะส่งผลต่อการพัฒนากฎระเบียบเหล่านี้ พวกมันแสดงให้เห็นความเสี่ยงในโลกจริงที่กฎระเบียบต้องจัดการ

ประการที่สาม ชุมชนวิจัยด้านความปลอดภัยกำลังขยายความสนใจในด้าน AI นักวิจัยมากขึ้นกำลังสืบสวนเวกเตอร์การโจมตีและกลไกการป้องกันเฉพาะของ AI องค์ความรู้ที่เพิ่มขึ้นนี้จะช่วยปรับปรุงความปลอดภัย AI ในอนาคต

บทสรุป

การเข้าถึงโดยไม่ได้รับอนุญาตต่อเครื่องมือความปลอดภัยทางไซเบอร์ Mythos ของ Anthropic ที่รายงานเน้นให้เห็นความท้าทายสำคัญในความปลอดภัย AI ขององค์กร แม้ว่าการสืบสวนของ Anthropic ไม่พบผลกระทบต่อระบบหลัก แต่เหตุการณ์นี้เผยให้เห็นช่องโหว่ในโปรโตคอลความปลอดภัยของผู้ให้บริการบุคคลที่สาม การละเมิดแสดงให้เห็นว่าแม้แต่การเผยแพร่ AI ที่ควบคุมอย่างรอบคอบก็ยังเผชิญกับความท้าทายด้านความปลอดภัย เมื่อระบบ AI ถูกรวมเข้ากับการดำเนินงานขององค์กรมากขึ้น มาตรการความปลอดภัยที่แข็งแกร่งยิ่งมีความจำเป็นมากขึ้น สถานการณ์ Anthropic Mythos เป็นกรณีศึกษาที่สำคัญสำหรับองค์กรที่ปรับใช้เครื่องมือ AI ขั้นสูง มันเน้นย้ำถึงความจำเป็นของกลยุทธ์ความปลอดภัยที่ครอบคลุมซึ่งจัดการทั้งระบบภายในและเครือข่ายผู้ให้บริการที่ขยายออกไป

คำถามที่พบบ่อย

Q1: เครื่องมือความปลอดภัยทางไซเบอร์ Mythos ของ Anthropic คืออะไร?

Mythos คือเครื่องมือความปลอดภัยทางไซเบอร์ที่ขับเคลื่อนด้วย AI ซึ่งพัฒนาโดย Anthropic สำหรับการใช้งานความปลอดภัยขององค์กร เครื่องมือนี้ออกแบบมาเพื่อเพิ่มประสิทธิภาพการป้องกันความปลอดภัยขององค์กร แต่มีศักยภาพการใช้งานสองด้านที่อาจถูกผู้กระทำที่มีเจตนาร้ายใช้ประโยชน์

Q2: กลุ่มที่ไม่ได้รับอนุญาตเข้าถึง Mythos ได้อย่างไร?

รายงานระบุว่ากลุ่มดังกล่าวได้รับการเข้าถึงผ่านสภาพแวดล้อมของผู้ให้บริการบุคคลที่สาม พวกเขาใช้กลยุทธ์หลายอย่างรวมถึงการเดาตำแหน่งออนไลน์ของโมเดลโดยอาศัยรูปแบบการจัดรูปแบบของ Anthropic สำหรับโมเดลอื่นๆ

Q3: Anthropic ยืนยันการละเมิดหรือไม่?

Anthropic ยืนยันว่ากำลังสืบสวนรายงานการเข้าถึงโดยไม่ได้รับอนุญาต แต่ระบุว่าการสืบสวนไม่พบหลักฐานว่ากิจกรรมดังกล่าวส่งผลกระทบต่อระบบหลักของบริษัท การสืบสวนมุ่งเน้นไปที่สภาพแวดล้อม preview ที่เข้าถึงผ่านช่องทางผู้ให้บริการ

Q4: Project Glasswing คืออะไร?

Project Glasswing คือโครงการของ Anthropic สำหรับการเผยแพร่เครื่องมือ Mythos แบบควบคุม โปรแกรมนี้ให้การเข้าถึงที่จำกัดแก่ผู้ให้บริการที่คัดสรรรวมถึงบริษัทเทคโนโลยีชั้นนำ โดยมีเป้าหมายเพื่อป้องกันการใช้งานในทางที่ผิดโดยผู้กระทำที่ไม่ดี

Q5: ผลกระทบในวงกว้างต่อความปลอดภัย AI คืออะไร?

เหตุการณ์นี้เน้นให้เห็นช่องโหว่ในความปลอดภัยของผู้ให้บริการบุคคลที่สามและความท้าทายในการรักษาความปลอดภัยระบบ AI ขั้นสูง มีแนวโน้มที่จะส่งผลต่อกลยุทธ์การเผยแพร่ AI การพัฒนากฎระเบียบ และแนวปฏิบัติความปลอดภัยขององค์กรทั่วทั้งอุตสาหกรรม

บทความนี้ Anthropic Mythos Breach: Unauthorized Access to Exclusive AI Cybersecurity Tool Sparks Critical Enterprise Security Concerns ปรากฏครั้งแรกบน BitcoinWorld

คุณอาจชอบเช่นกัน

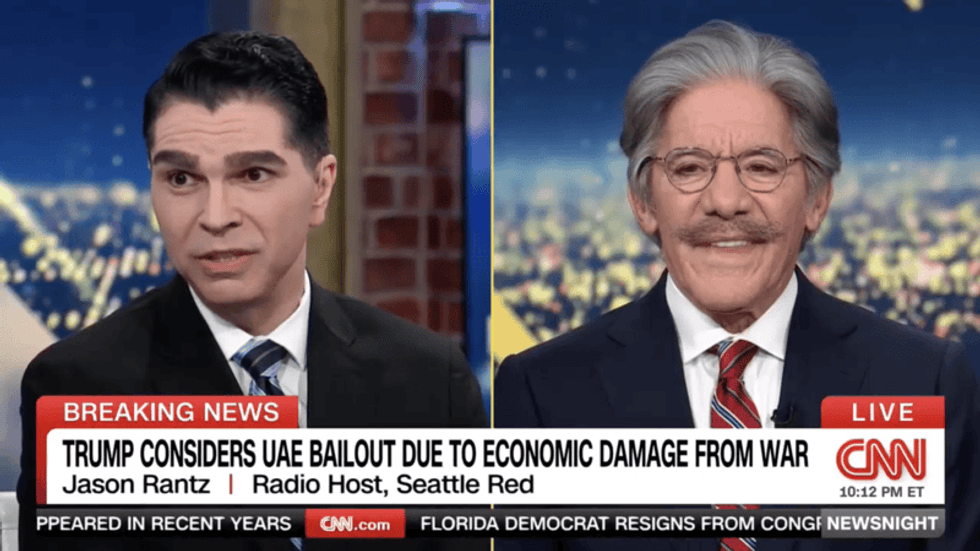

'โอ้ เลิกเถอะ!' เกรัลโด ริเวรา โจมตีการปกป้องแนวคิดช่วยเหลือทางการเงินของทรัมป์โดยนักวิเคราะห์พรรครีพับลิกันบน CNN

สหราชอาณาจักรผลักดันการปฏิรูปครั้งสำคัญเพื่อการเติบโตของการชำระเงินดิจิทัล