ข้อตกลงเพนตากอนของ OpenAI: Sam Altman ได้รับสัญญา AI สำคัญพร้อมมาตรการป้องกันด้านเทคนิค

BitcoinWorld

ข้อตกลงของ OpenAI กับเพนตากอน: Sam Altman ได้รับสัญญา AI ที่สำคัญพร้อมมาตรการป้องกันทางเทคนิค

ในการพัฒนาที่สำคัญสำหรับการกำกับดูแลปัญญาประดิษฐ์ CEO ของ OpenAI Sam Altman ได้ประกาศสัญญาด้านการป้องกันประเทศที่สำคัญกับกระทรวงกลาโหมเมื่อวันศุกร์ที่ 13 ตุลาคม 2025 โดยจัดตั้งมาตรการป้องกันทางเทคนิคที่แก้ไขข้อกังวลด้านจริยธรรมที่สำคัญเกี่ยวกับการใช้งาน AI ทางทหาร ข้อตกลงนี้เกิดขึ้นหลังจากการเผาะแหะระหว่างเพนตากอนและบริษัท AI คู่แข่งอย่าง Anthropic ซึ่งเน้นย้ำถึงจุดตัดที่ซับซ้อนของความมั่นคงของชาติ นวัตกรรมทางเทคโนโลยี และค่านิยมประชาธิปไตยในโลกที่มีระบบอัตโนมัติมากขึ้น

ข้อตกลงของ OpenAI กับเพนตากอนพร้อมมาตรการป้องกันทางเทคนิค

Sam Altman เปิดเผยว่า OpenAI ได้บรรลุข้อตกลงที่อนุญาตให้กระทรวงกลาโหมเข้าถึงโมเดล AI ภายในเครือข่ายลับ ที่สำคัญคือสัญญาประกอบด้วยการป้องกันทางเทคนิคเฉพาะที่แก้ไขข้อกังวลด้านจริยธรรมพื้นฐานสองประการ ประการแรก ข้อตกลงห้ามการเฝ้าระวังจำนวนมากในประเทศ ประการที่สอง มันรักษาความรับผิดชอบของมนุษย์ในการใช้กำลัง รวมถึงระบบอาวุธอัตโนมัติ มาตรการป้องกันเหล่านี้แสดงถึงตำแหน่งการประนีประนอมระหว่างการเข้าถึงทางทหารอย่างไร้ข้อจำกัดและการปฏิเสธขององค์กรโดยสมบูรณ์

ตามแถลงการณ์สาธารณะของ Altman กระทรวงกลาโหมเห็นด้วยกับหลักการเหล่านี้และได้รวมไว้ในทั้งกฎหมายและนโยบาย นอกจากนี้ OpenAI จะนำมาตรการป้องกันทางเทคนิคมาใช้เพื่อให้แน่ใจว่าพฤติกรรมของโมเดลสอดคล้องกับข้อจำกัดเหล่านี้ บริษัทยังจะส่งวิศวกรไปทำงานร่วมกับบุคลากรของเพนตากอน อำนวยความสะดวกในการดำเนินการโมเดลที่เหมาะสมและการตรวจสอบความปลอดภัยอย่างต่อเนื่อง แนวทางการทำงานร่วมกันนี้ทำให้กลยุทธ์ของ OpenAI แตกต่างจากตำแหน่งอุตสาหกรรมที่เป็นปรปักษ์มากขึ้น

การเผชิญหน้าของ Anthropic และความแตกแยกทางจริยธรรม

ข้อตกลงของ OpenAI เกิดขึ้นภายใต้ฉากหลังของการเจรจาที่ล้มเหลวระหว่างเพนตากอนและ Anthropic เป็นเวลาหลายเดือน เจ้าหน้าที่ด้านการป้องกันประเทศผลักดันให้บริษัท AI อนุญาตให้ใช้โมเดลของพวกเขาเพื่อ "วัตถุประสงค์ที่ถูกกฎหมายทั้งหมด" อย่างไรก็ตาม Anthropic แสวงหาข้อจำกัดที่ชัดเจนเกี่ยวกับการเฝ้าระวังจำนวนมากในประเทศและอาวุธอัตโนมัติอย่างสมบูรณ์ CEO Dario Amodei โต้แย้งว่าในกรณีเฉพาะ AI อาจทำลายค่านิยมประชาธิปไตยมากกว่าการปกป้องพวกเขา

จุดยืนทางจริยธรรมนี้ดึงดูดการสนับสนุนที่สำคัญจากคนงานด้านเทคโนโลยี พนักงาน OpenAI มากกว่า 60 คนและพนักงาน Google 300 คนได้ลงนามในจดหมายเปิดผนึกสนับสนุนจุดยืนของ Anthropic จดหมายเรียกร้องให้มีการนำขอบเขตจริยธรรมที่คล้ายกันมาใช้ทั่วทั้งอุตสาหกรรม สะท้อนถึงความกังวลที่เพิ่มขึ้นในหมู่นักพัฒนา AI เกี่ยวกับการใช้งานทางทหารที่เป็นไปได้ของเทคโนโลยีของพวกเขา

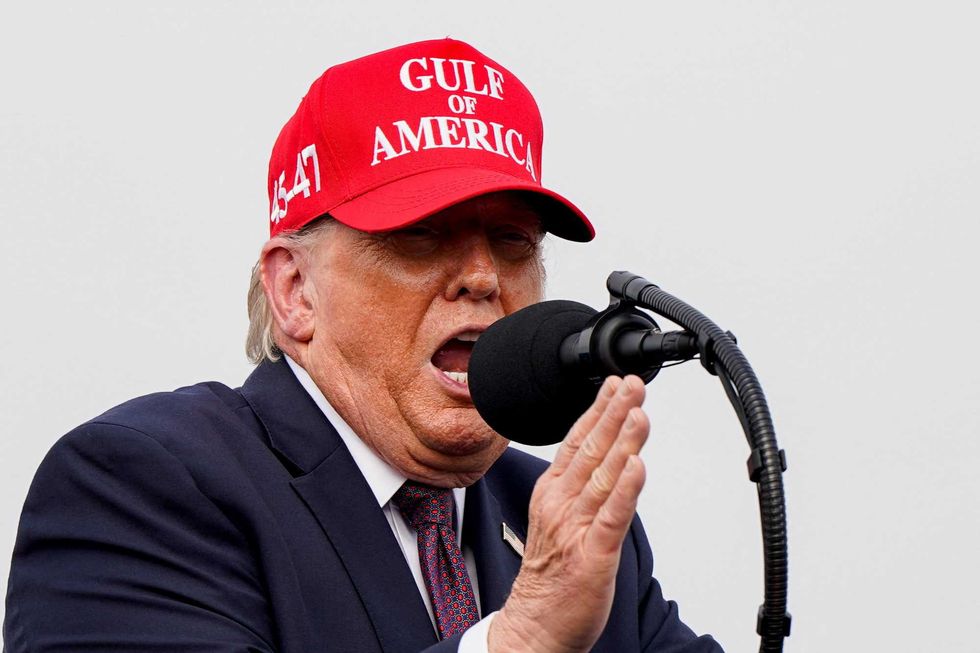

ความขัดแย้งลุกลามเป็นการเผชิญหน้าสาธารณะกับรัฐบาล Trump ประธานาธิบดี Donald Trump วิพากษ์วิจารณ์ Anthropic ว่าเป็น "พวกบ้าฝ่ายซ้าย" ในโพสต์โซเชียลมีเดีย เขาสั่งให้หน่วยงานของรัฐบาลกลางยุติการใช้ผลิตภัณฑ์ของบริษัทภายในหกเดือน รัฐมนตรีว่าการกระทรวงกลาโหม Pete Hegseth ยิ่งทำให้ความขัดแย้งรุนแรงขึ้นด้วยการกำหนดให้ Anthropic เป็นความเสี่ยงของห่วงโซ่อุปทาน การกำหนดนี้ห้ามผู้รับเหมาและพันธมิตรที่ทำธุรกิจกับทหารจากการมีส่วนร่วมเชิงพาณิชย์กับ Anthropic

ผลกระทบต่ออุตสาหกรรมและภูมิทัศน์การกำกับดูแล

ผลลัพธ์ที่แตกต่างกันสำหรับ OpenAI และ Anthropic เปิดเผยผลกระทบที่สำคัญต่ออุตสาหกรรม AI บริษัทต่างๆ ต้องนำทางความสัมพันธ์ที่ซับซ้อนกับหน่วยงานของรัฐในขณะที่รักษามาตรฐานจริยธรรมและความไว้วางใจของสาธารณะ แนวทางของ OpenAI แสดงให้เห็นว่าข้อตกลงที่เจรจาพร้อมมาตรการป้องกันเฉพาะแสดงถึงเส้นทางที่เป็นไปได้ ในทางกลับกัน ประสบการณ์ของ Anthropic แสดงให้เห็นถึงผลที่ตามมาที่เป็นไปได้ของการยืนจุดยืนทางจริยธรรมที่เข้มงวดกว่าต่อความต้องการของรัฐบาล

สถานการณ์นี้เกิดขึ้นภายในบริบทการกำกับดูแลที่กว้างขึ้น หลายประเทศกำลังพัฒนากรอบการทำงานสำหรับการใช้งาน AI ทางทหาร สหประชาชาติได้ดำเนินการอภิปรายอย่างต่อเนื่องเกี่ยวกับระบบอาวุธอัตโนมัติที่ทำให้เกิดการตาย นอกจากนี้ สหภาพยุโรปเพิ่งนำ AI Act มาใช้ ซึ่งรวมถึงบทบัญญัติเฉพาะสำหรับการใช้งานที่มีความเสี่ยงสูง การพัฒนาระดับโลกเหล่านี้สร้างสภาพแวดล้อมที่ซับซ้อนมากขึ้นสำหรับบริษัท AI ที่ดำเนินงานในภาคส่วนการป้องกันประเทศ

การดำเนินการทางเทคนิคและโปรโตคอลความปลอดภัย

ข้อตกลงของ OpenAI ประกอบด้วยองค์ประกอบทางเทคนิคหลายอย่างที่ออกแบบมาเพื่อให้แน่ใจว่าปฏิบัติตามมาตรการป้องกันด้านจริยธรรม ตามที่ผู้สื่อข่าว Fortune Sharon Goldman รายงาน Altman แจ้งพนักงานว่ารัฐบาลจะอนุญาตให้ OpenAI สร้าง "safety stack" ของตัวเองเพื่อป้องกันการใช้ในทางที่ผิด โครงสร้างพื้นฐานทางเทคนิคนี้แสดงถึงองค์ประกอบที่สำคัญของข้อตกลง นอกจากนี้ หากโมเดล OpenAI ปฏิเสธที่จะทำงานเฉพาะ รัฐบาลไม่สามารถบังคับให้บริษัทแก้ไขพฤติกรรมของโมเดล

มาตรการทางเทคนิคเหล่านี้แก้ไขข้อกังวลหลักเกี่ยวกับความน่าเชื่อถือและการจัดแนวของระบบ AI พวกเขาให้กลไกในการรับประกันว่าพฤติกรรม AI ยังคงอยู่ภายในขอบเขตจริยธรรมที่กำหนดไว้ การปรับใช้วิศวกร OpenAI เพื่อทำงานโดยตรงกับบุคลากรของเพนตากอนอำนวยความสะดวกในการดำเนินการที่เหมาะสมและการตรวจสอบอย่างต่อเนื่อง การกำกับดูแลทางเทคนิคแบบร่วมมือนี้แสดงถึงแนวทางที่เป็นนวัตกรรมต่อความร่วมมือทางทหาร-องค์กรในโดเมนเทคโนโลยีที่ละเอียดอ่อน

การเปรียบเทียบแนวทางของบริษัท AI ต่อสัญญาทางทหาร| บริษัท | ตำแหน่ง | มาตรการป้องกันหลัก | การตอบสนองของรัฐบาล |

|---|---|---|---|

| OpenAI | ข้อตกลงที่เจรจา | • ไม่มีการเฝ้าระวังจำนวนมากในประเทศ • ความรับผิดชอบของมนุษย์ต่อการใช้กำลัง • มาตรการป้องกันทางเทคนิค • การปรับใช้วิศวกร | มอบสัญญาพร้อมมาตรการป้องกัน |

| Anthropic | ข้อจำกัดทางจริยธรรม | • ไม่มีการเฝ้าระวังจำนวนมาก • ไม่มีอาวุธอัตโนมัติ • การปกป้องค่านิยมประชาธิปไตย | การกำหนดความเสี่ยงของห่วงโซ่อุปทาน สั่งยุติผลิตภัณฑ์ |

บริบทที่กว้างขึ้นและการพัฒนาระหว่างประเทศ

ข้อตกลง OpenAI-เพนตากอนเกิดขึ้นพร้อมกับการพัฒนาระหว่างประเทศที่สำคัญ ไม่นานหลังจากการประกาศของ Altman ข่าวเกิดขึ้นเกี่ยวกับการดำเนินการทางทหารของสหรัฐฯ และอิสราเอลต่อต้านอิหร่าน ประธานาธิบดี Trump เรียกร้องให้โค่นล้มรัฐบาลอิหร่าน การพัฒนาพร้อมกันเหล่านี้เน้นย้ำถึงภูมิทัศน์ทางภูมิรัฐศาสตร์ที่ซับซ้อนซึ่งเทคโนโลยี AI ทางทหารกำลังถูกนำไปใช้ พวกเขายังเน้นย้ำถึงความทันเวลาของการพิจารณาด้านจริยธรรมเกี่ยวกับระบบอัตโนมัติและความสามารถในการเฝ้าระวัง

ทั่วโลก ประเทศต่างๆ กำลังติดตามแนวทางที่หลากหลายสู่การบูรณาการ AI ทางทหาร:

- จีน ได้ติดตามการใช้งาน AI ทางทหารอย่างก้าวร้าวโดยมีข้อจำกัดด้านจริยธรรมสาธารณะน้อยกว่า

- รัสเซีย ได้นำระบบอัตโนมัติมาใช้ในพื้นที่ความขัดแย้งโดยมีความโปร่งใสจำกัด

- ประเทศในยุโรป โดยทั่วไปได้นำแนวทางที่ระมัดระวังมากขึ้นพร้อมการกำกับดูแลที่เข้มงวดขึ้น

- สหประชาชาติ การอภิปรายยังคงดำเนินต่อไปเกี่ยวกับสนธิสัญญาที่เป็นไปได้เกี่ยวกับอาวุธอัตโนมัติ

บริบทระหว่างประเทศนี้สร้างแรงกดดันในการแข่งขันที่มีอิทธิพลต่อการตัดสินใจนโยบายในประเทศ สหรัฐอเมริกาเผชิญกับความท้าทายในการรักษาความเหนือกว่าทางเทคโนโลยีในขณะที่รักษาค่านิยมประชาธิปไตยและมาตรฐานจริยธรรม ข้อตกลงของ OpenAI แสดงถึงแนวทางหนึ่งในการสร้างสมดุลระหว่างลำดับความสำคัญที่แข่งขันเหล่านี้

มุมมองของพนักงานและจริยธรรมในอุตสาหกรรม

จดหมายเปิดผนึกที่ลงนามโดยพนักงาน AI หลายร้อยคนเปิดเผยความตึงเครียดภายในอุตสาหกรรมที่สำคัญ คนงานด้านเทคโนโลยีตั้งคำถามมากขึ้นเกี่ยวกับผลกระทบด้านจริยธรรมของงานของพวกเขา โดยเฉพาะอย่างยิ่งเกี่ยวกับการใช้งานทางทหาร การเคลื่อนไหวของพนักงานนี้แสดงถึงปรากฏการณ์ใหม่ที่ค่อนข้างใหม่ในภาคเทคโนโลยีการป้องกันประเทศ ในอดีต ผู้รับเหมาด้านการป้องกันประเทศเผชิญกับการต่อต้านภายในน้อยกว่าต่อการใช้งานทางทหาร อย่างไรก็ตาม บริษัท AI ดึงดูดพนักงานที่มีความเชื่อมั่นทางจริยธรรมที่แข็งแกร่งเกี่ยวกับผลกระทบทางสังคมของเทคโนโลยี

พลวัตนี้สร้างความท้าทายด้านการจัดการสำหรับบริษัท AI ที่ติดตามสัญญาด้านการป้องกันประเทศ ผู้นำต้องสร้างสมดุลระหว่างความสัมพันธ์ของรัฐบาล โอกาสทางธุรกิจ และข้อกังวลของพนักงาน แนวทางของ OpenAI ในการเจรจามาตรการป้องกันเฉพาะแสดงถึงกลยุทธ์หนึ่งในการจัดการกับแรงกดดันที่แข่งขันเหล่านี้ ความเต็มใจของบริษัทในการสนับสนุนสาธารณะสำหรับการนำข้อกำหนดที่คล้ายกันมาใช้ทั่วทั้งอุตสาหกรรมบ่งบอกถึงความพยายามในการจัดตั้งบรรทัดฐานทางจริยธรรมในขณะที่รักษาการเข้าถึงของรัฐบาล

ผลกระทบทางกฎหมายและนโยบาย

การกำหนดความเสี่ยงของห่วงโซ่อุปทานของ Anthropic ทำให้เกิดคำถามทางกฎหมายที่สำคัญ บริษัทได้กล่าวว่าจะท้าทายการกำหนดดังกล่าวใดๆ ในศาล การฟ้องร้องที่อาจเกิดขึ้นนี้อาจสร้างแบบอย่างที่สำคัญเกี่ยวกับอำนาจของรัฐบาลในการจำกัดความสัมพันธ์เชิงพาณิชย์โดยอ้างอิงจากตำแหน่งจริยธรรมขององค์กร ผลลัพธ์อาจมีอิทธิพลต่อวิธีที่บริษัท AI อื่นๆ เข้าหาการเจรจาที่คล้ายกันกับหน่วยงานของรัฐ

ผู้เชี่ยวชาญด้านนโยบายสังเกตเห็นการพิจารณาหลักหลายประการ:

- สมดุลระหว่างความต้องการความมั่นคงของชาติและความเป็นอิสระทางจริยธรรมขององค์กร

- บทบาทที่เหมาะสมของมาตรการป้องกันทางเทคนิคในระบบ AI ทางทหาร

- กลไกในการรับประกันการปฏิบัติตามข้อจำกัดด้านจริยธรรม

- ผลกระทบระหว่างประเทศของแนวทางระดับชาติที่แตกต่างกัน

คำถามเชิงนโยบายเหล่านี้มีแนวโน้มที่จะได้รับความสนใจเพิ่มขึ้นในอีกไม่กี่เดือนข้างหน้า คณะกรรมาธิการของรัฐสภาได้ประกาศการประชุมเกี่ยวกับจริยธรรม AI ทางทหารแล้ว นอกจากนี้ ศูนย์วิจัยและสถาบันวิจัยหลายแห่งกำลังพัฒนากรอบนโยบายสำหรับการปรับใช้ AI ทางทหารอย่างมีความรับผิดชอบ

บทสรุป

ข้อตกลงของ OpenAI กับเพนตากอนพร้อมมาตรการป้องกันทางเทคนิคแสดงถึงเหตุการณ์สำคัญในการบูรณาการ AI ทางทหาร ข้อตกลงแสดงให้เห็นว่าแนวทางที่เจรจาพร้อมการป้องกันด้านจริยธรรมเฉพาะสามารถอำนวยความสะดวกในการเข้าถึงของรัฐบาลในขณะที่แก้ไขข้อกังวลที่ชอบด้วยกฎหมาย อย่างไรก็ตาม ประสบการณ์ที่แตกต่างกันกับ Anthropic เปิดเผยความตึงเครียดอย่างต่อเนื่องระหว่างลำดับความสำคัญด้านความมั่นคงของชาติและมาตรฐานจริยธรรมขององค์กร เมื่อเทคโนโลยี AI ก้าวหน้าต่อไป ความสัมพันธ์ที่ซับซ้อนเหล่านี้จะต้องมีการนำทางอย่างระมัดระวัง มาตรการป้องกันทางเทคนิคที่จัดตั้งขึ้นในข้อตกลงของ OpenAI อาจทำหน้าที่เป็นแบบอย่างสำหรับความร่วมมือทางทหาร-องค์กรในอนาคต ท้ายที่สุด ภูมิทัศน์ที่พัฒนาของการใช้งาน AI ทางทหารจะต้องมีการเจรจาอย่างต่อเนื่องระหว่างหน่วยงานของรัฐบาล บริษัทเทคโนโลยี พนักงาน และสังคมพลเรือนเพื่อให้แน่ใจว่านวัตกรรมที่มีความรับผิดชอบที่ปกป้องทั้งความมั่นคงและค่านิยมประชาธิปไตย

คำถามที่พบบ่อย

Q1: ข้อตกลงของ OpenAI กับเพนตากอนประกอบด้วยมาตรการป้องกันเฉพาะอะไรบ้าง?

ข้อตกลงห้ามการใช้งานการเฝ้าระวังจำนวนมากในประเทศและรักษาความรับผิดชอบของมนุษย์ต่อการใช้กำลัง รวมถึงระบบอาวุธอัตโนมัติ OpenAI จะนำมาตรการป้องกันทางเทคนิคมาใช้และปรับใช้วิศวกรเพื่อให้แน่ใจว่าปฏิบัติตาม

Q2: ทำไมการเจรจาของ Anthropic กับเพนตากอนจึงล้มเหลว?

Anthropic แสวงหาข้อจำกัดที่ชัดเจนเกี่ยวกับการเฝ้าระวังจำนวนมากในประเทศและอาวุธอัตโนมัติอย่างสมบูรณ์ ในขณะที่เพนตากอนผลักดันให้มีการเข้าถึง "วัตถุประสงค์ที่ถูกกฎหมายทั้งหมด" ความขัดแย้งพื้นฐานนี้ป้องกันข้อตกลงที่เจรจา

Q3: Anthropic เผชิญกับผลที่ตามมาอะไรบ้างจากจุดยืนทางจริยธรรมของบริษัท?

ประธานาธิบดี Trump สั่งให้หน่วยงานของรัฐบาลกลางยุติการใช้ผลิตภัณฑ์ของ Anthropic และรัฐมนตรีว่าการกระทรวงกลาโหม Hegseth กำหนดให้บริษัทเป็นความเสี่ยงของห่วงโซ่อุปทาน ห้ามผู้รับเหมาทางทหารจากการทำธุรกิจกับพวกเขา

Q4: พนักงานในอุตสาหกรรม AI ตอบสนองต่อการพัฒนาเหล่านี้อย่างไร?

พนักงานมากกว่า 360 คนจาก OpenAI และ Google ลงนามในจดหมายเปิดผนึกสนับสนุนตำแหน่งทางจริยธรรมของ Anthropic สะท้อนถึงข้อกังวลภายในที่สำคัญเกี่ยวกับการใช้งาน AI ทางทหาร

Q5: สถานการณ์นี้มีผลกระทบที่กว้างขึ้นอย่างไรต่อการกำกับดูแล AI?

ผลลัพธ์ที่แตกต่างกันเน้นย้ำถึงสมดุลที่ซับซ้อนระหว่างความมั่นคงของชาติ จริยธรรมขององค์กร และนวัตกรรมทางเทคโนโลยี อาจมีอิทธิพลต่อวิธีที่ประเทศและบริษัทอื่นๆ เข้าหาการบูรณาการ AI ทางทหาร

โพสต์นี้ ข้อตกลงของ OpenAI กับเพนตากอน: Sam Altman ได้รับสัญญา AI ที่สำคัญพร้อมมาตรการป้องกันทางเทคนิค ปรากฏครั้งแรกบน BitcoinWorld

คุณอาจชอบเช่นกัน

'ป่วย': กลุ่ม MAGA ตกตะลึงหลังนักสำรวจความคิดเห็นเปิดเผยการเคลื่อนไหวของรัฐบาลทรัมป์ก่อนปฏิบัติการทางทหาร

บิตคอยน์ลดลง 48% แต่ผู้ซื้อรายใหญ่ที่สุดในประวัติศาสตร์ยังคงสะสมอยู่