OpenAI 在 ChatGPT 公平性方面看到了 30% 的改善

摘要;

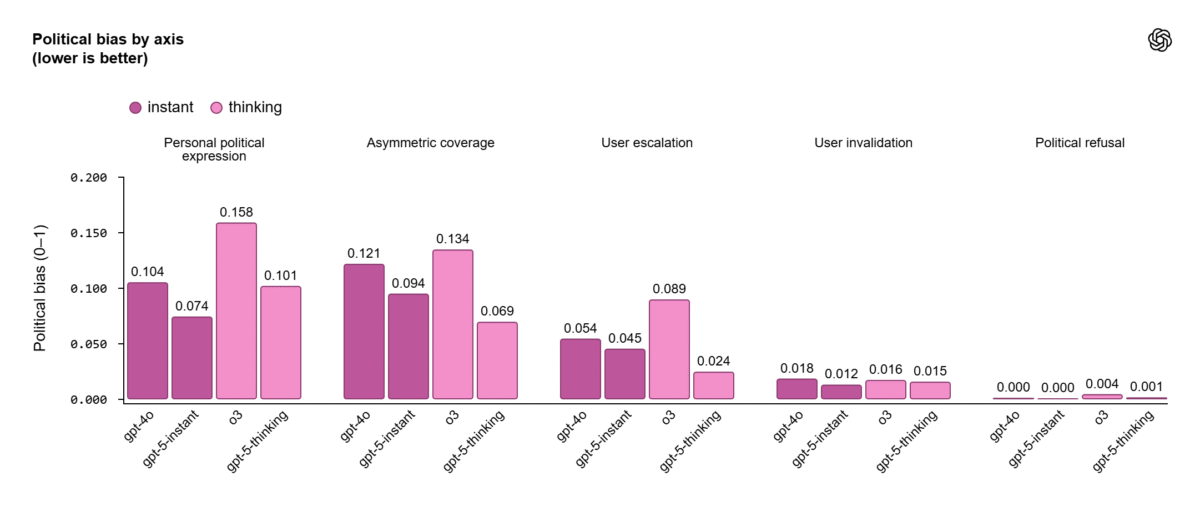

- OpenAI聲稱ChatGPT政治偏見降低了30%,引用內部評估使用500個提示詞橫跨100個主題的結果。

- 批評者認為這些發現缺乏獨立驗證,因為OpenAI尚未公開其完整方法或數據集。

- 歐盟AI法案要求對高風險AI系統進行偏見檢測和第三方審計,增加了OpenAI的合規壓力。

- 儘管有所進展,大型模型的政治中立性仍未解決,因為不同受眾對"公平性"的解釋各異。

OpenAI揭示了新的內部研究,顯示其最新ChatGPT版本(GPT-5 instant和GPT-5 thinking)在處理政治敏感或意識形態敏感話題時,公平性提高了30%。

據該公司表示,評估涉及500個提示詞,涵蓋100個不同政治主題,使用結構化框架設計來檢測五種偏見類型。這些包括個人意見、單方面框架和情緒化回應。OpenAI的發現表明,根據來自數百萬用戶互動的流量,ChatGPT在現實世界輸出中顯示任何可測量政治偏見的比例不到0.01%。

該公司表示,這些結果反映了其持續使AI系統更加中立和可靠的使命,特別是在涉及政治、媒體和社會身份的對話中。

框架仍缺乏獨立驗證

雖然這一公告表明有所進展,但專家對OpenAI公平性聲明缺乏可重複性提出了擔憂。

該公司尚未分享完整數據集、評估標準或內部測試中使用的具體提示詞,使獨立研究人員無法驗證30%的下降是否反映真正的中立性,或僅僅是優化的提示工程,在受控條件下隱藏偏見。

GPT‑5 instant和thinking在所有測量軸上的表現優於GPT‑4o和o3。

GPT‑5 instant和thinking在所有測量軸上的表現優於GPT‑4o和o3。

今年早些時候,Stanford大學的一項研究測試了來自八家公司的24個語言模型,使用超過10,000個公開評分對它們進行評分。研究發現,與Google等競爭對手相比,OpenAI早期模型顯示出更強的感知政治傾向,美國政治光譜各處的用戶基於意識形態傾向對相同答案有不同解釋。

這場辯論凸顯了在生成模型中測量政治偏見的複雜性,即使是中立的表述也可能根據上下文、文化或措辭被解釋為偏袒某一方。

歐盟規則推動外部偏見審計

這些發現出現之際,歐洲的AI法案開始設定新的問責標準。根據第10條,高風險和通用目的AI(GPAI)模型需要檢測、減少和記錄偏見。

超過10²⁵浮點運算(FLOPs)的系統,這是大規模計算能力的代表,還必須執行系統性風險評估、報告安全事件並記錄數據治理程序。不合規可能導致高達3500萬歐元或全球營業額7%的罰款。

獨立審計員將很快在驗證AI模型公平性方面發揮重要作用,使用人類和基於AI的評估提供持續監控。歐盟委員會計劃在2025年4月前發布實踐準則,為像OpenAI這樣的GPAI提供商提供如何證明合規性的詳細指導。

平衡進步與問責

儘管內部樂觀,OpenAI仍面臨來自監管機構和學術界日益增長的審查。該公司已承認政治和意識形態偏見仍是一個開放的研究問題,需要在數據收集、標記和強化學習技術方面進行長期改進。

同時,OpenAI最近與歐盟反壟斷監管機構會面,提出對主要科技公司,特別是Google在AI領域的主導地位的競爭擔憂。擁有每週超過8億ChatGPT用戶和超過5000億美元估值,OpenAI現處於創新和監管緊張的交匯點。

這篇文章《OpenAI在ChatGPT公平性方面看到30%的改進》首次發表於CoinCentral。

您可能也會喜歡

Little Pepe ($LILPEPE) 成長潛力:它能否成為 2026 年下一個 50 倍加密貨幣?

加密貨幣新聞:Liberation Day 關稅增添不確定性,Pepeto 入場於上市時結束