澳洲放棄了其人工智能策略

澳洲在週二發布了其人工智能策略。令人驚訝的部分?政府正在從先前討論的高風險人工智能使用的更嚴格規則中退步。

目前澳洲沒有任何特定的人工智能法律。去年,工黨政府表示可能會引入自願性指導方針,因為人們對隱私問題、安全性和透明度提出了擔憂。

週二的國家人工智能計劃專注於三件事:為先進數據中心獲取投資、建立人工智能技能以保護就業,以及在人工智能成為日常生活一部分時保障公眾安全。

政府計劃使用現有法律來管理人工智能風險,而不是創建新法律。「政府對人工智能的監管方法將繼續建立在澳洲現有的健全法律和監管框架上,確保已建立的法律仍然是解決和減輕人工智能相關風險的基礎,」該計劃指出。

各個政府機構將在自己的領域處理人工智能風險

全球監管機構一直在對生成內容的人工智能工具所產生的錯誤信息發出警告。微軟支持的 OpenAI 的 ChatGPT 和 Google 的 Gemini 正變得廣泛使用,這加劇了這些擔憂。

上個月,政府宣布將在2026年創建一個人工智能安全研究所。該研究所將幫助監控新出現的風險並應對威脅。

部長為平衡創新與安全辯護

聯邦工業部長 Tim Ayres 表示,該路線圖旨在幫助澳洲人從新技術中受益。它試圖平衡創新與風險管理。

「隨著技術不斷發展,我們將繼續完善和加強這個計劃,以抓住新機會並果斷行動保障澳洲人的安全,」Ayres 說。

不過,並非所有人都認同政府所倡導的內容。澳洲天主教大學副教授 Niusha Shafiabady 表示,更新後的路線圖存在關鍵缺口。

「該計劃在解鎖數據和提高生產力方面雄心勃勃,但在問責制、主權、可持續性和民主監督方面留下了關鍵缺口,」Shafiabady 說。

她補充道:「如果不解決這些未探索的領域,澳洲可能會建立一個高效但不公平或不受信任的人工智能經濟。」

如果你正在閱讀這篇文章,你已經領先了。訂閱我們的通訊保持領先。

您可能也會喜歡

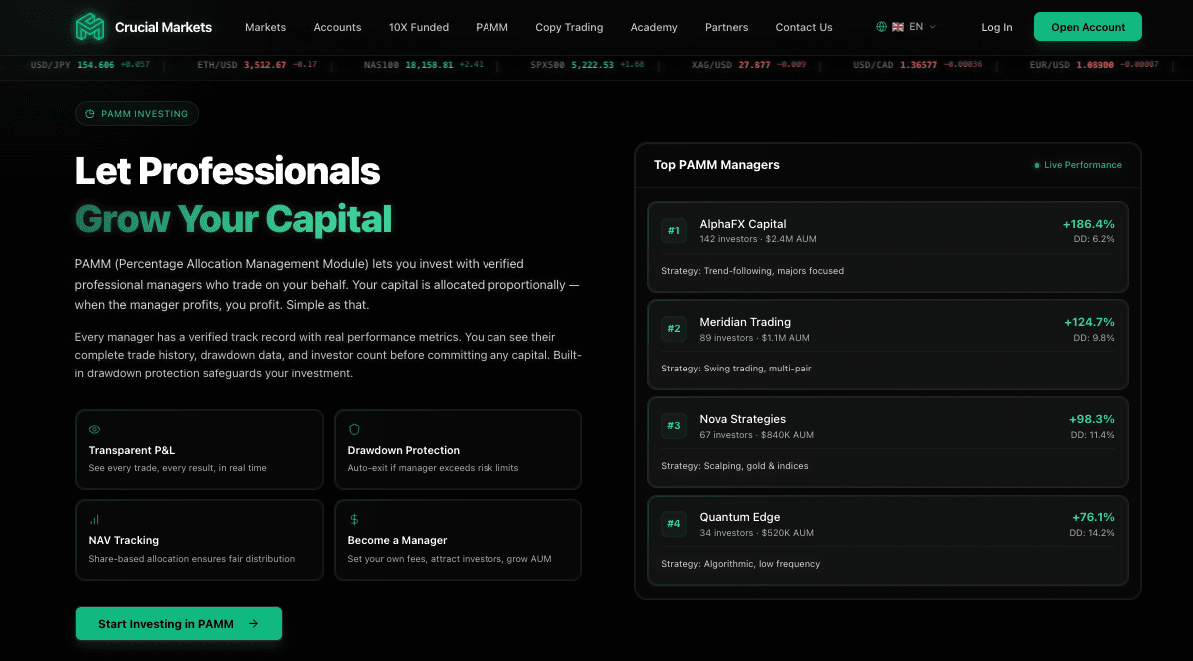

Crucial Markets 擴展跟單交易和 PAMM 基礎設施

CLARITY 法案面臨 2030 年延遲警告,來自參議員 Lummis

![[LENTE | 更新] 2026年BARMM選舉選民教育在塔威塔威持續進行](https://lente.rappler.com/tachyon/sites/12/2026/04/BCPCH-2-2-scaled.png?resize=75%2C75&crop_strategy=attention)