NVIDIA針對自駕車推出Alpamayo系列開源AI模型與工具 挹注基於推論且安全自駕技術發展

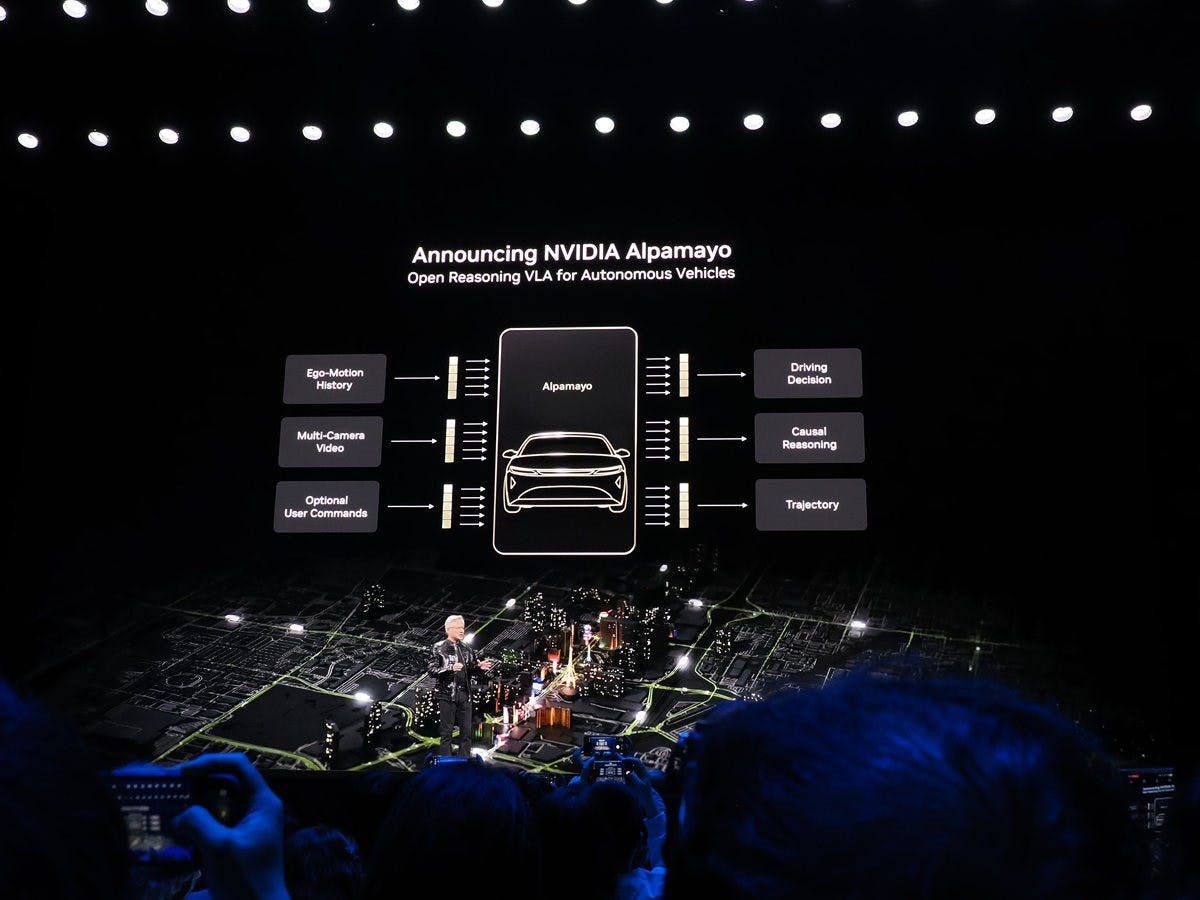

NVIDIA認為開源模型是驅動AI的重要關鍵,針對各個領域於推出高效能的開源模型不遺餘力;NVIDIA執行長黃仁勳於CES 2026的主題演講宣布針對車用的Alpamayo系列視覺推論動作語言模型,旨在解決自動駕駛於真實世界複雜環境決策的「長尾」挑戰,加速Level 4的自動駕駛技術能夠落實,同時NVIDIA也將Alpamayo的AI模型、模擬框件與資料集進行開源。

JLR、Lucid與Uber等移動服務領導者,以及包括 Berkeley DeepDrive在內的自駕研究社群皆對Alpamayo展現高度興趣,並有意藉Alpamayo開發Level 4等集的自動駕駛推論型技術堆疊。

Alpamayo系列模型是具備思維鏈且基於推理的視覺語言動作(VLA)模型,VLA如同物理AI的ChatGPT,將類人思維導入自動駕駛的決策過程,可逐步解析新穎或罕見的場景,提升智慧車輛信任度與安全性關鍵的駕駛能力與可解釋性,並建立在NVIDIA Halos安全系統技術之上。

NVIDIA拋磚引用開源Alpamayo三大核心,加速產業發展基於推論的Level 4自駕技術

▲Alpamayo並非直接在車輛執行的模型,而是作為骨幹供微調與蒸餾的「教師模型」

▲Alpamayo並非直接在車輛執行的模型,而是作為骨幹供微調與蒸餾的「教師模型」

NVIDIA在CES公布Alpamayo模型的AI模型、模擬框架與資料集等三大關鍵進行開源,汽車開發者與研究團隊可將此三大部分進行建構,不過Alpamayo並非針對在車輛內執行的模型,而是做為大規模的教師模型(teacher model),使開發者能進行微調與蒸餾,進而作為自動駕駛技術堆疊的核心骨幹。

Alpamayo 1模型是針對自動駕駛研究社群設計的思維鏈推論視覺語言動作模型,開發者現在可自Hugging Face下載:Alpamayo 1;Alpamayo 1具備百萬參數架構,可透過影片輸入產生行進軌跡與推論軌跡,並展現每個決策背後的邏輯;開發者可將Alpamayo 1改造成更精煉的版本用於車輛開發,或將其作為推論的評估器與自動標註系統等自動駕駛開發工具的基礎,同時提供開放的模型權重與開源推論指令集,未來將提供更大參數規模、更精細的推論能力與更靈活的輸出入選項與更多商業化用途。

AlpaSim是完全開源的端對端模擬框架,可呈現高度擬真的自動駕駛開發,現在已經在GitHub開放下載:AlpaSim;AlpaSim可提供逼真的模擬器建模、可配置的交通動態與具備可擴展性的閉環測試環境,提供可供快速驗證與策略最佳化。

此外NVIDIA也提供超過1,700小時在各種地理區域與環境的駕駛資料在內的大規模自駕開放資料集,其駕駛資料還包括有助提升推論架構的複雜真實世界邊際案例,開發者即日起可在Hugging Face取用:PhysicalAI大規模自駕開放資料集。

您可能也會喜歡

為何日本 265.3 億美元的金融科技市場凸顯區域多元化

2026年中國金融科技市場308.6億美元的預測揭示了什麼