NVIDIA Rubin超級運算平台以6大晶片、軟硬體協同設計 降低10倍推論詞元成本、僅需1/4的GPU即可訓練混合專家模型

隨著NVIDIA預期在2026年3月的GTC大會正式揭開Rubin平台細節,NVIDIA執行長黃仁勳於CES 2026的主題演講尾聲繼續聚焦Rubin平台,強調透過全新6款晶片高度的協同設計,能大幅縮減訓練時間與降低推論詞元成本,相對Blackwell可將推論詞元(Token)成本降低10倍、並僅需1/4的GPU即可完成混合專家模型訓練。

6大全新晶片與2種平台

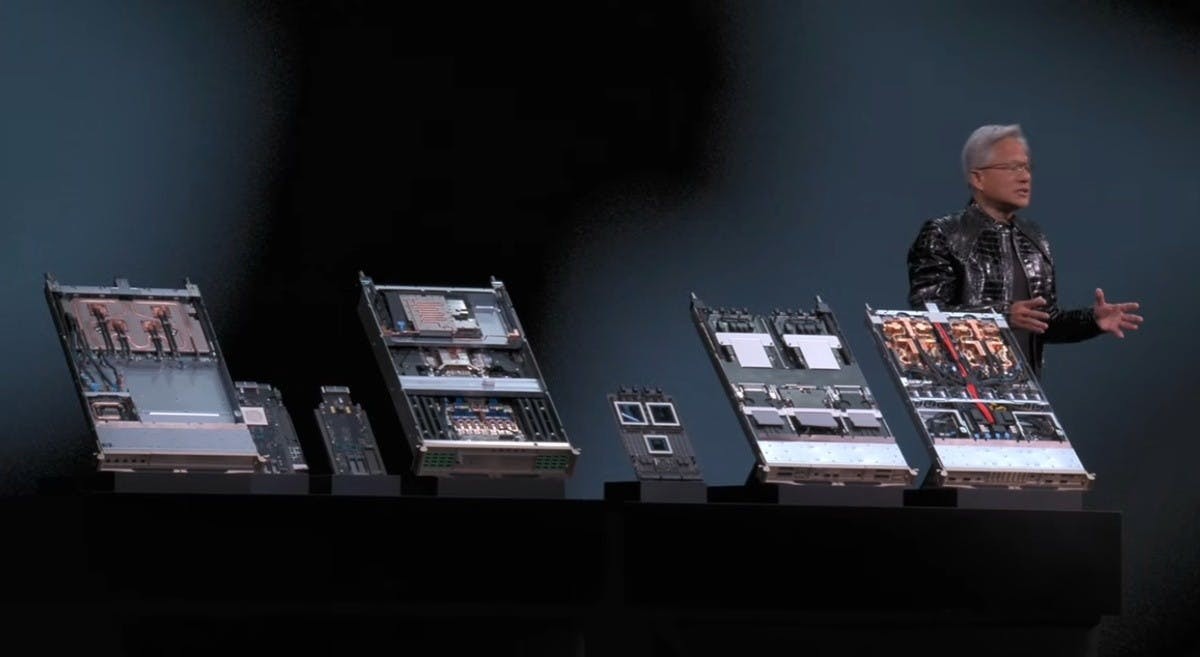

▲Rubin平台由6款緊密協同設計的新晶片構成平台基礎

▲Rubin平台由6款緊密協同設計的新晶片構成平台基礎

黃仁勳強調,Rubin的平台進一步將關鍵元件進行極致的協同設計,使每個晶片在其負責的領域發揮極致的性能,進一步突破性能極限,相較Blackwell又是一次更重大的技術突破。

Rubin平台由6大關鍵新晶片構成,包括NVIDIA Vera CPU、NVIDIA Rubin GPU、NVIDIA NVLink 6交換器、NVIDIA ConnectX-9 SuperNIC、NVIDIA BlueField-4 DPU與NVIDIA Spectrum-6乙太網路交換器,以及基於NVIDIA SuperChip設計的NVIDIA Vera Rubin NVL72機架級解決方案與採用8個Rubin SXM模組與NVLink構成的NVIDIA HGX Rubin NVL8系統。

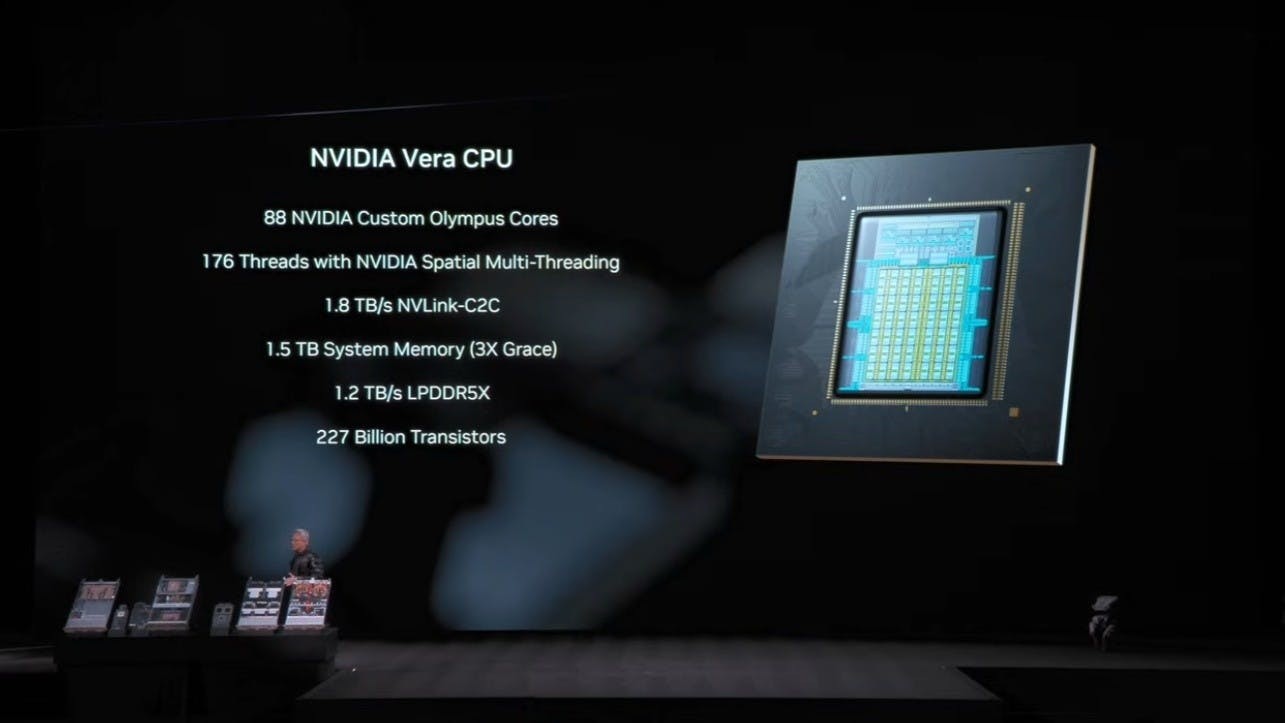

▲Vera CPU具備88核NVIDIA客製化Olympus核心與支援多執行緒技術

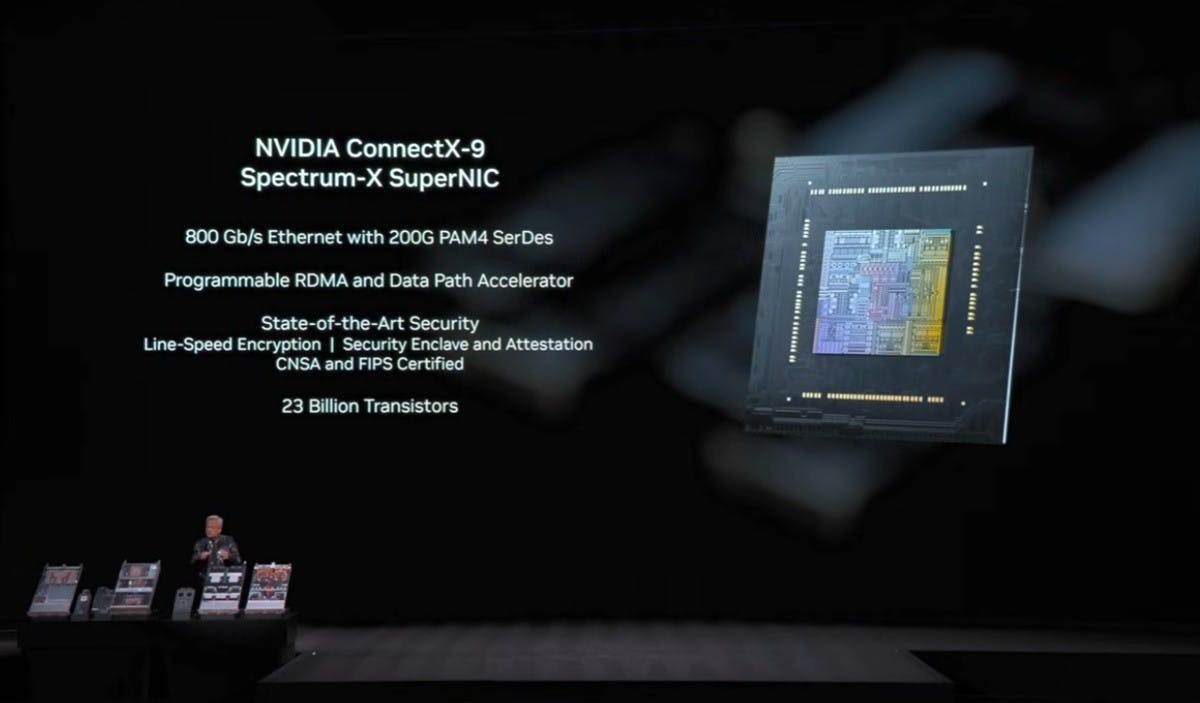

▲Vera CPU具備88核NVIDIA客製化Olympus核心與支援多執行緒技術 ▲ConnectX-9 Spectrum-X SuperNUC支援800GB/s乙太網路與200G PAM4 SarDes

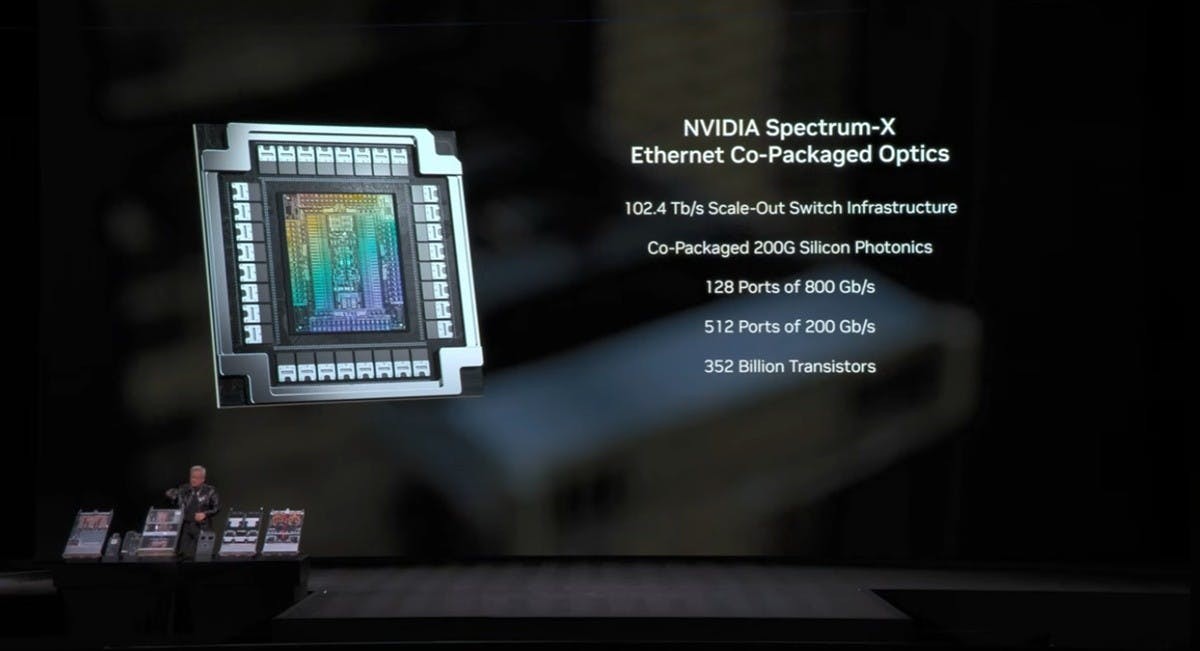

▲ConnectX-9 Spectrum-X SuperNUC支援800GB/s乙太網路與200G PAM4 SarDes ▲NVIDIA Spectrum-X乙太網路偕同封裝光學晶片可滿足高頻寬、低延遲的大量高速互聯需求

▲NVIDIA Spectrum-X乙太網路偕同封裝光學晶片可滿足高頻寬、低延遲的大量高速互聯需求

此外,Rubin平台還具備5項創新技術,包括具備更高互聯頻寬的NVIDIA NVLink技術,Transformer Engine,機密運算與RAAS Engine,新一代Arm架構Vera CPU等,其中Vera CPU採用客製化的88核Olympus核心,支援稱為NVIDIA Spatial Multi-Threading的超執行緒技術,進一步提升多工處理性能;透過五大創新技術,使Rubin平台可加速代理型AI、新進推論、大規模混合專家(MoE)模型推論,並大幅降低詞元成本與模型訓練所需的GPU數量。

生態系與多家雲端及AI領導者已著手布局Rubin平台

▲多家領先的AI與雲服務廠商已經著手布局Rubin平台

▲多家領先的AI與雲服務廠商已經著手布局Rubin平台

包括 Amazon Web Services(AWS)、Anthropic、Black Forest Labs、思科、Cohere、CoreWeave、Cursor、戴爾科技集團、Google、Harvey、慧與科技、Lambda、聯想集團、Meta、微軟、Mistral AI、Nebius、Nscale、OpenAI、OpenEvidence、Oracle Cloud Infrastructure(OCI)、Perplexity、Runway、Supermicro、Thinking Machines Lab與xAI已經計畫將採用Rubin平台。

其中微軟新一代Fairwater AI超級工廠預計採用NVIDIA Vera Rubin NVL72機架型系統,規模將達數十萬個Vera Rubin超級晶片;CoreWeave將率先提供NVIDIA Rubin服務,並以CoreWeave Mission Control運作,提供效能及彈性;此外NVIDIA將擴大攜手Red Hat合作,針對Rubin平台提供最佳化的AI軟體堆疊,包括Red Hat Enterprise Linux、Red Hat OpenShift 與Red Hat AI等。

您可能也會喜歡

為何日本 265.3 億美元的金融科技市場凸顯區域多元化

2026年中國金融科技市場308.6億美元的預測揭示了什麼