Meta 宣布將在 2027 年前推出 MTIA 300、400、450 與 500 四代晶片,採超高速迭代策略與推論優先設計,目標透過自研硬體降低龐大推論成本。

面對旗下數十億用戶每日龐大的AI生成與推薦運算需求,Meta決定將硬體命運進一步掌握在自己手中。Meta揭曉其客製化晶片Meta Training and Inference Accelerator (MTIA)的最新發展藍圖。有別於傳統晶片廠一至兩年的產品週期,Meta宣示將在短短兩年內 (至2027年)將接續推出包含MTIA 300、400、450與500總計四代新晶片。

透過獨特的「模組化小晶片」 (Chiplet)設計與「推論優先」 (Inference-First)的戰略,Meta試圖在高度依賴NVIDIA等商用GPU的現狀下,走出一條兼具極致效能與成本效益的自研道路。

打破摩爾定律節奏:半年一更的「超高速迭代」

在傳統半導體業界,開發、推出一款全新的AI晶片通常需要一到兩年的時間。然而,AI模型的演進速度早已把硬體開發週期遠遠甩在後頭。

為了不讓硬體落後於軟體,Meta採取了極度激進的「超高速迭代」 (High Velocity)策略——將推出新晶片的週期縮短至大約每六個月一次。這種近乎「軟體敏捷開發」的速度,歸功於其高度模組化的設計思維。從MTIA 400到500,Meta都採用了相同的機箱、機架與網路基礎設施 (並且符合OCP開放運算計畫標準),這意味新一代的晶片可以直接「隨插即用」 (Drop-in)替換到現有的伺服器機架中,大幅縮短從晶片出廠到資料中心上線的時間。

兩年四代戰力解析:劍指高頻寬記憶體 (HBM)

根據Meta公布的時程與規格,這四款MTIA晶片各自肩負著不同階段的戰略任務:

• MTIA 300 (已量產):作為高性價比的基石,主要針對Meta傳統的「排序與推薦」 (R&R)系統進行最佳化,同時也為後續的GenAI晶片打下網路與通訊架構的底層基礎。

• MTIA 400 (即將佈署):這是Meta首款具備與市售頂級商業晶片 (如NVIDIA系列)正面對決實力的產品。除了維持推薦系統的運算外,大幅強化GenAI的支援能力,其FP8算力相比前代提升400%,HBM記憶體頻寬也提升51%。

• MTIA 450 (預計2027年初):專為「GenAI 推論」量身打造。由於大型語言模型 (LLM)的推論速度極度依賴記憶體頻寬,MTIA 450直接將HBM頻寬翻倍,並且導入專為推論設計的低精度資料格式 (如MX4),效能甚至超越市面領先的商業產品。

• MTIA 500 (預計2027年):進一步挑戰極限,在450的基礎上再將HBM頻寬提升50%、MX4算力提升43%,並且採用更先進的2×2小型運算小晶片 (Chiplet)配置,實現以最低成本輸出最大規模的AI推論能力。

「推論優先」與無痛轉移的軟體生態圈

目前市場上的主流GPU幾乎都是為了最吃重算力的大規模生成式AI「預訓練」 (Pre-training)而設計,隨後才被「降維」拿來做推論使用。Meta認為這種做法在成本上極度不划算。

因此,MTIA 450與500採取完全相反的「推論優先」 (Inference-First)策略,從一開始就是為解碼生成 (Decode)與專家混合模型 (Mixture-of-Experts,MoE)架構最佳化,確保在應付數十億用戶日常呼叫Meta AI助理時,能將每單位的算力成本壓到最低。

更重要的是,身為全球最受歡迎AI框架PyTorch的發明者,Meta讓MTIA從一開始就做到「原生支援PyTorch」。開發者無需重新編寫程式碼,就能讓模型在商業GPU與MTIA之間無縫遷移,徹底消除了導入新硬體的陣痛期。

分析觀點

Meta這次一口氣攤牌未來兩年的MTIA設計路線圖,實際上傳遞一個作法:「買卡訓練模型可以,但拿高價GPU來服務免費用戶,門都沒有」。

訓練一個像Llama 4,或未來的Llama 5此類超級模型,的確需要數以萬計的頂規商用GPU (這也是為何Meta依然是NVIDIA的大型客戶)。但訓練是一次性的支出;當模型上線後,每天面對Facebook、Instagram與WhatsApp上動輒30億名活躍用戶的海量「推論」請求,將是一筆沒有盡頭的無底洞營運成本。

如果Meta每生成一段文字、每推薦一支Reels都要繳納高昂的「GPU硬體稅與耗電稅」,這家公司的毛利率將會被迅速吞噬。MTIA家族的誕生與光速迭代,本質上就是Meta為了保護自身獲利模式所築起的硬體護城河。

透過將開源軟體 (PyTorch、vLLM)與開放硬體 (OCP)深度綁定,Meta不僅在擺脫單一硬體供應商的束縛,更向業界證明:在特定的巨量應用場景中,量身訂做的ASIC (特殊應用積體電路)將遠比GPU來得有用且高效。

資料來源

- https://mashdigi.com/meta-announced-a-two-year-push-to-launch-four-generations-of-its-self-developed-mtia-ai-chips-focusing-on-inference-first-and-ultra-fast-iteration/

您可能也會喜歡

綠能解密:鈣鈦礦為何突然成為太陽能新寵兒?

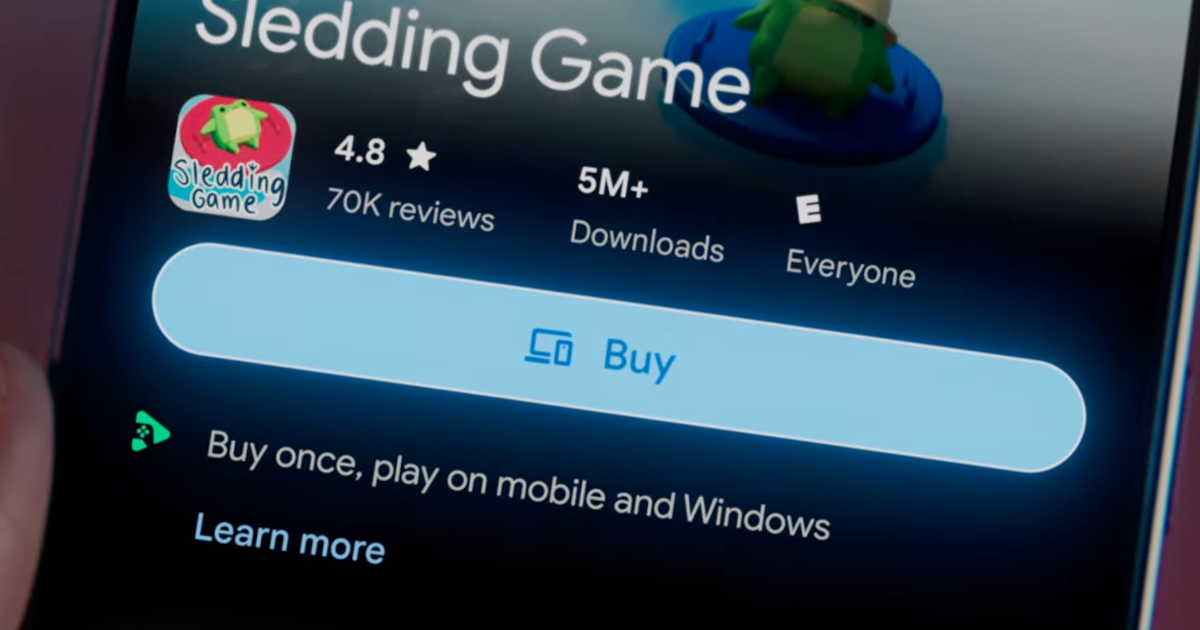

Google Play 大翻新:買一次遊戲,手機、電腦都能玩