AIUC-1: Der neue Goldstandard für vertrauenswürdige Unternehmens-KI

Überbrückung der CX-Vertrauenslücke: Verantwortungsvolle KI mit AIUC-1

Stellen Sie sich eine CX-Direktorin, Maria, in einem angespannten Videoanruf mit dem CEO vor. „Letzte Woche hat unser KI-Chatbot einen VIP-Kunden falsch identifiziert und ihm versehentlich die Preisliste eines Konkurrenten per E-Mail geschickt", schnappt der CEO. Daten sind durchgesickert; das Kundenvertrauen ist erschüttert. Im folgenden Chaos gibt die IT dem Produktteam die Schuld, das Produktteam der Rechtsabteilung, und das Marketingteam ist sich nicht einmal sicher, was passiert ist. Maria wird schmerzlich bewusst, dass isolierte Teams und beschleunigte KI-Einführungen kritische Daten- und Datenschutz-Leitplanken undefiniert ließen – und der Ruf ihrer Marke nun an einem seidenen Faden hängt.

Dieses Szenario ist keine Fiktion. Während KI-Chatbots, Sprachagenten und Empfehlungsmaschinen Kundenkontaktpunkte überfluten, können Fehler und undurchsichtige Datenpraktiken das Vertrauen über Nacht zerstören. Unternehmen stehen vor einem klaren Dilemma: KI verspricht Hyperpersonalisierung und Effizienz, aber Fehltritte (halluzinierte Antworten, unbefugte Datennutzung, IP-Lecks) können die Kundenerfahrung irreparabel schädigen. CX- und EX-Führungskräfte benötigen ein neues Playbook – ein strukturiertes Framework für eine verantwortungsvolle KI-Steuerung.

Wichtige Erkenntnisse:

- Vertrauen in Gefahr: KI-Ausfälle (wie selbstsichere falsche Antworten oder Datenlecks) untergraben direkt das Kundenvertrauen und die Kundenbindung. Umfragen zeigen, dass 53 % der Verbraucher befürchten, dass ihre persönlichen Daten von KI missbraucht werden, und fast die Hälfte würde nur dann mehr Daten teilen, wenn Unternehmen mehr Transparenz und Kontrolle bieten.

- Erster AI Agent-Standard: AIUC-1 ist der weltweit erste umfassende Standard für AI Agents, der von Sicherheits- und KI-Experten entwickelt wurde, um unternehmensweite Bedenken anzugehen. Er umfasst zentrale Risikobereiche (Daten & Datenschutz, Sicherheit, Safety, Zuverlässigkeit, Verantwortlichkeit, Gesellschaft) und schafft eine gemeinsame „Vertrauensinfrastruktur" für die KI-Einführung.

- Verpflichtende Daten-/Datenschutzkontrollen: AIUC-1 erzwingt strenge Daten- und Datenschutzanforderungen. Beispielsweise verlangt es klare Richtlinien für Eingabe-/Ausgabedaten, Beschränkungen bei der Datenerfassung und technische Schutzmaßnahmen gegen das Durchsickern von PII oder Geschäftsgeheimnissen. Diese Leitplanken zielen darauf ab, Vorfälle wie den zu verhindern, den Marias Unternehmen gerade erlebt hat.

- Zertifizierung und Versicherung: Die AIUC-1-Zertifizierung bedeutet, dass ein KI-System rigorosen Tests unterzogen wurde (Tausende von simulierten Ausfällen in verschiedenen Risikoszenarien). Frühe Anwender wie ElevenLabs haben AIUC-1-Zertifikate und sogar KI-Versicherungen für ihre Sprachagenten erhalten, was Kunden und Partnern signalisiert, dass ihre KI geprüft ist.

- Zusammenarbeit ist entscheidend: AIUC-1 wurde von Führungskräften von Microsoft, Cisco, JPMorgan Chase, UiPath, ElevenLabs und anderen entwickelt und spiegelt einen Konsens wider, dass KI-Sicherheit/-Sicherheit funktionsübergreifendes Handeln erfordert. Frameworks wie Microsofts Secure Development Lifecycle für KI betonen ebenfalls, dass Sicherheit eine Arbeitsweise sein muss, kein Kontrollkästchen.

- Fallstricke des „AI-Washing": Viele Anbieter kleben „KI" auf Produkte ohne echte Daten oder Schutzmaßnahmen, aber Kunden durchschauen dies schnell. Übertriebene Behauptungen (wie „KI auf Unternehmensniveau" ohne Datenherkunft) führen zu inkonsistenten Outputs, die das Vertrauen untergraben und die Abwanderung fördern. Schlimmer noch, Regulierungsbehörden verschärfen die Kontrollen: Die SEC und FTC haben Unternehmen für irreführende KI-Behauptungen mit Geldstrafen belegt.

Häufige Fallstricke: CX-Führungskräfte sollten auf Folgendes achten…

- AI-Washing: Bereitstellung „unbeaufsichtigter" AI Agents ohne neue Daten oder Modelle. Kunden sehen schnell null Verbesserung, was der Markenglaubwürdigkeit schadet.

- Datenübergriff: Horten von Kundendaten „nur für den Fall", ohne klare Richtlinien, führt zu Datenschutzverletzungen. Wie Qualtrics rät, „Hören Sie auf, alles nur des Habens willen zu sammeln"; nur das zu sammeln, was Sie benötigen (mit Zustimmung und klarem Zweck) schafft Vertrauen.

- Isolierte Governance: KI als rein technisches Tool behandeln und dabei Sicherheit, Recht und CX-Input ignorieren. Wenn Teams nicht bei KI-Risiken zusammenarbeiten (wie Microsoft warnt), entstehen Vertrauenslücken an Kundenkontaktpunkten.

- Red-Teaming überspringen: Generative KI-Funktionen ohne adversarische Tests oder Überwachung starten. Ohne mehrschichtige Schutzmaßnahmen (wie Prompt-Filter oder Anomalieerkennung) können KI-Outputs PII durchsickern lassen, halluzinieren oder IP verletzen.

- Standards vernachlässigen: Die Nichtanpassung an aufkommende KI-Frameworks (z. B. AIUC-1, MITRE ATLAS) lässt Unternehmen unvorbereitet für Audits oder Versicherungen. Das Ergebnis sind blockierte Projekte, rechtliche Risiken und verlorene Kundenloyalität.

- Undurchsichtige KI-Nutzung: Kunden nicht informieren, wenn KI im Spiel ist oder wie ihre Daten verwendet werden. Dieser „Black Box"-Ansatz wird schnell als Misstrauen empfunden; Transparenz ist im Zeitalter der generativen KI nicht verhandelbar.

Was ist AIUC-1 und warum ist es für CX wichtig?

AIUC-1 ist das erste branchenweite Standard-Framework speziell für AI Agents, das Daten/Datenschutz, Sicherheit, Safety und mehr abdeckt. Es kodifiziert Best Practices (und technische Kontrollen), damit Unternehmen KI-Risiken konsistent messen und verwalten können. In praktischer Hinsicht gibt AIUC-1 CX-Teams eine gemeinsame Sprache, um jede KI-Lösung zu bewerten: „Ist dieser Agent sicher, zuverlässig und respektvoll im Umgang mit Kundendaten?" Durch die Standardisierung dieser Antworten baut AIUC-1 die Vertrauensinfrastruktur auf, die die Unternehmens-KI-Einführung freischaltet.

Wie erzeugen Daten- und Datenschutzprobleme eine Vertrauenslücke?

Das Kundenvertrauen zerbricht in dem Moment, in dem ein AI Agent personenbezogene Daten missbraucht oder vertrauliche Informationen durchsickern lässt. Moderne KI-Systeme greifen auf verstreute Daten zurück und haben ein „probabilistisches Gedächtnis", was bedeutet, dass sie versehentlich PII oder geistiges Eigentum preisgeben können, wenn sie nicht streng kontrolliert werden. Beispielsweise könnte ein AI Agent, der unwissentlich auf CRM-Einträgen trainiert, sensible Kundendetails öffentlich wiedergeben. CX-Experten warnen, dass solche Lecks – oder sogar unvorhersehbares Verhalten bei KI-Modell-Updates – die Kundenerfahrung direkt untergraben. In regulierten Branchen lädt dies auch zu rechtlichen und Compliance-Zusammenbrüchen ein.

AIUC-1 bekämpft diese Risiken, indem es klare Datenrichtlinien und Kontrollen vorschreibt. Es zwingt Teams zu definieren, wie Eingabedaten verwendet und geschützt werden (A001), welche Ausgaben die KI generieren kann und wem sie gehören (A002), und die Datenerfassung strikt auf das für die Aufgabe Relevante zu beschränken (A003). Diese Schritte stellen sicher, dass die persönlichen oder Unternehmensdaten eines Kunden nicht ohne Aufsicht von der KI konsumiert oder gespeichert werden. Kurz gesagt, klare Eingabe-/Ausgabe-Governance und Zugriffskontrollen sind die erste Verteidigungslinie gegen die Fehlbehandlung von Kundeninformationen.

Welche Daten- und Datenschutzkontrollen erzwingt AIUC-1?

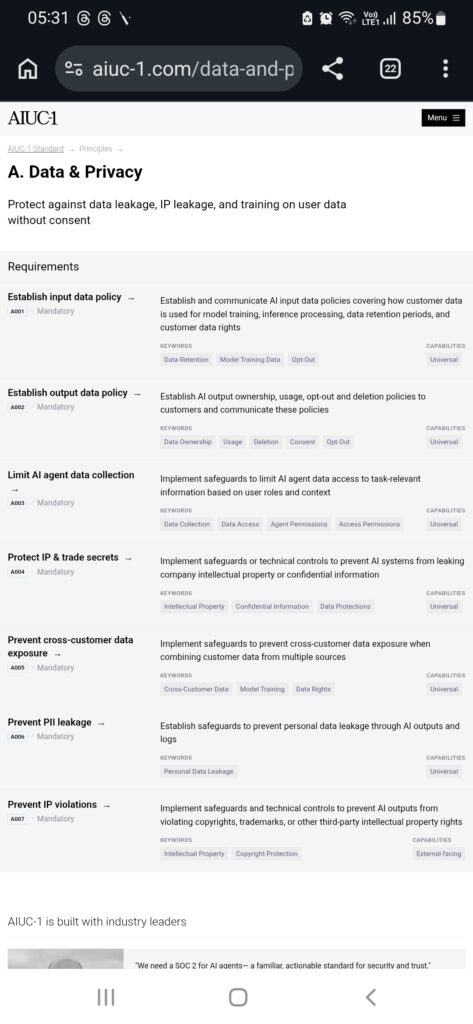

AIUC-1 listet mehrere verpflichtende Anforderungen auf, um die Datennutzung in KI-Systemen zu sperren. Wichtige Beispiele sind: Etablierung von Eingabedaten-Richtlinien (wie und wann Kundendaten für Training oder Inferenz verwendet werden und Datenspeicherung/-rechte); Formalisierung von Ausgabedaten-Richtlinien (Definition, wem KI-generierte Daten gehören, Nutzungsrechte, Opt-out- und Löschprozesse); und Beschränkung der KI-Datenerfassung strikt auf aufgabenrelevante Eingaben basierend auf Rollen.

Entscheidend ist, dass AIUC-1 auch technische Schutzmaßnahmen vorschreibt: Verhindern, dass die KI Unternehmens-IP oder Geschäftsgeheimnisse durchsickern lässt (A004); jede kundenübergreifende Datenvermischung blockieren, wenn eine KI Mehrmandanten-Eingaben hat (A005); PII-Durchsickern durch Ausgaben oder Protokolle stoppen (A006); und sicherstellen, dass KI-Ausgaben keine Urheberrechte oder Marken Dritter verletzen (A007). Zusammen verwandeln diese Kontrollen abstrakte Datenschutzziele in konkrete Prüfungen: Datensätze auditieren, Protokolle verschlüsseln, Modelle sandboxen und DPIA-ähnliche Überprüfungen anwenden. Für CX-Führungskräfte ist das Ergebnis messbar: Richtlinien und Tools, die Kunden zeigen „unsere KI wird Ihre Daten oder die anderer nicht missbrauchen".

Wie baut die AIUC-1-Zertifizierung Vertrauen wieder auf?

Ein AIUC-1-Zertifikat bedeutet, dass ein AI Agent über 5 000 adversarische Simulationen über Sicherheits-, Datenschutz- und Safety-Szenarien bestanden hat. Tatsächlich ist es ein Drittanbieter-Stempel, dass „diese KI getestet und sicher ist". Für Kunden und Partner ist das mächtig. ElevenLabs berichtet, dass der Erwerb von AIUC-1 es ihnen ermöglichte, ihre KI-Sprachagenten wie Mitarbeiter zu versichern – von Fehlern durch Halluzinationen bis zu Lecks. Wie der Mitbegründer von AI Underwriting erklärt, „sind führende Versicherer so zuversichtlich in diesen zertifizierungsbasierten Ansatz, dass sie denjenigen, die ihn erwerben, KI-spezifische Finanzdeckung anbieten. ElevenLabs ist das erste Unternehmen, das beweist, dass dieses Modell im großen Maßstab funktioniert".

In der Praxis verschiebt Zertifizierung + Versicherung das Risiko. Anstatt Unbekanntes zu fürchten („Was ist, wenn unser Chatbot durchdreht?"), können Unternehmen die Haftung auf das Framework übertragen: Wenn die KI trotz AIUC-1-Leitplanken versagt, ist der Verlust gedeckt. Dies beseitigt eine enorme psychologische Barriere für die Verwendung von KI in Kernworkflows. Wie der Mitbegründer von ElevenLabs feststellt, beschleunigt AIUC-1 (und die Versicherung, die es freischaltet) die Unternehmensbereitstellung, indem es Partnern „das Sicherheitsframework und die KI-Versicherungsdeckung gibt, die sie benötigen". Für CX/EX-Führungskräfte bedeutet dies, dass mehr Pilotprojekte in die Produktion übergehen und ein stärkeres Verkaufsargument beim Aufbau von Kundenvertrauen entsteht.

Wie können sich CX/EX-Führungskräfte auf verantwortungsvolle KI vorbereiten?

Beginnen Sie mit Governance und Richtlinien, nicht nur mit Technologie. Definieren Sie jetzt Ihre Datennutzungsregeln: Entscheiden Sie, welche Kundendaten KI-Modelle speisen, wie lange sie gespeichert werden und wie Benutzer sich abmelden können. Beziehen Sie funktionsübergreifende Teams frühzeitig ein – Recht, Sicherheit, Data Science und Produkt – und spiegeln Sie den Microsoft SDL-Ansatz wider, der Sicherheit als kollaboratives Designprinzip behandelt. Fordern Sie als Nächstes Transparenz sowohl intern als auch für Kunden. Folgen Sie beispielsweise Microsofts Vorbild, indem Sie klar offenlegen, wann ein Benutzer mit KI interagiert, und ihm die Kontrolle über seine Daten geben.

Übernehmen Sie Standards wie AIUC-1 als Leitstern. Verwenden Sie seine Daten-/Datenschutz-Checkliste, um KI-Anbieter und interne Projekte zu auditieren: Beschränken wir die Datenerfassung? Verschlüsseln wir Protokolle? Verhindern wir PII-Inferenz? Wenn nicht, investieren Sie jetzt in diese Kontrollen. Beauftragen Sie frühzeitig einen akkreditierten Auditor, um Ihre KI-Assets zu erfassen – das AIUC-1-Konsortium bietet Anleitung, wo jede Kontrolle gilt. Erwägen Sie eine Pilotzertifizierung für wichtige AI Agents; beispielsweise tauchen Sprach- oder Verkaufs-Bots oft zuerst bei CX-Transformationen auf. Wie das Beispiel von ElevenLabs zeigt, kann die Integration eingebauter Schutzmaßnahmen die Zertifizierung beschleunigen: Einer ihrer Kunden zertifizierte einen 24/7-Immobilienanfrage-Sprachbot in nur vier Wochen.

Schließlich messen und iterieren Sie auf Kundenfeedback. Überwachen Sie KI-gesteuerte Interaktionen genau: Brechen Kunden ab oder erheben Beschwerden nach einem KI-Kontaktpunkt? Verwenden Sie CX-Metriken, um Probleme zu erkennen, die die KI-Tests möglicherweise übersehen. Und denken Sie daran, Vertrauen wird im Laufe der Zeit verdient – wie ein Qualtrics-Experte es ausdrückt, kommt der echte KI-Wert davon, „Verbindungen aufzubauen und die menschliche Erfahrung zu verbessern, wobei fähige AI Agents einfache Aufgaben verwalten und menschliche Agenten bei komplexen Problemen unterstützen". Halten Sie Menschen dort in der Schleife, wo es am wichtigsten ist, und lassen Sie KI den Rest innerhalb Ihrer neuen Governance-Leitplanken handhaben.

Häufig gestellte Fragen

Was genau ist AIUC-1?

AIUC-1 ist ein neuer Branchenstandard und Zertifizierungsframework für KI-„Agents" (Software-Bots und Assistenten), der alle wichtigen Risikokategorien abdeckt. Es wurde von Experten von Unternehmen wie Microsoft, Cisco, JPMorgan Chase, UiPath und ElevenLabs erstellt, um Unternehmen ein klares Framework (wie ein „SOC 2" für KI) bei der Bewertung von KI-Systemen zu geben. Durch die Erfüllung der AIUC-1-Anforderungen demonstriert ein KI-Produkt, dass es auf Sicherheit, Datenschutz, Zuverlässigkeit und andere Bedenken getestet wurde.

Welche Daten- und Datenschutzprobleme adressiert AIUC-1?

Der Standard schreibt spezifische Kontrollen zur Datennutzung vor: Etablierung schriftlicher Richtlinien für KI-Eingabe- und Ausgabedaten (einschließlich Training, Aufbewahrung, Löschung und Kunden-Opt-out); Beschränkung der KI vom Zugriff auf irrelevante oder übermäßige Daten; und Hinzufügen von Schutzmaßnahmen gegen das Durchsickern personenbezogener Daten, IP oder das Vermischen von Daten verschiedener Kunden. Kurz gesagt, es zwingt Organisationen, festzulegen, wie Kundendaten durch ihre KI fließen, und verhindert die Art von Datenschutzverletzungen, die Vertrauen zerstören.

Wie baut die AIUC-1-Zertifizierung Kundenvertrauen wieder auf?

AIUC-1-zertifiziert (und versichert) zu werden, signalisiert Kunden, dass das KI-System rigorose Tests gegen bekannte Ausfallmodi bestanden hat. Es ist wie ein Sicherheitsinspektionsbericht für Ihre KI. Unternehmen können dann ehrlich Kunden sagen: „Unsere KI hat überprüfbare Schutzmaßnahmen und sogar Versicherungsschutz." Frühe Anwender berichten, dass diese Glaubwürdigkeit Verträge und Bereitstellung beschleunigt. In der Praxis bedeutet Zertifizierung weniger Marken-Ausrutscher – und wenn trotz Zertifizierung ein Vorfall auftritt, kann die Versicherung die Folgen abdecken. Diese Verantwortlichkeitsschleife ist es, die KI von einem unbekannten Glücksspiel in einen verwalteten Service in den Augen von Geschäftsführern und Kunden verwandelt.

Was passiert, wenn wir diese Standards überspringen?

Die Ignorierung der KI-Governance öffnet die Vertrauensschleusen. Ohne klare Richtlinien oder Tests können AI Agents Daten durchsickern lassen, Urheberrechte verletzen oder gefährlich schlechte Ratschläge geben. Kunden werden es bemerken – beispielsweise werden Bots, die inkonsistente oder irreführende Antworten geben, die Loyalität untergraben. Regulierungsbehörden und die Branche verschärfen auch die Aufsicht. Unternehmen, die „AI-washen" (vorgeben, KI ohne ordnungsgemäße Kontrollen zu verwenden), riskieren rechtliche Schritte: Die SEC und FTC haben bereits Firmen für irreführende KI-Behauptungen sanktioniert. Kurz gesagt, das Überspringen von Standards bedeutet Risiko für Markenschäden, Compliance-Bußgelder und verlorene Kunden.

Wie können CX-Führungskräfte mit der Übernahme von AIUC-1-Praktiken beginnen?

Beginnen Sie mit der Inventarisierung Ihrer KI-Tools und Datenflüsse: Klassifizieren Sie, welche Systeme Kundendaten verarbeiten oder mit Kunden interagieren, und vergleichen Sie sie mit der AIUC-1-Kontroll-Checkliste. Entwickeln oder aktualisieren Sie Ihre KI-Datenschutzrichtlinie (die Eingabe, Ausgabe, Aufbewahrung und Kundenrechte abdeckt). Arbeiten Sie mit Ihren Sicherheits- und Rechtsteams zusammen, um die erforderlichen technischen Kontrollen zu implementieren (z. B. Datenminimierung, Verschlüsselung, Überwachung). Beauftragen Sie frühzeitig einen akkreditierten AIUC-1-Auditor, um die Zertifizierung zu erfassen. Selbst wenn die vollständige Zertifizierung ein längerfristiges Ziel ist, verwenden Sie die Anforderungen des Standards als Lückenanalyse, um Ihre KI-Systeme jetzt zu härten. Kommunizieren Sie schließlich weiterhin mit Stakeholdern (und Kunden), während Sie sich verbessern: Transparenz über diese Bemühungen wird selbst dazu beitragen, das Vertrauen in Ihre KI-Initiativen wieder aufzubauen.

Umsetzbare Erkenntnisse:

- Klare Datenrichtlinien definieren: Schreiben Sie auf, wie KI Kundendaten für Training vs. Inferenz verwenden wird, legen Sie Aufbewahrungsfristen fest und bieten Sie Opt-out-/Löschrechte an.

- AIUC-1 als Framework übernehmen: Verwenden Sie seine Prinzipien, um Sicherheits-, Datenschutz- und Safety-Prüfungen über alle KI-Projekte hinweg zu vereinheitlichen. Erwägen Sie eine Pilotzertifizierung für risikoreiche AI Agents.

- Teamübergreifend zusammenarbeiten: Brechen Sie Silos auf, indem Sie IT, Recht, Compliance und CX in KI-Rollout-Entscheidungen einbeziehen. Behandeln Sie KI-Risikomanagement als gemeinsame Mission.

- Sicherheit durch Design einbetten: Testen Sie vor dem Start AI Agents auf Belastung (Red-Teaming, Prompt-Injektionen) und implementieren Sie Laufzeit-Leitplanken (Modulation, Anomaliewarnungen), um Lecks oder Fehlverhalten zu verhindern.

- KI-Versicherung nutzen: Suchen Sie nach KI-Anbietern mit AIUC-1-Zertifizierung oder Versicherungsabsicherung. Dies richtet Anreize aus und bietet finanziellen Schutz, wenn die KI versagt.

- Transparent gegenüber Benutzern sein: Informieren Sie Kunden, wenn KI im Einsatz ist, und lassen Sie sie wissen, wie ihre Daten verarbeitet werden, basierend auf Microsofts Copilot-Praxis von Echtzeit-Offenlegungen.

- Nur benötigte Daten sammeln: Bevorzugen Sie Qualität vor Quantität. Da Benutzer Datenschutz fordern, sammeln Sie nur die Informationen, die für den Service erforderlich sind, und erklären Sie klar, wie dies ihre Erfahrung verbessert.

- Personal schulen und überwachen: Stellen Sie sicher, dass kundenorientierte Teams KI-Einschränkungen verstehen und klare Eskalationswege haben. Verfolgen Sie CX-Metriken nach der KI-Einführung, um Probleme (wie langsame Reaktion oder Unzufriedenheit) frühzeitig zu erkennen.

Durch die direkte Bewältigung von KI-Risiken und die Übernahme von Frameworks wie AIUC-1 können CX- und EX-Führungskräfte die Vertrauenslücke schließen. In einer Landschaft fragmentierter Journeys und schneller KI-Entwicklung ist dies der Weg, wie Unternehmen von vorsichtiger Experimentierung zu selbstbewusster, kundenzentrierter KI-Bereitstellung übergehen.

Der Beitrag AIUC-1: The New Gold Standard for Trustworthy Enterprise AI erschien zuerst auf CX Quest.

Das könnte Ihnen auch gefallen

Trumps jüngster „besonders unheimlicher" Schritt alarmiert Psychologen: „Er verherrlicht sich selbst"

Ruandas Mineralexporte steigen um 46%, während sich das Handelsdefizit 2025 verringert