โมเดล AI แบบโอเพนซอร์สมีช่องโหว่ต่อการใช้ในทางที่ผิดของอาชญากร นักวิจัยเตือน

แฮกเกอร์และอาชญากรอื่นๆ สามารถควบคุมคอมพิวเตอร์ที่ใช้งานโมเดลภาษาขนาดใหญ่แบบโอเพนซอร์สนอกกรอบการป้องกันและข้อจำกัดของแพลตฟอร์มปัญญาประดิษฐ์หลักได้อย่างง่ายดาย ก่อให้เกิดความเสี่ยงด้านความปลอดภัยและช่องโหว่ นักวิจัยกล่าวเมื่อวันพระหัสบดีที่ 29 มกราคม

แฮกเกอร์สามารถกำหนดเป้าหมายไปที่คอมพิวเตอร์ที่ใช้งาน LLM และสั่งการให้ดำเนินการส่งสแปม สร้างเนื้อหาฟิชชิง หรือแคมเปญบิดเบือนข้อมูล โดยหลีกเลี่ยงโปรโตคอลความปลอดภัยของแพลตฟอร์ม นักวิจัยกล่าว

งานวิจัยที่ดำเนินการร่วมกันโดยบริษัทความปลอดภัยไซเบอร์ SentinelOne และ Censys เป็นระยะเวลา 293 วัน และแบ่งปันโดยเฉพาะกับ Reuters นำเสนอมุมมองใหม่เกี่ยวกับขนาดของกรณีการใช้งานที่อาจผิดกฎหมายสำหรับการติดตั้ง LLM แบบโอเพนซอร์สหลายพันรายการ ซึ่งรวมถึงการแฮ็ก คำพูดที่แสดงความเกลียดชังและการคุกคาม เนื้อหาที่มีความรุนแรงหรือสยดสยอง การขโมยข้อมูลส่วนบุคคล การหลอกลวงหรือการฉ้อโกง และในบางกรณีเป็นสื่อล่วงละเมิดทางเพศเด็ก นักวิจัยกล่าว

แม้ว่าจะมี LLM แบบโอเพนซอร์สหลายพันรูปแบบ แต่ส่วนสำคัญของ LLM บนโฮสต์ที่เข้าถึงได้ผ่านอินเทอร์เน็ตเป็นรูปแบบต่างๆ ของ Llama ของ Meta, Gemma ของ Google DeepMind และอื่นๆ ตามที่นักวิจัยระบุ ในขณะที่โมเดลโอเพนซอร์สบางตัวมีการป้องกัน นักวิจัยระบุกรณีหลายร้อยกรณีที่มีการลบการป้องกันออกอย่างชัดเจน

การสนทนาของอุตสาหกรรม AI เกี่ยวกับการควบคุมความปลอดภัย "กำลังเพิกเฉยต่อความสามารถส่วนเกินประเภทนี้ที่ถูกใช้งานอย่างชัดเจนสำหรับสิ่งต่างๆ มากมาย บางอย่างถูกกฎหมาย บางอย่างเป็นอาชญากรรมอย่างชัดเจน" Juan Andres Guerrero-Saade ผู้อำนวยการฝ่ายข่าวกรองและการวิจัยด้านความปลอดภัยของ SentinelOne กล่าว Guerrero-Saade เปรียบเทียบสถานการณ์กับ "ภูเขาน้ำแข็ง" ที่ไม่ได้รับการคิดคำนึงอย่างเหมาะสมทั่วทั้งอุตสาหกรรมและชุมชนโอเพนซอร์ส

การศึกษาตรวจสอบคำสั่งระบบ

งานวิจัยวิเคราะห์การติดตั้ง LLM แบบโอเพนซอร์สที่เข้าถึงได้สาธารณะที่ติดตั้งผ่าน Ollama ซึ่งเป็นเครื่องมือที่ช่วยให้ผู้คนและองค์กรสามารถใช้งานเวอร์ชันของตนเองของโมเดลภาษาขนาดใหญ่ต่างๆ

นักวิจัยสามารถดูคำสั่งระบบ ซึ่งเป็นคำสั่งที่กำหนดว่าโมเดลจะทำงานอย่างไร ในประมาณหนึ่งในสี่ของ LLM ที่พวกเขาสังเกต จากจำนวนนั้น พวกเขาพิจารณาว่า 7.5% อาจเปิดใช้งานกิจกรรมที่เป็นอันตรายได้

ประมาณ 30% ของโฮสต์ที่นักวิจัยสังเกตดำเนินการจากจีน และประมาณ 20% ในสหรัฐอเมริกา

Rachel Adams ซีอีโอและผู้ก่อตั้ง Global Center on AI Governance กล่าวในอีเมลว่าเมื่อโมเดลเปิดถูกเปิดตัว ความรับผิดชอบต่อสิ่งที่เกิดขึ้นต่อไปจะกลายเป็นการแบ่งปันทั่วทั้งระบบนิเวศ รวมถึงห้องปฏิบัติการต้นทาง

"ห้องปฏิบัติการไม่ได้รับผิดชอบต่อการใช้ในทางที่ผิดทุกกรณีในขั้นตอนถัดไป (ซึ่งยากต่อการคาดการณ์) แต่พวกเขายังคงมีหน้าที่ดูแลที่สำคัญในการคาดการณ์อันตรายที่คาดการณ์ได้ บันทึกความเสี่ยง และจัดหาเครื่องมือและคำแนะนำในการบรรเทา โดยเฉพาะอย่างยิ่งเมื่อพิจารณาจากความสามารถในการบังคับใช้ทั่วโลกที่ไม่สม่ำเสมอ" Adams กล่าว

โฆษกของ Meta ปฏิเสธที่จะตอบคำถามเกี่ยวกับความรับผิดชอบของนักพัฒนาในการจัดการกับข้อกังวลเกี่ยวกับการใช้โมเดลโอเพนซอร์สในทางที่ผิดในขั้นตอนถัดไป และวิธีการรายงานข้อกังวล แต่ระบุถึงเครื่องมือ Llama Protection ของบริษัทสำหรับนักพัฒนา Llama และ Meta Llama Responsible Use Guide ของบริษัท

Ram Shankar Siva Kumar หัวหน้าทีม Microsoft AI Red Team กล่าวในอีเมลว่า Microsoft เชื่อว่าโมเดลโอเพนซอร์ส "มีบทบาทสำคัญ" ในหลายด้าน แต่ "ในขณะเดียวกัน เรามองเห็นอย่างชัดเจนว่าโมเดลเปิด เช่นเดียวกับเทคโนโลยีเปลี่ยนแปลงทั้งหมด สามารถถูกใช้ในทางที่ผิดโดยฝ่ายตรงข้ามได้หากเปิดตัวโดยไม่มีมาตรการป้องกันที่เหมาะสม"

Microsoft ดำเนินการประเมินก่อนเปิดตัว รวมถึงกระบวนการประเมิน "ความเสี่ยงสำหรับสถานการณ์ที่เปิดเผยทางอินเทอร์เน็ต การโฮสต์ด้วยตนเอง และการเรียกใช้เครื่องมือ ซึ่งการใช้ในทางที่ผิดอาจสูง" เขากล่าว บริษัทยังติดตามภัยคุกคามที่เกิดขึ้นใหม่และรูปแบบการใช้ในทางที่ผิด "ท้ายที่สุด นวัตกรรมเปิดที่มีความรับผิดชอบต้องการความมุ่งมั่นร่วมกันจากผู้สร้าง ผู้ติดตั้ง นักวิจัย และทีมความปลอดภัย"

Ollama ไม่ตอบสนองต่อคำขอแสดงความคิดเห็น Google ของ Alphabet และ Anthropic ไม่ตอบคำถาม – Rappler.com

คุณอาจชอบเช่นกัน

XRP ทำ Golden Cross ระยะสั้นสำเร็จ: Breakout หรือ Fakeout?

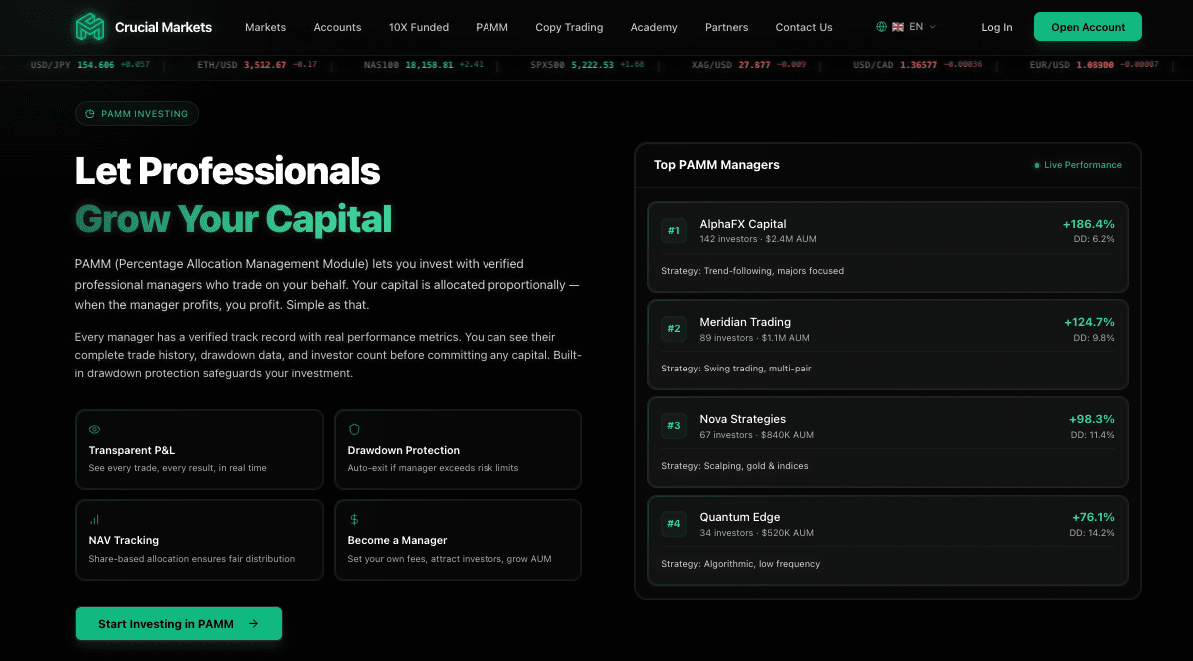

Crucial Markets ขยายโครงสร้างพื้นฐาน Copy Trading และ PAMM

![[LENTE | อัปเดต] การให้ความรู้แก่ผู้มีสิทธิเลือกตั้งสำหรับการเลือกตั้ง BARMM ปี 2026 ดำเนินต่อไปในตาวีตาวี](https://lente.rappler.com/tachyon/sites/12/2026/04/BCPCH-2-2-scaled.png?resize=75%2C75&crop_strategy=attention)